镜头切换自然,节奏有急有缓,创作这样高质量的视频,需要怎样的专业剪辑技巧?

答案是,不用剪,会写就行。

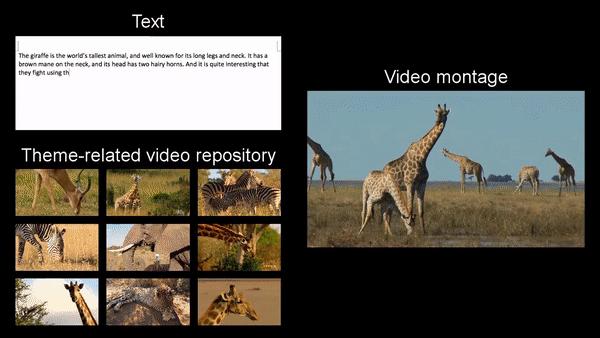

比如要剪辑一个有关长颈鹿的片段,你只需要告诉AI:

The giraffe is the world’s tallest animal, and well known for its long legs and neck.

长颈鹿是世界上最高的动物,以其长腿和长脖子闻名于世。

It has a brown mane on the neck, and its head has two hairy horns.

它的脖子上有棕色的鬃毛,头上长了两只毛茸茸的角。

AI就能自动剪辑完成这样的画面:

先展示一下长颈鹿群的全貌。接着镜头切给一只奔跑中的长颈鹿,展示一下它的长腿长脖子。按照指示,再给鬃毛和犄角来个特写,齐活!

是的,不再需要费劲挑选素材,一帧一帧地来回倒腾:

只需要把你脑海中的创意转化成简短的文字,这个名叫Write-A-Video的AI就能读懂你的心,从选材到剪辑,一站式完成创作。

这就是北航、清华、哈佛和以色列赫兹利亚跨学科研究中心的科学家联手打造的最新AI神器,只需主题脚本,就能生成视频。

用文字创作视频

现在,准备好素材,我们一起来看看,Write-A-Video到底是怎样“写”出一个视频来的。

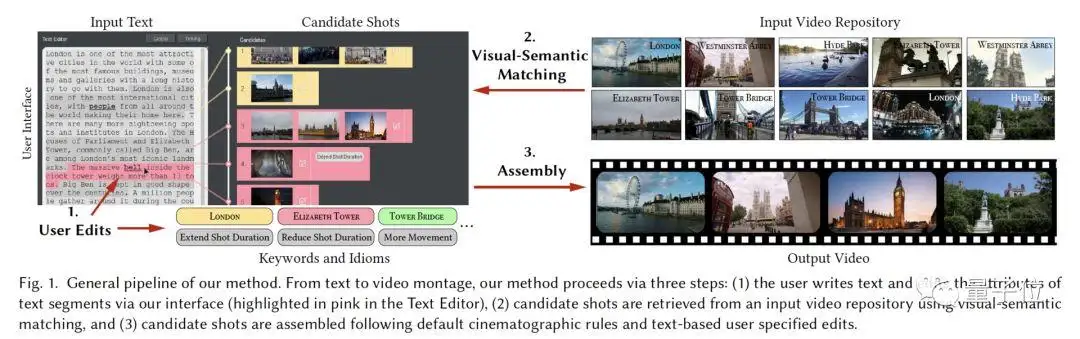

整个过程分为三步。

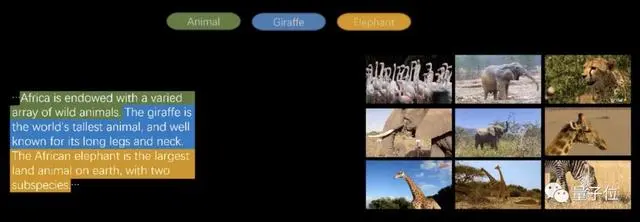

第一步,用户以文本的形式提供输入。Write-A-Video会挑选出句子中的关键词。

第二步,Write-A-Video会利用关键词,把素材库里与之相匹配的候选片段挑出来。

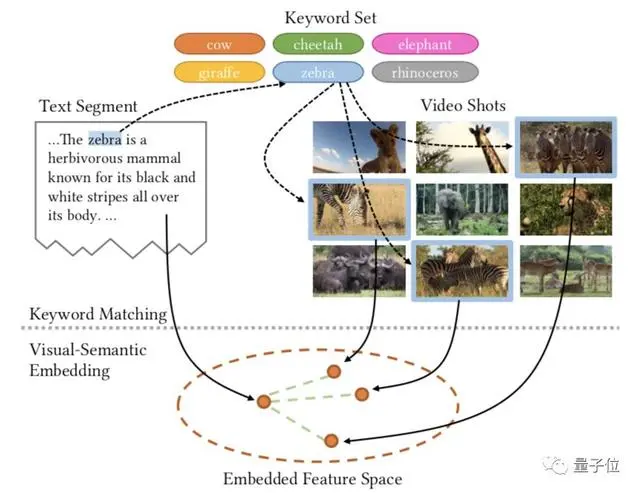

文本和镜头之间的视觉语义匹配主要包括两个步骤:关键字匹配和视觉语义嵌入。

首先,AI会根据脚本从素材库中检索所有带有关键字标签的视频镜头。

素材库中的所有视频均被分割为快照,便于语义匹配,还能在下一步正式剪辑视频时,让用户用电影术语来指导AI创作。

Write-A-Video的作者,北京航空航天大学的汪淼老师介绍说,Write-A-Video允许用户在输入文本中使用电影术语,以探索每个场景不同的视觉风格,比如调整电影的节奏,画面的调动等。

此外,采用基于直方图的分割算法,如果帧与帧之间在HSV色域中的直方图相差超过80%,并且追踪的SURF关键点80%以上不匹配,那么算法就会以这两帧为界,切分镜头。

太长(>30s)或太短(<2s)的镜头也会被舍弃,因为短镜头观感不好,而长镜头会降低效率和可变性

而后,视觉语义嵌入技术会为每个检索到的镜头计算匹配分数,排名最高的镜头就会被选为候选镜头。

这里采用的方法是 VSE++ (论文地址见文末)。该方法能将跨模型内容编码到联合特征空间中,比如把文本和镜头联系起来。

在嵌入空间中,从镜头中每十帧抽取一帧,计算其与文本之间的余弦相似度,最后取平均值,即为判断镜头能否入选的最终得分。

第三步,就是将这些镜头组合在一起,完成视频的剪辑。

这一步,其实是Write-A-Video对镜头的混合优化。而它也有自己的审美标准。

首先,画面应该是明亮而生动的。

其次,镜头不能晃动得太厉害。

最后,要避免不连贯的跳接(jump cut)和相反的相机运动。

值得一提的是,Write-A-Video对用户非常友好。

查找对应镜头,剪切,重新排列,都可以用添加、删除文本及移动句子等文本编辑的形式进行。不用掌握剪辑技巧,更不用会敲代码。

不仅如此,在下面这个视频中,你会发现,敲进去的文字还可以转成配音旁白,渲染影片气氛。

并且,旁白和视频完全同步,对应得十分自然。提到白金汉宫时,镜头就自然地转到了白金汉宫门前。而提到皇家护卫队时,画面便给到了表演中的皇家护卫队。

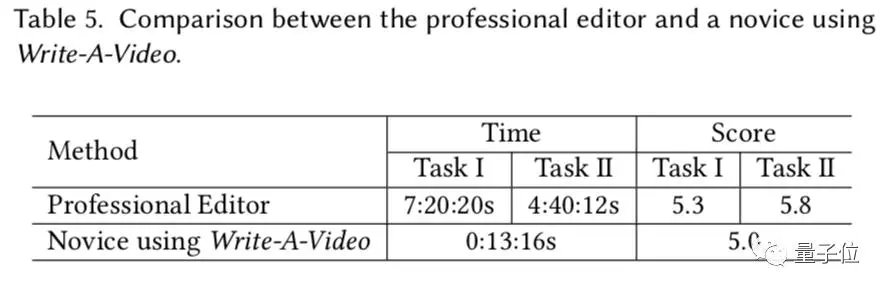

研究团队表示,跟商用的逐帧处理视频编辑器比起来,用上Write-A-Video,创作起来快多了。

有了Write-A-Video,甚至新手,都能以快得多的速度(13分钟:7小时),完成质量与职业剪辑师差距不大的视频剪辑任务。

在不久前结束的SIGGRAPH Asia 2019会议上,研究团队报告并展示了Write-A-Video这一成果,得到了国际同行的广泛认可。

北航清华团队出品

Write-A-Video的第一作者汪淼博士,现为北京航空航天大学虚拟现实技术与系统国家重点实验室助理研究员,硕士生导师。

他本科毕业于西安电子科技大学,后于2016年获得清华大学博士学位,师从论文通讯作者,清华大学计算机系胡事民教授。

论文作者中的杨国炜参加该项目时,只是一位本科生,现已在清华大学计算机系攻读博士学位。

另外两位作者,分别是菲尔兹奖得主、哈佛大学教授、美籍华人数学家丘成桐,以及以色列赫兹利亚跨学科研究中心院长艾里尔·沙米尔(Ariel Shamir)。

传送门

视频链接:

https://vimeo.com/357657704

论文地址:

http://www.faculty.idc.ac.il/arik/site/writeVideo.asp

https://dl.acm.org/citation.cfm?id=3355089

注:TOG2019年的第177号论文

VSE++论文地址:

https://arxiv.org/abs/1707.0561

王光卫博客

用户思维很有必要对用户进行数据分析

王光卫博客

用户思维很有必要对用户进行数据分析

一路向北

赞

一路向北

赞