在过去几年里,从实验室走向消费者的AI生成内容技术可谓是互联网上最热门的话题之一。

而在其中,Ai驱动的“文字生成图片(Text-to-Image,T2I)”在此之前已经有不少企业和产品取得了相当精致的效果,从英伟达已经多次升级的GauGAN AI、OpenAI的DALL·E,到最近大放异彩的Midjourney、Stable Fusion、百度的“一格”等,都是其中的佼佼者

而众所周知,视频就是一张张图像的集合,在“文字生成图片”到“文字生成视频(Text-to-Video,T2V)”自然也是AI在相关领域的自然发展,近日,Meta就公布了旗下最新的T2V工具,并为其起了个相当朴实易懂的名字“Make-A-Video”,并开放了预约。

根据Meta官网和相关论文的介绍,“Make-A-Video的研究是建立在T2I生成技术的最新进展之上的”,不过Meta也表示,虽然目前T2I已经取得了巨大的突破,但是T2V其实很难复刻该技术的成功路线。毕竟最简单的,互联网上带有文字描述的图片可是一爬一大把,但带有详细描述的视频,却少得多。

Meta表示,“Make-A-Video”相较于目前行业内的一些其他技术,就比如CogVideo、Video Diffusion等,有三大优势,首先它加速了T2V模型的训练(它不需要从头开始学习视觉和多模态表示);其次它不需要成对的文本-视频数据;最后,“Make-A-Video”生成的视频的多样性,包括审美、艺术风格等都十分丰富。

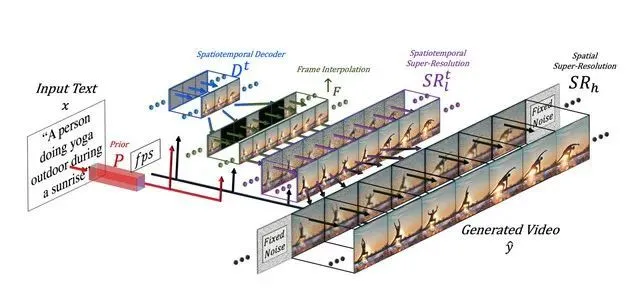

“Make-A-Video”官网的论文显示,该工具的基础运行逻辑简单来说就是,当用户输入一串文字后,系统会生成16张在时间上有连续性的64X64像素的RGB图片,然后这作品图片将会通过插值模型增加视频的帧数,让前后帧之间的动作更加平滑,之后通过两个超分辨率模型,将图像的像素提升到256×256像素后,再提升到768×768像素,生成高分辨率和帧率的视频。

当然具体流程和细节上会更加专业和高深,这只是一个通俗的概述。

在Meta的官网,官方展示了大量T2V的案例就比如“身着超人服装在天空飞翔的狗”:

猫猫手拿遥控器看电视:

饮马:

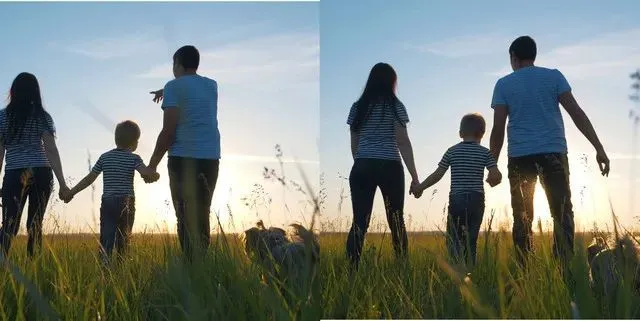

除了“文字生成图片”,“Make-A-Video”还可以根据一个视频生成同类型,不同内容的视频:

原视频

AI生成视频

让静止的图片动起来:

原图(图片来自Meta的Make-A-Video官网)

AI生成内容:

补全两张图片之间的内容:

原图(图片来自Meta的Make-A-Video官网)

AI生成视频

就在Meta宣布了“Make-A-Video”工具后,一系列研究相关工具的团队都公开了它们的成果,T2I工具Stable Fusion的开发者更是公开叫板Meta,表示我们的模型只会更好,“并且(相较于Meta工具尚未开放),人们或许真的有机会用到我们的工具”。

另一个名为“Phenaki”的团队更是整了个大活,直接丢出了可以利用一大段文字生成短片的工具,该工具不仅可以生成短片,甚至可以用文字运镜,开发者甚至已经用该工具生成了一个时长两分钟的视频。

在AI抢占分类工作之前,AI之间恐怕就要先进行数轮的比拼,卷出最后的获胜者。

以下是Phenaki生成的两分钟短片(原版清晰度就一般,压缩后(只有128×128)凑合着看,感兴趣的可以前往Phenaki官网查看内容,不过现阶段清晰度也不是重点):

该短片使用的关键词:

(机器翻译)未来城市的交通很拥挤。一艘外星飞船到达了未来的城市。摄像机进入了外星飞船内部。镜头向前移动,直到出现一个宇航员在蓝色的房间里。宇航员正在键盘上打字。摄像机从宇航员身上移开。宇航员离开键盘,走到左边。宇航员离开了键盘,走开了。摄像机会越过宇航员,转向屏幕。宇航员身后的屏幕上显示着在海里游泳的鱼。急速放大到蓝色的鱼。我们跟着蓝色的鱼,因为它在黑暗的海洋中游泳。相机透过水面对着天空。未来城市的海洋和海岸线。冲向一座未来的摩天大楼。摄像机将镜头对准众多窗户中的一扇。我们在一间空桌子的办公室里。一只狮子在办公桌上奔跑。镜头对准了办公室里狮子的脸。镜头缩小到办公室里穿着深色西装的狮子。穿衣服的狮子看着镜头笑了。镜头慢慢移到摩天大楼的外部。现代城市中日落的时间流逝

(官网原文)Lots of traffic in futuristic city. An alien spaceship arrives to the futuristic city. The camera gets inside the alien spaceship. The camera moves forward until showing an astronaut in the blue room. The astronaut is typing in the keyboard. The camera moves away from the astronaut. The astronaut leaves the keyboard and walks to the left. The astronaut leaves the keyboard and walks away. The camera moves beyond the astronaut and looks at the screen. The screen behind the astronaut displays fish swimming in the sea. Crash zoom into the blue fish. We follow the blue fish as it swims in the dark ocean. The camera points up to the sky through the water. The ocean and the coastline of a futuristic city. Crash zoom towards a futuristic skyscraper. The camera zooms into one of the many windows. We are in an office room with empty desks. A lion runs on top of the office desks. The camera zooms into the lion’s face, inside the office. Zoom out to the lion wearing a dark suit in an office room. The lion wearing looks at the camera and smiles. The camera zooms out slowly to the skyscraper exterior. Timelapse of sunset in the modern city。

相关推荐: Meta发布Make-A-Video,这个AI文本生成视频工具太神奇了!

在过去几年里,从实验室走向消费者的AI生成内容技术可谓是互联网上最热门的话题之一。 而在其中,Ai驱动的“文字生成图片(Text-to-Image,T2I)”在此之前已经有不少企业和产品取得了相当精致的效果,从英伟达已经多次升级的GauGAN AI、OpenA…

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง