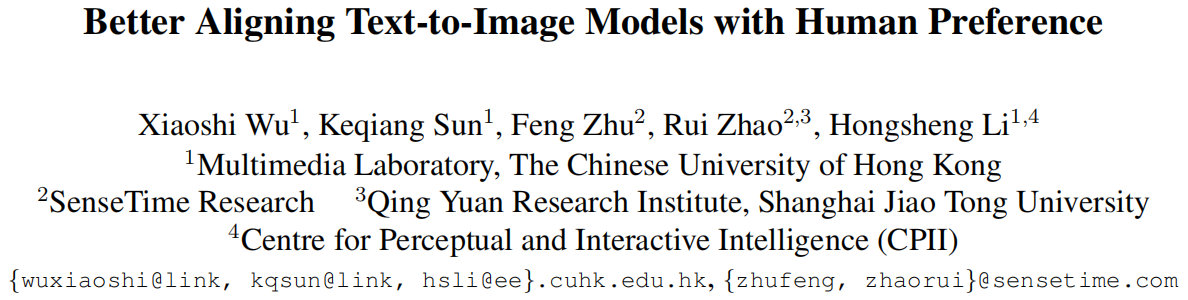

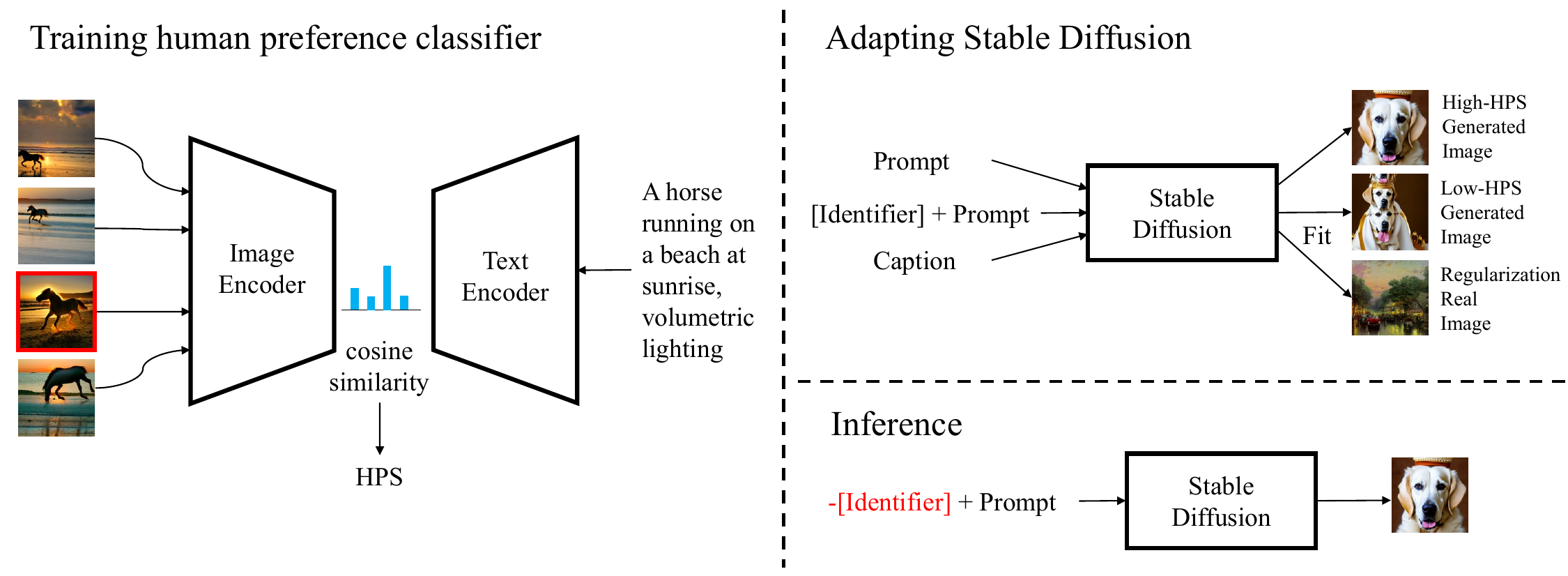

近年来,深度生成模型快速增长,文本到图像模型在公众中获得了显着关注。然而,现有的模型常常生成的图像与人类审美偏好不符,例如肢体和面部表情的奇怪组合。为了解决这个问题,本文收集了一个人类选择生成图像的数据集,来自Stable Foundation Discord频道。本文的实验表明,目前的生成模型评估指标与人类选择的相关性不高。因此,本文使用收集的数据集训练了一个人类喜好分类器,并根据分类器得出了基于人类喜好的得分(HPS)。使用HPS,本文提出了一种简单而有效的方法,将Stable Diffusion适应于更符合人类审美偏好。本文的实验表明,HPS在预测人类选择方面优于CLIP,并具有对其他模型生成的图像的良好泛化能力。通过在HPS的指导下调整Stable Diffusion,适应模型能够生成更受人类用户喜爱的图像。

标题:Better Aligning Text-to-Image Models with Human Preference

作者:Xiaoshi Wu, Keqiang Sun, Feng Zhu, Rui Zhao, Hongsheng Li,

论文:https://arxiv.org/pdf/2303.14420.pdf

项目:https://tgxs002.github.io/align_sd_web/

正文完

可以使用微信扫码关注公众号(ID:xzluomor)

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง