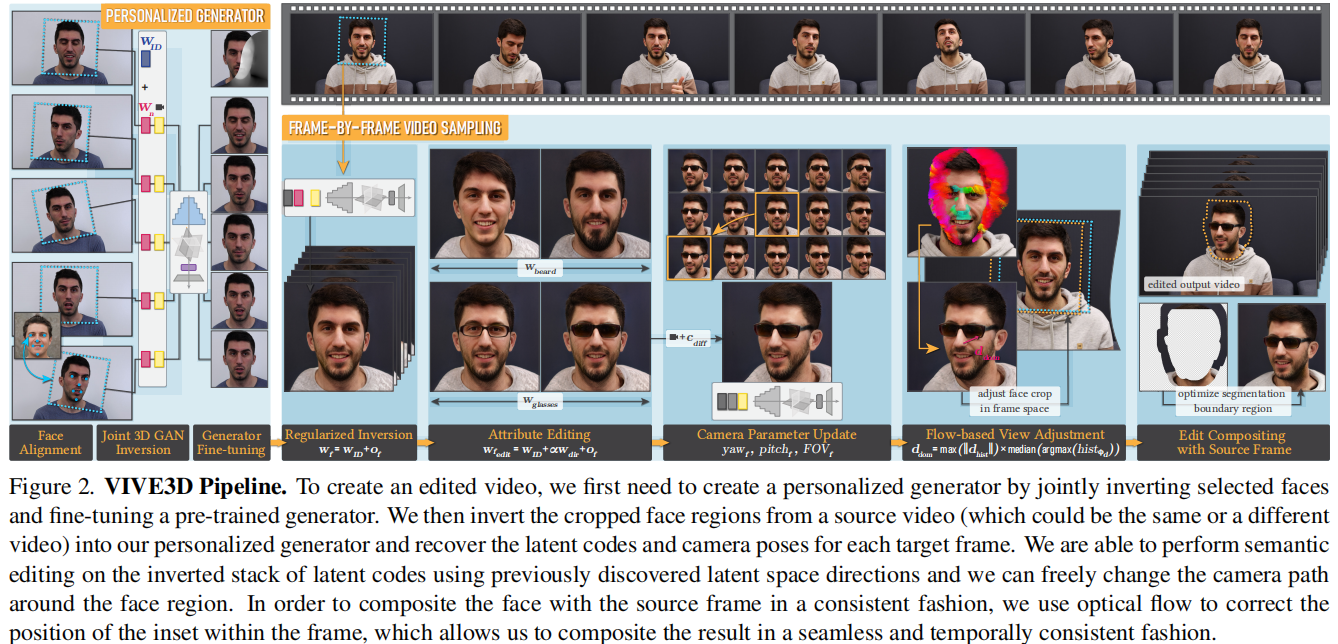

本文介绍了VIVE3D,一种新颖的方法将基于图像的3D GAN的能力扩展到视频编辑,并能以保持身份和时间一致的方式表示输入视频。本文提出了两个新的构建块。首先,通过联合嵌入多个帧并优化相机参数引入了一种新颖的GAN反演技术,专门针对3D GAN。其次,除了传统的语义面部编辑(例如年龄和表情),本文是第一个展示了利用3D GAN的固有属性和本文的光流引导合成技术来组合头部和背景视频,从而实现头部新视角编辑的。本文的实验表明,VIVE3D从各种摄像机角度生成高保真度的面部编辑,并以时间和空间一致的方式与原始视频组合。

标题:VIVE3D: Viewpoint-Independent Video Editing using 3D-Aware GANs

作者:Anna Frühstück , Nikolaos Sarafianos ,Yuanlu Xu , Peter Wonka and Tony Tung

论文:https://papers.labml.ai/api/v1/redirect/pdf?paper_key=94cfe9fecdd211edb95839eec3084ddd

项目:http://afruehstueck.github.io/vive3D/

正文完

可以使用微信扫码关注公众号(ID:xzluomor)

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง