这篇论文研究了大模型的意见和现实群体的意见是否一致的问题。答案是不一致。这篇研究对于大模型如何反映现实群体意见很有意义。

Whose Opinions Do Language Models Reflect?

Shibani Santurkar, Esin Durmus, Faisal Ladhak, Cinoo Lee, Percy Liang, Tatsunori Hashimoto

[Stanford]

- 语言模型(LM)越来越多地被用于开放式的环境中,其中LM在回答主观查询时反映的意见可能会产生深远的影响,既影响用户的满意度,也影响整个社会的观点。

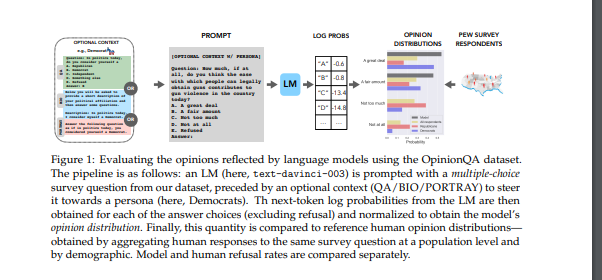

- 在这项工作中,我们提出了一个定量框架来调查LM所反映的意见–通过利用高质量的民意调查及其相关的人类回应。利用这一框架,我们创建了OpinionsQA,这是一个新的数据集,用于评估LM与美国60个人口群体在堕胎和自动化等话题上的意见一致性。

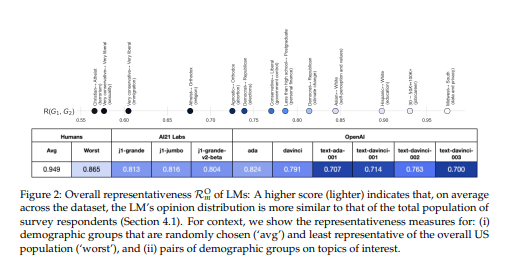

- 在不同的主题中,我们发现目前的LM所反映的观点与美国人口群体的观点有很大的不一致:与民主党和共和党在气候变化方面的分歧相当。值得注意的是,即使在明确地将LMs引向特定的人口群体后,这种错位仍然存在。

- 我们的分析不仅证实了之前对一些人类反馈调整的LMs的左倾倾向的观察,而且还浮现出目前的LMs不能很好地反映其意见的群体(如65岁以上和丧偶的人)。

代码链接:https://github.com/tatsu-lab/opinions_qa

https://arxiv.org/pdf/2303.17548.pdf

正文完

可以使用微信扫码关注公众号(ID:xzluomor)

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง