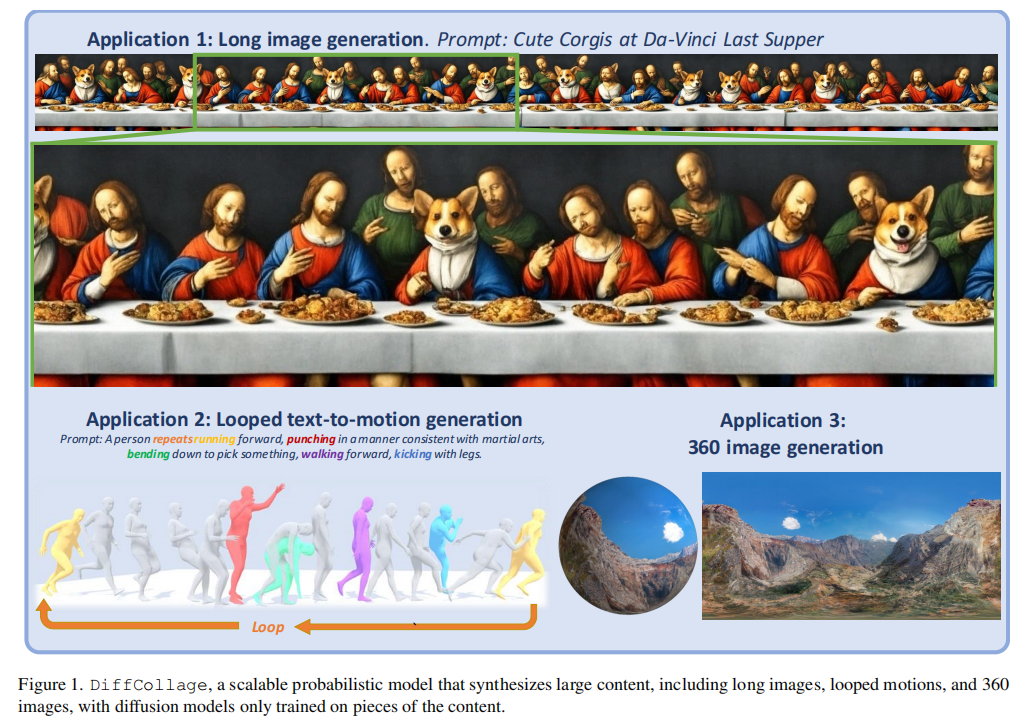

这篇论文介绍了一种名为DiffCollage的方法,该方法可以以更快的速度生成大规模的图像,并保留原始内容的细节。作者指出,传统的生成模型(如GANs)在处理大规模图像时会面临内存和计算资源的限制,而DiffCollage可以通过并行化生成过程来优化计算效率。

DiffCollage使用扩散模型(Diffusion Models)作为其主要生成器,并且具有以下优点:

- 可以生成高分辨率图像,并且保留了原始内容的细节;

- 可以预处理各种图像基础数据集,从而生成更加多样化的图像;

- 可以在多个GPU上进行并行计算,提高生成速度。

此外,DiffCollage还使用了两个技术来进一步优化生成效率:切片生成和哈希近似。切片生成技术可以将生成过程切分成多个子任务,再使用多个GPU进行并行计算,而哈希近似技术则可以有效地减少内存使用量。

实验结果表明,DiffCollage比传统的生成模型在保留图像细节和生成速度方面具有更好的性能。因此,DiffCollage可以在多个应用场景下发挥重要作用,如图像合成、视频生成、素材生成等。

标题:DiffCollage: Parallel Generation of Large Content with Diffusion Models

作者:Qinsheng Zhang,Jiaming Song,Xun Huang,Yongxin Chen,Ming-Yu Liu

正文完

可以使用微信扫码关注公众号(ID:xzluomor)

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง