OrienterNet: Visual Localization in 2D Public Maps with Neural Matching

Paul-Edouard Sarlin, Daniel DeTone, Tsun-Yi Yang, Armen Avetisyan, Julian Straub, Tomasz Malisiewicz, Samuel Rota Bulo, Richard Newcombe, Peter Kontschieder, Vasileios Balntas

[Meta Reality Labs & ETH Zurich]

OrienterNet: 用神经匹配在2D开放地图中进行视觉定位

要点:

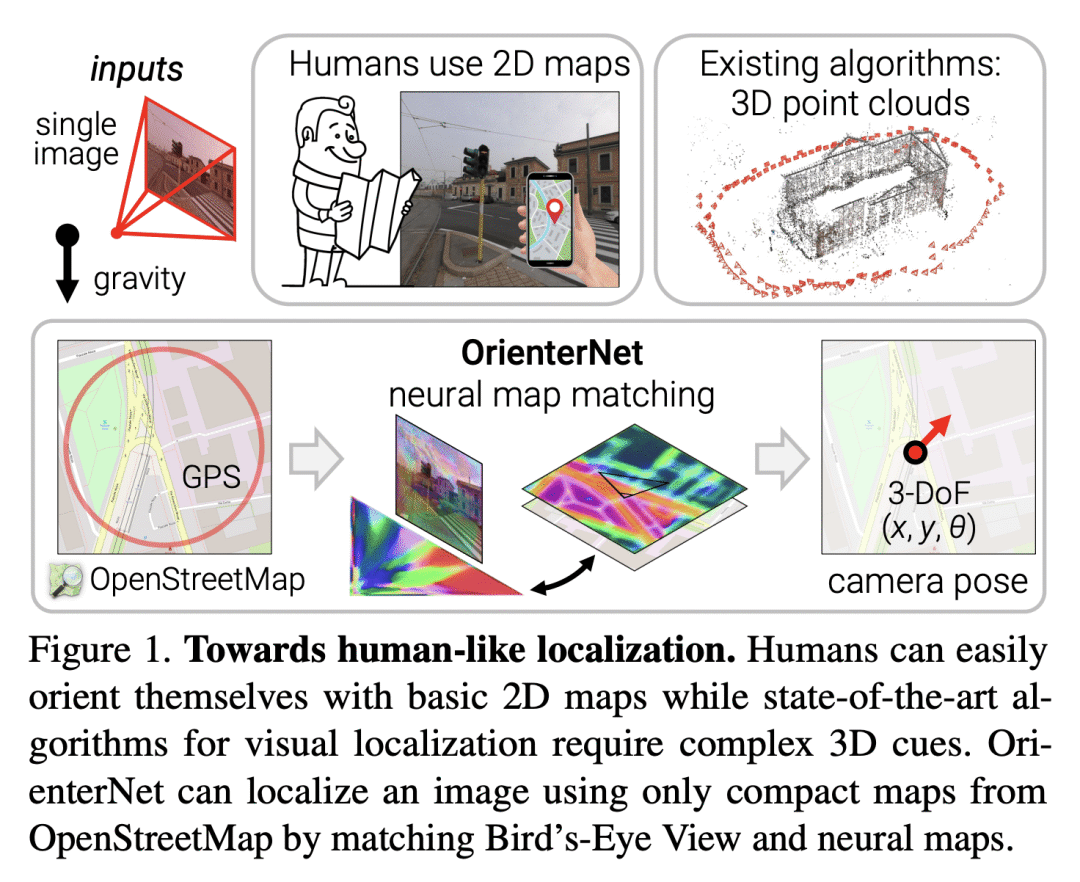

- 动机:大多数视觉定位算法都依赖于复杂的3D点云,这些点云的建立、存储和维护成本高昂。本文介绍了OrienterNet,它是第一个可以用与人相同的2D语义地图定位图像的深度神经网络。

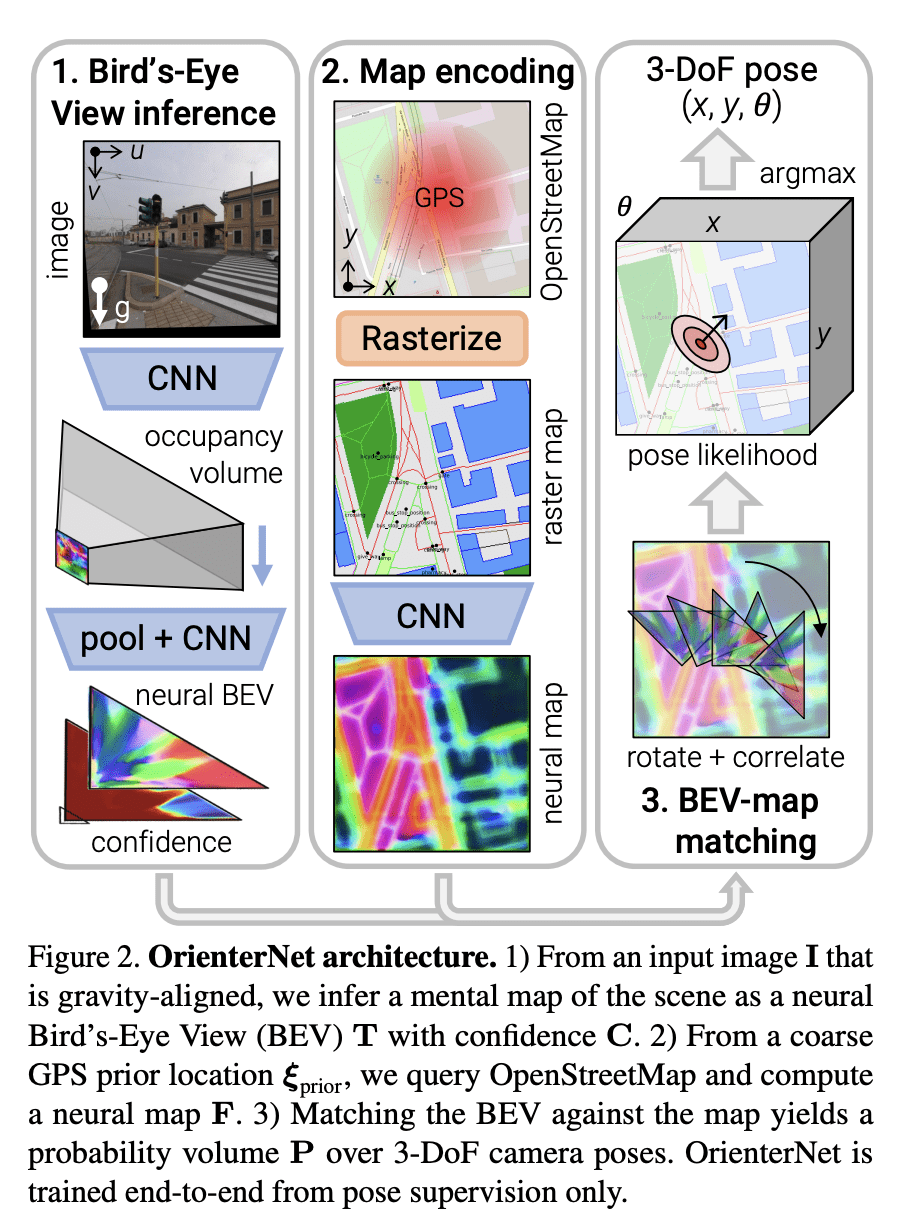

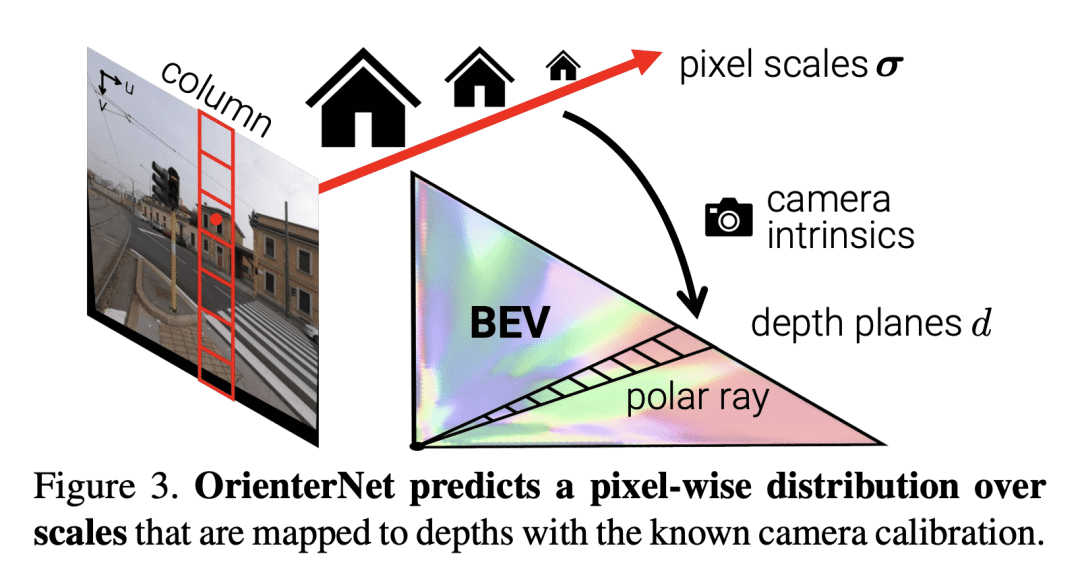

- 方法:通过将神经鸟瞰图与来自OpenStreetMap的开放全球可用地图进行匹配,OrienterNet可以估计查询图像的位置和方向。该模型仅受相机姿态监督,但可以学习在端到端方式下执行广泛的地图元素的语义匹配。

- 优势:OrienterNet可以使用来自OpenStreetMap的全球和免费地图,任何人都可以在这些地图可用的地方进行定位。同时,OrienterNet具有高速和可解释性,能够泛化到之前未见过的城市和不同视角的图像,并显著提高了3-DoF定位的性能。

OrienterNet是一种深度神经网络,可以通过匹配2D语义地图与OpenStreetMap的全球开放地图,实现图像的定位和方向估计,精度可达到小于1米。

https://arxiv.org/abs/2304.02009

正文完

可以使用微信扫码关注公众号(ID:xzluomor)

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง