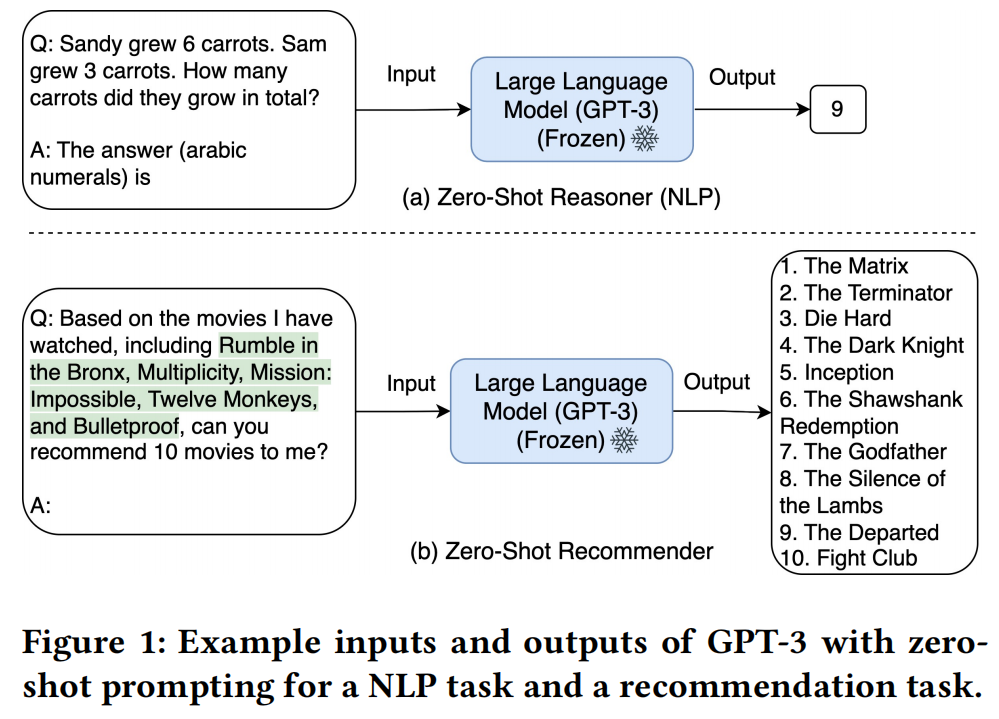

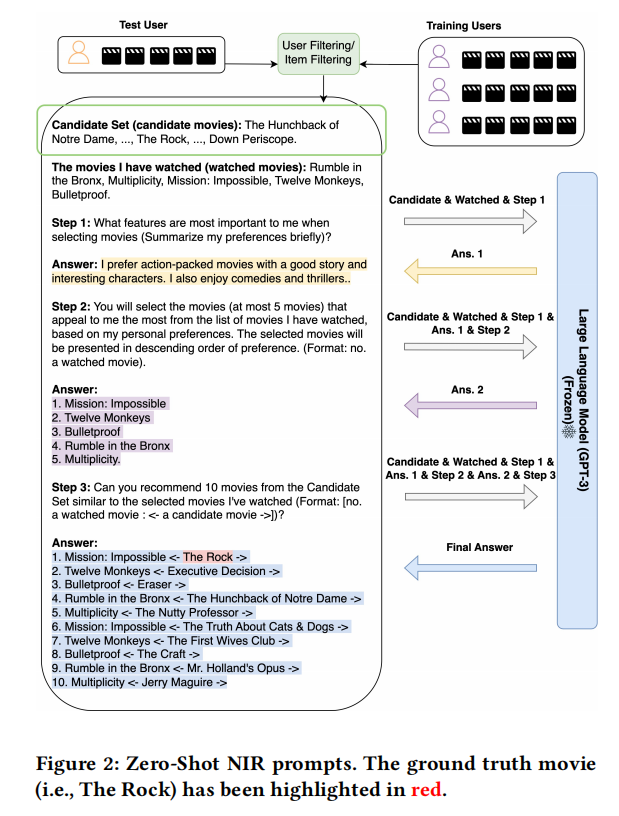

大型语言模型(LLMs)在各种自然语言处理(NLP)任务中已经取得了令人瞩目的零样本表现,展示了它们在没有训练样例的情况下进行推理的能力。尽管LLMs获得了成功,但迄今尚未有研究探索LLMs在零样本设置中执行下一个推荐项的潜力。我们确定了必须解决的两个主要挑战,以使LLMs有效地充当推荐器。首先,对于LLMs来说,推荐空间可能非常大,而且LLMs不知道目标用户过去交互的项目和偏好。为了解决这个问题,我们提出了一种提示策略,称为“零样本下一项推荐(NIR)提示”,以指导LLMs进行下一个项目的推荐。具体而言,基于过滤的用户或项目,NIR策略涉及使用外部模块生成候选项。我们的策略包含一个三步提示,引导GPT-3进行捕捉用户偏好的子任务,选择代表性的以前观看过的电影,并推荐一个排名前10名的电影列表。我们在MovieLens 100K数据集上使用GPT-3对所提出的方法进行评估,并显示它取得了强大的零样本性能,甚至胜过了一些训练整个训练数据集的强序列推荐模型。这些有希望的结果突显了使用LLMs作为推荐器的丰富研究机会。

总结:

本文介绍了一种使用大型预训练语言模型进行零样本下一项推荐的方法。这个方法利用预训练的语言模型对用户查询和商品描述进行编码,使用一个多分类器将编码后的查询向量和商品描述向量匹配,最终选择分数最高的商品作为推荐结果。实验结果表明,该方法在不需要用户历史记录的情况下可以有效地进行下一项推荐,并取得了与其他先进方法相当的结果。

标题:Zero-Shot Next-Item Recommendation using Large Pretrained Language Models

代码:https://github.com/AGI-Edgerunners/LLM-Next-Item-Rec

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง