标题:DreamPose: Fashion Image-to-Video Synthesis via Stable Diffusion

作者:Johanna Karras, Aleksander Holynski, Ting-Chun Wang, Ira Kemelmacher-Shlizerman

[University of Washington, UC Berkeley, Google Research, NVIDIA]

简介:

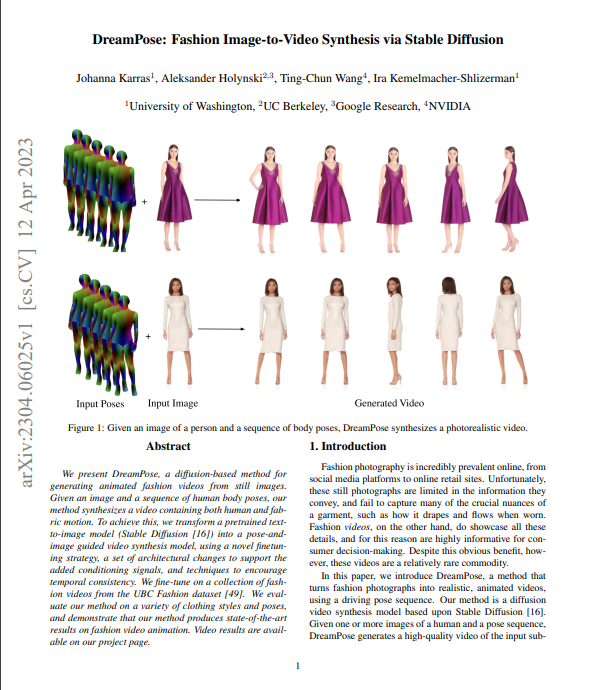

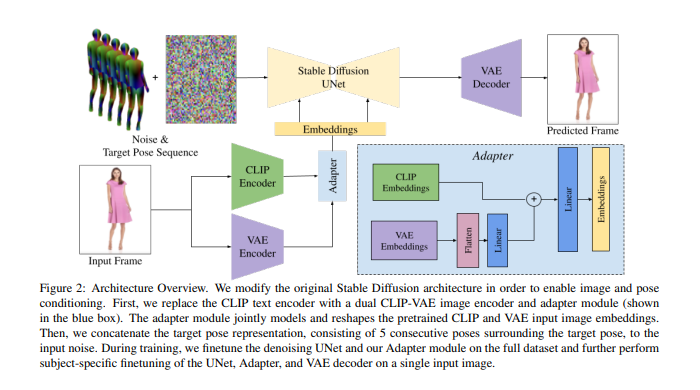

本文提出了DreamPose,一种基于扩散的方法,用于从静止图像生成动画时装视频。给定一张图片和一连串的人体姿势,我们的方法可以合成一个包含人体和织物运动的视频。为了实现这一目标,我们将一个预先训练好的文本-图像模型(稳定扩散)转化为一个姿势-图像引导的视频合成模型,使用一种新的微调策略、一套架构变化来支持添加的调节信号,以及鼓励时间一致性的技术。

我们在UBC时尚数据集的时尚视频集合上进行微调。我们在各种服装风格和姿势上评估了我们的方法,并证明我们的方法在时尚视频动画上产生了最先进的结果。

视频结果可在我们的项目页面上找到。

project page: https://grail.cs.washington.edu/projects/dreampose/…

github: https://github.com/johannakarras/DreamPose

https://arxiv.org/pdf/2304.06025.pdf

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง