OmnimatteRF: Robust Omnimatte with 3D Background Modeling

G Lin, C Gao, J Huang, C Kim, Y Wang, M Zwicker, A Saraf

[Meta & University of Maryland]

OmnimatteRF:基于3D背景建模的鲁棒Omnimatte视频抠图

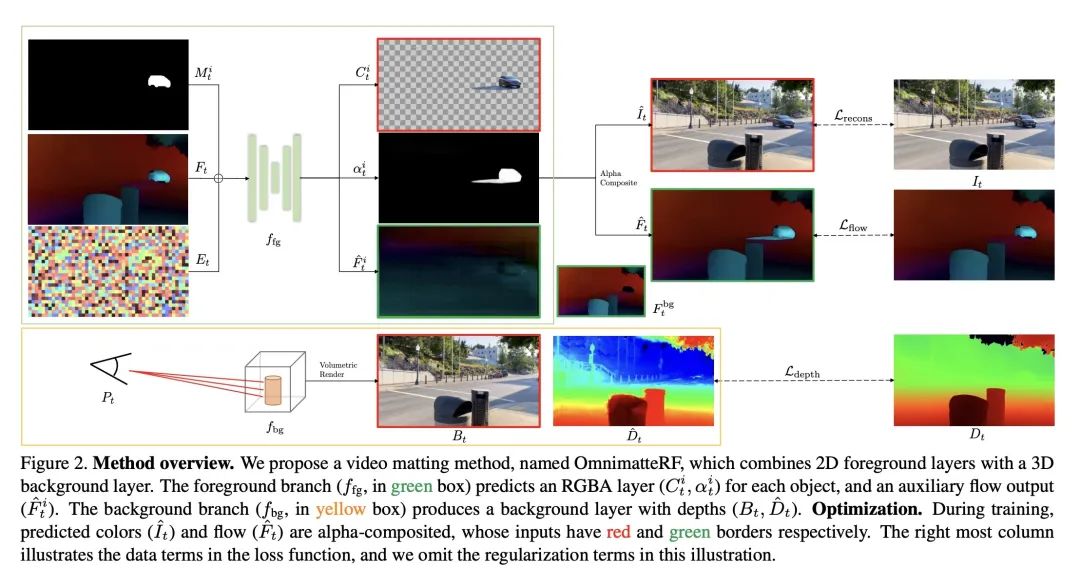

提出一种新的视频抠图方法OmnimatteRF,将2D前景层和3D背景模型相结合。

-

轻量的2D前景层可以捕获动态对象的细节,而3D背景模型可以处理复杂的场景。

-

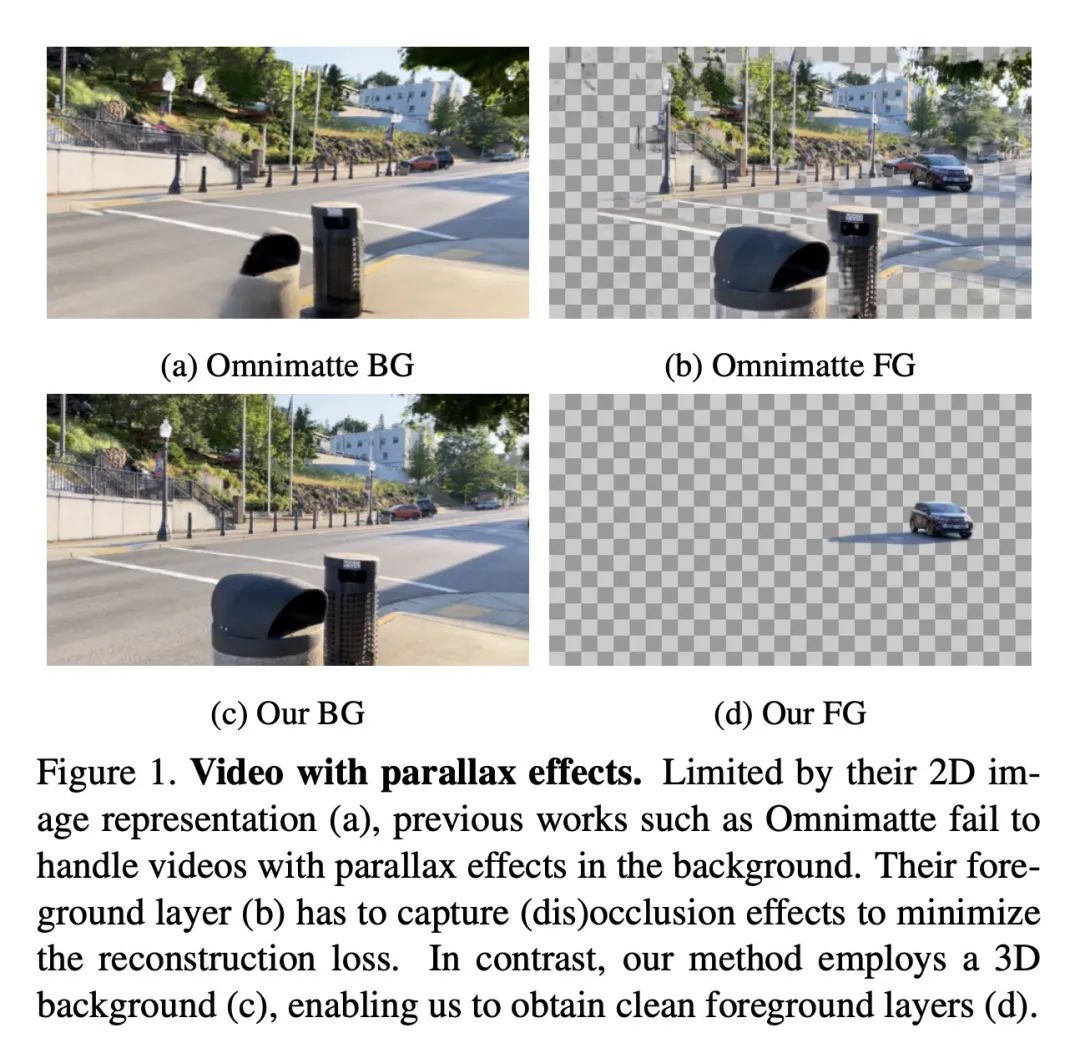

Omnimatte使用2D背景图像,无法处理具有视差的视频。D2NeRF使用两个3D模型,但无法很好地处理多个前景对象。

-

所提出的方法保留2D前景层,并为静态3D背景使用辐射场。前景层提供对象细节,背景支持处理视差。

-

重建损失同时监督前景和背景分支,流和深度等附加损失改进了结果。

-

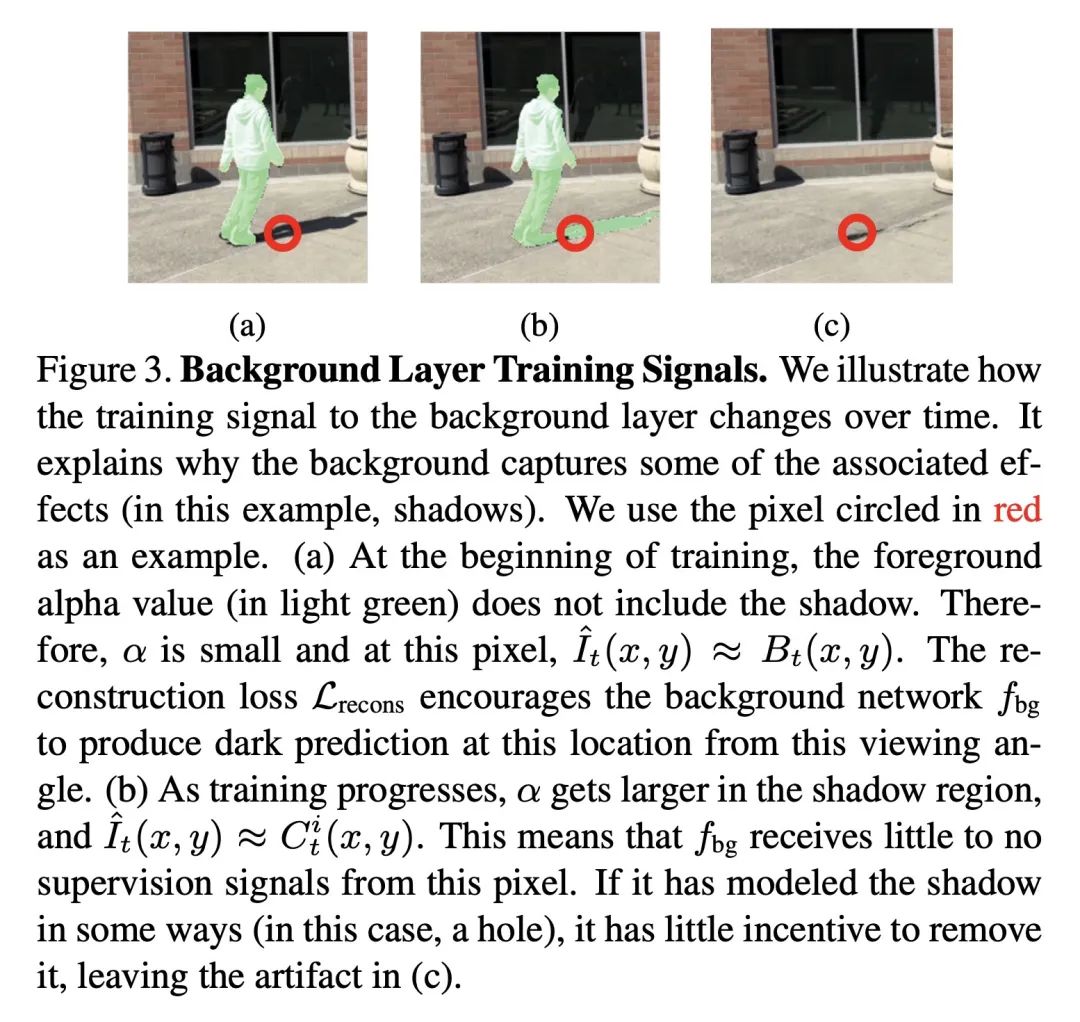

一个可选的利用前景掩膜重新训练步骤可以产生更干净的背景模型。

-

在合成数据集Kubrics和Movies上的定量评估表明,该方法优于Omnimatte和D2NeRF。

-

在各种真实视频上的定性结果展示了在不针对每个视频微调的情况下的强大适用性。

动机:传统的视频抠像方法在处理复杂场景时存在局限性,无法准确地分离前景对象和其相关效果。因此,本文旨在提出一种新的视频抠像方法,能准确地分离动态的前景对象和与之相关的效果,并能重建真实世界视频中的背景场景。 方法:提出了一种名为OmnimatteRF的视频抠像方法,通过结合动态的2D前景层和3D背景模型进行分割。2D前景层保留了前景对象的细节,而3D背景模型则能够鲁棒地重建真实世界视频中的场景。 优势:与传统方法相比,OmnimatteRF方法能够在各种视频上更好地重建场景,具有更高的质量和鲁棒性。

提出了一种新的视频抠像方法OmnimatteRF,通过结合2D前景层和3D背景模型,能够在各种视频上更准确地分离前景对象和相关效果,并重建真实世界视频中的场景。 该方法突破了传统方法对场景的2D表示的限制,具有更高的质量和鲁棒性。

https://arxiv.org/abs/2309.07749

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง