人工智能与公共治理实证研究前沿:

一项文献综述

梁正 王尚瑞

(清华大学)

引文参考:梁正、王尚瑞.2023.人工智能与公共治理实证研究前沿:一项文献综述.[J]. 公共管理评论。

摘要

AI已成为公共治理中的重要理论和实践热点,但国内学术界的研究以规范分析为主,这限制了理论检验与循证决策。本文采取系统性文献综述的方式,从Web of Science 核心数据库中筛选了153篇英文实证文献,介绍了“AI 作为治理对象”和“AI作为治理工具”两条研究进路。前者包括国家战略和治理设计两个研究主题,后者包括技术采纳、组织应用和社会意义3个研究主题,以及相应主题下的多个议题。通过引介相关的研究动态,本文旨在为实证研究设计提供选题、理论和方法上的思路,并为进一步探索前沿提供知识地图。

关键词

AI;公共治理;实证研究;系统性文献综述;国际发表

投稿时间:2023/2/28

送外审时间:2023/3/6

首轮外审完成时间:2023/4/4

录用时间:2023/5/18

最终修回时间:2023/8/20

一、引言

作为智能技术应用的先进形态,AI( artificial intelligence,人工智能)在近年来逐步兴起、发展并嵌入社会治理体系之中,推动了新一轮的治理技术变革与社会结构转型。AI 的社会化应用引发了公共治理的两个关键性问题:一是公共部门如何设计战略以治理 AI(governance of AI),在促进 AI 发展和创新的同时,确保对 AI 进行伦理审查和技术监管,即将“AI 作为治理对象”;二是公共部门如何引入并应用 AI 治理(governance by / with AI),在各种公共场景中使用 AI 来推进数字化转型,以实现国家治理现代化,即将“AI 作为治理工具” (Wilson,2022)。可以说,这两个议题不仅直接关系到 AI 的未来发展和应用水平,也深刻影响着一国的治理水平与治理形态。

中国作为全球 AI 技术创新和场景应用方面的领先国家 ( 姜李丹和薛澜,2022),为公共治理研究提供了切实的分析场域。关于上述两个重要问题,国内学术界已经进行了深刻讨论和前沿探索,集中于 AI 应用中的伦理风险、产业变革、政策框架、治理变革、国际比较等主题,形成了丰富且有意义的知识洞见和治理思路。其中,大部分研究采取了规范性的学理分析,为理解 AI 与公共治理提供了理论基础与指导蓝图。然而,相比于大量的规范研究,目前国内学术界关于 AI 与公共治理的经验提炼与实证检验稍显不足。实证研究的意义不仅在于检验和发展规范研究提出的理论主张,为学术研究提供论证与争鸣的土壤,更有助于及时捕捉公共治理的实践素材,指导公共政策的循证决策,推进国家的治理体系与治理能力发展。

当然,任何一个新兴的研究领域都必然经历从规范分析到实证检验的发展过程,国际学术界同样经历了这一过程 (Wirtz et al. ,2021)。但是,相比国内学术界尚处于起步阶段而言,国际学术界已经开始涌现并发展出一系列关注 AI 与公共治理的实证类文献,介绍这些国际前沿的研究动态能够为国内学术界提供借鉴、学习和交流的契机,有助于推动国内学术研究朝着实证取向快速发展。同时,这也有利于把握 AI 与公共治理的研究现状、知识结构与发展空间,为进一步探索前沿和理论发展提供学术基础与蓝图。

基于此,本文采取系统性文献综述方式,收集并筛选了国际学术界在 AI 与公共治理研究领域的 153 篇实证类英文文献,遵循“AI 作为治理对象”和“AI 作为治理工具”两条重要的研究进路,对这些研究进行引介和述评,以把握前沿研究动态并提供启发性思考。

二、研究设计

由于 AI 与公共治理的相关文献较为丰富,且呈现为“多学科、广议题”的基本态势,本文遵循系统性文献综述的基本思路和标准程序开展文献收集、筛选和分析工作,以减少由主观因素引起的样本选择偏误,并建立结构化和系统性的知识体系。

(一)文献收集

本文选择 Web of Science 核心合集数据库,收集对象不仅包括期刊论文,也包括会议论文,以消除期刊发表周期和 AI 快速迭代之间的张力。在搜索方式上,本文选择人 工 智 能 ( artificial intelligence / AI)和 公 共 治 理 ( governance / government / public administration / public management / public policy / bureaucracy / bureaucrat)的所有排列组合方式进行主题搜索,搜索时间为 2022 年 10 月 5 号,共收集到 3031 条文献数据。

(二)文献筛选

依照研究目的,本文根据如下原则对所有收集到的文献数据进行筛选,从而确定纳入分析的文献库。(1)文献类型属于实证论文,在文献标题、摘要或内容中存在可识别的研究方法,且研究方法非概念研究、理论调查或文献综述,由此排除了综述、论述和规范性质的文献以及新闻报道。(2)文献主题属于公共治理,由此排除私营部门治理、市场产品应用等主题的文献,以及侧重于 AI 技术开发与性能研究的文献。(3)AI 作为公共治理的核心要素,排除了将 AI 作为研究方法,或是将 AI 与其他技术混为一谈的公共治理研究。此外,在文献阅读的过程中,本文也通过滚雪球的方式来补充遗漏了的重要文献。经过上述筛选,共计 153 篇文献数据被纳入文献库进行分析。

(三)文献基本情况

本文从发表时间与期刊分布两个方面对 153 篇文献进行了初步的量化分析,以呈现 AI 与公共治理实证研究的整体趋势与基本面貌。

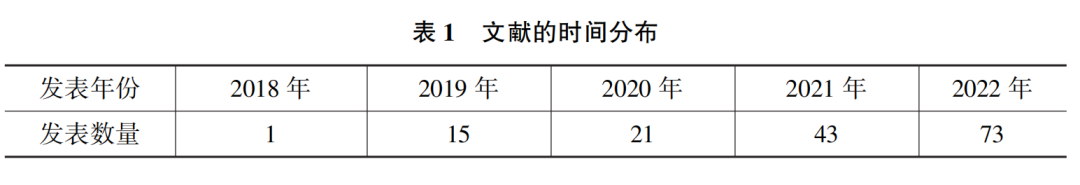

表 1 展现了相关研究的发表时间。如表 1 所示,相关研究的发表时间最早为2018 年,并呈现出逐年快速增长的趋势,从 2018 年的 1 篇发展到 2022 年的 73 篇(仅累计至 2022 年 10 月),这表明 AI 与公共治理的实证研究是一个新兴而有潜力的研究领域。

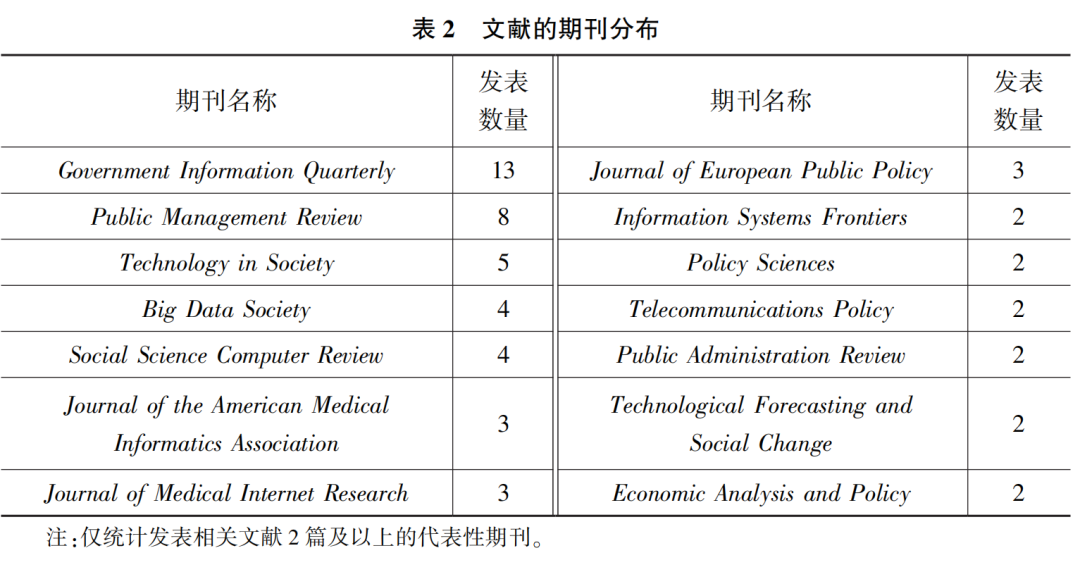

从期刊分布来看,153 篇文献共发表在 88 种期刊上,其中多数期刊(64 种)仅发表了一篇文献,证实了这一研究领域具有跨学科与广议题的性质。表 2 进一步展示了代表性期刊分布,可分为 3 类:第一类主要是公共管理与公共政策的专业性期刊,包括 Public Management Review、Journal of European Public Policy、Policy Sciences、Public Administration Review 等,其中 Public Management Review 的发表数量最多,达到了 8次;第二类是关注信息技术的社会和公共意义的综合性期刊, 包括 Government Information Quarterly、Technology in Society、Big Data Society、Technological Forecasting and Social Change 等,其中 Government Information Quarterly 的发表数量最多,达到了13 次;第三类是医药卫生管理领域的专业性期刊,包括 Journal of the American Medical Informatics Association、Journal of Medical Internet Research 等。总的来看,这些期刊的影响因子普遍较高,基本上都属于 JCR 的 Q1 分区,这也证明了 AI 与公共治理实证研究的前沿性与重要性。

(四)分析思路

基于对文献库的阅读和整理,本文遵循“AI 作为治理对象”和“AI 作为治理工具”两条研究进路介绍实证研究的研究主题和议题。其中,“AI 作为治理对象”可分为国家战略和治理设计两个研究主题,分别包含战略框架、战略制定、战略实施以及伦理框架和监管框架共 5 个议题;而“AI 作为治理工具”可分为技术采纳、组织应用和社会意义 3 个研究主题,分别包括组织采纳和个体采纳、组织变革和官僚决策、公众观念和技术后果共 6 个议题。由此,本文对相关实证研究进行了分门别类以全面揭示前沿动态。同时,好的实证研究不仅提供观点的阐述与启发,更要展示科学严谨的研究过程与结果。因此,在上述篇章布局和结构安排中,本文也具体介绍了相关文献中具有代表性的理论基础、研究方法和研究内容,为未来实证研究的设计与开展提供借鉴、学习和交流的契机。

三、“AI 作为治理对象”:

国家战略与治理设计

经由几次起伏,AI 目前已成为最受瞩目的集成类技术,甚至被寄希望于开启并引领新一轮工业革命。AI 在创造巨大经济与社会价值以及无限应用可能的同时,也对社会伦理和公共道德产生了严重的不可见冲击,这使得如何治理 AI 成为一个重要且紧迫的研究领域。根据研究对象和分析尺度,本文将这一领域区分为国家战略和治理框架两个主题。其中,国家战略构成治理设计的现实基础,而治理设计则为国家战略提供了未来方向。

(一)国家战略

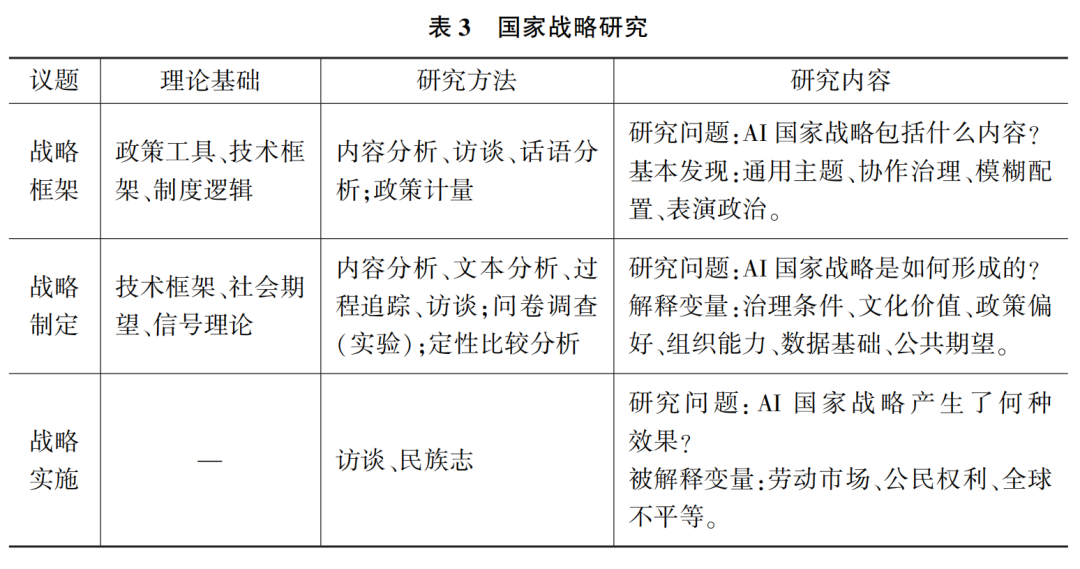

国家战略构成该研究进路的重要主题。相关研究以个别或多个国家(共同体)的战略规划和政策文本为研究对象,形成宏观分析尺度。相应的研究议题主要包括国家战略的基本框架、制定过程和实施情况,具体如表 3 所示。

1. 国家战略的基本框架

针对不同国家(共同体)的 AI 战略和政策文本的分析发现,不同国家的 AI 战略规划中存在 6 个共同主题,即公共部门职能、行业转型、数据要素、算法伦理、能力发展和技术治理 (Fatima et al. ,2020),其政策工具包括金融、权威、组织和信息工具,并据此可以识别出创业型、市场型、监管型和自我监管促进型 4 类国家,但是公共责任话题在很大程度上与国家类型无关 (Djeffal et al. , 2022)。事实上,公共责任构成了各个国家(共同体)AI 战略中的特别考量。各个主要国家(共同体)的 AI 战略基本都关注到了公平性、问责制、透明度、隐私、安全、自治等重要伦理价值问题,并确定了不同参与者的作用和责任,强调通过协作治理来解决AI 应用中的社会伦理和公共道德问题 (Cath et al. ,2018; Saveliev and Zhurenkov, 2021)。其中,欧盟的 AI 战略确定了成为全球 AI 监管规则引领者的愿景,基于对道德伦理问题在个人及社会层面上的广泛考虑,欧盟构建了统合数据规则和算法规则的基本框架,并确定了根据AI风险等级进行适应性监管的治理方法 ( Vesnic-Alujevic et al. ,2020;Roberts et al. , 2021)。在 AI 战略的基本框架中,国家和社会分别被分配了积极协作的角色。其中,政府同时承担变换的身份,包括促进者、推广者、担保人、中介人和社会参与赋能者,而专家、从业者、社会组织、公众等多元利益相关者被视为维护多样性、代表性和公平性的社会力量 (Ulnicane et al. ,2021)。

然而,基于技术框架的价值关系分析表明,公众参与价值在国家战略中的出现频率明显低于专业、服务、效率等价值,而且公众更倾向于被认为是服务接收者,缺乏明确的参与机制表述。AI 战略具有家长式管理作风,这引发了对新自由主义技术框架的担忧 (Wilson,2022)。不仅如此,AI 战略中存在着多重制度逻辑的混合,其中的基本内容往往是以道德而非规则为导向的,形成了模糊的组织配置,这导致各个行动者发挥角色作用的具体措施也是含糊不清的,反映出国家在技术不确定性下的治理意图(Radu,2021)。在这样一种技术不确定的条件下,尽管各个国家的 AI战略在叙事结构上非常相似,涉及宏大遗产、国际竞争、技术进步等,但其实质战略想象大不相同,这锁定了不同的技术路径与表演政治( performative politics)(Bareis and Katzenbach, 2022)。因此,在国家 AI 战略的基本框架中,社会责任作为优先事项能否得到实际落实仍然值得怀疑(Roberts et al. ,2021)。

2. 国家战略的制定过程

研究者进一步探讨了国家 AI 战略制定中的因果过程及机制。对欧盟框架的过程追踪指出,AI 框架的发展过程可区分为头脑风暴、议程设定和决策阶段,全球经济竞争、欧盟制度结构和成员国政策偏好分别解释了上述的政策演化过程 ( Justo-Hanani, 2022)。对欧盟内部北欧国家的研究发现,信任、透明和开放的文化价值观,以及欧盟的政策理念和话语框架深刻影响着国家的 AI 战略制定,但国家组织能力的差异决 定 了 不 同 程 度 的 政 策 采 用 ( Robinson,2020; Af Malmborg and Trondal,2023)。另外两项研究将视野扩大到国际范围,使用模糊集定性比较分析对全球 AI战略的跨国研究发现,强大的研究能力和数据可及性是国家部署 AI 战略的先决条件,相比于威权国家,民主国家更倾向于优先考虑 AI 的伦理和治理问题(Fatima et al. ,2021),但是威权国家能够在政策设计和技术发展上取得更好表现(Filgueiras,2022)。

相较于上述研究关注宏观国家变量在 AI 战略中发挥的作用,另外一些研究捕捉到了社会中公共期望的重要意义。一项基于内容分析和国际调查的研究发现,社会公众的 AI 期望存在积极(效率、可靠、准确等)和消极(隐私、不平等、情感等)的分立(Kerr et al. , 2020)。联合调查实验的研究结论进一步表明,公众期望主要集中于 AI系统的经济和规范属性上,且发达国家的公众更加关注规范议题 (Ehret,2022)。这些公共期望影响着 AI 战略中的具体设计,例如伦理和责任原则,但是这些原则一般只是作为回应公众压力的语言工具,而难以成为有效的治理工具 ( Kerr et al. ,2020)。相比普通公众,专家群体更能够参与 AI 战略制定的实际过程通过复制、转化、扩展、审查和生根等期望工作来落实其 AI 期望 (Minkkinen et al. , 2023)。然而,这些专家群体也被诟病于对专业领域的过分扩展以及对公众意见的吸纳不足,在 AI辩论中缺乏代表性 (Galanos,2019)。

3. 国家战略的实施情况

少部分研究相对零散地关注 AI 战略的实施情况,以检查政策文本到治理实践的距离。其中,两项研究关注 AI 战略对工作和劳动力市场的影响,分别代表了两类研究情境:作为发达国家的挪威和英国,以及作为新兴经济体的印度。前者质疑了国家战略的意义,面对 AI 技术变革与社会应用,机构和社会参与者而不是国家战略将更加具有影响力 (Lloyd and Payne,2019);后者提出了更加严厉的批评,认为 AI 战略对工作和就业产生了不均衡的总体影响,加剧了劳动力市场的不平等。对此,AI战略也缺乏有效的政策干预,例如塑造工作条件、调解劳资关系和提供技能发展(Hammer and Karmakar,2021)。另外两项研究则针对国家战略中的公共责任问题。对澳大利亚的民族志研究发现,国家战略中“负责任 AI”的伦理话语为 AI 部署提供了合法性,但其在社会福利方面的实施情况却与伦理话语相去甚远,反而限制了表达、透明、谈判、民主和监督的公民权利 ( James and Whelan,2022)。伦理问题在全球南北不平等的背景下得到了放大,研究发现,相比发达国家集中的北方,发展中国家集中的南方面临的 AI 不透明性、偏见等问题更加严重,然而其相应的政策框架却是更加狭隘、脆弱和虚设的(Sampath,2021)。

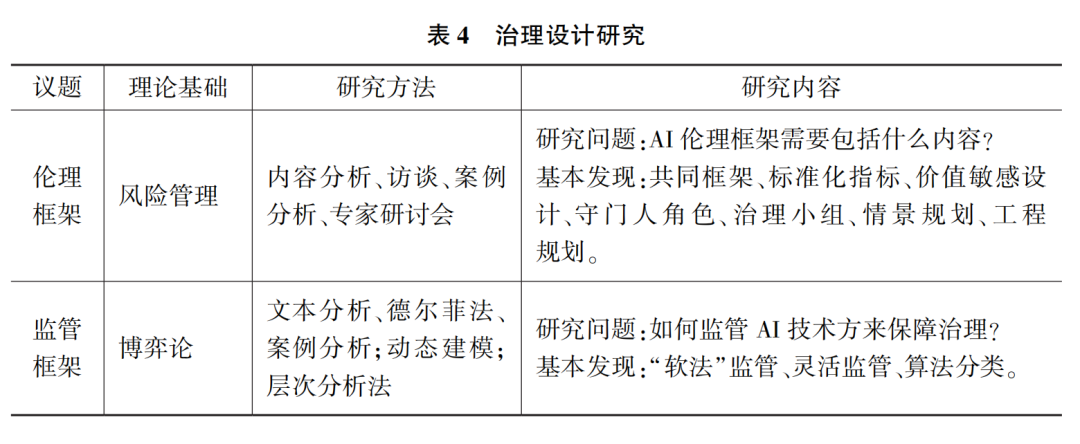

(二)治理设计

在目前国家战略和治理实践的基础上,许多研究者进一步设计和检验了更好的治理框架。其中的经验证据由两部分组成:一是根据理论原则对特定实践的治理反思,二是根据最佳治理的实践案例进行理论提取。由此形成伦理框架和监管框架两个基本议题,如表 4 所示。

1. 伦理框架

如前所述,现行的国家战略往往悬浮于 AI 可能或已经产生的伦理问题之上,因此,研究者特别关注伦理框架的最佳设计。通过将 AI 风险从颗粒度(特殊/ 一般)、原则(法律/ 伦理)、强度(个体/ 集体)和范围(当代/ 隔代)4 个维度加以划分,研究者发现现行伦理准则并不对称和统一,对集体和代际风险考虑不足,这提供了开展伦理原则评估“元研究”的必要性 (Jia and Zhang, 2022)。因此,需要寻求建立共同的治理制度框架,制定统一的标准和指标来评估私营部门或公共部门使用 AI 的潜在影响,并通过公开磋商反馈、积累最佳实践和设置试点试验等方式来构建广泛的知识库 (Kuziemski and Misuraca,2020)。当然,治理框架的设计与实施往往落后于快速变革的 AI 技术的开发与应用。因此,应当在具体 AI 项目的实施过程中引入道德与价值敏感设计,建立数据伦理决策辅助框架:根据特定的治理情境和组织背景,集体审议确定伦理价值,以反思个体道德价值并评估特定项目实践 (Franzke et al. , 2021)。

进一步地,研究者提出了更加具体的制度安排。第一,扮演守门人角色。平衡厂商的设计效率与公众的安全效用。例如,在 AI 公共采购的各个阶段(招标、选择、安装和管理)中嵌入以人为中心的原则,确保伦理原则得到技术端的关注和落实,并依据实际表现实行奖惩激励 (Nagitta et al. ,2022)。第二,建立 AI 技术治理小组。以跨学科审查来搭建技术基础设施和算法评估流程,并考虑不同社会群体的道德、法律、隐私观点,保证技术的监测与反馈机制以实现透明性和可解释性(Wilson et al. ,2023)。第三,采取情景规划的公共决策。对特定公共议题进行政策宣传,确定决策中的利益相关方及其利益诉求,解决长期政策与短期政策间的时间不匹配问题,并考虑公共部门和私人部门之间的跨界效应 (Park,2022)。第四,将伦理原则融入 AI工程生命周期。引入联邦学习、区块链、对抗性测试等前沿技术手段来实现数据安全、隐私、透明、可信、稳健和公平等伦理原则 (Wu et al. , 2020)。

2. 监管框架

另一部分研究则关注 AI 监管框架的治理设计,其基本出发点在于遏制 AI 技术方的不当举动,为 AI 的伦理治理保驾护航。尽管监管框架并不鲜见于 AI 的国家战略之中,例如欧盟的适应性规则体系,但是,这些监管框架往往会扼杀创新和阻碍投资,并造成大公司市场支配的经济不平等格局。同时,AI 技术所引发的颠覆式创新具有高度的技术不确定性,严重冲击知识观念和社会结构。对此,既有监管制度不仅存在节奏滞后的问题,而且容易使利益相关者陷入“技术梦游主义”,对技术失败的担忧与关注不足,如自动驾驶技术 (Schuelke-Leech et al. , 2019)。基于此,研究者提出了一种类似“软法”的监管思路,建立自愿的自下而上的双边承诺安全机制,并进一步加入第三方的制裁行动以使承诺具有约束力和制裁性,这一观点得到了博弈论模型的验证 (Han et al. ,2022)。

然而,这样一种理想方案同样遭到了现实质疑。研究者认为,AI 公司承诺的社会责任很可能成为道德清洗和游说的措辞,通过强化企业责任的叙述而混淆了加强国家监管的必要性,从而构建了不可持续的技术治理模式 (Dauvergne, 2022)。即便AI 公司具有良好意图,其治理措施也可能会加剧而不是缓解监管问题。例如,社交媒体平台公司(如 Facebook,Youtube)的自动审核系统旨在解决种族歧视、错误信息和恐怖主义等问题,反而增加了决策的不透明性、公平正义的复杂性以及政治性质的模糊性。换言之,这些公司为了履行社会责任而寻找技术解决方案,却形成了更加复杂的监管问题 (Gorwa et al. ,2020)。因此,另一些学者进一步提出灵活监管的AI 治理思路,强调在监管政策的设计、执行和审查过程中提高规则结构、执行结构和监管反馈的灵活性,其目的在于为被监管者提供一定的监管选择范围,从而促进整个监管生命周期的有效合作 (Hong et al. ,2022)。同时,灵活监管的框架也要求对AI 应用情境中的复杂算法进行精简与分类,理解监管系统的信息内容、规范选择和干预效果,从而更好地回答“谁是监管者?” “被监管的是什么?” “监管是如何进行的?”这 3 个问题 (Eyert et al. , 2022)。

四、“AI 作为治理工具”:

技术采纳、组织应用与社会意义

如前所述,AI 技术与社会的互动是一个机遇与风险并存的过程,这构成了该研究进路的两个起点:一是出于治理现代化的需求,观察公共部门采纳和应用 AI 的过程与结果;二是基于公共部门的公共属性,关注公共部门利用 AI 提供的公共产品或服务。其中,前者对应于技术采纳和组织应用的研究主题,而后者对应于社会意义的研究主题。显然,技术采纳构成组织应用的基础与前提,而组织应用进一步决定了产生的社会意义。

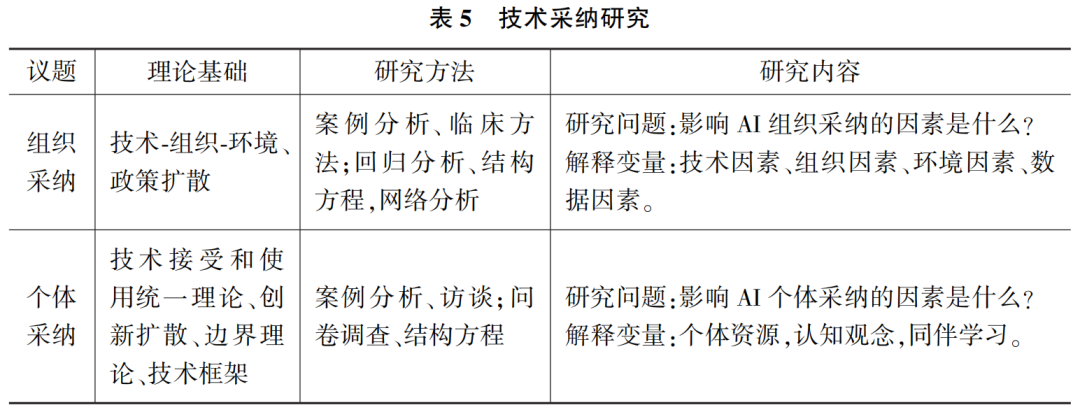

(一)技术采纳

尽管 AI 对公共部门的政务服务提供、内部业务沟通、数据集成处理等具有极大的应用潜力,但是公共部门对于 AI 技术的采纳程度相对较低,仅处于起步阶段(Chen et al. , 2019; Mikalef et al. , 2019)。由此,许多研究开始关注政府的 AI 采纳议题,并形成组织采纳和个体采纳两类研究议题,如表 5 所示。

1. 组织采纳

许多研究遵循中观的组织研究视角,讨论公共部门 AI 采纳的影响因素。其中,一些研究为 AI 采纳搭建了“技术-组织-环境”的整体框架。这些研究发现,AI 技术的易用性和有用性,组织内部的财务成本、创新能力和规模结构,以及组织外部的环境压力、激励措施和监管框架,均会对公共部门的 AI 采用产生显著影响(Mikalef et al. ,2022)。同时,随着 AI 成熟度从评估、确定到管理阶段的发展,不同技术和组织因素的重要性程度会发生明显变化 (Neumann et al. ,2022)。不同于上面两项研究关注发达国家的 AI 采纳问题,另一项研究分析了印度公共分配系统中采用 AI 的主要障碍,形成了包含 18 个障碍的 5 层次障碍结构,并确定了障碍重要性排序,包括政治冲突、技术信任缺乏、基础设施不足、激励措施有限等 (Kumar et al. ,2021)。基于目前公共部门在 AI 采纳上的困局,研究者采用临床方法(clinical approach)亲身参与项目 过 程 以 促 进 AI 采 纳, 提 出 了 政 学 合 作 和 行 动 导 向 以 阐 明 AI 可 用 性(affordance)的实践路径,并总结为人类/ AI 伙伴关系、基于理论的干预、制度化的合作研究 3 条经验启示 (Vassilakopoulou et al. ,2023)。

当然,公共部门的技术采纳并不是一个全新话题。其他研究借鉴了信息技术和创新政策采用和传播的研究成果,从而挖掘出公共部门 AI 采用中的一般性与特殊性。一项探索性研究发现,类似于其他形式的政府创新,公共部门的 AI 采用同样受到环境、组织、创新等因素的影响。不同的是,AI 采用还对数据因素提出了更严苛的额外要求,涉及数据质量、数据维护、数据分析和数据系统 (van Noordt and Misuraca,2022a)。另一项研究则聚焦于中国特殊的政治文化情境,发现纵向压力和横向压力是政府采用聊天机器人的决定性因素,但政策环境、组织环境、经济环境以及技术应用水平决定了政府采用聊天机器人后的绩效表现 (Wang et al. ,2022b)。

2. 个体采纳

另一些研究将政府官员的技术主体意义带入讨论之中,补充了 AI 采用的个体视角。其中,两项研究分别探讨了美国和印度普通公务人员对 AI 采纳的态度与行动。前者分析了美国政府雇员对 AI 技术的认知、观念与使用经验,发现政府雇员整体上持积极看法,具备较高程度的采纳意愿 (Ahn and Chen, 2022);后者发现印度政府雇员的个体资源,包括时间、金钱和技能会显著影响其行为意图,并推动 AI 采用的实际行动。其中,组织文化和自愿性发挥着重要的调节作用 (Behl et al. ,2022)。总而言之,两项研究都强调对公务人员进行 AI 培训和教育,并促进组织创新和合作文化。

不同于上述研究关注普通政府雇员,其他研究将目光转向在技术或权力上占有主导地位的部门管理者。其中,两项研究主要讨论了不同管理者的技术框架。基于中国医疗保健场景的研究发现,尽管政府决策者、医院管理者和 IT 公司经理都认为AI 采纳面临着社会、经济、道德、政治、法律、组织、数据等多方面的挑战,但不同利益相关者的技术框架存在差异,甚至相互矛盾;针对西班牙市议会的研究更全面地展示了首席信息官(CIO)在技术性质、技术策略和技术使用方面的态度和观念,发现CIO 的技术框架侧重于 AI 的工程和技术特征,而对社会、政治、文化和经济影响关注不足(Criado and de Zarate-Alcarazo,2022)。AI 论坛为弥合公共管理者的观念与知识之间的鸿沟提供了契机,研究发现,非结构化论坛中的同伴学习机制能够推动管理者获取 AI 采用中的隐形和程序性知识,包括知识经纪人、跨边界对象和边界交互3 种桥接策略。但是,这一机制的作用边界受制于技术成熟度、组织规模和操作环境(Wilson and Broomfield, 2022)。

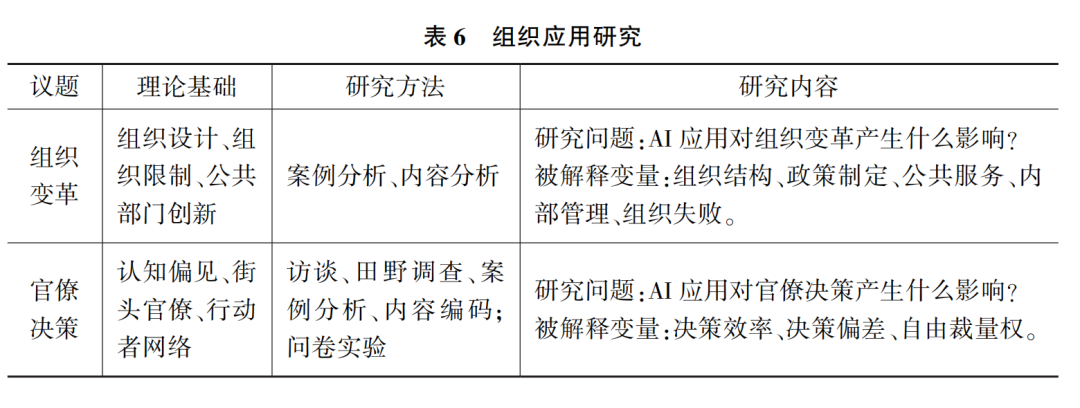

(二)组织应用

作为具有变革性意义的技术双刃剑,AI 的应用将对公共部门产生全方位的影响。因此,许多研究探讨了 AI 在组织应用中产生的利弊,在研究议题上可以分为组织变革和官僚决策两类,如表 6 所示。

1. 组织变革

许多研究关注公共部门 AI 应用所引发的组织创新和变革意义。作为公共部门AI 应用的最常见形式,聊天机器人得到了研究关注。一项早期的研究认为,公共部门使用聊天机器人参与有限的信息管理,即回复一般性的重复问题,这虽然有助于节省组织资源,使公务人员专注于更加复杂的非标准问题,但是聊天机器人无法参与服务交互和跨部门集成,没有在根本上引发组织变革 ( van Noordt and Misuraca,2019)。不同的是,另一项研究认为,通过平衡 AI 的自动化( automation) 和增强(augmentation)功能,公共部门能够使用聊天机器人来改变任务划定、任务分配、信息提供和激励提供的组织框架,这构建了人机协作的组织形式,并创造出一个新的组织结构 (Maragno et al. ,2022)。对欧洲 AI 库中 250 个 AI 应用的案例分析则更加全面地总结了 AI 在 3 个层面上的意义与功能,分别是政策制定上的发现问题、改进决策、监测执行和促进参与,公共服务上的信息提供、服务提供和服务发掘,以及内部管理上的人力招聘、资源分配、腐败检测、财务管理、资产维护等 ( van Noordt and Misuraca,2022b)。

相反的是,另外的研究察觉到了 AI 应用的副作用与黑暗面。尽管这些研究并不完全否认 AI 应用产生的组织创新,例如新的组织结构和人力资源协调带来的行政流程创新和概念创新,但是由于公共部门往往缺乏系统性的技术生态和配套措施,这些创新反而会干扰组织的正常运转,从而引发不良后果,包括官僚解雇、监督缺位、目标偏离等(Giest and Klievink,2022)。不仅如此,在 AI 应用的不同阶段下,公共部门中的认知限制、管理限制、技术限制和环境限制会发生级联效应并推动生成社会破坏性系统,对公共部门产生损害甚至摧毁性影响(Rinta-Kahila et al. ,2022)。总而言之,这些发生在荷兰、美国和澳大利亚的 AI 事故为公共部门中的 AI 应用敲醒了警钟。

2. 官僚决策

一些研究者关注 AI 应用对官僚决策所产生的影响。积极观点认为,AI 在数据科学意义上构建了一种新的行政范式,即算法官僚制(algorithmic bureaucracy),这有助于提高公务人员的自主性和能力,使其能够更好地应对社会问题中的制度复杂性(Vogl et al. ,2019)。特别是,AI 算法能够改变决策情境,降低决策的模糊性和不确定性。在这一过程中,AI 应用有助于达成决策共识,提高决策效率,且不会成为决策者的责任规避工具 (Hartmann and Wenzelburger,2021)。然而,AI 的上述积极作用存在两个边界条件。第一,决策者的专业能力。尽管算法能够帮助决策者做出更加正确的决策,但是相比基于规则的算法,基于学习的算法构成了一个不透明和不可解释的决策黑箱,在准确性上表现更差 (Janssen et al. ,2022)。同时,一些复杂活动本身可能超出了 AI 设定的决策情境 (de Sousa et al. , 2022)。 这些问题对决策者的经验和能力提出了更高要求。第二,效率与公平之间的权衡。这一方面源于 AI 模型问题。 例如,AI 软件虽然有助于识别存在长期失业风险的求职者,但同时会将部分弱势群体错误视为 高 风 险 求 职 者, 引 发 就 业 市 场 中 的 歧 视 问 题 ( Desiere and Struyven,2021)。另一方面源于官僚心理偏差。 尽管公务人员并不一定遵循算法决策(自动化偏见),但是会倾向于选择与刻板印象相匹配的算法建议(选择性遵从),从而产生决策歧视并加剧社会不平等 (Alon-Barkat and Busuioc,2023)。因此,尽管AI 能够提高官僚决策的效率,但这可能是以公平作为代价的。

部分研究则特别关注自由裁量权问题,延续了信息技术缩减观点( curtailment thesis)与赋能观点( enablement thesis)的辩论。一项支持缩减观点的问卷实验研究发现,尽管 AI 能够提高街头官僚的执行意愿,但降低了其自由裁量权,其中决策类型发挥着重要的调节作用 (Wang et al. , 2022a)。而另一项支持赋能观点的案例研究认为,AI 应用促进了数字自由裁量权,表现为人与技术之间的协作模式能够推进道德、民主和专业价值观 (Ranerup and Henriksen, 2022)。对此,一项研究总结性地提出 3 个观点:缩减与赋能共存于技术与官僚的互动过程中;技术通过配置组织关系影响自由裁量权的行使方式;街道级与系统级的自由裁量权通过辩证关系而相互塑造(Alshallaqi,2022)。

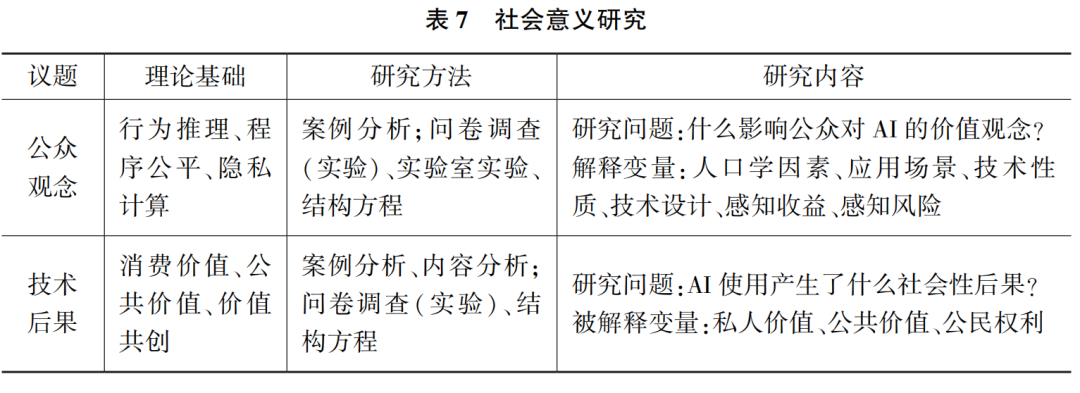

(三)社会意义

在公共部门采纳和应用 AI 技术推进公共治理的过程中,社会公众作为另一端的核心主体同样得到了许多研究的关注,并形成了公众观念和技术后果两个研究议题,如表 7 所示。

1. 公众观念

许多研究分析了公众对于 AI 参与公共治理的价值观念,并进一步探索了特定价值观念的形成原因。这些研究发现,整体上公众对AI 使用持中性或积极看法(Akkaya and Krcmar, 2019; Aoki, 2020; Kankanamge et al. , 2021),其影响因素可归结为 4 类。一是公众的人口学因素。年轻一代、受教育程度高以及在安全部门工作的公众更加青睐于 AI 驱动的政府灾害管理 (Kankanamge et al. , 2021)。二是 AI 的应用场景。公众对 AI 的初始信任取决于应用领域和目的(Aoki,2020)。相比特殊公共服务,由AI 提供简单和重复的一般公共服务更容易得到公众支持,并提高后者的接受程度 (Akkaya and Krcmar, 2019; Gesk and Leyer,2022)。三是 AI 的技术性质。AI 算法的透明度能够提高公众对于算法和官僚决策的信任程度,其中可解释性比可访问性更加重要 (Grimmelikhuijsen, 2023)。然而,由于 AI 决策难以通过符号系统来表达因果关系,其可解释性往往在现实生活中构成一个抗解问题( wicked problem),造成一系列挑战并限制了共识的达成 (de Bruijn et al. ,2022)。四是 AI的设计方式。 AI 设计的感知拟人化能够塑造社会临场感(social presence),从而改善公众的质量感知,并提高其信任水平 (Munnukka et al. ,2022)。其中,AI 的道德行为而非视觉设计决定了它在多大程度上被视为人类 (Willems et al. , 2022b)。

事实上,公众关于 AI 的价值观念可以归结为特定决策情境下收益与风险的权衡过程。正如数据隐私的研究所发现的,公众的感知收益越高、感知风险越低,就越倾向于接受 AI 驱动的公共服务 (Willems et al. , 2022a; Hong and Cho, 2023)。然而,这一权衡并非表现为一个完全理性的过程,而是存在着隐私悖论( privacy paradox):信息数据量共享作为可能的隐私风险,并不会降低公众的使用意愿 (Willems et al. ,2022a)。平衡好 AI 使用中的工具性价值与公共性价值有助于最大化收益并最小化风险,而人机协作构成其中的关键性措施。实验研究发现,人类决策与算法决策在不同决策场景中各有不足,而人机交互决策(算法系统的人工治理)能更好提升公众的感知合法性,即使决策可能产生严重错误 (Waldman and Martin, 2022)。

2. 技术后果

许多研究也关注了公共治理中 AI 服务和产品可能创造的价值与社会影响。研究发现,AI 机器人的个性化、美学、享受和学习等价值效用能够提高公众的用户体验和满意度 (Chen et al. , 2021; Zhu et al. , 2022)。然而,相反的研究则认为,公民在4 个维度上的使用价值没有得到满足,分别是寻求人工支持渠道、个性化、参与/ 交互以及联结 (Scutella et al. , 2022)。 研究者进一步区分了 AI 带来的公共价值和私人价值。一项调查研究发现,AI 机器人使用能够提高公众的感知有用性、感知享受、程序正义,但是对政府信任没有显著影响(Wang et al. ,2021)。另一项实验研究同样发现,尽管AI 主导的决策过程能够降低繁文缛节感知,但同时也降低了公民信任(Ingrams et al. , 2022)。这些结论在一定程度上表明,尽管 AI 使用有助于创造特定价值,但其中的私人价值感知大于公共价值感知,甚至私人价值的创造是以公共价值为代价的。

因此,一些研究更是特别注意到了 AI 使用中可能的公共价值失败与破坏性后果。一项实验研究发现,AI 在公平性、透明性和响应性上的公共价值失败都会严重降低公众对公共部门的支持、信任、质量评估和期望,其中公平性和透明性的负面效应更加突出,且这些结果超越了组织背景与意识形态的差异 ( Schiff et al. ,2022)。另一项案例研究进一步指出,公共部门的 AI 应用使监控资本主义( surveillance capitalism)进入公共领域,扩大了国家与个体间信息和权利的不对等,以不透明的方式侵犯了公民的基本权利。 总而言之,AI 使用并没有遵循以人为本的基本原则,而是表现为以系统为中心的运作过程 (Jørgensen, 2023)。

五、总结与展望

目前,AI 已成为公共治理中的热点研究问题,这不仅关系到科技水平与创新应用,而且与社会结构和治理形态相关。国内学术界对此进行了充分讨论,并形成了大量的学术洞见。但总体而言,大部分研究采取了规范性的学理分析,有助于检验和发展理论并指导循证决策的实证研究相对不足。基于这一研究现状,本文对 153篇实证类英文文献开展系统性文献综述,以期把握前沿研究动态并提供启发性思考。

首先,从研究主题上来看,关于 AI 与公共治理的实证研究遵循了“AI 作为治理对象”和“AI 作为治理工具”两条研究进路,这一研究取向不仅关涉当下关于 AI 的两个关键性问题,而且以相对宏观和微观的视角形成互相补充,从而构建了 AI 与公共治理实证研究的基本图景。其中,“AI 作为治理对象”研究进路强调对 AI 技术的总体性把握,从而一般性地形成两个主要议题:治理 AI 的现实战略是怎么样的? 有没有更好的治理设计? 而“AI 作为治理工具”研究进路则强调 AI 带来的公共治理转型与变革契机,从而关注公共部门的技术采纳、组织应用和社会意义的相关议题。尽管这些研究主题并不鲜见于规范研究,但实证导向的研究设计有助于调和不同价值规范间的张力(例如监管与发展、公平与效率、专业与民主、赋权和排斥等),从而为现实生活中的治理决策提供实践证据。

其次,从理论基础上来看,相关实证研究反映了多学科交融的理论取向,不仅包括技术面向的工程学、计算机与科学等理工学科,也包括社会面向的哲学、法学、商学和公共管理学等社会学科,从而在总体意义上形成了社会与技术互相建构的理论范式。这要求研究者不仅要了解技术嵌入的社会结构、文化背景、制度框架和组织体系,也要对技术的使用原理、输入输出和运作流程有着基本认知。同时,关于新兴技术与公共治理的理论研究正处于方兴未艾之时,许多研究同样将 AI 视为一种新兴技术,基于技术框架、创新系统、街头官僚等经典理论开启探索,继承、检验和发展了这一广泛领域中的基本理论和研究框架。

最后,从研究方法上来说,这些实证研究主要采取了质性和量化的研究方法。对于质性研究而言,其数据来源主要包括一手的调研访谈和二手的话语文本,并进而使用内容分析、话语分析、案例分析等方法来开展研究;对于量化研究而言,由于可用的二手数据相对较少,大多数研究主要使用一手的问卷调查数据,并通过方差分析、线性回归、结构方程等方法开展研究。其中,不少研究采取了实验设计思路,从而提供了更加纯粹和干净的因果证据。另外,少部分研究超越了质性与量化的划分,使用定性比较分析来检验多因一果的逻辑组合。总体而言,研究方法的选择在很大程度上与研究议题相关,并受到学科范式和理论维度的影响。

国际学术界在上述方面提供了有益启示和学习契机,但对于本土研究者而言,应当对中外制度和情境的差异有着明确认知,并对研究设计中的现实观照、理论探索和方法应用等部分进行适当的本土化改造,以为中国的 AI 与公共治理提供理论和实践上的循证指引,促进治理体系和治理能力的现代化。同时,作为“另一种制度选择”(郑永年和杨丽君,2021),中国场景中的故事也为相关研究提供了另一种经验事实,有助于为全球治理提供中国经验和中国智慧,并进一步揭示“地方化”与“全球化”之间的联系与差异。

此外,国际学术界的实证研究仍处于探索阶段,无论是研究主题、理论还是方法都存在进一步验证与深化的空间。因此,本文也为研究者进一步探索前沿提供了知识地图。在这一过程中,研究者应当对 AI 的技术类型和治理情境有着清晰认识,前者关系到 AI 的技术分类(如规则导向或学习导向)及其实践性质(如透明度和准确率),而后者是指 AI 的落地场景(如不同政务领域)和嵌入方式(如人机协作)。作为一种通用的集成技术,AI 的社会化应用在技术类型和治理情境中存在多种适配组合,这深刻影响着 AI 与公共治理的研究命题。因此,研究者应当保持具体问题具体分析的科学态度,确定 AI 的技术类型与治理情境,并挖掘其中的过程、机制与结果,从而推动形成可对话和延续的学术生态。另外,考虑到目前许多实证研究的研究结论并不能完全支持其理论框架,研究者应当有意识地挖掘公共治理中 AI 与其他技术之间的差异,从而构建更加具有解释力和适应性的学术话语和理论框架。

当然,尽管本文较为全面和具体地引介了国际范围内 AI 与公共治理的实证研究,但相关论述需要在以下 3 个方面得到谨慎对待。第一,AI 与公共治理的复杂性可能远超本文的论述范围,本文难免挂一漏万。一方面,由于 AI 概念的广泛性与复杂性,相关研究中可能存在诸多概念混用而没有进入本文的文献搜索范围之内;另一方面,公共治理的实然范畴可能还包括了 AI 的行业影响等,但相关研究显然与本文所讨论的公共治理语境存在一定差异。第二,AI 与公共治理延续于信息技术与公共治理的研究脉络。显然,相比其他信息技术,AI 技术面临着更大的复杂性与争议性。限于研究目的与篇幅,本文并未对此进行充足的论述。因此,AI 与公共治理中存在什么“变”与“不变”,其中有什么一般性或特殊性规律,这值得研究者专文论述。第三,尽管本文侧重于实证研究前沿,但规范研究的价值不可忽视,特别是规范研究确定了实证研究所扎根的理论与现实背景,有助于形成对相关研究领域的整体性把握。总而言之,未来的文献研究可以针对特定的研究主题或议题,考虑信息技术与公共治理的发展脉络,并结合规范研究与实证研究来进行更加深入和整合的述评。

参考文献 略

论文已同步上传中国知网,预计将于近期完成审核上线。欢迎到中国知网下载原文阅读,尊重版权,尊重学术。

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง