Language Models Represent Space and Time

W Gurnee, M Tegmark

[MIT]

语言模型的空间和时间表示

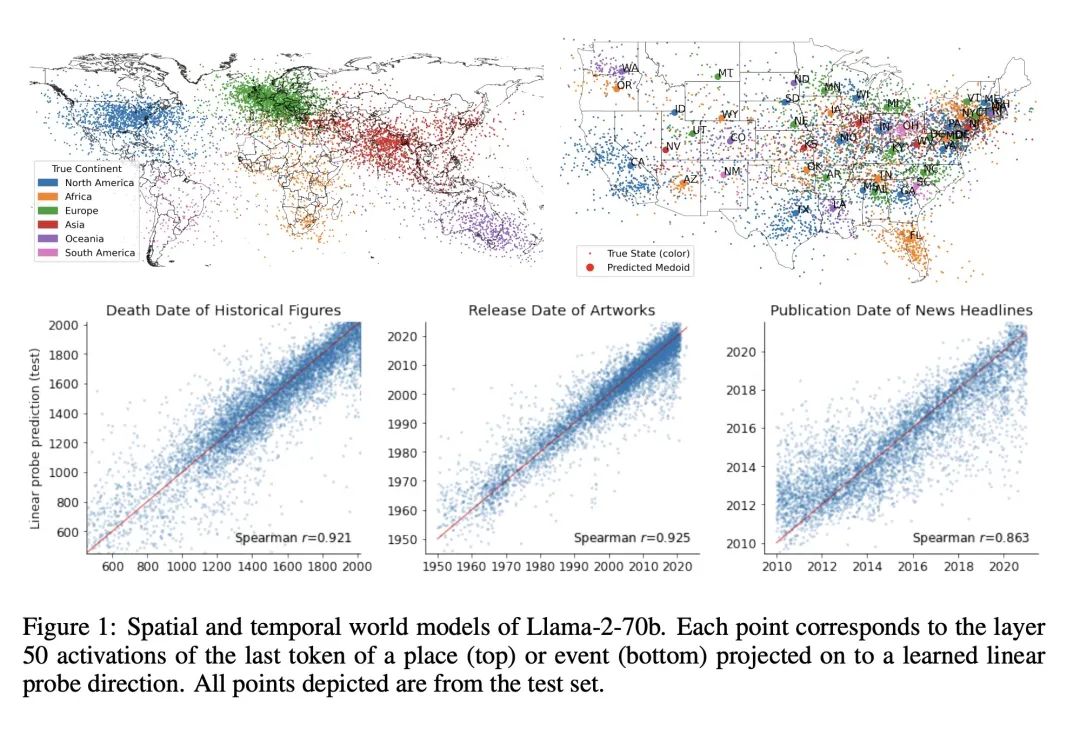

- 研究了大型语言模型(LLM)是否通过分析Llama-2系列模型中的命名实体的内部激活来学习一致的空间和时间表示。

- 作者构建了6个数据集,其中包含不同空间/时间尺度下的地点/事件名称及其实际坐标(世界、美国、纽约市、历史人物、娱乐、新闻标题)。

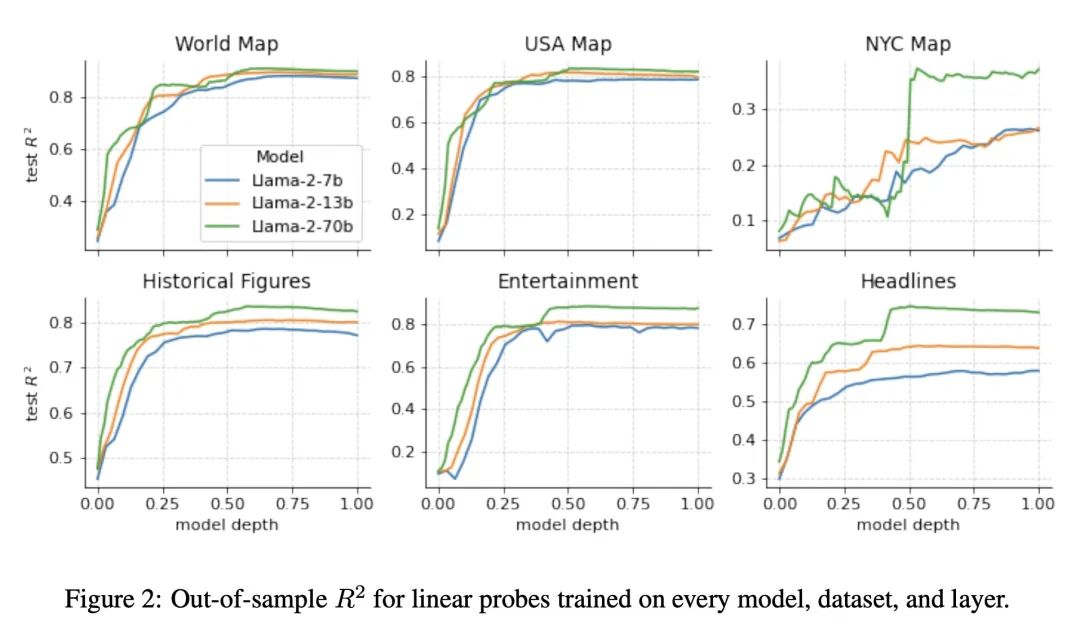

- 探测实验表明,LLM在早期至中期层中构建了空间/时间表示,之后达到平台期,更大的模型优于更小的模型。

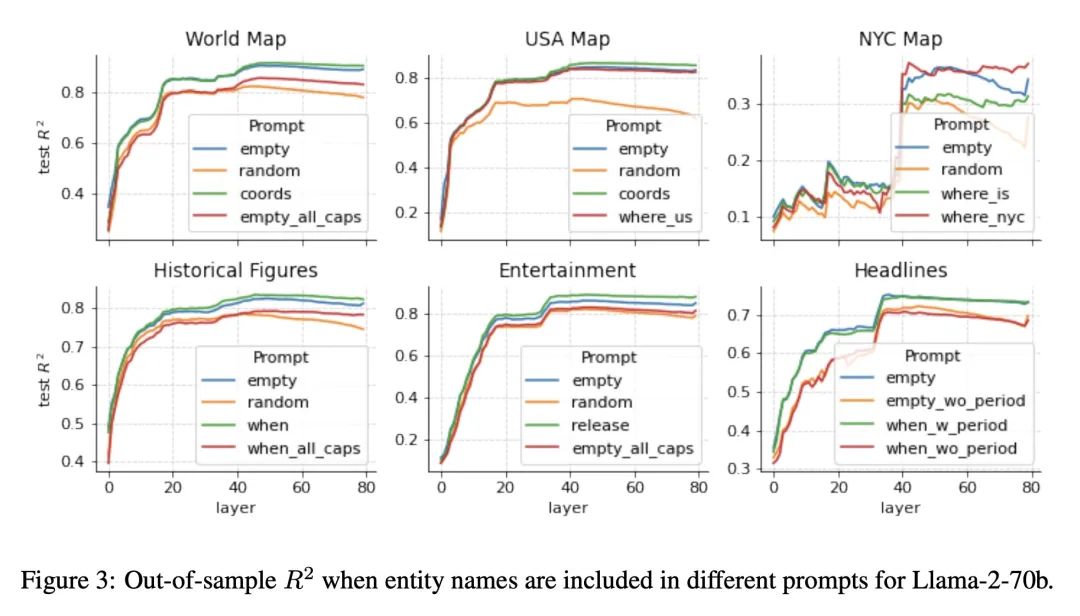

- 空间/时间表示是线性的、对提示变化比较鲁棒的,并且在不同实体类型之间是统一的。

- 探测器可能学习将模型的内部坐标映射到人类坐标,但模型确实具有实体的相对定位。

- 识别了个别“空间神经元”和“时间神经元”,可靠地对坐标进行编码,表明模型使用了这些特征。

- 结果表明,LLM获得了对空间/时间维度的结构化知识,支持仅通过下一个Token的预测就可以学习字面上的世界模型的观点。

动机:研究人员想要确定大型语言模型(LLM)是否能学习到空间和时间的结构化知识,即是否能构建一个真实的世界模型。

方法:研究人员使用Llama-2系列模型,构建了六个包含空间和时间坐标的数据集,通过线性回归探测器来分析LLM在不同层次上的表示,并预测实际世界的位置或时间。

优势:研究发现,LLM能在多个尺度上学习到空间和时间的线性表示,并且这些表示对提示变化具有鲁棒性,且在不同类型的实体(如城市和地标)之间保持统一。这表明LLM不仅学习表面统计信息,而且学习了字面上的世界模型。

通过分析LLM在空间和时间数据集上的表示,发现LLM能学习到结构化的空间和时间知识,支持其不仅仅是学习表面统计信息,而是学习了字面上的世界模型。

https://arxiv.org/abs/2310.02207

正文完

可以使用微信扫码关注公众号(ID:xzluomor)

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง