今天是2023年10月13日,星期一。北京,天气晴。

随着大型语言模型在不同领域的应用,其输出结果的可靠性和准确性变得至关重要,我们在之前面有多次说过关于幻觉评估的问题。

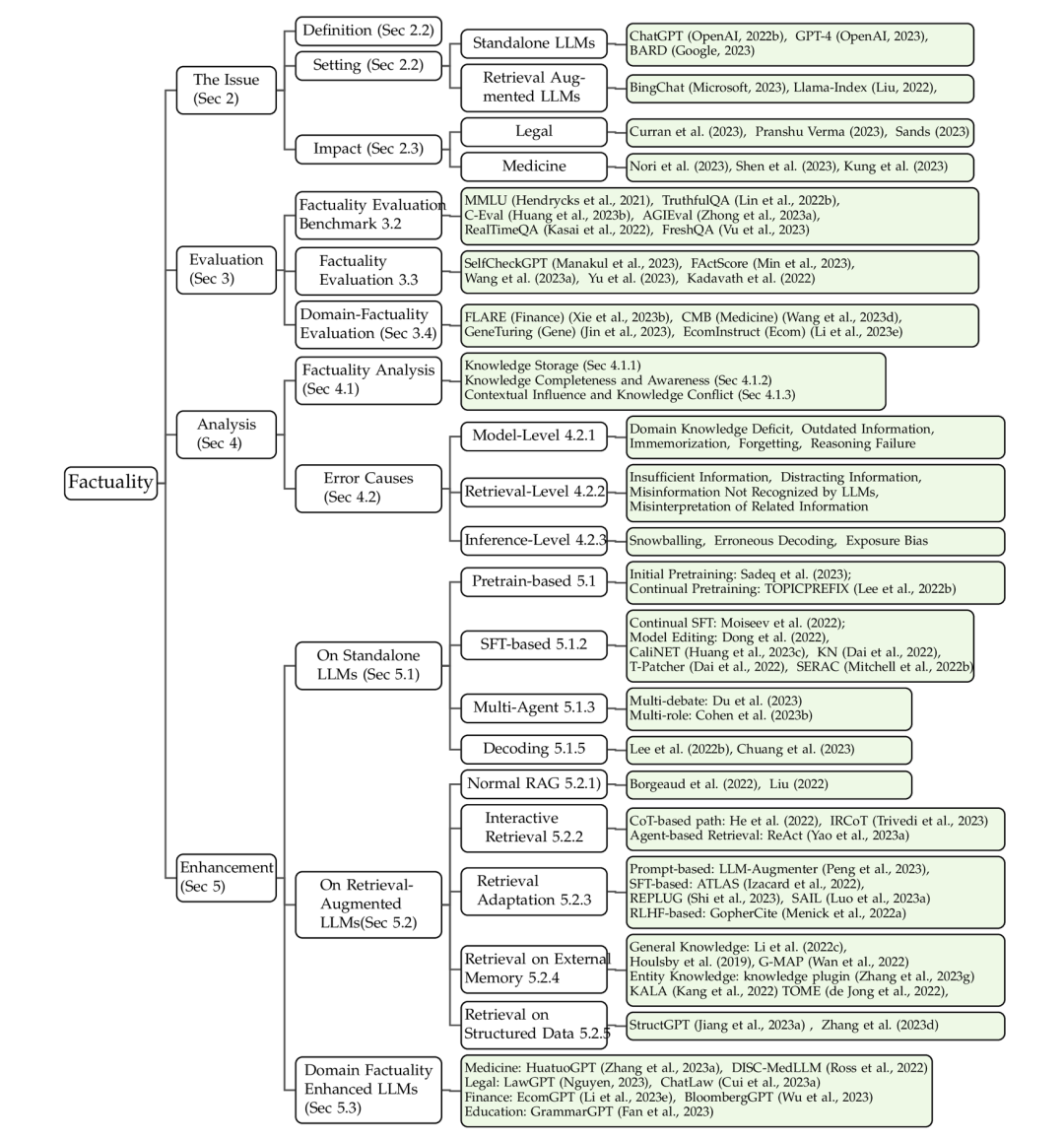

最近的工作《Survey on Factuality in Large Language Models:Knowledge, Retrieval and Domain-Specificity》将”事实性问题”定义为LLM生成与既定事实不一致内容的概率,总结了存储和处理事实的机制,寻找造成事实错误的主要原因,并介绍了评估LLM事实性的方法,包括关键指标、相关基准,以及利用外部数据的检索增强RAG。

该工作是个很好的材料,本文对其中一些关键点进行说明,供大家一起参考。

一、先看什么是大模型的事实性

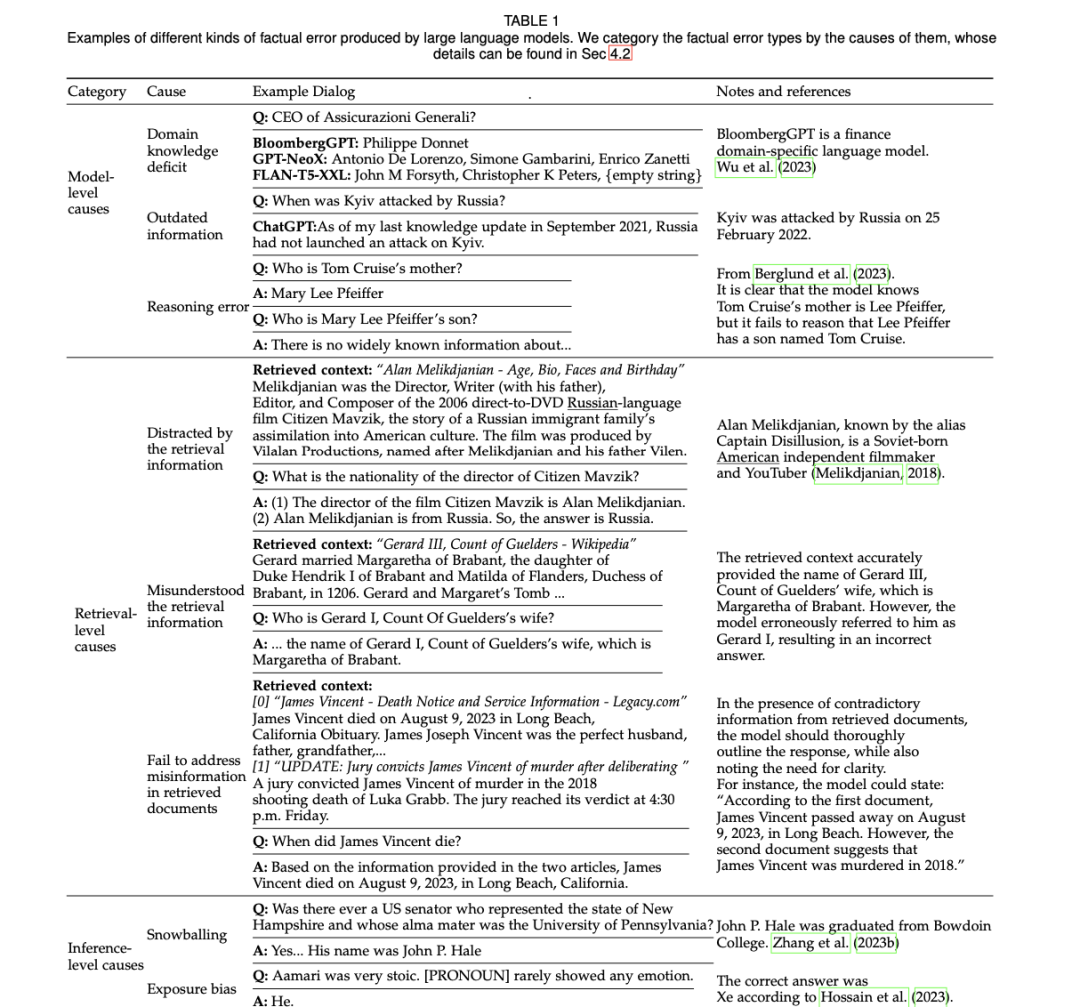

事实性问题是指大型语言模型有可能产生与事实相悖的内容。这里的”事实信息”包括世界知识、常识和来自可靠来源的明确信息,如维基百科或特定领域的教科书,表1中展示了事实性问题的各种实例。

例如:

大模型可能缺乏特定领域的事实知识,如医学或法律领域,可能不知道上次更新后发生的事实,尽管大模型掌握了相关事实,却无法推理出正确答案,在某些情况下,LLM甚至可能忘记或无法回忆起以前学到的事实。

事实性问题与大型语言模型领域的几个热门话题密切相关,包括幻觉、过时信息和特定领域(如健康、法律、金融。这些主题的核心是解决同一个问题:大模型可能产生与某些事实相矛盾的内容,无论这些内容是凭空产生的、过时的信息,还是缺乏特定领域的知识,这三个主题都属于事实性问题的范畴。

不过,需要注意的是,虽然这些主题相互关联,但它们各有独特的侧重点。

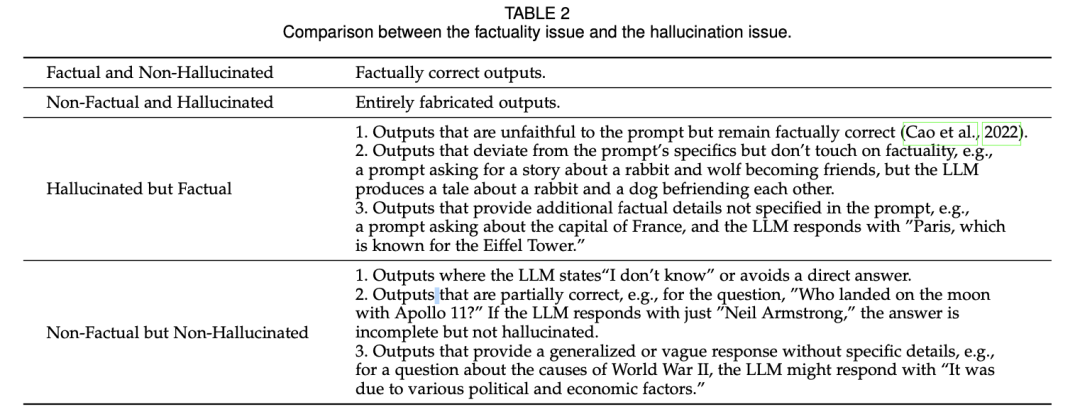

LLM中的幻觉和事实性问题都与生成内容的准确性和可靠性有关,但它们涉及不同的方面。

幻觉主要是指LLM生成毫无根据或毫无根据的内容,幻觉可以理解为模型倾向于”生成与某些来源相关的无意义或不真实的内容”。这与事实性问题不同,后者强调模型学习、获取和利用事实性知识的能力。

举例说明两者的区别:

如果一个LLM在被要求创作”一个关于兔子和狼交朋友的童话故事”时,创作出了一个关于”兔子和狗交朋友”的故事,那么它就表现出了幻觉。不过,这并不一定是事实性错误。

如果生成的内容包含准确的信息,但与提示的具体内容有出入,那就是幻觉,而不是事实性问题。

例如,如果LLM的输出包含了比提示指定更多的细节或不同的元素,但事实仍然正确,这就是幻觉。

相反,如果LLM避免给出直接答案,而是说”我不知道”,或者给出了一个准确的答案,但遗漏了一些正确的细节,那么这就是事实性问题,而不是幻觉。

此外,值得注意的是,幻觉有时会产生一些内容,虽然与原始输入内容有偏差,但在事实方面仍然是准确的。

二、大模型事实性问题的归因分析

1、模型层面的原因

导致事实错误的大型语言模型的内在因素,这些因素源于其固有的知识和能力。

领域知识缺陷。 模型可能缺乏特定领域的综合专业知识,从而导致错误。每个LLM都有其局限性,这取决于它所训练的数据。如果一个LLM在训练过程中没有接触过特定领域的全面数据,那么当查询该领域时,它很可能会产生不准确或泛化的输出结果。例如,尽管LLM可能擅长回答一般的科学问题,但当被问及利基科学子领域时,它可能会出现问题。

过时信息。 模型对旧版数据集的依赖可能会使其不了解最近的发展或变化。LLM是在数据集上训练出来的,这些数据集在某些时候会过时。这就意味着,模型不会知道在上次训练更新之后发生的任何事件、发现或变化。例如,ChatGPT和GPT-4都是在2021.09之前的数据上训练出来的,可能无法了解之后的事件或进展。

记忆化。 模型并不总能保留训练语料库中的知识。虽然认为LLM会”记忆”数据是一种误解,但它们确实会根据训练形成知识表征。不过,它们可能并不总能从训练参数中回忆起特定的、不太受重视的细节,尤其是当这些细节很少见或没有通过多个示例得到强化时。例如,ChatGPT已经使用维基百科进行了预训练,但它仍然无法回答来自NaturalQuestions和TriviaQA的一些问题,而这些问题都是由维基百科构建的。

遗忘。 模型可能无法保留训练阶段的知识,也可能在进一步训练时遗忘先前的知识。当模型在新数据上进一步微调或训练时,就有可能出现”灾难性遗忘”,在这种情况下,模型可能会丢失之前已知的某些知识。这是神经网络训练中的一个众所周知的挑战,即网络在接受新数据时会遗忘以前学习过的信息,这在大型语言模型中也会发生。

推理失败。 虽然模型可能拥有相关知识,但有时它可能无法有效地利用这些知识进行推理以回答查询。即使LLM拥有回答问题所需的知识,它也可能无法将问题联系起来或进行逻辑推理。例如,输入中的模糊性可能会导致LLM理解失败,从而导致推理错误。此外,LLM存在反转诅咒陷阱,例如,它知道A是B的母亲,却无法回答谁是B的儿子。这在复杂的多步骤推理任务中或模型需要根据事实组合进行推理时尤为明显。

2、检索层面的原因

检索过程在决定LLM响应的准确性方面起着关键作用,尤其是在检索增强的环境中,增强的情况下更是如此。在这个层面上,有几个因素可能导致事实错误:

信息不足。 如果检索到的数据没有提供足够的上下文或细节,大模型可能很难做出符合事实的回答。由于缺乏全面的证据,这可能会导致通用甚至错误的输出。

LLM无法识别的错误信息。 LLM有时会接受并传播检索数据中的错误信息。当模型遇到知识冲突时,即检索到的信息与其预先训练的知识相矛盾,或者多个检索到的文档相互矛盾时,这种情况更加。例如,证据越不相关,模型就越有可能依赖其内在知识,LLM在检索过程中容易受到错误信息的攻击。

干扰信息。 LLM可能会被检索数据中的无关信息或干扰信息误导。例如,如果证据中提到了”俄罗斯电影”和”导演”,那么LLM可能会错误地推断出”导演是俄罗斯人”。分散注意力的检索结果会严重影响LLM。

长文本偏差。 此外,在处理长检索输入时,模型在处理输入上下文开头或结尾的信息时往往会表现出最佳性能。与此相反,当模型需要从这些冗长上下文的中间部分提取相关数据时,它们的性能可能会显著下降。

曲解相关信息。 即使检索到的信息与查询密切相关,LLM有时也会误解或曲解这些信息。虽然这种情况在检索过程优化后可能会减少,但它仍然是一个潜在的错误来源。。

3、推理层面的原因

滚雪球效应。在生成过程中,一开始的小错误或小偏差会随着模型不断生成内容而加剧。例如,如果一个LLM错误地理解了一个提示或以一个不准确的前提开始,随后的内容就会进一步偏离事实。

错误解码。 解码阶段对于将模型的内部表征转化为人类可读的内容至关重要。在这一阶段出现的错误,无论是由于波束搜索错误还是采样策略不理想等问题,都会导致输出错误地反映模型的实际”知识”或意图。这可能表现为不准确、矛盾,甚至是无意义的陈述。

暴露偏差。 LLM是训练数据的产物。如果他们更频繁地接触到某些类型的内容或措辞,他们可能会偏向于生成类似的内容,即使这些内容并不是最符合事实或最相关的。如果训练数据不平衡,或者某些事实场景代表性不足,这种偏差就会特别明显。在这种情况下,模型的输出结果反映的是训练数据,而不是客观事实。例如,LLM可以正确识别符合二元性别系统的个体的性别,但在确定非二元或中性性别时,LLM表现不佳。

三、事实性的衡量指标有哪些

包括基于规则的评估指标、神经评估指标、混合评估指标以及人工评估指标4种。

1、基于规则的评价指标

由于基于规则的评估指标具有一致性、可预测性和易于实施的特点,因此大多数大型语言模型的事实性评估都使用基于规则的评估指标。但是,它们可能比较死板,可能无法考虑语言使用、上下文解释或口语表达中的细微差别或变化。

许多事实性评估方法都使用通用指标,如准确度(Accuracy)、精确度(Precision)、召回率(Recall)、AUC、F-Measure、校准分数(Calibrationscore)、布赖尔分数(Brierscore)以及其他用于概率预测和机器学习(特别是涉及概率预测的任务)的通用指标。

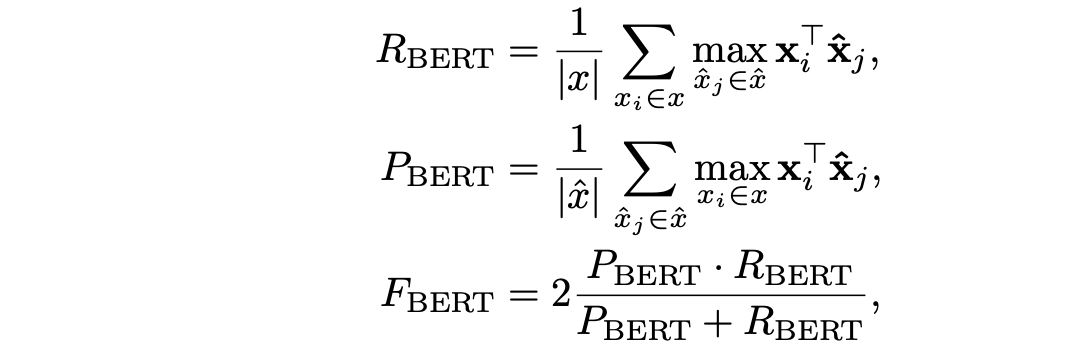

由于LLM的输入和输出都是人类可读的句子,因此没有将句子转换为标签的统一方法。大多数评估都会确定自己的方法。也就是说,这些分数通常不会单独使用,而是组合使用。例如,BERTScore使用BERT来确定精度和召回率,然后使用F-measures来获得最终的加权分数。

其次,神经评估指标。这些指标通过学习评估模型,将这些模型的输出与标准或参考文本进行比较。每个指标的评估方法略有不同,但都旨在评估机器生成的文本与其参考文本之间的语义和词汇一致性,从而确保生成内容的真实性。例如:

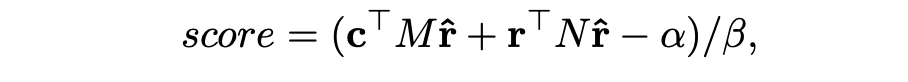

ADEM以半监督的方式训练分层RNN,预测机器生成的回复的评分。ADEM的评估主要取决于对话上下文(标记为c)、模型响应(标记为ˆr)和参考响应(标记为r)。

这些元素通过分层RNN编码后,会告知ADEM,然后ADEM会预测一个分数,反映模型响应与事实准确性和相关性的接近程度。

BERTScore利用BERT中预先训练好的上下文嵌入来衡量两个句子之间的相似性。具体做法是为引用句子”x”和模型生成的句子”xˆ”分配上下文嵌入,分别称为”x”和”xˆ”。然后计算召回率、精确率和F1分数,以量化”x”和”xˆ”之间的相似度。这个分数可以衡量生成句子的事实性,从而衡量大语言模型本身的可靠性。

BLEURT采用一种独特的预训练方案,即BERT最初是在大量合成句对语料库中进行训练的。同时使用的多个词汇和语义级监督信号对此进行强化。在预训练阶段之后,BERT将在评分数据上进行进一步微调,其目标是准确估算人类评分。

BARTScore使用BART(一种基于编码器-解码器的预训练模型)将生成的文本翻译成参考点和参考点之间的文本,当文本更准确、更流畅时,得分更高。该指标提供了多种变体,可在无监督的情况下灵活应用于文本评估的不同角度,如流畅性或事实性。测试表明,BARTScore在大多数测试环境中都能在多个数据集和角度上超越现有的最高得分指标。

2、基于机器自动评估指标

使用LLM进行评估具有效率高、通用性强、可减少对人工标注的依赖等优点,而且可以在单次模型调用中评估对话质量的多个维度,从而提高了可扩展性。但是潜在的问题包括缺乏既定的验证,如果用于评估的LLM没有经过彻底审查,可能会导致偏差或准确性问题。

例如:

GPTScore利用了19种不同的预训练模型(如zero-shot)的新兴能力,并用它们来评判生成的文本。这些模型的规模从80M到175B不等。对四种文本生成任务、22个评估方面和37个相关数据集的测试表明,GPTScore可以有效评估自然语言中的每条指令文本。

GPT-judge基于GPT-3-6.7B微调,经训练后用于评估TruthfulQA数据集中问题答案的真实性。训练集由问题-答案-标签组合形式的三元组组成,其中的标签可以是”真”或”假”。模型的训练集包括基准中的示例和由人工评估的其他模型生成的答案。在最终形式中,GPT-judge使用来自所有模型的示例来评估答案的真实性

四、事实性评估数据集及提升大模型事实性能力

1、通用领域事实性评估数据集

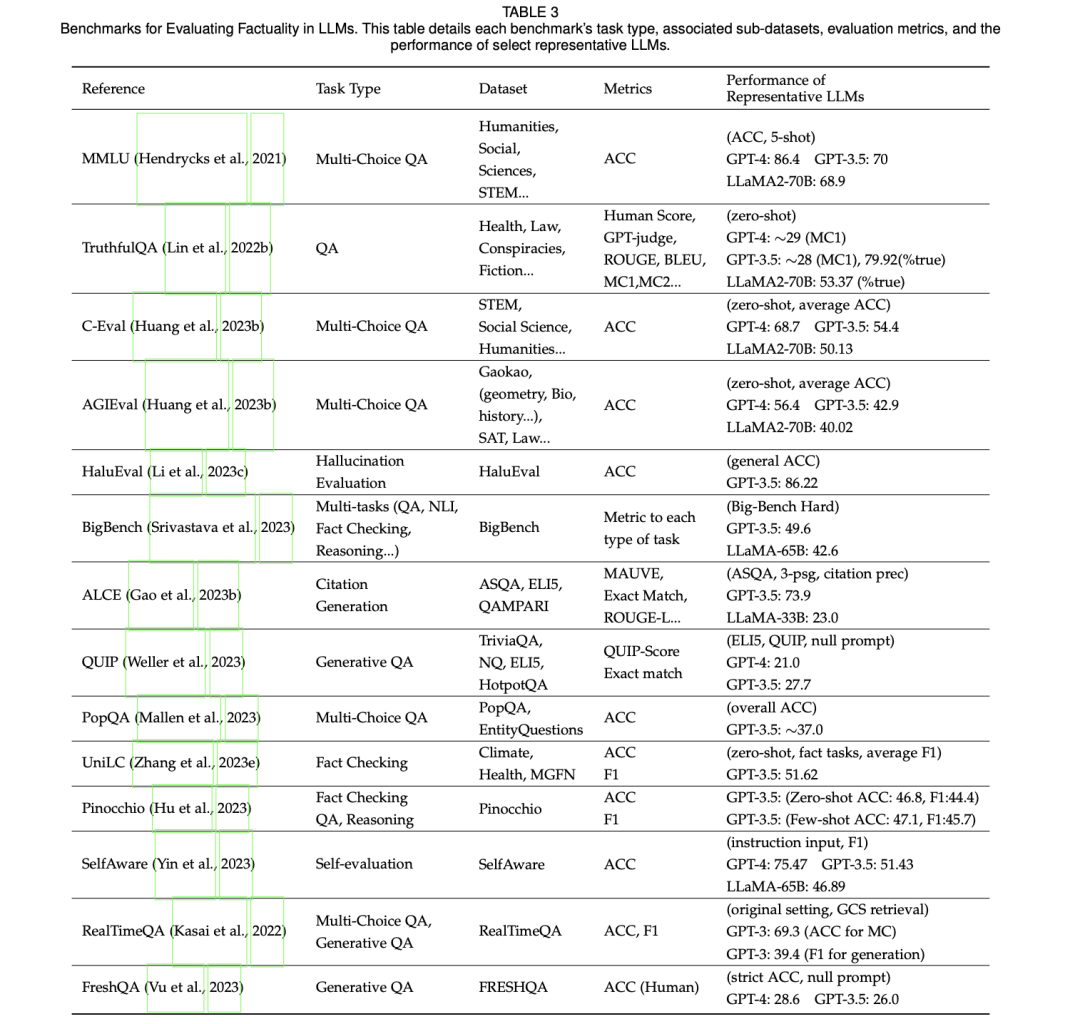

通用事实性评估,主要包括如MMLUAGIeval等考试题等,如下表所示:

2、垂直领域事实性评估数据集

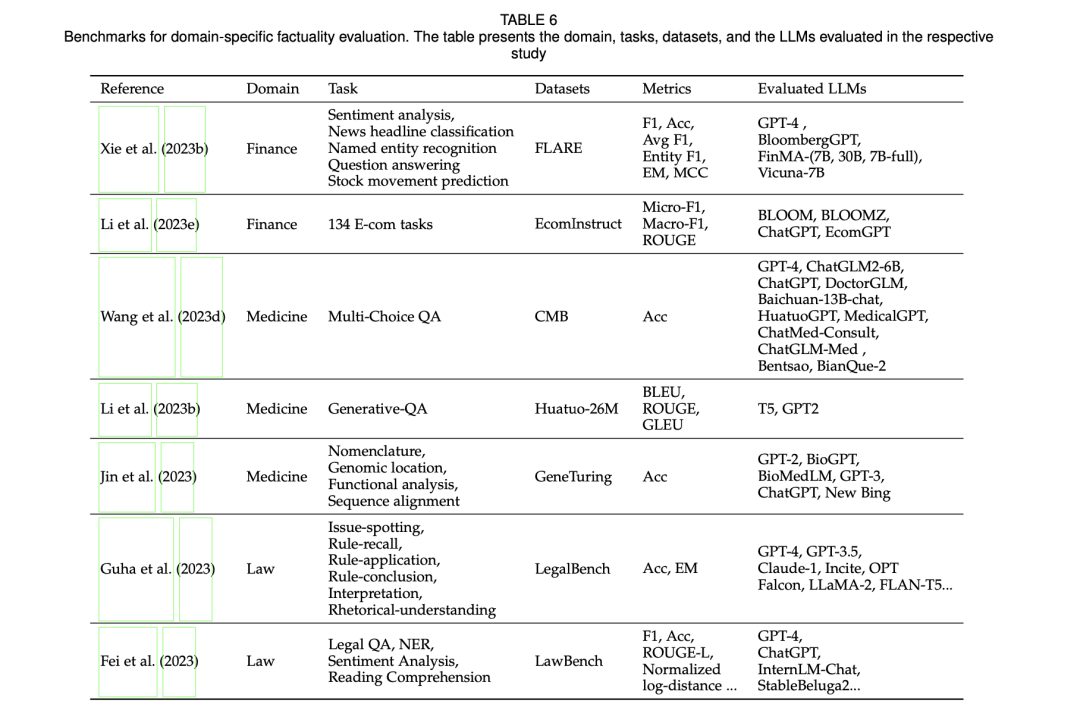

垂直领域事实性评估数据集主要解决在垂直领域的评估问题,包括金融Finance、医疗medicine以及法律领域的评估,,如下表所示:

3、如何提升大模型事实性能力

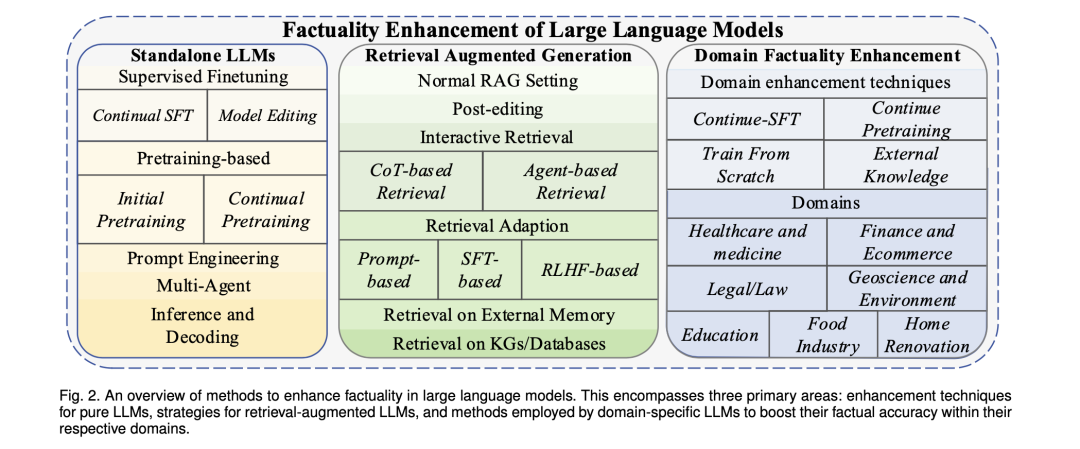

不同阶段增强LLM事实性的方法,包括LLM生成、检索增强生成、推理阶段增强和特定领域事实性改进(如图2所示)。

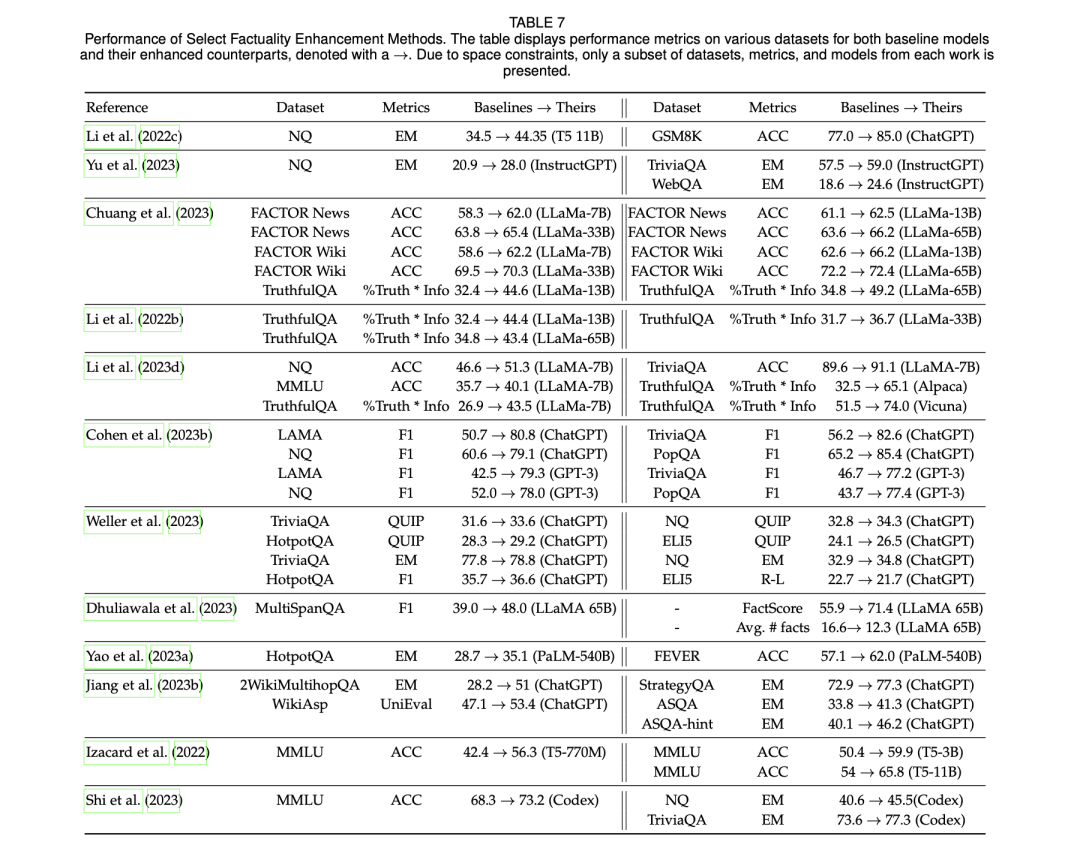

表7总结了增强方法及其各自对基准LLM的改进,也可看看。

总结

本文主要介绍了《Survey on Factuality in Large Language Models:Knowledge, Retrieval and Domain-Specificity》这一综述工作,该工作所提及的一些工作,可以参考https://github.com/wangcunxiang/LLM-Factuality-Survey,会有更多收获。

参考文献

1、https://arxiv.org/abs/2310.07521

2、https://github.com/wangcunxiang/LLM-Factuality-Survey.

关于我们

老刘,刘焕勇,NLP开源爱好者与践行者,主页:https://liuhuanyong.github.io。

老刘说NLP,将定期发布语言资源、工程实践、技术总结等内容,欢迎关注。

对于想加入更优质的知识图谱、事件图谱、大模型AIGC实践、相关分享的,可关注公众号,在后台菜单栏中点击会员社区->会员入群加入。

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง