关键词:机器学习,神经网络,功能模块化,解剖学模块化,大脑启发的模块化训练,涌现

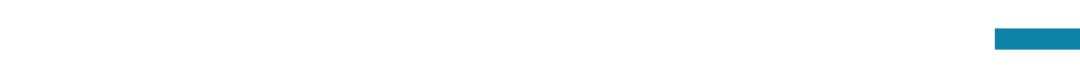

论文题目:Growing Brains: Co-emergence of Anatomical and Functional Modularity in Recurrent Neural Networks

论文链接:

https://arxiv.org/abs/2310.07711

递归神经网络(RNN)经过组合任务训练可以表现出功能模块化(functional modularity),其中神经元可以通过活动相似性和参与共享计算子任务进行聚类。与大脑不同,这些 RNN 不表现出解剖学模块化(anatomical modularity),其中功能聚类与强的递归耦合和功能聚类的空间定位相关。功能模块化可能暂时地依赖于输入,与之相反,解剖学模块化网络会形成强大的基础,在未来解决相同的子任务。

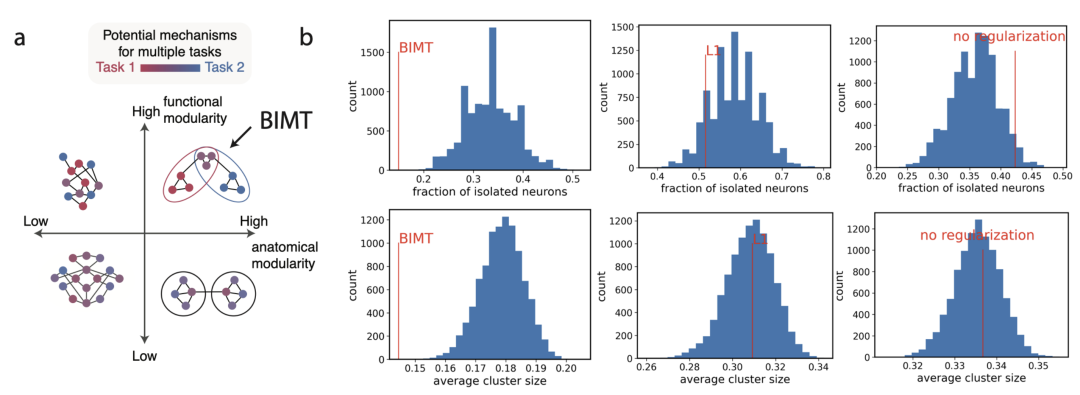

为了检查是否可能生长出类似于大脑的解剖学模块化,这项研究将最近的机器学习方法——大脑启发的模块化训练(brain-inspired modular training,BIMT),应用于正在训练以解决一组组合认知任务的网络。结果发现,功能聚类和解剖学聚类一起涌现,使得功能相似的神经元也变得空间局域化和互相连接。

此外,与标准L1或无正则化设置相比,该模型通过最优地平衡任务性能和网络稀疏性表现出卓越的性能。除了在RNN中实现类似于大脑的组织,这些研究结果还表明,BIMT 在神经形态计算和提高神经网络架构可解释性方面具有潜力。

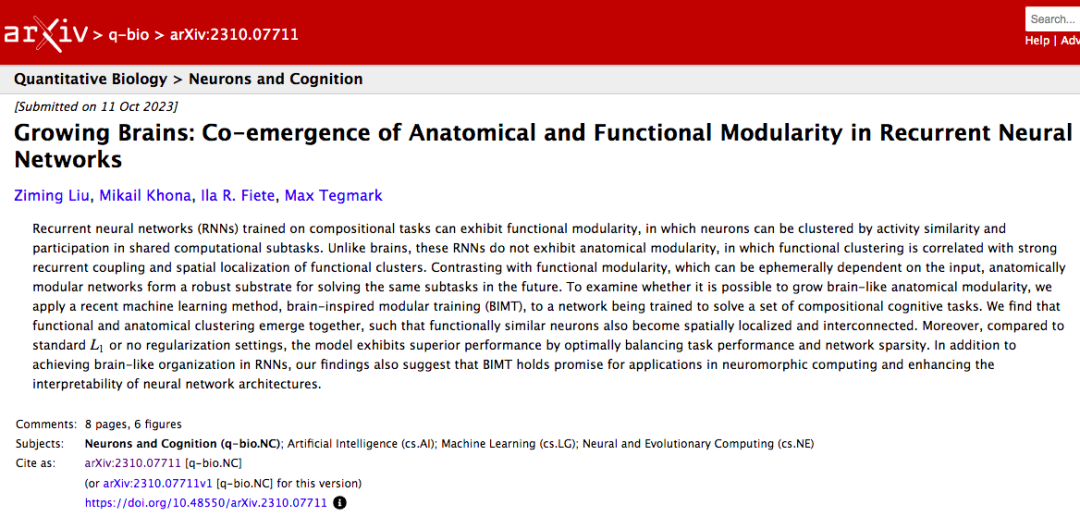

图1. 用大脑启发的模块化训练(BIMT)方法训练 RNN。a. 网络可视化;b. 隐藏神经元聚类为功能模块;c. 功能模块(不同颜色)也在空间聚类,类似于大脑;L1 正则化则不会导致解剖学模块化。网络具有 d. 良好的性能,e. 高的系属性,f. 良好的局域化;g-h. 性能和稀疏性的权衡。

图2. 多样的解剖和功能模块化可以在 RNN 中表示出来;用(左)BIMT、(中)L1 正则化、(右)无正则化测试神经网络的解剖模块化。

编译|梁金

AI+Science 读书会

详情请见:人工智能和科学发现相互赋能的新范式:AI+Science 读书会启动

推荐阅读

1. Nat. Commun. 速递:抽象表征从训练执行多任务的神经网络中自然涌现2. 从细胞到解剖稳态的扩展:从个体发育到集体智能3. Nature 速递:通过网络推断和计算机模拟基因扰动解剖细胞特性4. 张江:第三代人工智能技术基础——从可微分编程到因果推理 | 集智学园全新课程5. 成为集智VIP,解锁全站课程/读书会6. 加入集智,一起复杂!

点击“阅读原文”,报名读书会

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง