内容来自机器之心

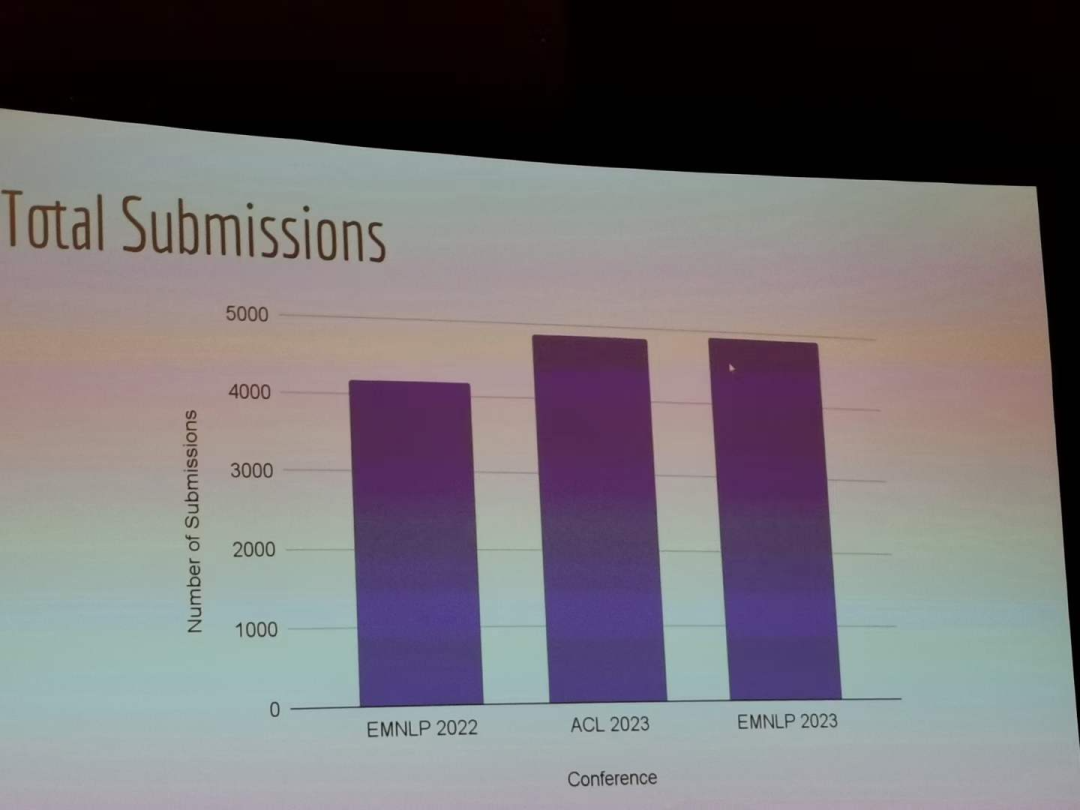

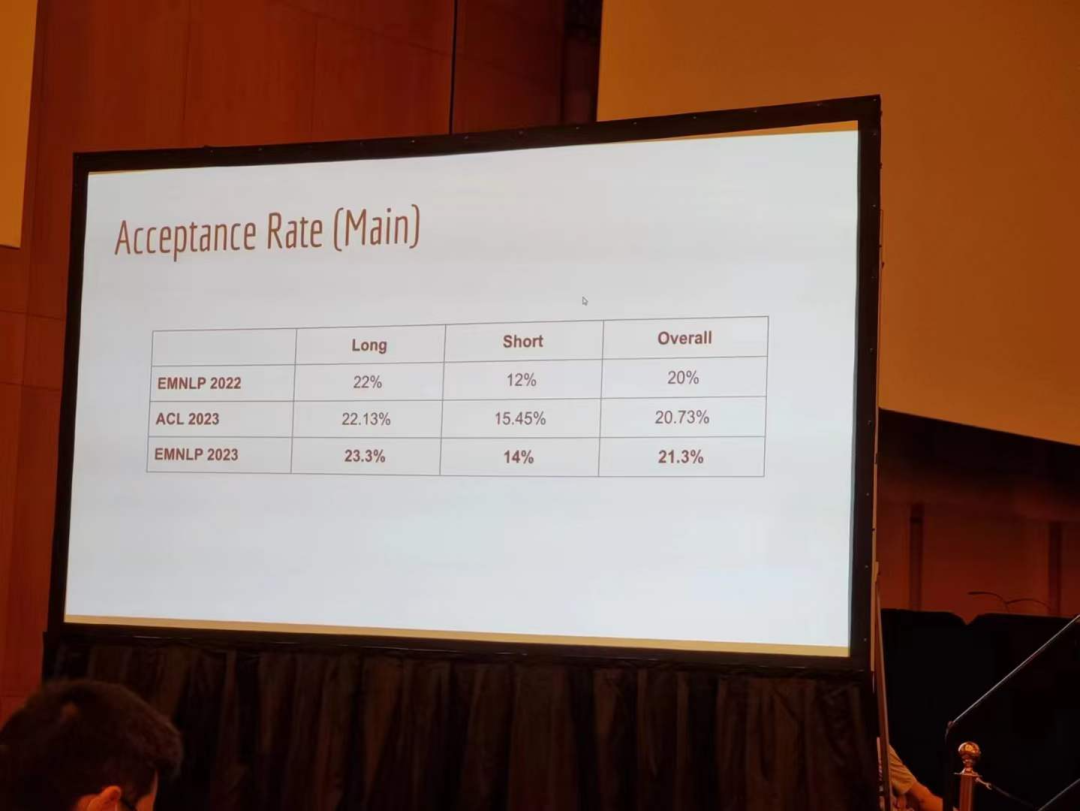

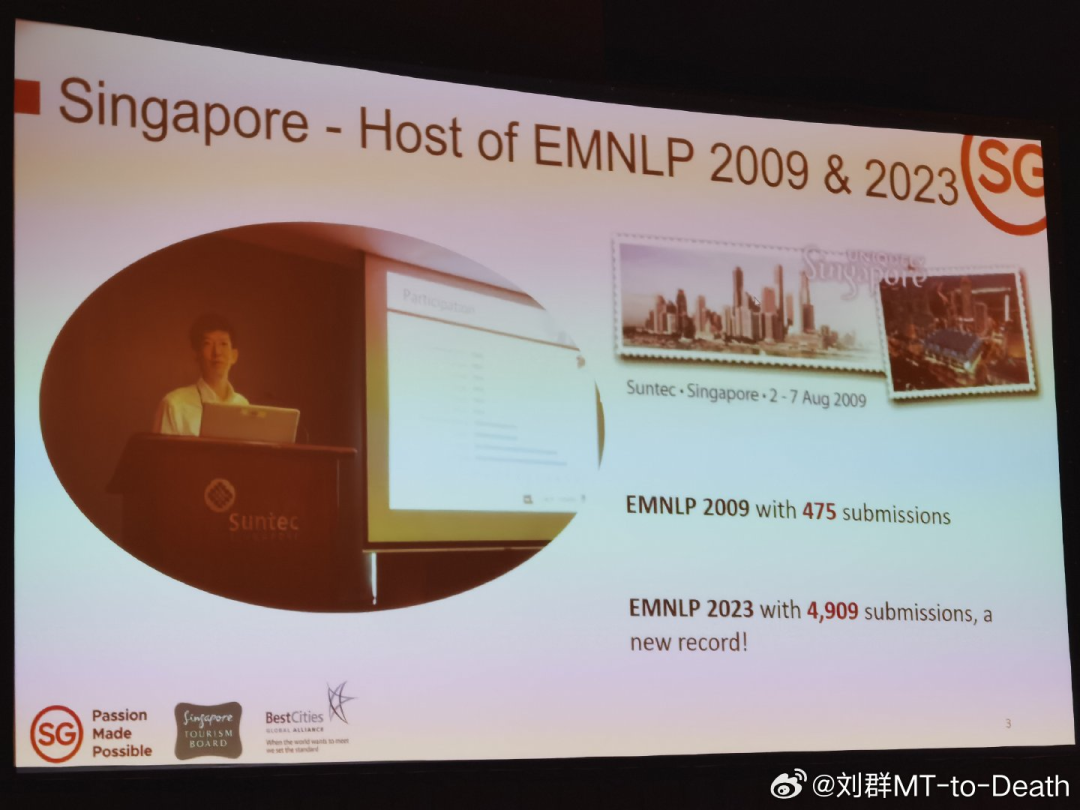

本届 EMNLP 大会在投稿人数上创了新高,整体接收率也较上届略有提升。

EMNLP 是自然语言处理领域的顶级会议之一,EMNLP 2023 于 12 月 6 日 – 10 日在新加坡举行。

因为今年 ChatGPT 的爆火带动大模型、NLP 概念,EMNLP 2023 的投稿论文数量也达到近 5000 篇,甚至略高于 ACL 2023。

在接收率方面,长论文接收率为 23.3%,短论文接收率为 14%,整体接收率为 21.3%。这一数据相较 EMNLP 2022 的 20% 略有提升。

我们从这次 EMNLP 的 local chair 李海洲老师的一张 PPT 上,可以感受下这场大会的发展历程。

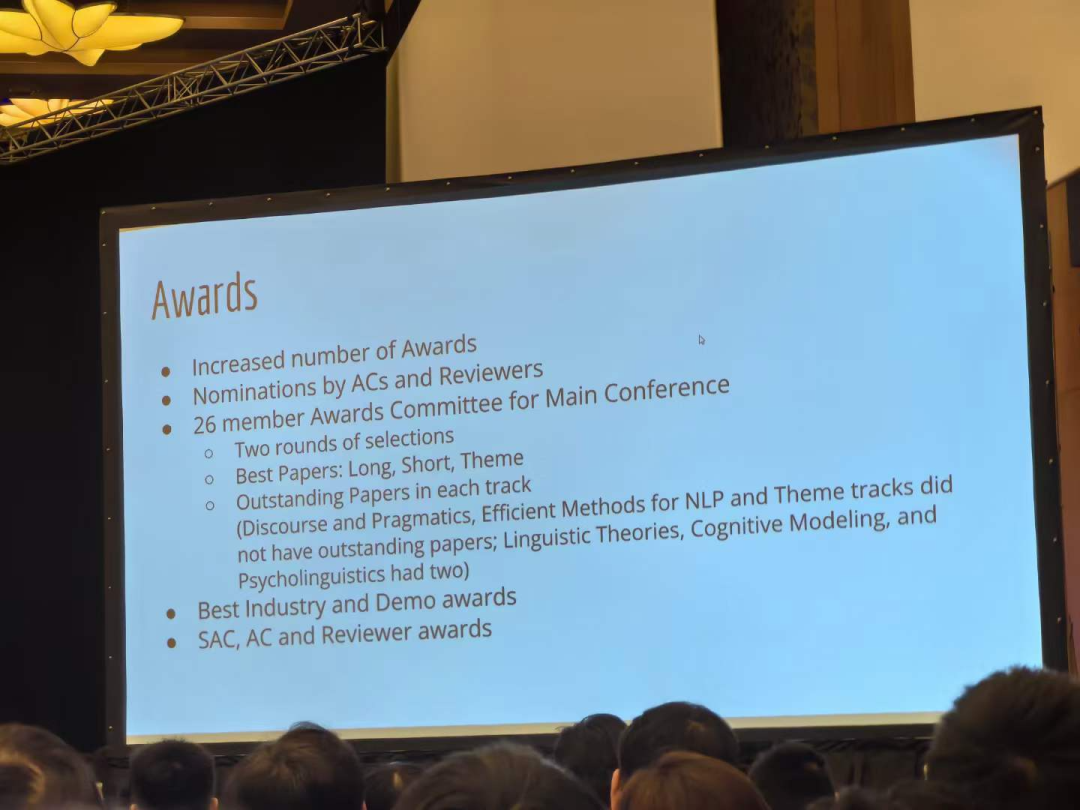

除了这些论文数据外,今年 EMNLP 的获奖论文也备受关注。

EMNLP 2023 颁发了最佳长论文、最佳短论文、最佳主题论文、最佳 Demo 论文和最佳行业论文各一篇,以及多篇不同赛道的杰出论文。

同时,官方公布了 EMNLP 2024 将于 2024 年 11 月 12-16 日、佛罗里达州迈阿密市举办。

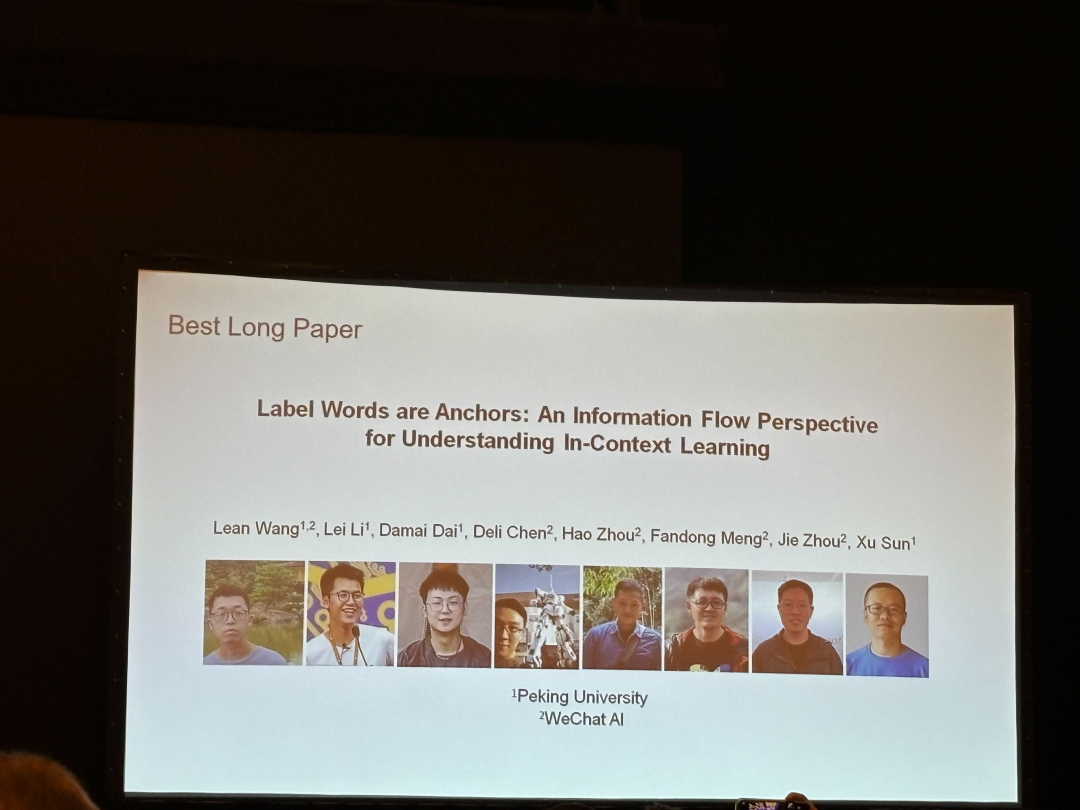

EMNLP 2023 最佳长论文

论文标题:Label Words are Anchors: An Information Flow Perspective for Understanding In-Context Learning

- 论文地址:https://aclanthology.org/2023.emnlp-main.609.pdf

- 机构:北京大学、腾讯 WeChat AI

论文摘要:上下文学习为大型语言模型(LLM)提供了执行不同任务的演示示例,成为了一种很有潜力的机器学习方法。然而,LLM 如何从所提供的上下文中学习的基础机制仍在探索之中。

因此,北京大学和腾讯 WeChat AI 的研究者通过信息流的视角探究上下文学习的工作机制。研究结果发现,演示示例中的标签词发挥了锚点(anchor)的作用,具体表现为以下两个方面:

- 语义信息在浅计算层的处理过程中聚合为标签词表示;

- 标签词中的整合信息作为 LLM 最终预测的参考。

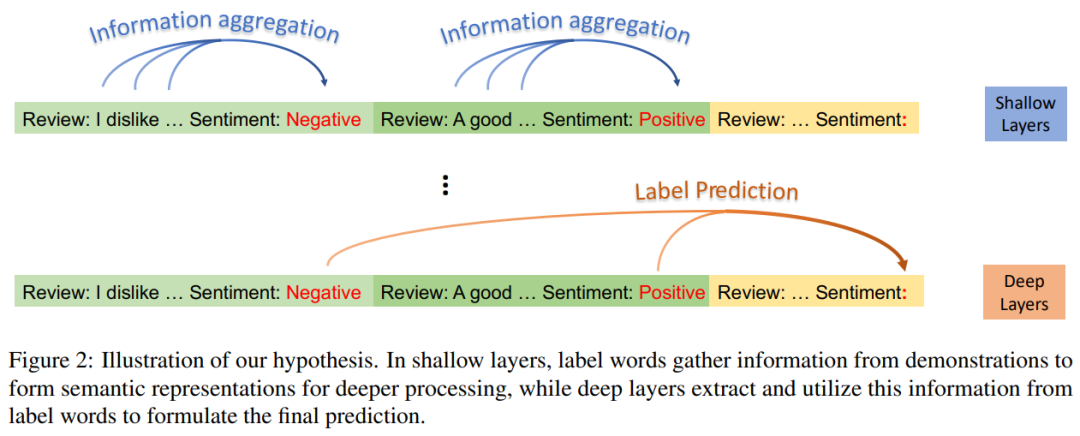

基于这些发现,研究者提出一种提升上下文学习性能的锚点重加权方法、一种加速推理的演示压缩技术、以及用于判断 GPT2-XL 中上下文学习误差的分析框架。 研究者提出的假设。在浅层,标签词从演示中收集信息,以形成语义表示来进行更深层处理;深层从标签词中提取并利用这些信息以形成最终预测。

研究者提出的假设。在浅层,标签词从演示中收集信息,以形成语义表示来进行更深层处理;深层从标签词中提取并利用这些信息以形成最终预测。

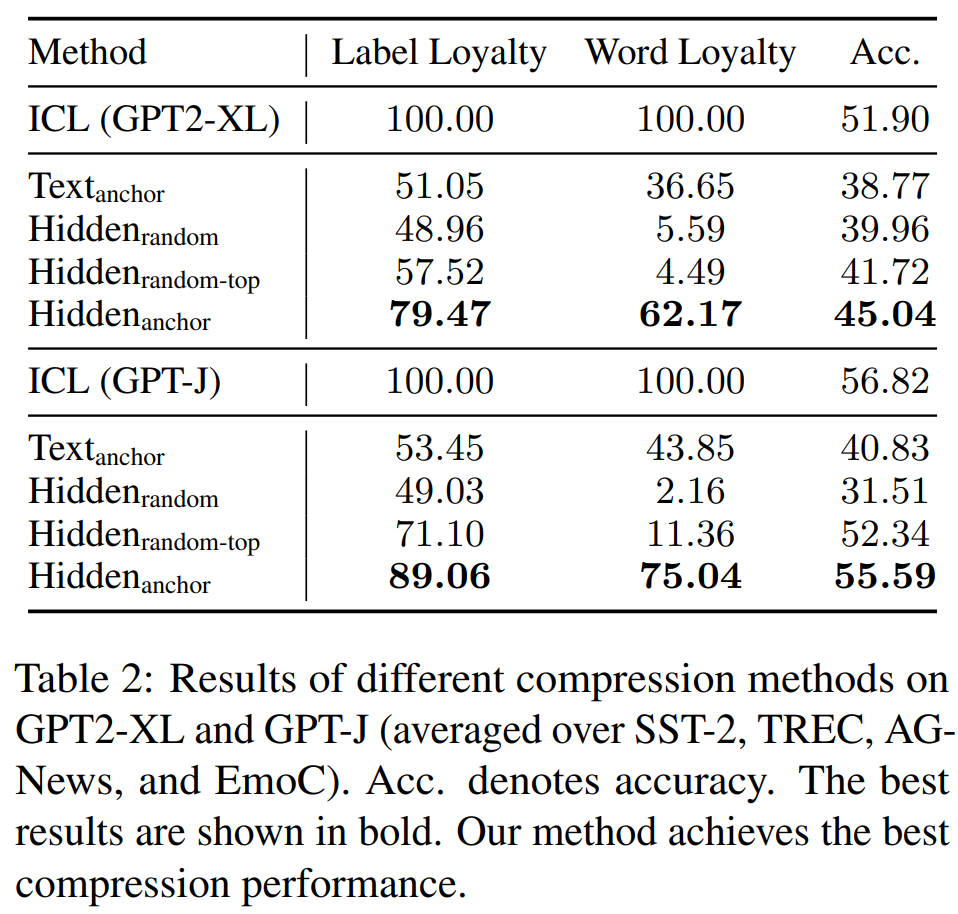

本文研究结果具有前景广阔的应用,再次验证了上下文学习的工作机制,为未来研究铺平了道路。 GPT2-XL 和 GPT-J 上不同压缩方法的结果比较。

GPT2-XL 和 GPT-J 上不同压缩方法的结果比较。

EMNLP 2023 最佳短论文

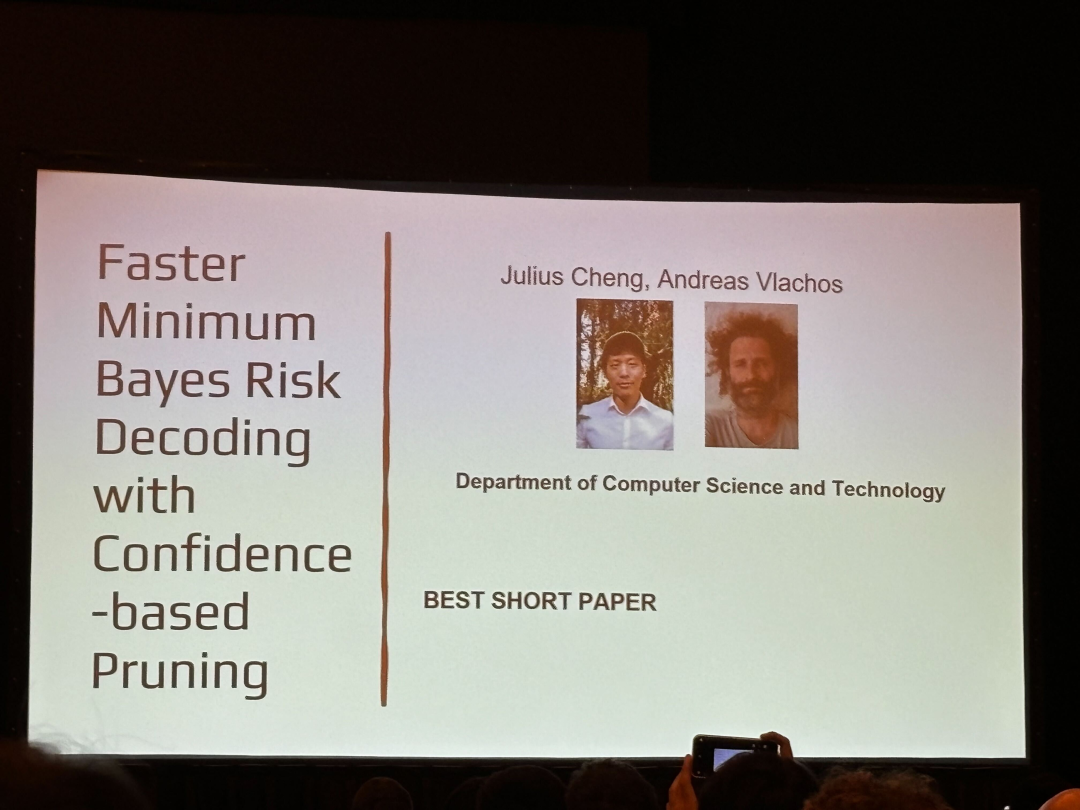

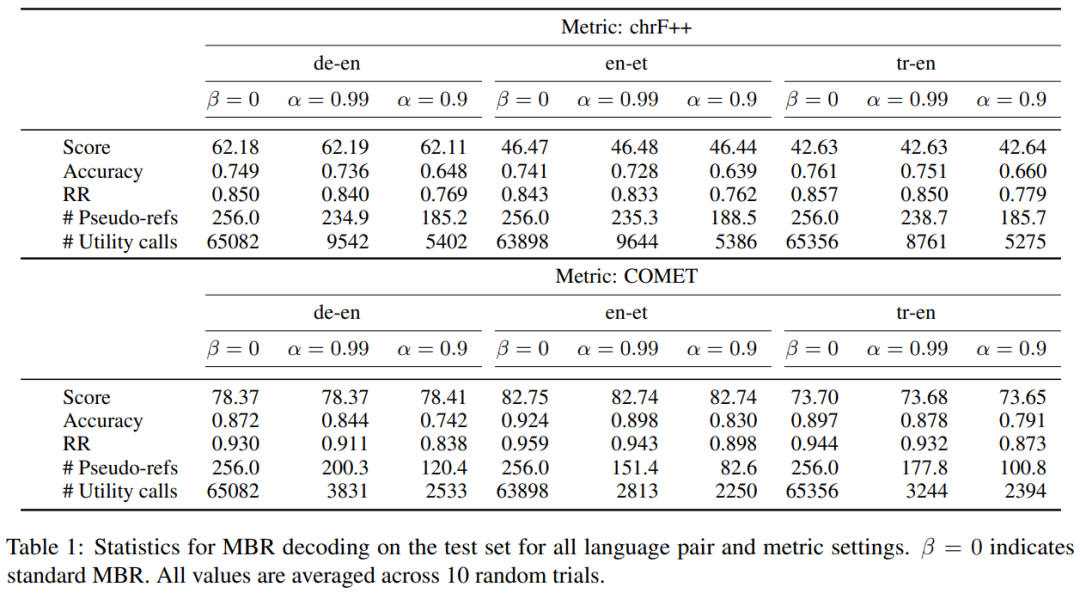

论文标题:Faster Minimum Bayes Risk Decoding with Confidence-based Pruning

- 论文地址:https://aclanthology.org/2023.emnlp-main.767.pdf

- 机构:剑桥大学

论文摘要:最小贝叶斯风险(MBR)解码是输出在模型分布上对某个效用函数具有最高预期效用的假设。在条件语言生成问题,尤其是神经机器翻译中,无论是在人类评估还是自动评估中,它的准确性都超过了束搜索(beam search)。然而,基于采样的标准 MBR 算法的计算成本远高于束搜索,它需要大量采样以及对效用函数的二次调用,这限制了它的适用性。

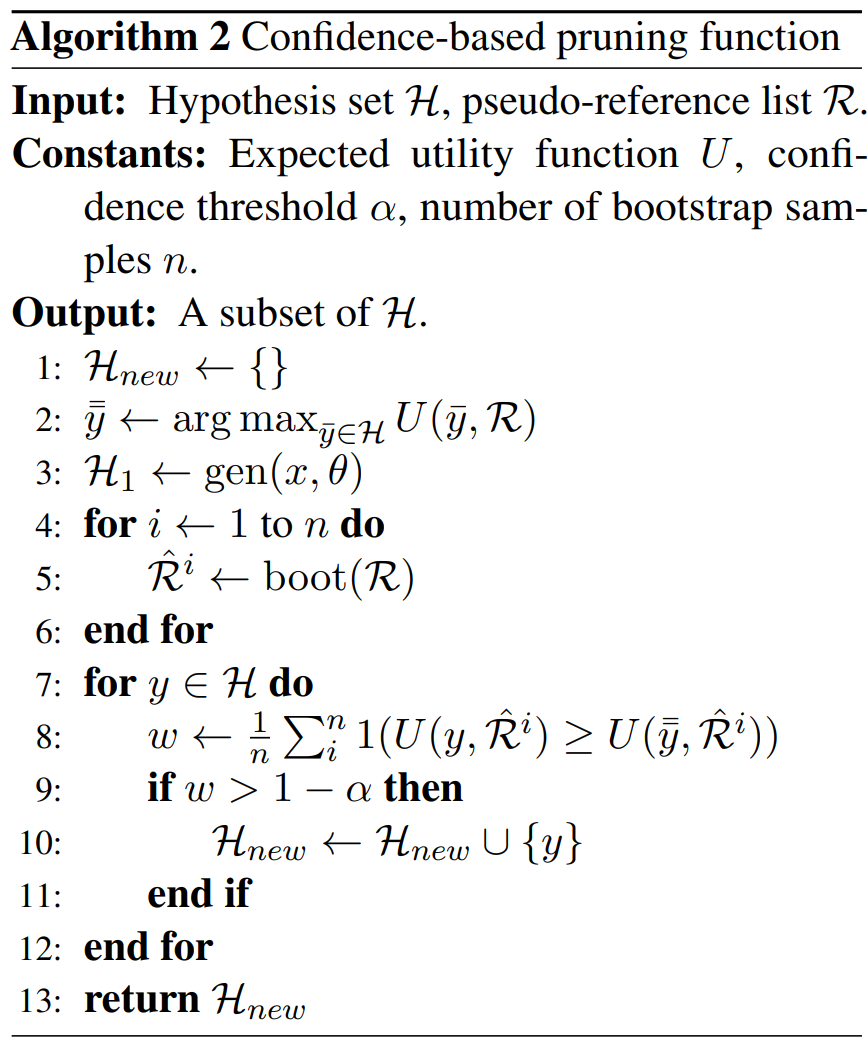

本文介绍了一种 MBR 算法,它可以逐渐增加用于估计效用的样本数量,同时剪枝根据引导抽样获得的置信估计不太可能具有最高效用的假设。与标准 MBR 相比,该方法所需的样本更少,调用效用函数的次数也大幅减少,同时准确性方面相差无几。 算法 2:基于置信的剪枝函数。

算法 2:基于置信的剪枝函数。

研究者使用 chrF++ 和 COMET 作为效用 / 评估指标,在三种语言对的实验中证明了该方法的有效性。 实验结果。

实验结果。

EMNLP 2023 最佳主题论文

论文标题:Ignore This Title and HackAPrompt: Exposing Systemic Vulnerabilities of LLMs Through a Global Prompt Hacking Competition

- 论文地址:https://aclanthology.org/2023.emnlp-main.302.pdf

- 机构:马里兰大学、Mila、 Towards AI、斯坦福大学等

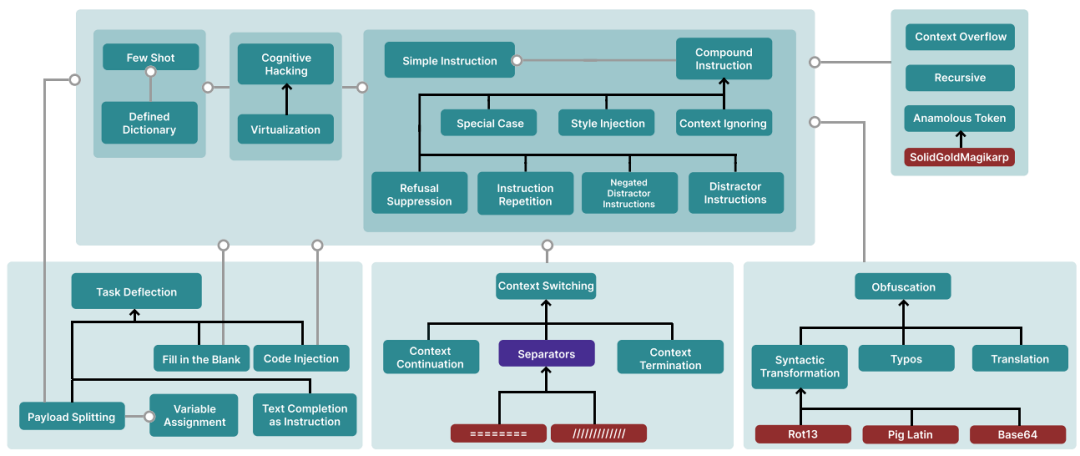

论文摘要:大型语言模型 (LLM) 通常部署在用户直接参与的交互式环境中,例如聊天机器人、写作助手。这些部署很容易受到即时「注入」和「越狱」(统称为即时黑客攻击)的攻击,其中模型被操纵以忽略其原始指令并遵循潜在的恶意指令。尽管人们广泛认为这是一个重大的安全威胁,但关于即时黑客攻击的定量研究仍然比较少。

因此,该研究发起了全球即时黑客竞赛,允许自由形式的人工输入攻击,并针对三个 SOTA LLM 提出了超过 60 万条对抗性 prompt。实验结果表明,当前的 LLM 确实可以通过即时黑客攻击进行操纵。 prompt 黑客技术分类。

prompt 黑客技术分类。

EMNLP 2023 最佳 Demo 论文

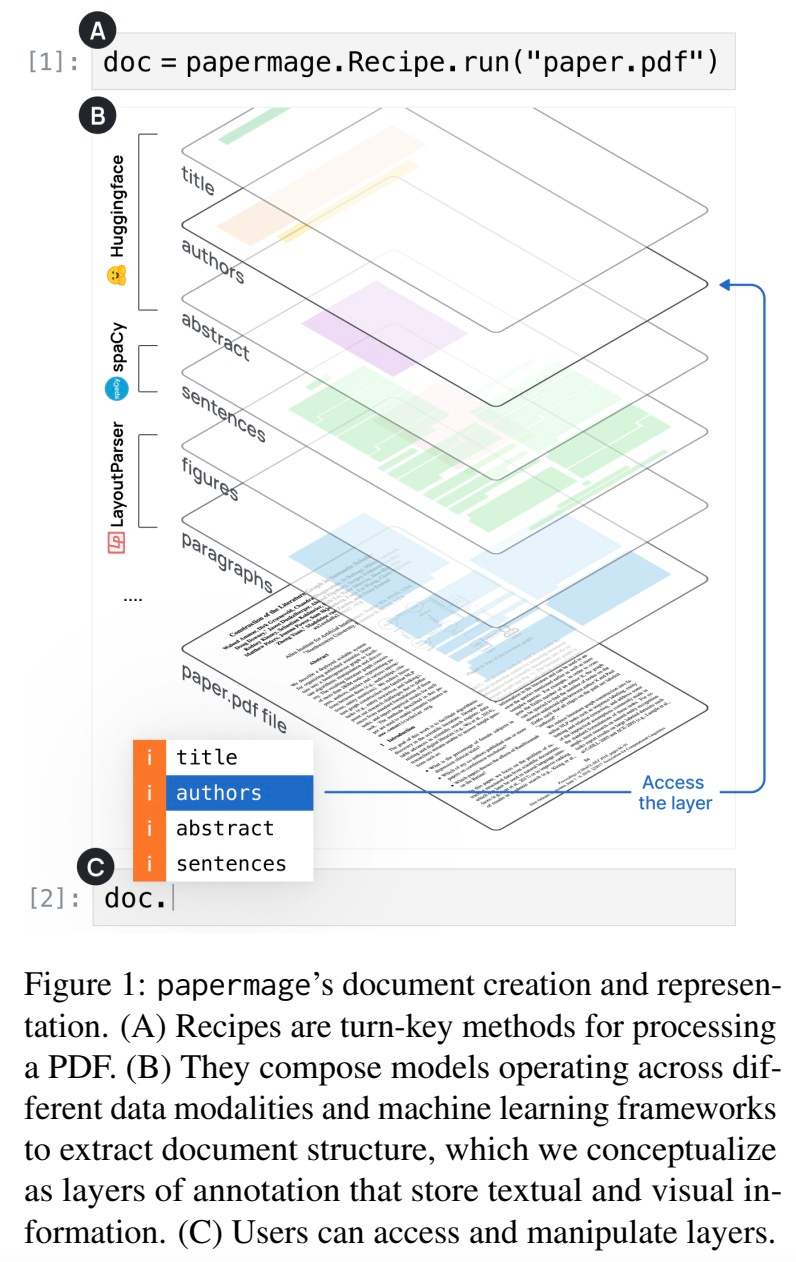

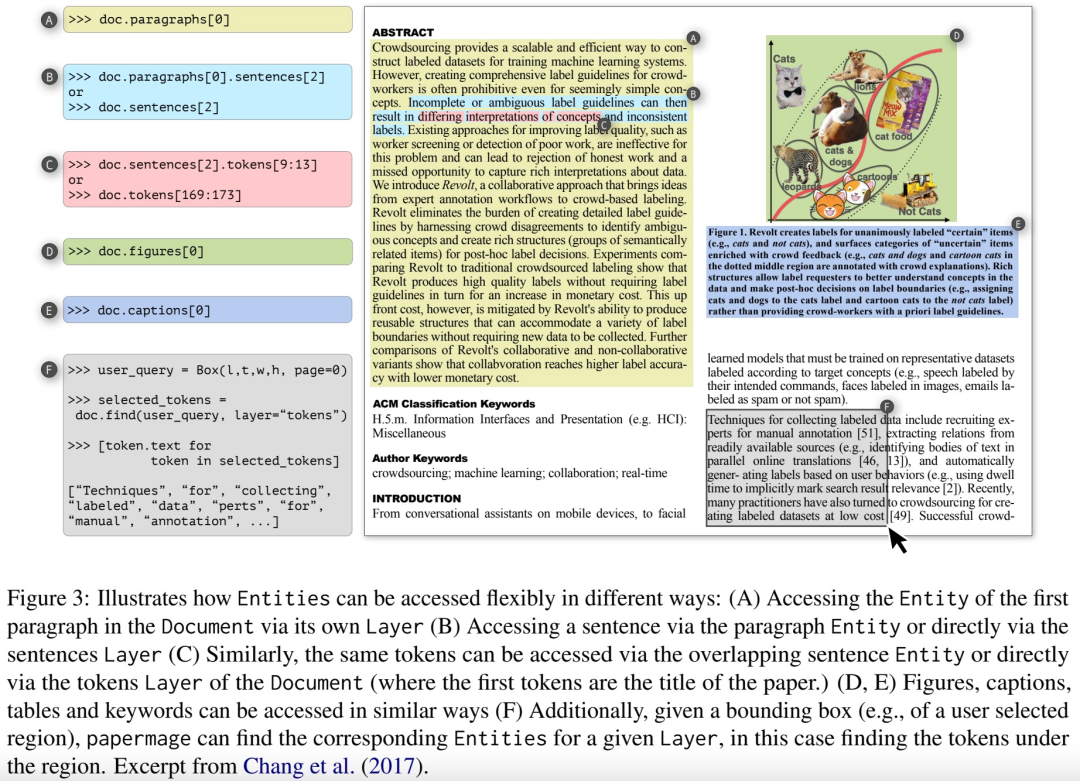

论文标题:PaperMage: A Unified Toolkit for Processing, Representing, and Manipulating Visually-Rich Scientific Documents

- 论文地址:https://aclanthology.org/2023.emnlp-demo.45.pdf

- 机构:艾伦人工智能研究院、MIT、加州大学伯克利分校、华盛顿大学、美国西北大学

论文摘要:科研领域的学术文献往往是复杂的、理论的,并且大部分是 PDF 格式的文档,查阅文献需要花费大量时间。为了解决该问题,该论文提出一个开源的 Python 工具包 ——papermage,用于分析和处理视觉效果丰富、结构化的科学文档。

papermage 通过将不同的 SOTA NLP 和 CV 模型集成到一个统一的框架中,为科学文献提供了清晰直观的抽象,并为常见的科学文档提供处理用例。在学术文献搜索引擎 Semantic Scholar 的支持下,papermage 已经可以处理多个 AI 应用研究原型的科学文献。

EMNLP 2023 最佳行业论文

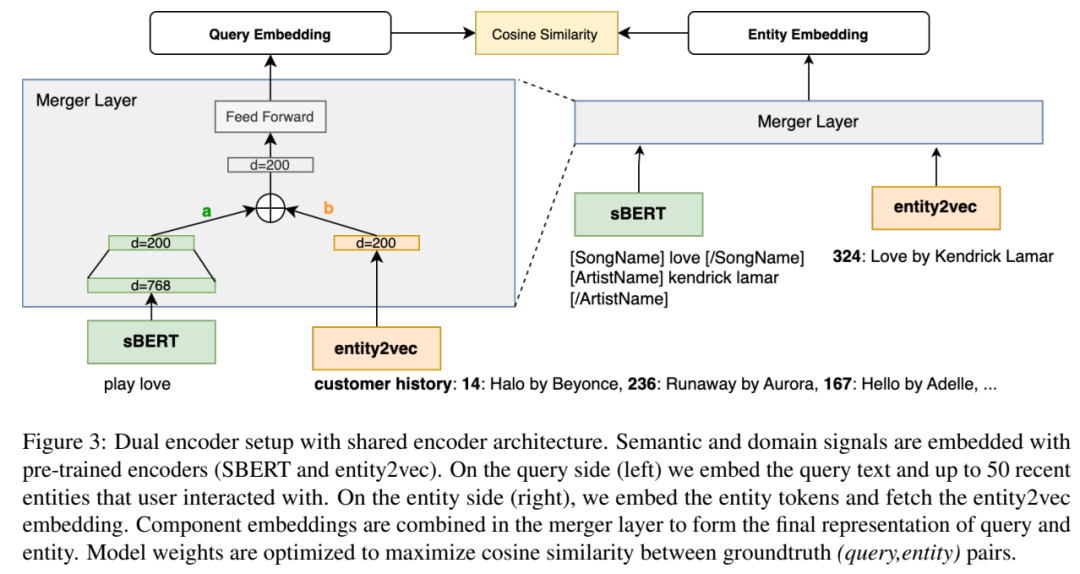

论文标题:Personalized Dense Retrieval on Global Index for Voice-enabled Conversational Systems

- 论文地址:https://aclanthology.org/2023.emnlp-industry.9.pdf

- 机构:亚马逊 Alexa AI 研究团队

论文摘要:语音控制的人工智能对话系统容易受语音变化噪音的干扰,并且难以解决含糊不清的实体问题。通常情况下,部署个性化实体解析(ER)、查询重写(QR)从这些错误模式中恢复。以往的工作通过限制检索空间至用户与设备的历史互动建立的个性化索引来实现个性化。虽然这种限制性检索能够实现高精度,但预测仅限于用户近期历史中的实体,因此无法广泛覆盖未来的请求。此外,为大量用户维护单个索引需要既耗费内存又难以扩展。

本文提出了一种个性化实体检索系统,它不局限于个性化索引并对语音噪声和歧义具有稳健性。研究者将用户的收听偏好嵌入到检索中使用的上下文查询嵌入中。他们展示了提出模型纠正多种错误模式的能力,并在实体检索任务上比基线提高了 91%。他们还优化了端到端方法,使其在保持性能提升的同时,也符合在线延迟的限制。

其他杰出论文奖

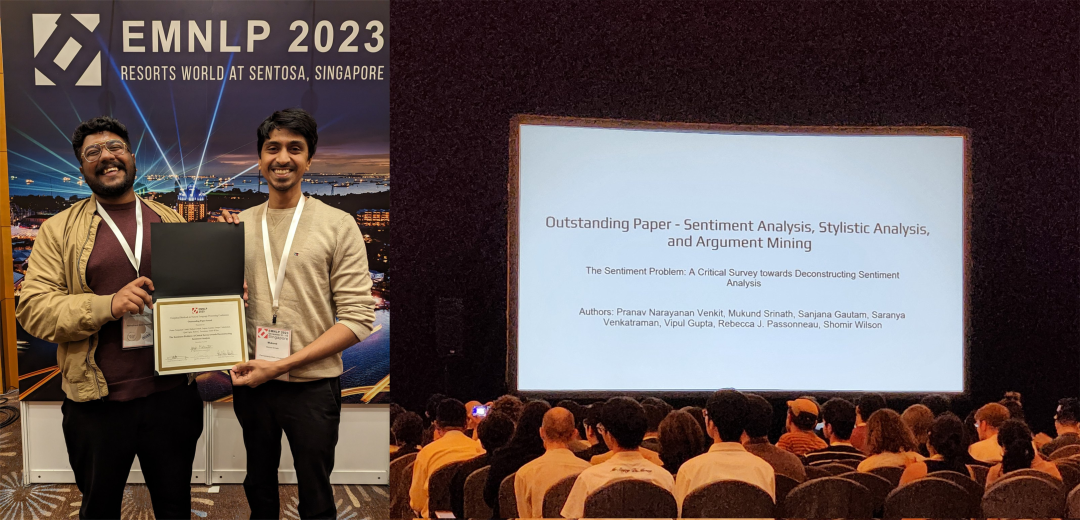

除了以上奖项,EMNLP 2023 官方还颁发了一些赛道的杰出论文奖,如宾夕法尼亚州立大学研究者的论文《The Sentiment Problem: A Critical Survey towards Deconstructing Sentiment Analysis》获得了情感分析、文体分析和论据挖掘赛道的杰出论文奖。 图源:https://twitter.com/PranavVenkit/status/1733856362214674848

图源:https://twitter.com/PranavVenkit/status/1733856362214674848

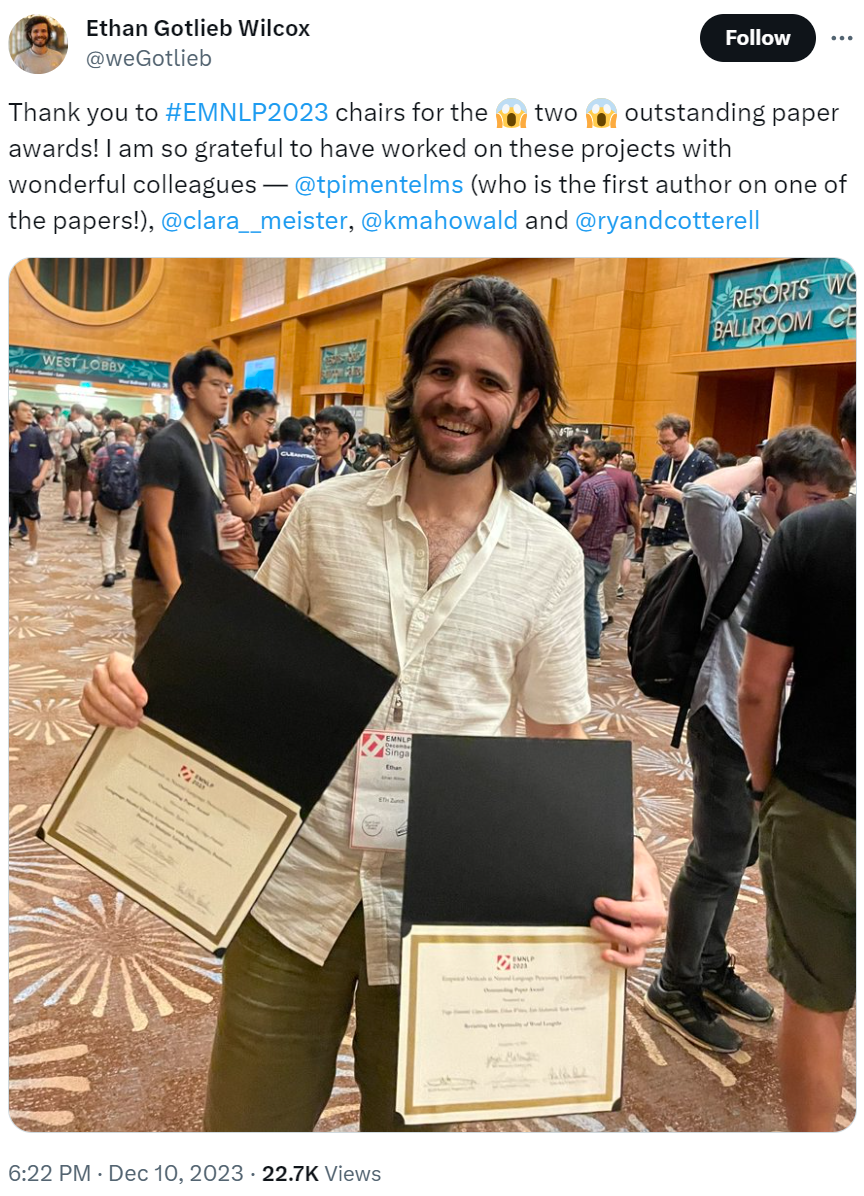

苏黎世联邦理工学院(ETH)博士后研究员 Ethan Gotlieb Wilcox 参与的两篇论文获得了杰出论文奖。 图源:https://twitter.com/weGotlieb/status/1733794210074243348

图源:https://twitter.com/weGotlieb/status/1733794210074243348

蒂尔堡大学、阿姆斯特丹大学研究者的论文《Homophone Disambiguation Reveals Patterns of Context Mixing in Speech Transformers》也获得了杰出论文奖。 图源:https://twitter.com/gchrupala/status/1733788397976650154

图源:https://twitter.com/gchrupala/status/1733788397976650154

|点击关注我 👇 记得标星|

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง