点击下方卡片,关注「AIWalker」公众号

底层视觉干货,即可获取

https://arxiv.org/abs/2312.09158

https://glee-vision.github.io

AIWalker后台回复【GLEE】即可下载原文与译文。

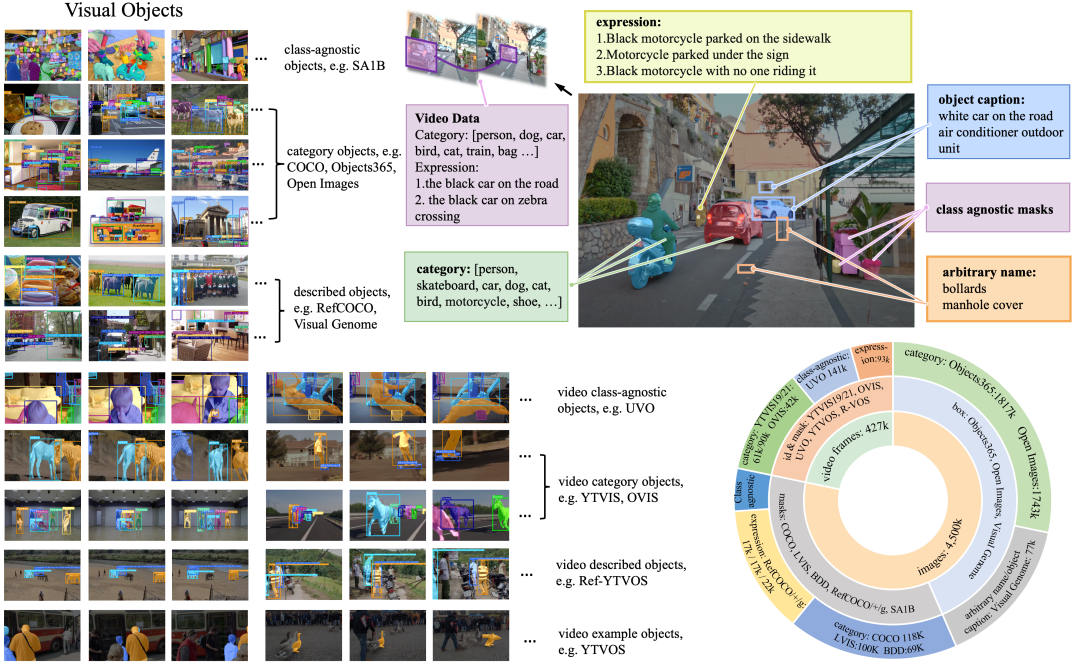

在这项工作中,我们提出了GLEE:一个对象级的基础模型,用于定位和识别图像和视频中的对象。

- 通过一个统一的框架,GLEE可以在开放世界场景中完成任意物体的检测、分割、跟踪、接地和识别,以完成各种物体感知任务。

- 采用内聚学习策略,GLEE从不同监督级别的不同数据源中获取知识,以形成通用对象表示,擅长零次迁移到新数据和任务。

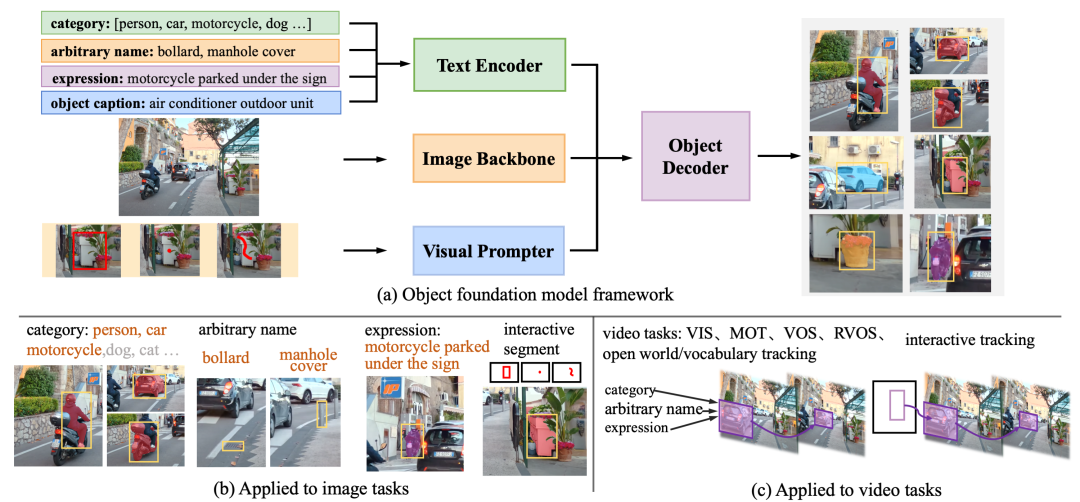

具体来说,我们采用图像编码器,文本编码器和视觉解码器来处理多模态输入,从而能够同时解决各种以对象为中心的下游任务,同时保持最先进的性能。通过对来自不同基准的500多万张图像进行广泛的训练,GLEE表现出显着的多功能性和改进的泛化性能,有效地处理下游任务,而不需要特定于任务的适应。通过集成大量的自动标注数据,我们进一步增强了其零炮概化能力。此外,GLEE能够被集成到大型语言模型中,作为基础模型为多模态任务提供通用的对象级信息。我们希望,我们的方法的可靠性和普遍性将标志着一个重要的一步,有效的视觉基础模型的AGI系统的发展。模型和代码将在/上发布。

本文亮点

- 我们提出了GLEE:一个通用的以对象为中心的基础模型的图像和视频, GLEE能够同时处理各种以对象为中心的任务,同时保持最先进的性能。

- 我们开发了一个多粒度的联合监督框架和一个可扩展的训练范例。GLEE的统一方法支持多源数据,并能够对来自不同监督级别的各种基准的500多万张图像进行联合训练。这大大方便了额外的手动或自动注释数据的合并,并简化了数据集的缩放。

- GLEE在对象级图像和视频任务的范围内展示了卓越的通用性和强大的zero-shot可传输性。此外,GLEE可以提供现代LLM目前缺乏的可视化对象级信息,从而作为增强其他架构或模型的基础组件。

本文方案

如图所示,所提GLEE包括一个图像编码器,一个文本编码器,一个视觉解码器,和一个对象解码器。文本编码器处理与任务相关的任意描述,包括对象类别、任何形式的名称、关于对象的标题和引用表达式。视觉识别器在交互式分割期间将诸如点、边界框或涂鸦的用户输入编码成目标对象的对应视觉表示。然后,它们被集成到一个检测器中,用于根据文本和视觉输入从图像中提取对象。

关于方案的详细介绍建议感兴趣的同学查看原文。AIWalker后台回复【GLEE】即可下载原文与译文,快快学习呀。

本文实验

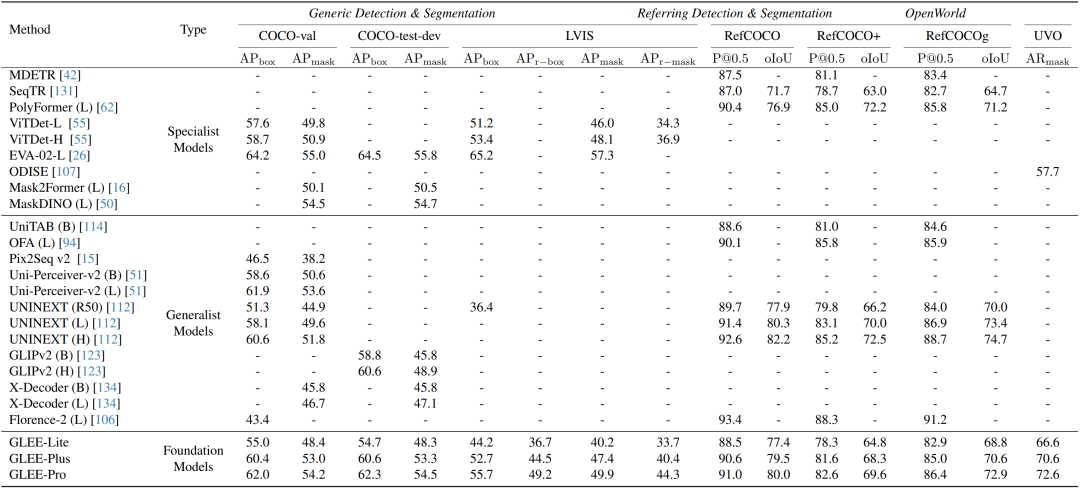

如上表所示:我们的模型在COCO和LVIS基准上都优于所有通才模型。即使与其他最先进的spec-cialist方法相比,我们的模型仍然具有很强的竞争力。这表明,GLEE同时掌握普遍和一般的对象表示,同时保持先进的能力, 这种特性对于适应需要精确目标定位的广泛下游任务至关重要。对于REC和RES任务,我们在Ref-COCO [120],RefCOCO+ [120]和RefCOCOg [72]上评估了我们的模型,如表1所示,GLEE实现了与SOTA专业方法PolyFormer [62]相当的结果,展示了强大的理解文本描述的能力,并展示了适应更广泛的多模态下游任务的潜力。在开放世界实例分割任务中,我们将“对象”视为类别名称,指示模型以类不可知的方式识别图像中所有可能的实例。GLEE比之前的ODISE [107]高出8.9分,证明了识别开放世界场景中可能存在的所有合理实例的能力。GLEE模型作为对象级视觉基础模型的通用性和有效性,直接适用于各种以对象为中心的任务,同时确保最先进的性能,而不需要微调。

zero-shot

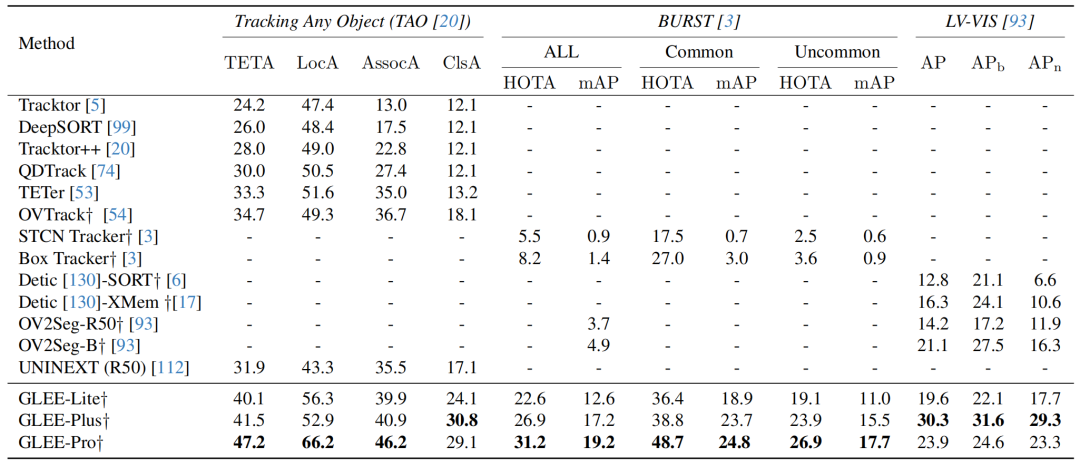

如上表所示:GLEE超过先前最佳方法OVTrack 36.0%,在BURST中几乎是最佳基线性能的三倍,在LV-VIS中超过OV 2Seg43.6%。这种出色的性能有力地验证了GLEE在处理一系列基准测试和任务的对象级任务时的卓越泛化和zero-shot能力

Ablation

-

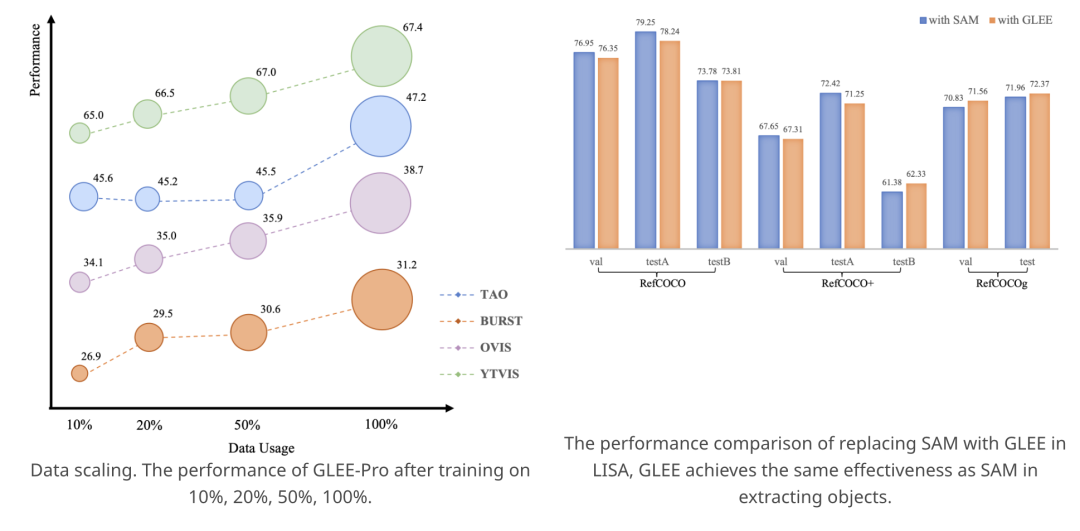

数据规模 使用10%、20%、50%、100%的训练数据训练GLEE-Pro,以评估zero-shot转移任务的性能,包括TAO、BURST、OVIS和YTVIS。增加训练数据集的大小可增强不同下游任务的零触发性能。

-

用作基础模型 我们用一个冻结的、预训练的GLEE-Plus代替丽莎视觉中枢,并将来自GLEE的对象查询馈送到LLAVA中,并去除LISA的解码器。我们直接将输出的SEG令牌与GLEE特征映射进行点积来生成掩码。经过同样数量的训练,改进后的LISA-GLEE获得了与原始版本相当的结果,证明了GLEE表示的多功能性及其在服务于其他模型中的有效性。

效果展示

对于图像级交互式分割,GLEE支持将点、框或涂鸦作为视觉提示发送到模型,从而实现指定对象的直接分割。在视频对象分割的情况下,使用来自第一帧的掩蔽特征作为提示引用特征允许在视频的后续帧中分割对应的对象。

小结

我们介绍了一个先进的对象级基础模型GLEE,旨在直接适用于广泛的对象级图像和视频任务。GLEE采用统一的学习范式,从不同监督级别的不同数据源中学习;GLEE在许多对象级任务上实现了最先进的性能,并在zero-shot泛化到新数据和任务方面表现出色,显示出其卓越的通用性和泛化能力。此外,GLEE提供了一般的视觉对象级信息,这是目前在现代LLM中缺失的,为以对象为中心的mLLM奠定了坚实的基础。

论文/代码下载

AIWalker后台回复【GLEE】即可下载原文与译文,必卷之!

扫描下方二维码,或加微信:AICVerX2,添加「小二」微信,第一时间获取底层视觉与基础AI相关论文,请备注研究方向+学校/公司+昵称。

▲扫码或加微信号: AICVerX2,获取最新底层视觉论文

▲点击上方卡片,关注AIWalker公众号

整理不易,请点赞和在看

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง