点击下方卡片,关注「集智书童」公众号

尽管神经网络在各种应用中取得了显著的进展,但它们需要大量的计算和内存资源。网络量化是一种强大的技术,可以压缩神经网络,从而实现更高效和可扩展的AI部署。

最近,重参化作为一种有前景的技术,在同时减轻各种计算机视觉任务中的计算负担的同时,提高了模型性能。然而,在应用量化时,重参化网络的准确性会显著下降。作者发现,这个问题主要源于原始分支中权重分布的巨大变化。

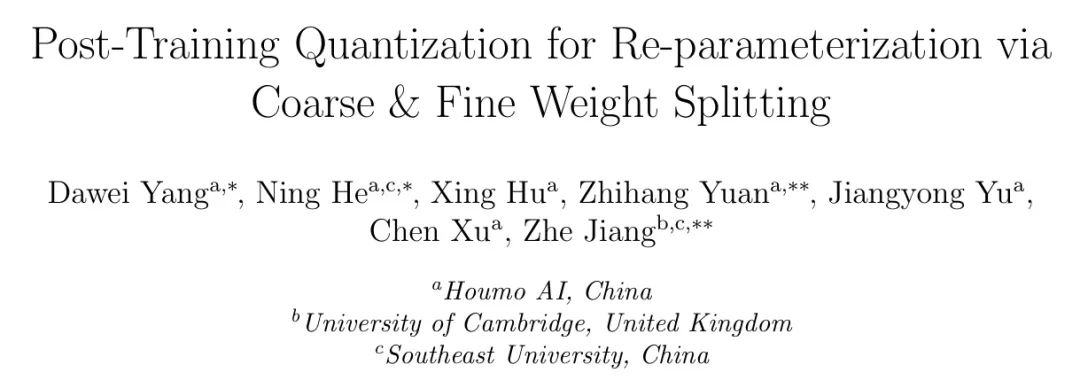

为了解决这个问题,作者提出了一种粗粒度与细粒度权重划分(CFWS)方法来减少权重的量化误差,并开发了一种改进的KL指标来确定激活的最优量化尺度。

据作者所知,作者的方法是首个能使后训练量化适用于重参化网络的工作。例如,量化的RepVGG-A1模型仅损失了0.3%的准确性。

代码位于https://github.com/NeonHo/Coarse-Fine-Weight-Split.git。

1 Introduction

尽管卷积神经网络(CNNs)在各种应用中展示了主导性能,但仍需要在边缘设备和云服务器上高效运行。神经网络量化是压缩神经网络中最广泛使用的技术之一。它涉及将网络参数和激活的精度降低,通常从浮点数(例如,FP32)减少到具有较低位数的整数(例如,INT8)。由于整数计算,它大大降低了内存成本(例如,INT8节省了75%的模型大小和带宽)并加速了矩阵乘法(例如,卷积,全连接)。网络量化通常分为两类:后训练量化(PTQ)和量化感知训练(QAT)。PTQ使用已经训练好的网络并对其进行量化,因此它需要最小化的超参数调整和无需端到端训练。

相比之下,QAT在模型训练或重新训练过程中进行模拟量化。因此,它通常需要大量的计算资源和更多的训练(例如,超参数调整),导致部署过程复杂。此外,在部署神经网络时,由于隐私问题或数据安全,访问训练资源(例如,训练数据,训练代码)可能会受到限制或限制。因此,在本论文中,作者的重点是特别关注将PTQ应用于重参化网络。

最近,重参化作为一种有前途的技术已经广泛应用于各种任务。它涉及用块线性层替换每个线性层,如全连接和卷积。这种块只在训练时使用,最终将在推理时将其合并为单个线性层。一方面,重参化利用了它们在训练时多分支结构的出色性能。另一方面,转换为单分支结构利用了它们的高并行性和减少的内存占用,从而提高了推理效率。例如,RepVGG在ImageNet上达到超过80%的Top-1准确率,比ResNet-50快83%,且准确率更高。众所周知,ResNet的残差路径需要实时内存保留,这对资源受限的边缘设备具有挑战性。

然而,在重参化网络上直接应用量化方法会导致准确性显著下降。例如,RepVGG-A1在端部署模式下的量化后的准确性从74.5%下降到61.7%。量化重参化模型的准确性下降也阻碍了它们的实际应用。值得一提的是,由于重参化网络在部署模式下没有BN层,因此通过QAT提高量化准确性也具有困难。

截至作者目前的知识,只有两篇论文探索了重参化网络的量化。然而,尽管它们具有新颖性,但两种方法都需要修改原始的重参化结构。具体而言,将BN层移出rep-block;[14]则删除了重参化结构,而将其替换为优化器中的重参化。虽然转换为单分支结构保持了相同的推理时间结构,但训练过程变得非常复杂,需要额外的训练 Pipeline 时间、步骤和调整。此外,两种方法都需要从头训练修改后的模型,这是一个显著的限制。

相比之下,作者的目标是确保模型研究和模型部署保持独立:一方面,允许研究行人专注于改进浮点模型结构而不受量化过程的限制;另一方面,简化部署过程。第二点至关重要,因为在缺乏数据集可用性(例如,当模型由供应商提供或数据集保密时)的场景下,快速部署的需求或训练成本限制可能不总是实际可行的。

为了在重参化网络上实现端到端量化,而不显著降低准确性,作者研究了这项任务,以确定主要挑战。作者发现,量化困难源于原始分支中权重分布的巨大变化,导致融合核的参数分布不利。

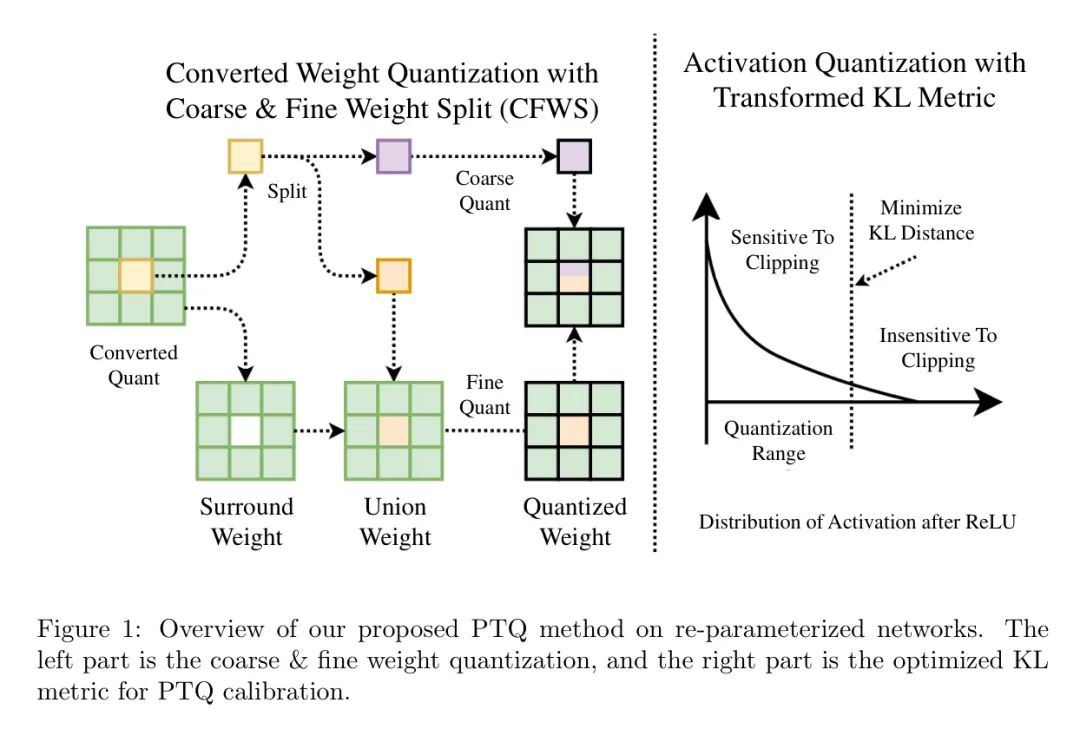

如图2所示,不同分支上的权重分布存在显著差异,导致转换后的权重范围更广。例如,在12nd卷积分支中,3×3卷积、1×1卷积和身份分支的取值范围分别为[-0.8, 0.8]、[-1.2, 1.8]和[-0.2, 2.8];转换后,最终范围扩展到[-1.2, 2.8]。观察发现,值主要集中在0附近,而远离0的值也具有重要意义(主要来自1×1和身份分支)。这种围绕0的密集值和远离0的值组合为量化带来了一个具有挑战性的场景。

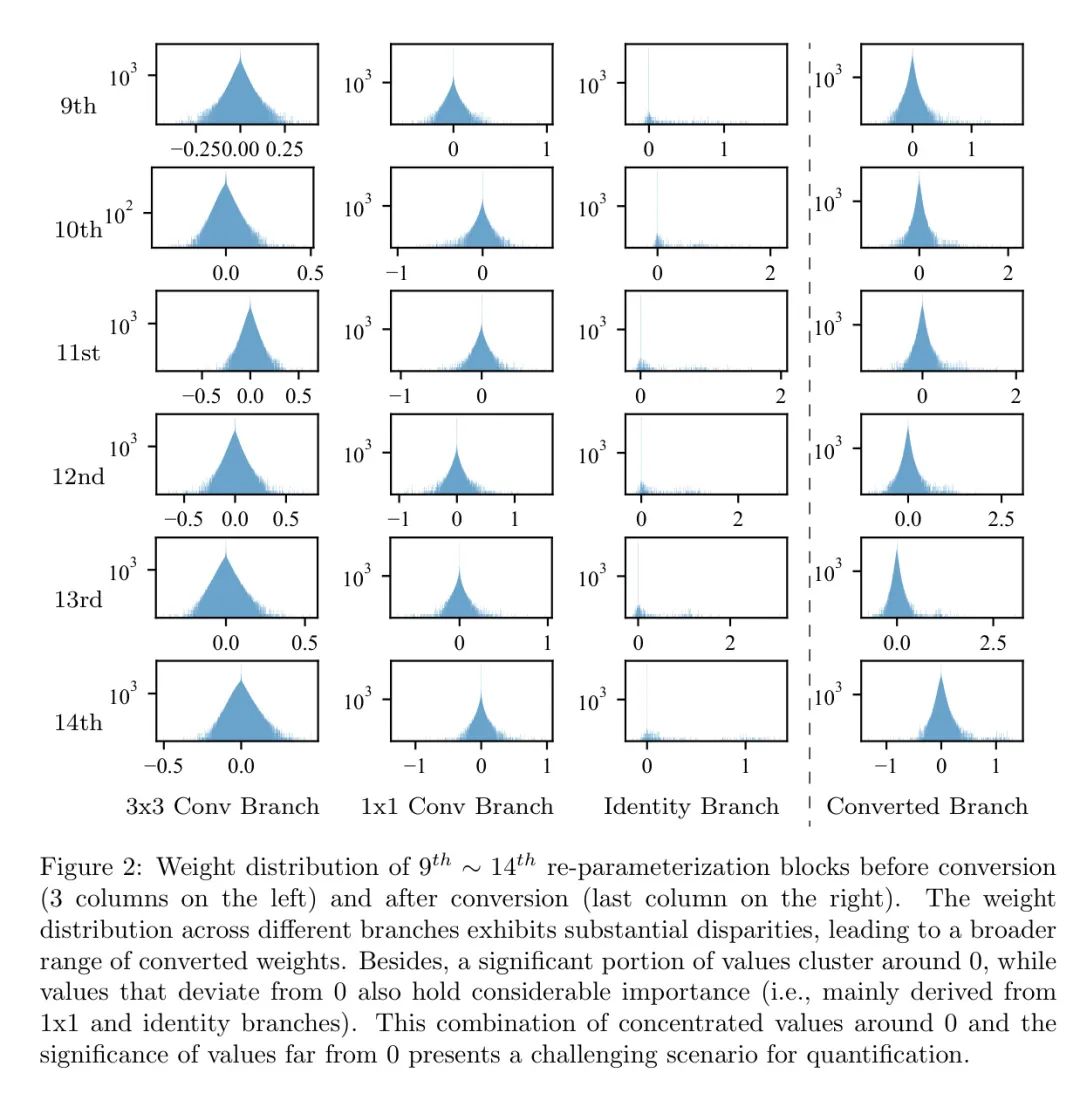

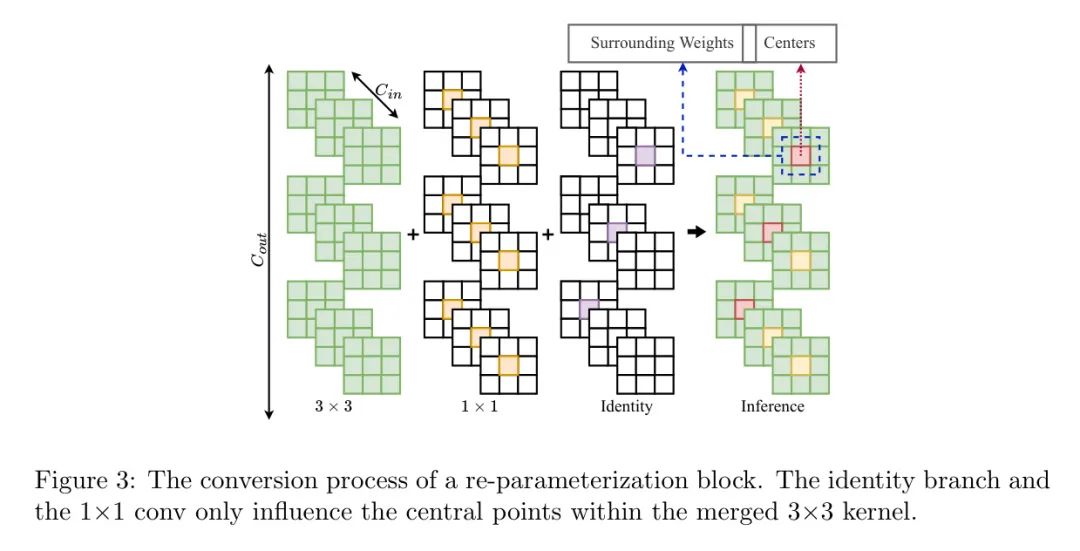

作者进一步研究了基于转换过程的问题(如图3所示),其中身份分支和1×1卷积的权重只影响合并的3×3核的中心点。具体而言,转换后核的中心点具有广泛的值范围,而周围的权重(即3×3矩阵中的8个非中心点)具有较小的范围(有关详细信息,请参阅图4)。

[14]还指出,核的中心点与周围点的标准差较高。因此,作者的重点应放在适当量化转换核的中心点。作者提出了一种粗粒度与细粒度权重划分(CFWS)方法,分别对中心权重和周围权重进行量化。在激活量化方面,作者注意到许多大激活值对截断不敏感。这一观察促使作者提出一种基于KL散度的校准度量方法。

改进的度量方法能够适当截断大激活值,从而有效地减轻量化误差。作者在各种为不同任务设计的重新参数化网络上评估作者提出的端到端量化(PTQ)方法。结果表明,作者的方法不仅对于图像分类有效,而且对于目标检测任务也表现出良好的泛化能力。

作者的贡献如下:

-

提出了一种新颖的端到端量化(PTQ)方法,适用于重参化网络,且不需要修改网络结构或重新训练。作者的方法有效地弥合了重参化技术和PTQ实际部署之间的差距。

-

分析了基于重参化架构的量化性能退化的根本原因,并提出了一个新颖的技术称为粗粒度与细粒度权重划分(CFWS)。这种方法使得中心权重和周围权重可以单独量化,有效地解决了这个问题。

-

开发了一种改进的KL指标,可以平滑地处理大激活值的正确截断。作者的整体方法在各种视觉任务上表现良好,实现了具有竞争力的量化精度,同时保留了快速PTQ部署的优势。

2 Background and Related Work

Quantization

神经网络量化是深度学习中用于降低神经网络内存和计算需求的技术。它涉及使用比标准浮点表示更少的比特来表示神经网络的权重和激活。通常,深度神经网络将权重和激活存储为32位浮点数,但使用低精度表示可以显著减少内存使用并提高计算效率。例如,将32位浮点数(FP32)替换为8位整数(INT8)可以导致模型大小和带宽分别减少75%,并由于整数计算加速矩阵乘法(例如,卷积,全连接)。

神经网络量化可分为两大主要方法:后训练量化(PTQ)和量化感知训练(QAT)。PTQ涉及使用最小或没有数据的预训练网络进行量化,需要最小超参数调整和无需端到端训练。另一方面,QAT在模型训练或重新训练过程中模拟量化。QAT通常需要大量的计算资源和更多的训练工作,例如超参数调整,导致复杂的部署过程。

此外,部署神经网络可能会受到隐私或数据安全问题的限制,无法访问训练数据。由于QAT涉及修改训练代码并涉及额外成本,只有在训练资源和代码和数据可用且PTQ无法产生令人满意结果时才会使用QAT。在本论文中,作者特别关注将PTQ应用于重参化网络。

Re-parameterization

重参化不是一个新的概念,可以追溯到批量归一化和残差连接。Ding等人最近的一项贡献引入了RepVGG网络架构,该架构利用结构重参化。自那时以来,重参化已经显示出前景,并在各种任务中广泛采用。基本上,它涉及用一个块替换每个线性层,如全连接和卷积。这种块只在训练时使用,最终将在推理时将其合并为一个线性层。转换后的网络在训练时的预测准确性与网络相同。

重参化具有几个优点。首先,它利用了多分支架构的优越性能和更快的收敛速度。其次,转换为单分支结构利用了高并行性和减少的内存占用,从而提高了推理效率。例如,RepVGG在ImageNet上达到了超过80%的Top-1准确率,比ResNet-50快83%,比ResNet-101快101%。

众所周知,ResNet的残差路径需要实时内存保留,这对资源受限的边缘设备具有挑战性。尽管重参化在准确性和速度方面都提供了明显的优势,但量化重参化模型的准确性下降会阻碍它们的实际应用。

Exploration on Quantizing Re-parametrization Networks

基于重参化架构的神经网络在量化方面存在挑战,因为它们固有的多分支设计导致了增加的动态数值范围。目前,只有两篇论文探讨了重参化网络的量化。Ding等人提出了梯度重参化(GR)方案,该方案通过将先验知识集成到网络特定的优化器RepOptimizer中,用重参化替换重参化。Chu等人[15]重新设计了RepVGG,将其设计为QARepVGG,该网络生成权重和激活分布,这些分布是针对量化的优化。然而,这两种方法都需要对原始重参化结构进行修改。

具体而言,[15]将BN层移出rep-block,而[14]则删除了重参化结构,并将其集成到优化器中。尽管转换为单分支结构保持了相同的推理时间结构,但训练过程变得非常复杂,需要额外的训练时间、步骤和调整训练 Pipeline 。相比之下,作者的方法保持了模型研究和端到端量化部署的独立性。

3 Method

量化函数是将浮点向量 转换为定点值 。对称均匀量化 是最常见的方法[1],其形式为:

其中 是量化的比特数(通常,), 是一个称为量化参数的量化因子。 的反量化表示为 。量化误差 通常有两个来源:来自舍入函数的误差称为舍入误差,而来自截断函数的误差称为截断误差。超出量化范围值被称为异常值,将被截断。

在对神经网络进行量化时,与浮点网络的接近程度是评估量化方法有效性的主要标准。一般的量化目标是:

其中 是一个目标函数,如均方误差(MSE)。作者的目标是找到适当的 和 值,以最大化量化网络的性能,同时不承担额外的再训练成本。

在以下子节中,作者首先分析基于重参化架构的量化性能退化的根本原因,然后介绍作者在重参化网络中进行权值和激活值量化的端到端量化(PTQ)方法。

Coarse & Fine Weight Splitting

为了便于理解,作者在图2中可视化了RepVGG块在转换前后的权重分布。不同分支上的权重分布存在显著差异,导致转换后的权重范围更广。例如,在12nd卷积分支中,3×3卷积、1×1卷积和身份分支的取值范围分别为[-0.8, 0.8]、[-1.2, 1.8]和[-0.2, 2.8];转换后,最终范围扩展到[-1.2, 2.8]。观察后可以发现,值主要集中在0附近,而远离0的值也具有重要意义(主要来自1×1和身份分支)。这种围绕0的密集值和远离0的值组合为量化带来了一个具有挑战性的场景。[19]表明,遵循均匀分布的权重更耐量化。

在作者的情况下,直接应用像MinMax这样的PTQ方法可能导致过宽的量化范围。这宽的量化范围可能导致在量化过程中,集中在较小部分的重量损失很大,从而阻碍卷积层保留其原始的特征提取能力。

作者进一步研究了基于转换过程的问题(如图3所示),其中身份分支和1×1卷积的权重只影响合并的3×3核的中心点。具体而言,转换后核的中心点具有广泛的值范围,而周围的权重(即3×3矩阵中的8个非中心点)具有较小的范围。

作者发现,转换后卷积权重范围较广的主要原因是中心点周围的分布。14也表明,核的中心点与周围点的标准差较高。然后作者分析了权重对截断的敏感性。

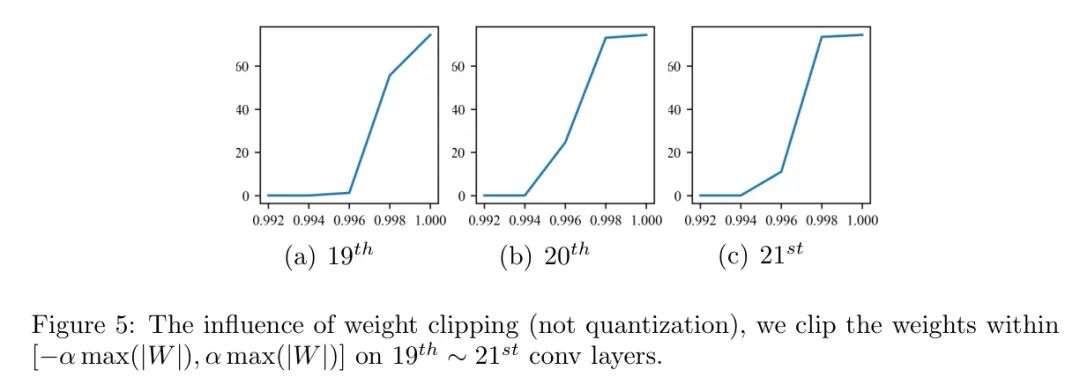

如图5所示,对转换后的权重进行略微截断会导致预测准确率大幅下降。上述分析为作者寻求更好的量化技术提供了动机,以对中心权重进行更好的量化。

为了解决这个问题,作者提出了一种粗粒度与细粒度权重划分(CFWS)方法,分别对中心权重和周围权重进行量化。给定转换后的卷积权重 ,其中 和 分别表示输出和输入通道的数量,整个过程可以看作:

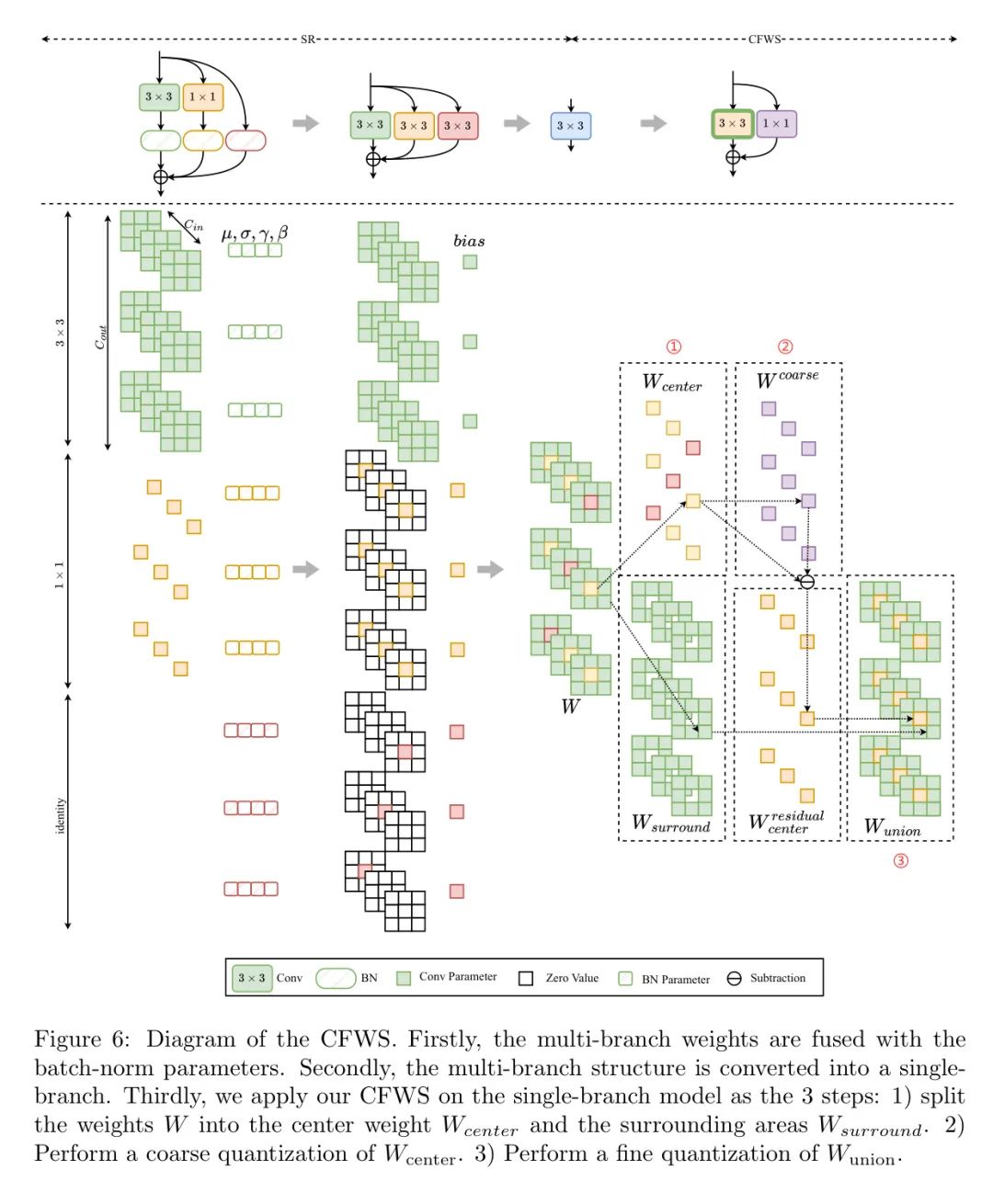

如图6所示,作者的CFWS主要包含以下三个步骤:

1. 划分权重。 首先,作者将权重划分为两个类别:(a)中心权重 ; (b)非中心权重 ,其中中心点为空。

2. 对中心权重 进行粗粒度量化。 第二步,作者对中心权重 进行粗粒度量化:

其中,粗粒度量化的标度因子 通过标准的Min-Max校准计算:

由于这一步涉及粗粒度量化 ,因此有必要补偿残差:

3. 对 进行精细量化。 从全局角度来看,第二步可以看作是对 的粗粒度量化。换句话说,作者现在有 以及所有剩余权重 。因此,最后一步是在 上应用精细量化:

其中,精细量化的标度因子 也是通过:

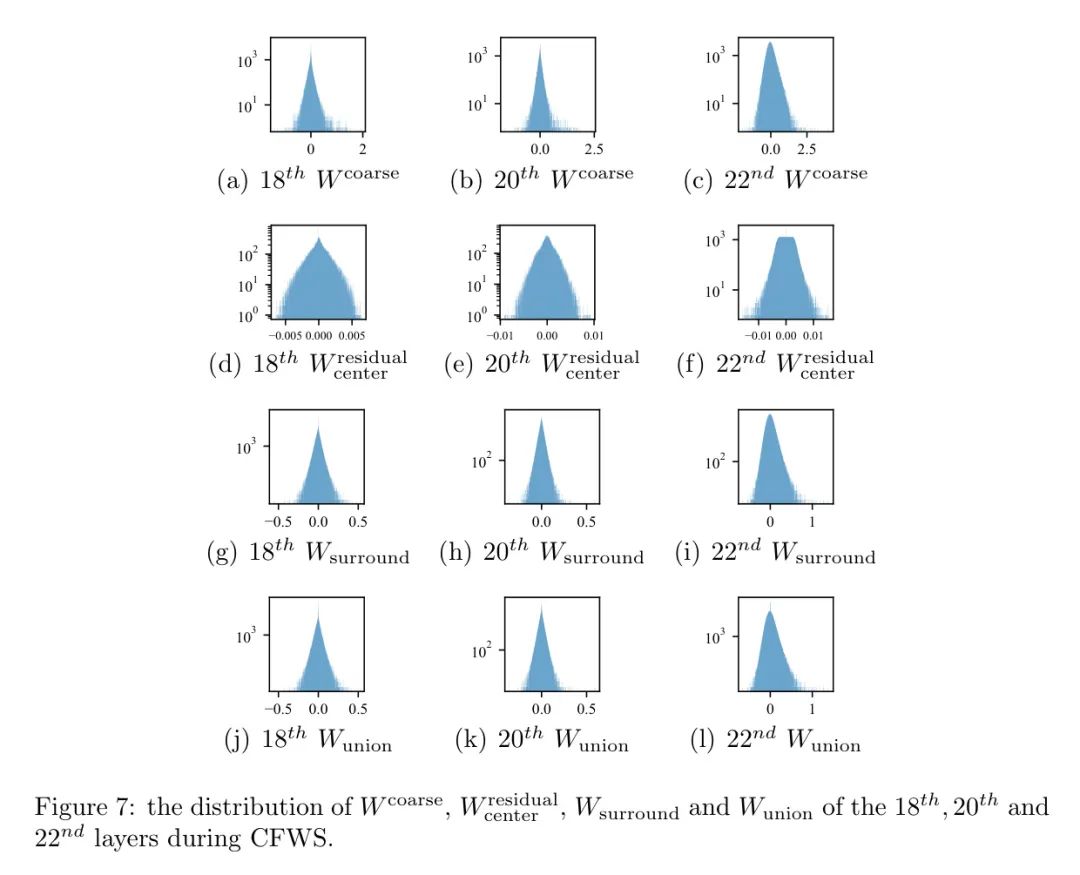

作者在图7中展示了 的分布,并观察到两个事实:(1) 和 的范围之间存在相当大的差异;(2)大多数值集中在接近零的狭窄范围内,只有少数几个值是异常值。通过使用作者提出的 CFWS, 和 的量化误差显著减小。

对于 ,粗粒度量化误差通过随后的精细量化得到补偿。至于 ,其量化范围被调整以减小 中大值的负面影响。

为了评估作者提出的 CFWS 的效率,而无需依赖特定目标平台,作者采用位操作(BOPs)[21; 22; 23] 作为一种代理指标。BOPs 的定义如下:

其中, 表示网络中执行的操作, 表示与操作 相关的权重和激活的比特数, 表示操作 的总乘加(MAC)操作数量。

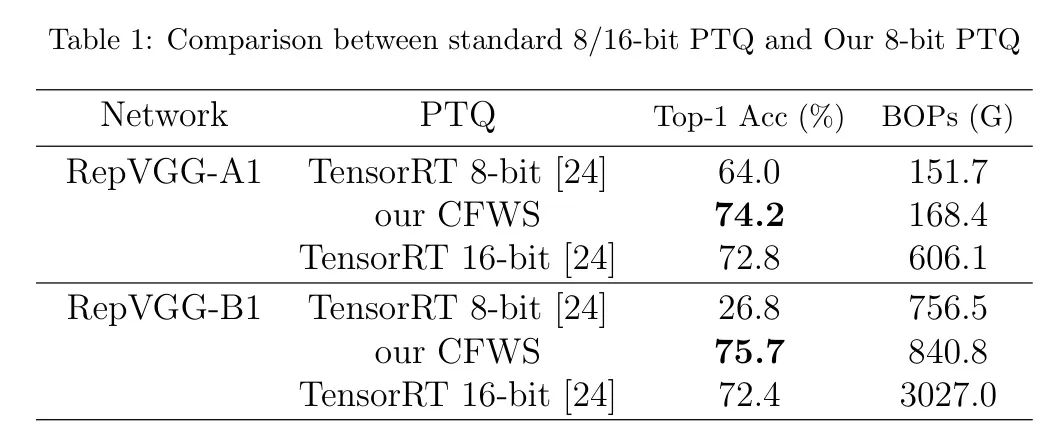

在表1中,值得注意的是,与 INT8 量化相比,作者的方法在准确率方面取得了显著改进,而比特操作(BOPs)的增加非常小。此外,与 INT16 量化相比,作者的方法不仅实现了更高的准确率,而且需要的 BOPs 数量也显著较少。

Quantization Metric for Activation

在分析激活分布时,作者引入了一种方法来分析激活截断的影响。作者手动设置每个卷积层的激活值截断范围,并观察在改变截断范围的情况下,网络在ImageNet验证集上的准确率变化,以了解不同值的激活的重要性。这使作者能够理解具有不同值的激活的重要性。实现如下:

将一批输入样本输入到网络中,并收集每个层的激活值 。

计算 的最大绝对值 。

将 限制在 的范围内。在这个范围内保留数据,而超出范围的部分被截断为 。

逐步减小 ,使范围缩小。在每个步骤中,收集网络的预测准确性。

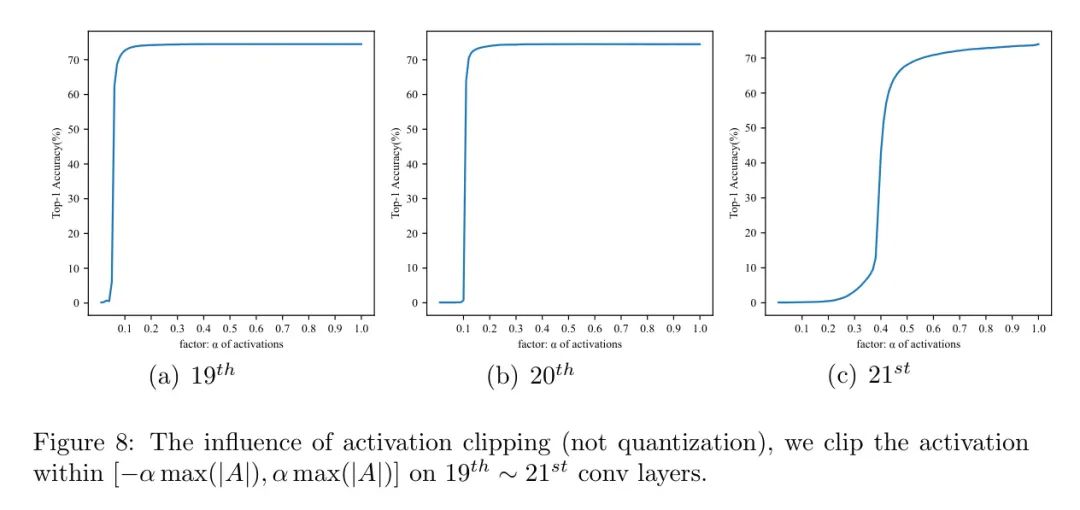

作者可以在图8中看到网络的 – 准确性曲线。作者可以发现,激活值分布中的大值不会影响网络的整体准确性,甚至在适当截断后可以提高。换句话说,在激活值中存在大量对截断不敏感的离群值。如果采用适当的截断方法,作者可以保留关键信息并删除离群值。这种截断将使量化的范围变窄,从而减少量化误差。

根据这个观察,Min-Max量化不适合激活的量化。为了减少量化范围,作者使用一个度量 来评估在量化和去量化前后张量的距离,该度量公式如下:

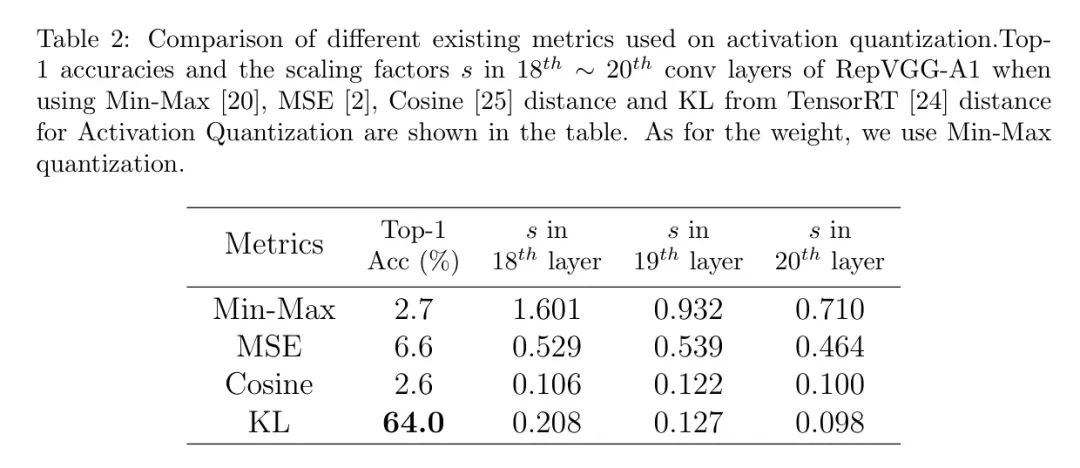

评价两个张量的距离有许多不同的度量方法,如均方误差(MSE)、余弦距离和KL距离。以前基于重参化网络的端到端量化方法使用MSE作为度量来量化激活。然而,作者发现MSE度量不是最优的。根据上述分析,在激活的分布中,有许多大值对截断不敏感。

然而,截断这些大值将导致在量化和去量化前后激活之间存在大的MSE。因此,使用MSE度量得到的量化范围不是最优的。作者探索不同的度量方法,并展示了表2的结果。作者观察到KL度量优于其他度量。

原始的KL度量是在TensorRT中提出的。然而,作者观察到在计算KL-divergence时存在一个数值问题,该问题如下所示:

其中, 是全精度激活的分布, 是量化激活的分布, 是量化范围。由于分布值表示为浮点数,因此在计算时存在数值问题。有时结果将具有显著的误差,使量化校准不准确。为了减轻这个问题,作者提出了一种变换计算方法:

如图3所示,变换计算实现了更好的量化结果。

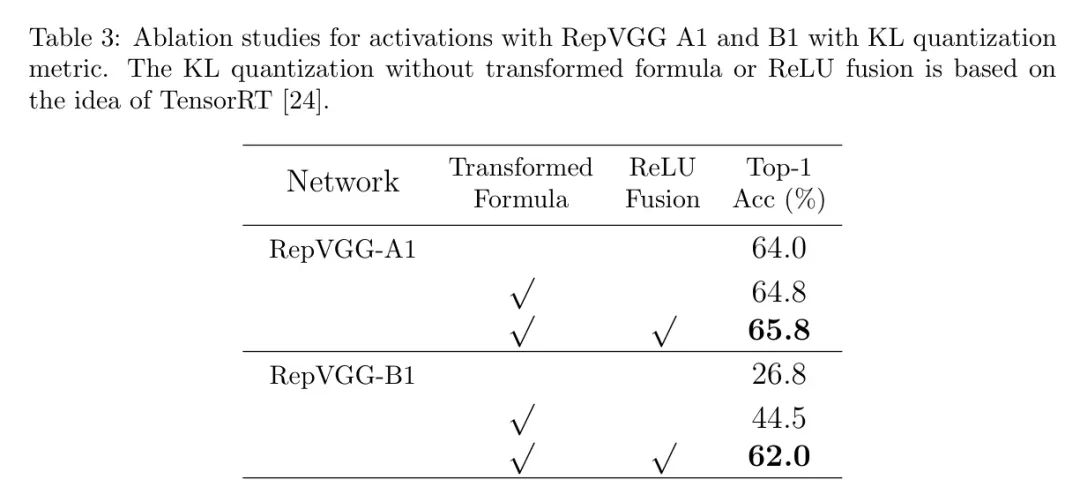

通常在卷积层之后会融合ReLU,这意味着卷积层产生的激活的负部分会被截断。作者发现,使用ReLU之后的分布来计算KL指标更好。表3显示了使用变换和ReLU融合进行基于KL的量化的结果。

4 Experimental Evaluation

为了评估所提出的方法,作者将实验应用于不同的重参化网络。接下来,作者将介绍实验设置。然后,作者将分别在分类和目标检测网络上展示结果。最后,作者将展示作者的消融研究。

Settings

作者在NVIDIA RTX3090上进行了实验。在量化校准期间,只使用了32个无标签校准样本。

作者在RepVGG网络上进行了实验,包括RepVGG-A0、RepVGG-A1和RepVGG-B1,用于ImageNet分类任务。RepVGG网络的输入是RGB图像,分辨率为224×224。作者还实验了用于目标检测任务的重参化网络,包括YOLOv6t和YOLOv6s。YOLOv6网络的输入是RGB图像,分辨率为640×640。作者使用32个无标签校准图像来量化网络。

作者将提出的量化方法与其他基于重参化模型的量化方法进行了比较,包括原始端到端量化(PTQ)与KL指标,RepOpt和QARepVGG。这些工作的结果来自原始论文。

ImageNet Classification

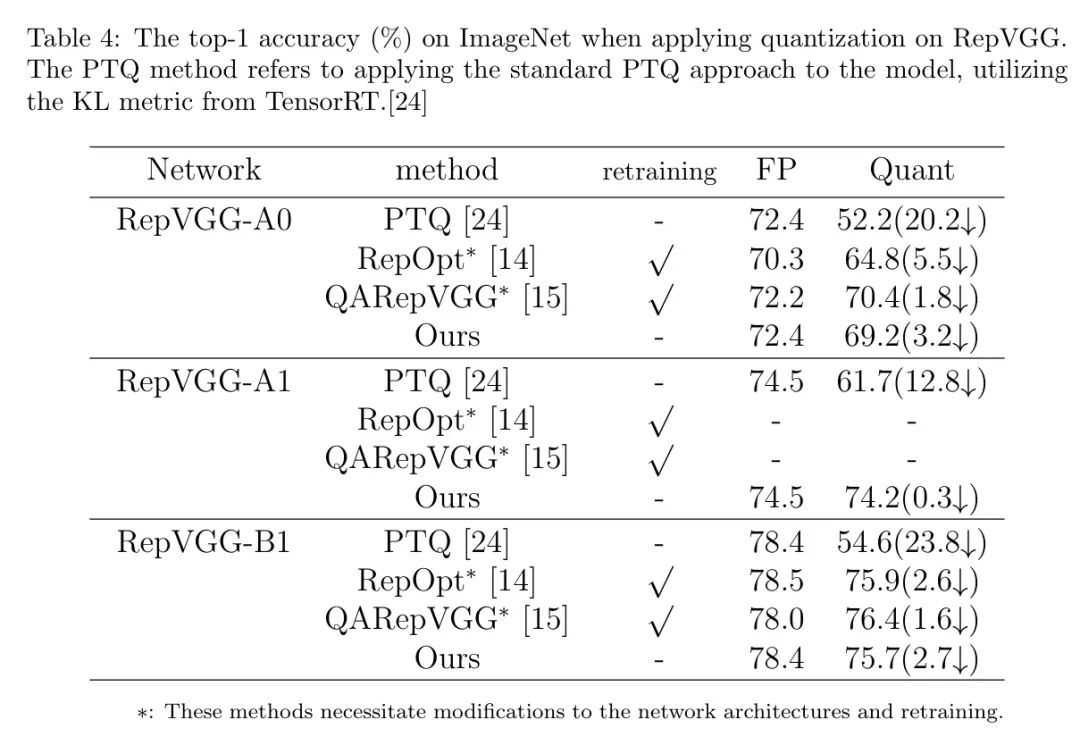

作者在ImageNet测试数据集上展示了全精度网络(FP)和量化网络(Quant)的Top-1精度,结果如表4所示。

由于作者使用了原始的RepVGG网络,没有重新训练,因此FP结果与原始结果相同。RepOpt-VGG和QARepVGG重新训练了网络,导致FP结果降低。对于量化网络,原始端到端量化(PTQ)方法的精度显著下降,这在部署中是不可接受的。得益于重新训练,RepOpt-VGG和QARepVGG在量化后的结果比原始结果更高。量化后的精度下降程度可以用于公平比较。

这种比较表明,作者的方法也实现了量化网络的显著改进,与基于训练的量化方法具有可比性。例如,作者在RepVGG-A0上实现了69.2%的Top-1精度,这比原始端到端量化(PTQ)的52.2%要好,略高于RepOpt-VGG的64.8%,但略低于QARepVGG的70.4%。

COCO Object Detection

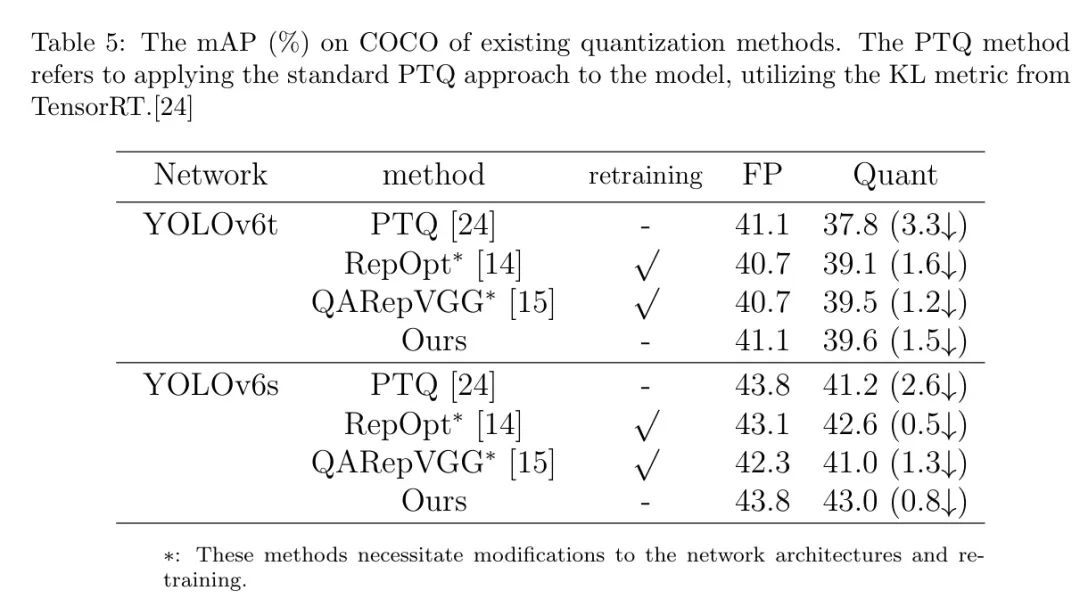

同样,在COCO目标检测测试数据集上,YOLOv6及其RepOptimizer方法和QARepVGG方法的大部分mAPs来自[15]。此外,YOLOv6s及其RepOptimizer方法的性能由美图官方提供。

表5中的实验表明,作者的方法在大目标检测重参化网络上具有泛化能力。例如,作者在YOLOv6s上实现了43.0%的mAP,与原始端到端量化(PTQ)的41.2%相比下降了0.8%,远超过了原始端到端量化(PTQ)的2.6%。作者还注意到,QARepVGG对于所有网络的性能都不是最优的,下降了1.3%。

Ablation Studies

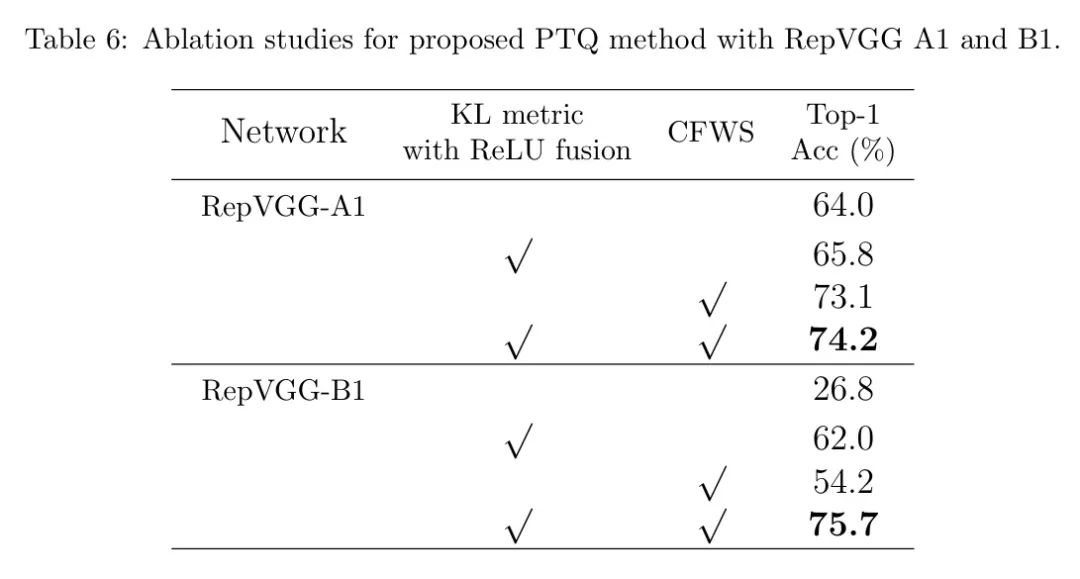

作者对所提出的算法进行了消融研究,结果如表6所示。

作者观察到,使用变换的KL度量指标与ReLU融合以及CFWS都可以实现显著的改进。例如,在将KL指标用于剪枝RepVGG-B1的激活分布后,Top-1精度提高到62.0%。在执行CFWS后,对权重分布进行量化,预测精度提高到54.2%。然后,作者进一步改进了使用两个所提出方法量化的重参化基础网络的性能(75.7%)。

5 Conclusion

本文提出了一种新颖的方法,用于重参化网络的后训练量化(PTQ)。作者提出了一种粗粒度与细粒度权重划分(CFWS)方法,以减少权重分布的量化误差。

参考

[1]. Post-Training Quantization for Re-parameterization via Coarse & Fine Weight Splitting

扫码加入👉「集智书童」交流群

(备注:方向+学校/公司+昵称)

想要了解更多:

想要了解更多:

前沿AI视觉感知全栈知识👉「分类、检测、分割、关键点、车道线检测、3D视觉(分割、检测)、多模态、目标跟踪、NerF」

行业技术方案👉「AI安防、AI医疗、AI自动驾驶」AI模型部署落地实战👉「CUDA、TensorRT、NCNN、OpenVINO、MNN、ONNXRuntime以及地平线框架」

欢迎扫描上方二维码,加入「集智书童-知识星球」,日常分享论文、学习笔记、问题解决方案、部署方案以及全栈式答疑,期待交流!

免责声明凡本公众号注明“来源:XXX(非集智书童)”的作品,均转载自其它媒体,版权归原作者所有,如有侵权请联系我们删除,谢谢。

点击下方“阅读原文”,了解更多AI学习路上的「武功秘籍」

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง