报告日期:1月5日(周五)14:30-15:30

主题简介:

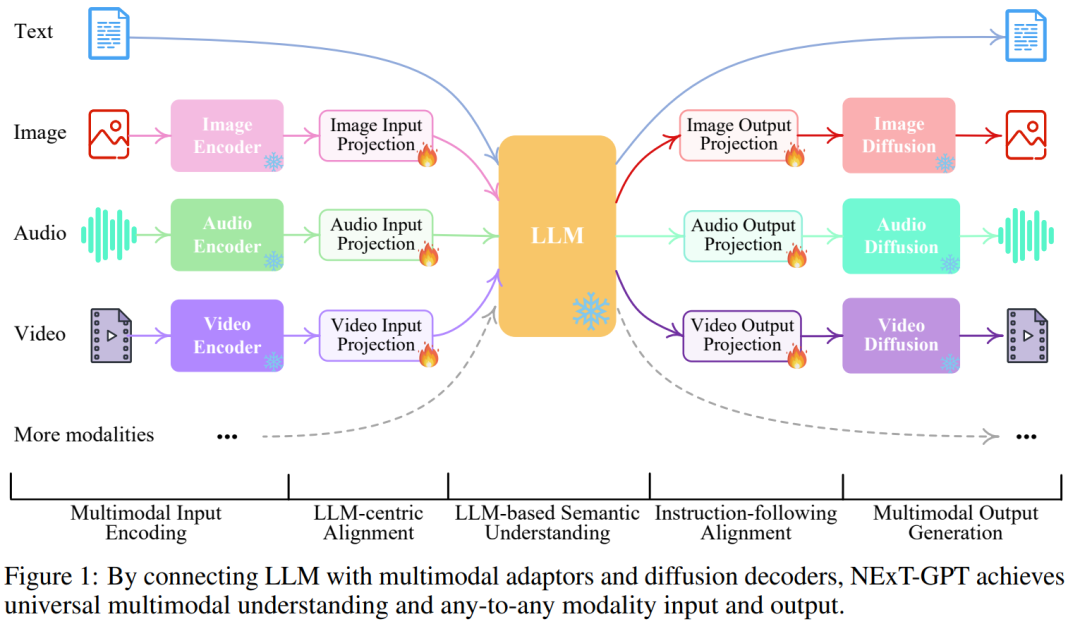

近来,多模态大语言模型已经取得了令人振奋的成果。然而,现有多模态大语言模型仍主要集中在对输入端进行多模态理解,而输出端仍受限于文本内容。相较之下,人类在沟通时具备理解和感知各种模态的能力,并能够以灵活的方式输出各类模态的回复。因此,构建能够接受和传递任何模态内容的系统,是实现类人水平的人工智能中至关重要的一步。为了实现这一目标,我们提出了一种端到端的通用的任意到任意多模态大语言模型系统,即NExT-GPT。

通过引入一个轻量级对齐网络,将一种大语言模型与多模态适配器和下游扩散解码器连接起来,使NExT-GPT能够感知文本、图像、视频和音频,并灵活地生成任意模态的输出。此外,我们提出基于模态切换的指令微调(Modality-switching Instruction-tuning, MosIT),并构建了一个高质量数据集。最终,实现复杂的跨模态语义理解和内容生成的能力。

主页地址: https://next-gpt.github.io

论文地址: https://arxiv.org/pdf/2309.05519

Code: https://github.com/NExT-GPT/NExT-GPT

报告嘉宾:

吴胜琼,新加坡国立大学的博士生,导师为Chua Tat-seng教授。研究方向为自然语言处理、多模态学习以及大模型。目前本人在自然语言处理、多模态学习以及机器学习等顶级会议上发表了多篇CCF A类论文,如NeurIPS, ACL, ACM MM, AAAI, IJCAI。荣获2022年湖北省网络安全学会优秀硕士毕业论文。在研究生期间也获得了多项国际、企业、校级奖励和荣誉,包括新加坡立大学校长奖学金、新加坡立大学研究成就奖、国家奖学金(中国)、华为奖学金、优秀硕士毕业生等。

扫描下方二维码

或点击「阅读原文」报名

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง