导读:本文整理自RL-China演讲分享实录,欢迎阅读交流。

目录:

- 前言

- 持续突破的自动出价决策技术

- 结语

- 小彩蛋:强化学习邀请赛

- 关于我们

- 参考文献

1. 前言

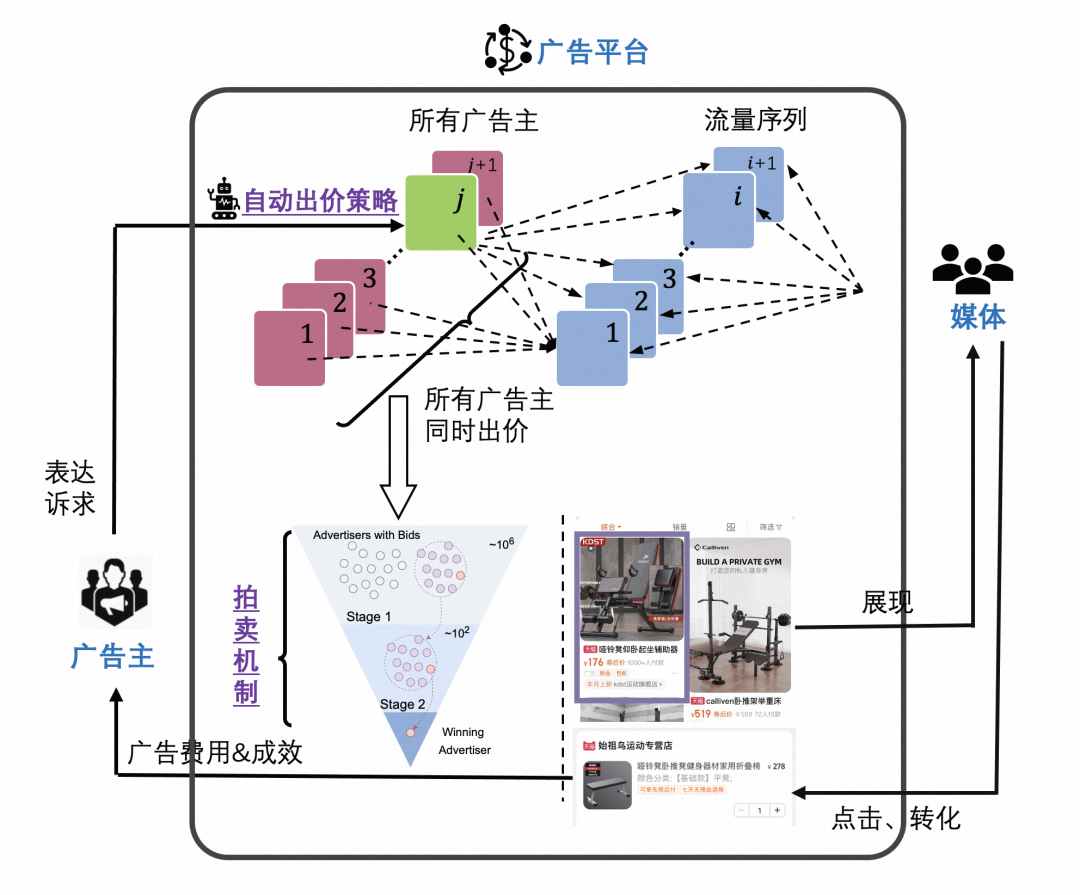

在线广告对于大多数同学来说是一个既熟悉又陌生的技术领域。「搜广推」、「搜推广」等各种组合耳熟能详,但广告和搜索推荐有本质区别:广告解决的是“媒体-广告平台-广告主”等多方优化问题,其中媒体在保证用户体验的前提下实现商业化收入,广告主的诉求是通过出价尽可能优化营销目标,广告平台则在满足这两方需求的基础上促进广告生态的长期繁荣。

广告智能决策技术在这之中起到了关键性的作用,如图1所示,它需要解决如下问题在内的一系列智能决策问题:1. 为广告主设计并实现自动出价策略,提升广告投放效果;2. 为媒体设计智能拍卖机制来保证广告生态系统的繁荣和健康。

图1:广告智能决策通过自动出价和拍卖机制等方式实现多方优化

图1:广告智能决策通过自动出价和拍卖机制等方式实现多方优化

随着智能化营销产品和机器学习的发展,阿里妈妈将深度学习和强化学习等AI技术越来越多地应用到广告智能决策领域,如RL-based Bidding(基于强化学习的出价)帮助广告主显著提升广告营销效果,Learning-based Auction Design(基于学习的拍卖机制设计)使得多方利益的统筹优化更加高效。我们追根溯源,结合技术浪潮发展的视角重新审视广告智能决策技术的演化过程,本文将以阿里妈妈广告智能决策技术的演进为例,分享我们工作和思考。也希望能以此来抛砖引玉,和大家一块探讨。

2. 持续突破的自动出价决策技术

广告平台吸引广告主持续投放的核心在于给他们带来更大的投放价值,典型的例子就是自动化的出价产品一经推出便深受广告主的喜爱并持续的投入预算。在电商场景下,我们不断地探索流量的多元化价值,设计更能贴近营销本质的自动出价产品,广告主只需要简单的设置就能清晰的表达营销诉求。

图2:出价产品逐步的智能化&自动化,广告主只需要简单的设置即可清晰的表达出营销诉求

图2:出价产品逐步的智能化&自动化,广告主只需要简单的设置即可清晰的表达出营销诉求

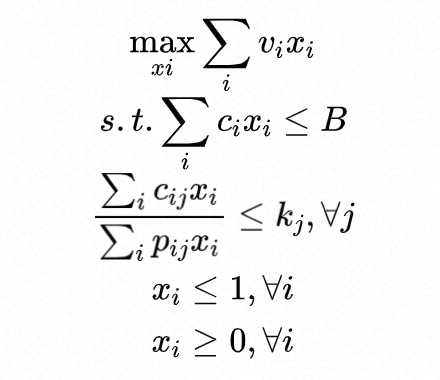

极简产品背后则是强大的自动出价策略支撑,其基于海量数据自动学习好的广告投放模式,以提升给定流量价值下的优化能力。考虑到广告优化目标、预算和成本约束,自动出价可以统一表示为带约束的竞价优化问题。

其中为广告主的预算,为成本约束,该问题就是要对所有参竞的流量进行报价,以最大化竞得流量上的价值总和。如果已经提前知道要参竞流量集合的全部信息,包括能够触达的每条流量的价值和成本等,那么可以通过线性规划(LP)方法来求得最优解 。然而在线广告环境的动态变化以及每天到访用户的随机性,竞争流量集合很难被准确的预测出来。因此常规方法并不完全适用,需要构建能够适应动态环境的自动出价算法。

对竞价环境做一定的假设(比如拍卖机制为单坑下的GSP,且流量竞得价格已知),通过拉格朗日变换构造最优出价公式,将原问题转化为最优出价参数的寻优问题[9]:

对于每一条到来的流量按照此公式进行出价,其中 为在线流量竞价时可获得的流量信息, 为要求解的参数。而参数并不能一成不变,需要根据环境的动态变化不断调整。参竞流量的分布会随时间发生变化,广告主也会根据自己的经营情况调整营销设置,前序的投放效果会影响到后续的投放策略。因此,出价参数的求解本质上是动态环境下的序列决策问题。

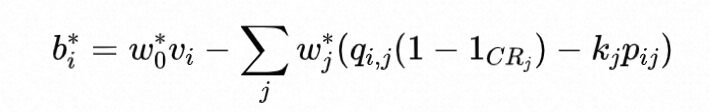

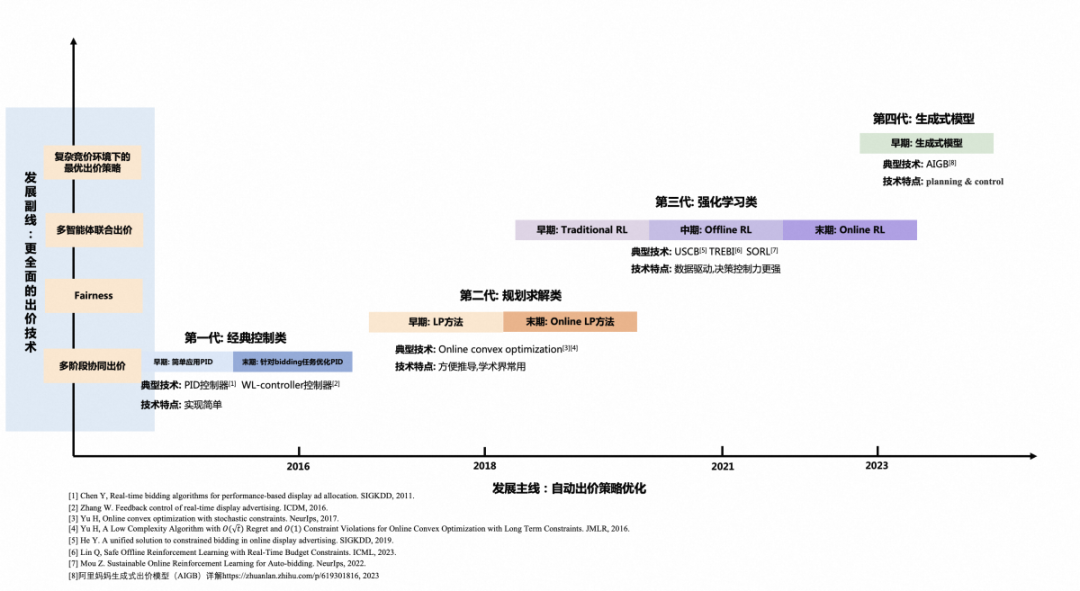

2.1 主线:从跟随到引领,迈向更强的序列决策技术

如何研发更先进的算法提升决策能力是自动出价策略发展的主线,我们参考了业界大量公开的正式文献,并结合阿里妈妈自身的技术发展,勾勒出自动出价策略的发展演进脉络。

图3:自动出价策略的演进主线:迈向更强的决策能力

图3:自动出价策略的演进主线:迈向更强的决策能力

整体可以划分为4个阶段:

👉🏻 第一代:经典控制类

- 把效果最大化的优化问题间接转化为预算消耗的控制问题。基于业务数据计算消耗曲线,控制预算尽可能按照设定的曲线来消耗。PID[1]及相关改进[2][10]是这一阶段常用的控制算法。当竞价流量价值分布稳定的情况下,这类算法能基本满足业务上线之初的效果优化。

👉🏻 第二代:规划求解类

- 相比于第一代,规划求解类(LP)算法直接面向目标最大化优问题来进行求解。可基于前一天的参竞流量来预测当前未来流量集合,从而求解出价参数。自动出价问题根据当前已投放的数据变成新的子问题,因此可多次持续的用该方法进行求解,即Online LP[3][4]。这类方法依赖对未来参竞流量的精准预估,因此在实际场景落地时需要在未来流量的质和量的预测上做较多的工作。

👉🏻 第三代:强化学习类

- 现实环境中在线竞价环境是非常复杂且动态变化的,未来的流量集合也是难以精准预测的,要统筹整个预算周期投放才能最大化效果。作为典型的序列决策问题,第三阶段用强化学习类方法来优化自动出价策略。其迭代过程从早期的经典强化学习方法落地[5][6][8][9],到进一步基于Offline RL方法逼近「在线真实环境的数据分布」[9],再到末期贴近问题本质基于Online RL方法实现和真实竞价环境的交互学习[13]。

👉🏻 第四代:生成模型类

- 以ChatGPT为代表的生成式大模型以汹涌澎湃之势到来,在多个领域都表现出令人惊艳的效果。新的技术理念和技术范式可能会给自动出价算法带来革命性的升级。阿里妈妈技术团队提前布局,以智能营销决策大模型AIGA(AI Generated Action)为核心重塑了广告智能营销的技术体系,并衍生出以AIGB(AI Generated Bidding)[14]为代表的自动出价策略。

为了让大家有更好的理解,我们以阿里妈妈的实践为基础,重点讲述下强化学习在工业界的落地以及对生成式模型的探索。

2.1.1 强化学习在自动出价场景的大规模应用实践

🏷 跟随:不断学习、曲折摸索

作为典型的序列决策问题,使用强化学习(RL)是很容易想到的事情,但其在工业界的落地之路却是充满曲折和艰辛的。最初学术界[8]做了一些探索,在请求粒度进行建模,基于Model-based RL方法训练出价智能体(Agent),并在请求维度进行决策。如竞得该PV,竞价系统返回该请求的价值,否则返回0,同时转移到下一个状态。这种建模方法应用到工业界遇到了很多挑战,主要原因在于工业界参竞流量巨大,请求粒度的建模所需的存储空间巨大;转化信息的稀疏性以及延迟反馈等问题也给状态构造和Reward设计带来很大的挑战。为使得RL方法能够真正落地,需要解决这几个问题:

「MDP是什么?」 由于用户到来的随机性,参竞的流量之间其实并不存在明显的马尔可夫转移特性,那么状态转移是什么呢?让我们再审视下出价公式,其包含两部分:流量价值和出价参数。其中流量价值来自于请求粒度,出价参数为对当前流量的出价激进程度,而激进程度是根据广告主当前的投放状态来决定的。一种可行的设计是将广告的投放信息按照时间段进行聚合组成状态,上一时刻的投放策略会影响到广告主的投放效果,并构成新一时刻的状态信息,因此按照时间段聚合的广告主投放信息存在马尔可夫转移特性。而且这种设计还可以把问题变成固定步长的出价参数决策,给实际场景中需要做的日志回流、Reward收集、状态计算等提供了时间空间。典型的工作[5][6][7][8][9][12] 基本上都是采用了这样的设计理念。

「Reward如何设计?」 Reward设计是RL的灵魂。出价策略的Reward设计需要让策略学习如何对数亿计流量出价,以最大化竞得流量下的价值总和。如果Reward只是价值总和的话,就容易使得策略盲目追求好流量,预算早早花光或者成本超限,因此还需要引导策略在约束下追求更有性价比的流量。另外,自动出价是终点反馈,即直到投放周期结束才能计算出完整的投放效果;且转化等信号不仅稀疏,还存在较长时间的回收延迟。因此我们需要精巧设计Reward让其能够指导每一次的决策动作。实践下来建立决策动作和最终结果的关系至关重要,比如[9]在模拟环境中保持当前的最优参数,并一直持续到终点,从而获取到最终的效果,以此来为决策动作设置较为精准的Reward。另外,在实际业务中,为了能够帮助模型更好的收敛,往往也会把业务经验融入到Reward设计中。

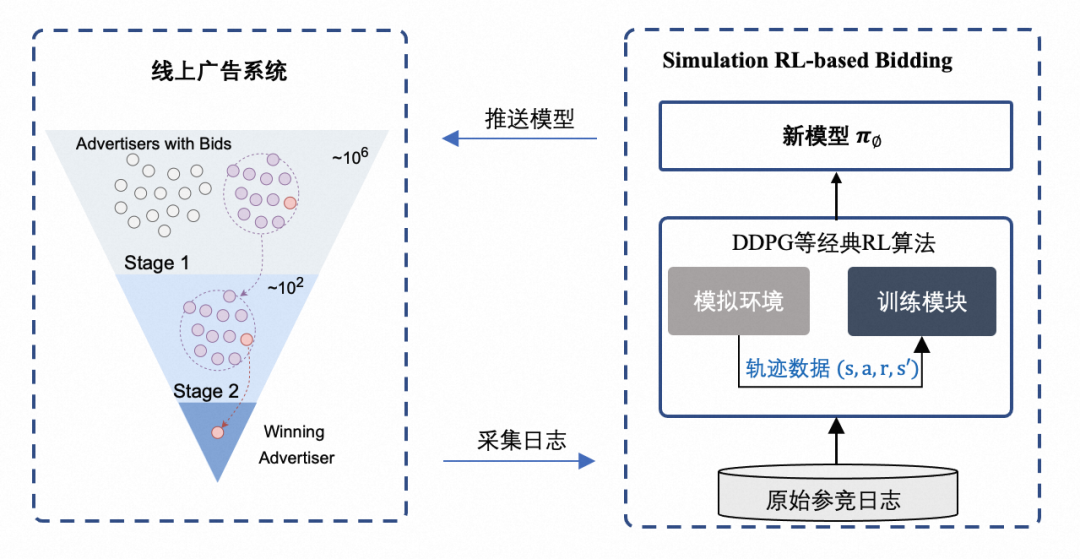

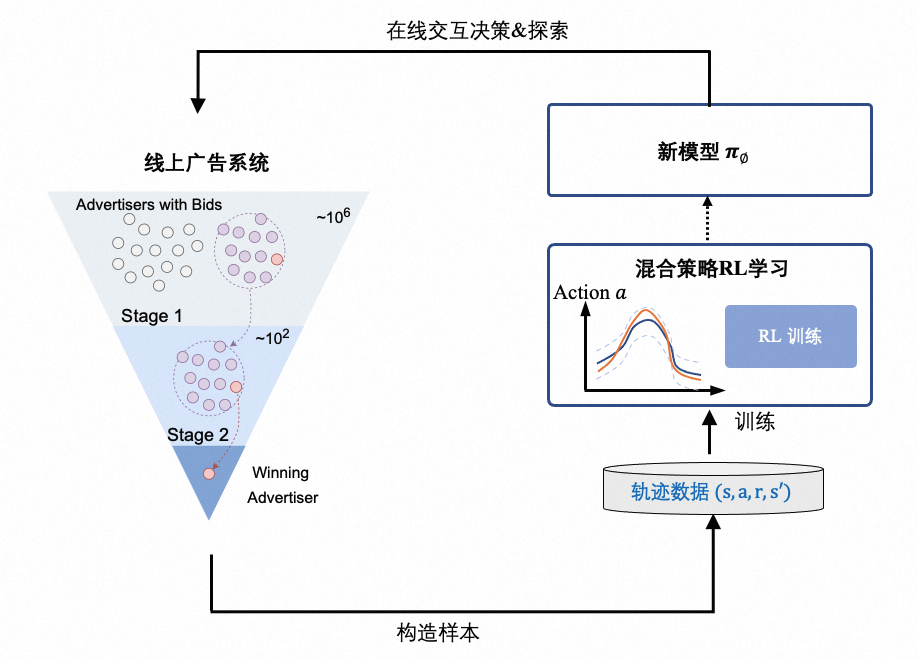

「如何训练?」 强化学习本质是一个Trail-and-Error的算法,需要和环境进行交互收集到当前策略的反馈,并不断探索新的决策空间进一步更新迭代策略。但在工业界,由于广告主投放周期的设置,一个完整的交互过程在现实时间刻度上通常为一天。经典的RL算法要训练好一般要经历上万次的交互过程,这在现实系统中很难接受。在实践中,通常构造一个模拟竞价环境用于RL模型的训练,这样就摆脱现实时空的约束提升模型训练效率。当然在线竞价环境非常复杂,如何在训练效率和训练效果之间平衡是构造模拟环境中需要着重考虑的事情。这种训练模式,也一般称之为 Simulation RL-based Bidding(简称SRLB),其流程如下图所示:

图4:Simulation RL-based Bidding (SRLB)训练模式

图4:Simulation RL-based Bidding (SRLB)训练模式

基于SRLB训练模式,我们实现了强化学习类算法在工业界场景的大规模落地。根据我们的调研,在搜广推领域,RL的大规模落地应用较为少见。

🏷 创新:立足业务、推陈出新

随着出价策略不断的升级迭代,“模拟环境和在线环境的差异”逐渐成为了效果进一步提升的约束。为了方便构造,模拟环境一般采用单坑GSP来进行分配和扣费且假设每条流量有固定的获胜价格(Winning Price)。但这种假设过于简单,尤其是当广告展现的样式越来越丰富,广告的坑位的个数和位置都在动态变化,且Learning-based拍卖机制也越来约复杂,使得模拟环境和在线实际环境差异越来越大。基于Simulation RL-based Bidding模式训练的模型在线上应用过程中会因环境变化而偏离最优策略,导致线上效果受到损失。模拟环境也可以跟随线上环境不断升级,但这种方式成本较高难度也大。因此,我们期待能够找到一种不依赖模拟环境,能够对标在线真实环境学习的模式,以使得训练出来的Bidding模型能够感知到真实竞价环境从而提升出价效果。

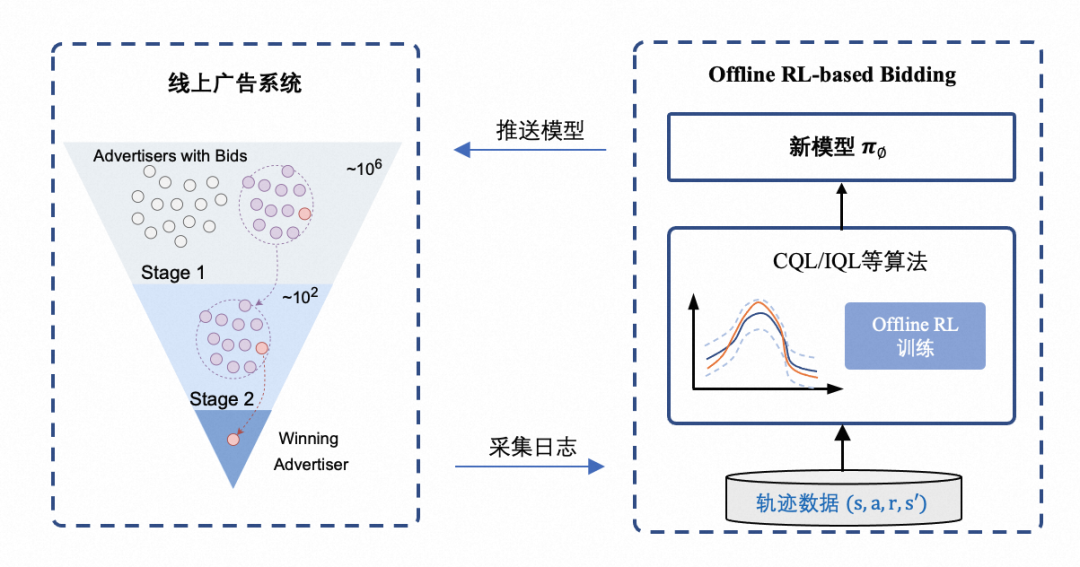

结合业务需求并参考了RL领域的发展,我们先后调研了模仿学习、Batch RL、Offline RL等优化方案,并提出的如下的 Offline RL-based Bidding 迭代范式,期望能够以尽可能小的代价的逼近线上真实的样本分布。

图5:Offline RL-based Bidding 训练模式,与SRLB模式差异主要在训练数据来源和训练方式

图5:Offline RL-based Bidding 训练模式,与SRLB模式差异主要在训练数据来源和训练方式

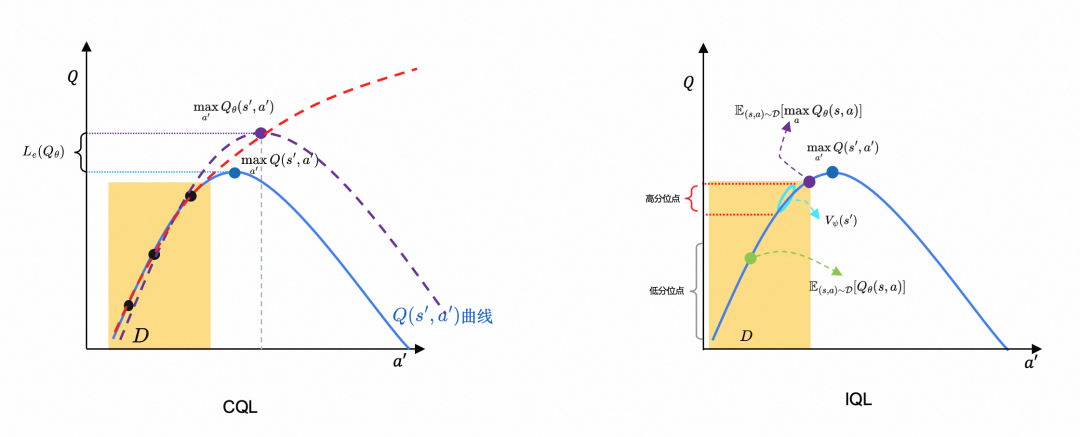

在这个范式下,直接基于线上决策过程的日志,拟合reward与出价动作之间的相关性,从而避免模拟样本产生的分布偏差。尽管使用真实决策样本训练模型更加合理,但在实践中往往容易产生策略坍塌现象。核心原因就是线上样本不能做到充分探索,对样本空间外的动作价值无法正确估计,在贝尔曼方程迭代下不断的高估。对于这一问题,我们可以假设一个动作所对应的数据密度越大,支撑越强,则预估越准确度越大,反之则越小。基于这一假设,参考CQL[21]的思想,构建一种考虑数据支撑度的RL模型,利用数据密度对价值网络估值进行惩罚。这一方法可以显著改善动作高估问题,有效解决OOD问题导致的策略坍塌,从而使得Offline RL-based能够部署到线上并取得显著的效果提升。后续我们又对这个方法做了改进,借鉴了IQL[22](Implicit Q learning)中的In-sample learning思路,引入期望分位数回归,基于已有的数据集来估计价值网络,相比于CQL,能提升模型训练和效果提升的稳定性。

图6:从CQL到IQL,Offline RL-based Bidding中训练算法的迭代

图6:从CQL到IQL,Offline RL-based Bidding中训练算法的迭代

总结下来,在这一阶段我们基于业务中遇到的实际问题,并充分借鉴业界思路,推陈出新。Offline RL-based Bidding通过真实的决策数据训练出价策略,比基于模拟环境训练模式(SRLB)能够更好的逼近「线上真实环境的数据分布」。

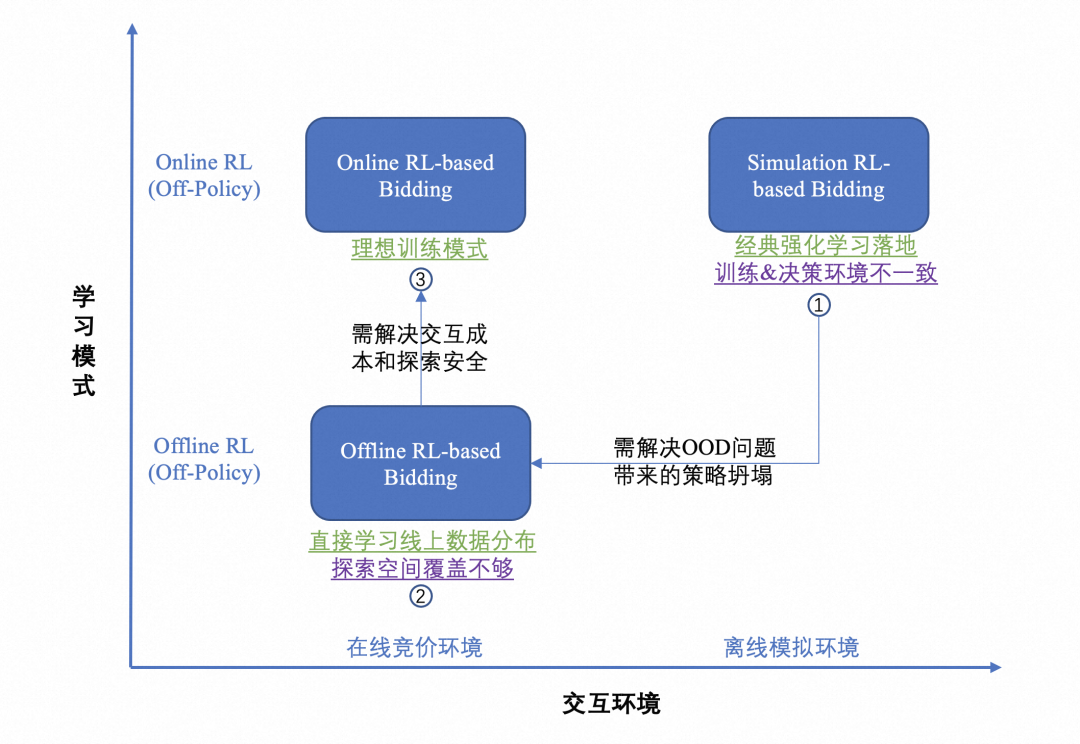

🏷 突破:破解难题、剑走偏锋

让我们再重新审视RL-based Bidding迭代历程,该问题理想情况可以通过「与线上真实环境进行交互并学习」的方式求解,但广告投放系统交互成本较高,与线上环境交互所需要的漫长「训练时间成本」和在线上探索过程中可能需要遭受的「效果损失成本」,让我们在早期选择了Simulation RL-based Bidding范式,随后为解决这种范式下存在的环境不一致的问题,引入了Offline RL-based Bidding范式。

图7:重新审视RL-based Bidding发展脉络

图7:重新审视RL-based Bidding发展脉络

为了能够进一步突破效果优化的天花板,我们需要找到一种新的Bidding模型训练范式:能够不断的和线上进行交互探索新的决策空间且尽可能减少因探索带来的效果损失。还能够在融合了多种策略的样本中进行有效学习。即控制「训练时间成本」和「效果损失成本」下的 Online RL-based Bidding 迭代范式,如下图所示:

图8:Online RL-based Bidding 训练模式,与前两种模式的差别在于能够和环境进行直接交互学习

图8:Online RL-based Bidding 训练模式,与前两种模式的差别在于能够和环境进行直接交互学习

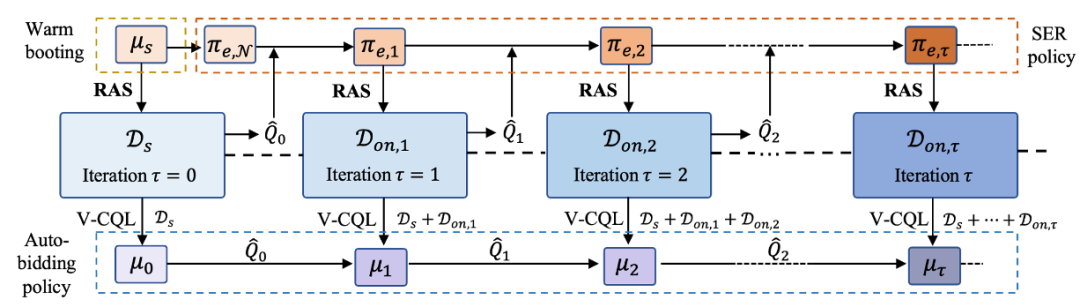

[13]提出了可持续在线强化学习(SORL),与在线环境交互的方式训练自动出价策略,较好解决了环境不一致问题。SORL框架包含探索和训练两部分算法,基于Q函数的Lipschitz光滑特性设计了探索的安全域,并提出了一个安全高效的探索算法用于在线收集数据;另外提出了V-CQL算法用于利用收集到的数据进行离线训练,V-CQL算法通过优化训练过程中Q函数的形态,减小不同随机种子下训练策略表现的方差,从而提高了训练的稳定性。

图9:SORL的训练模式

图9:SORL的训练模式

在这一阶段中,不断思考问题本质,提出可行方案从而使得和在线环境进行交互训练学习成为可能。

2.1.2 引领生成式Bidding的新时代(AIGB)

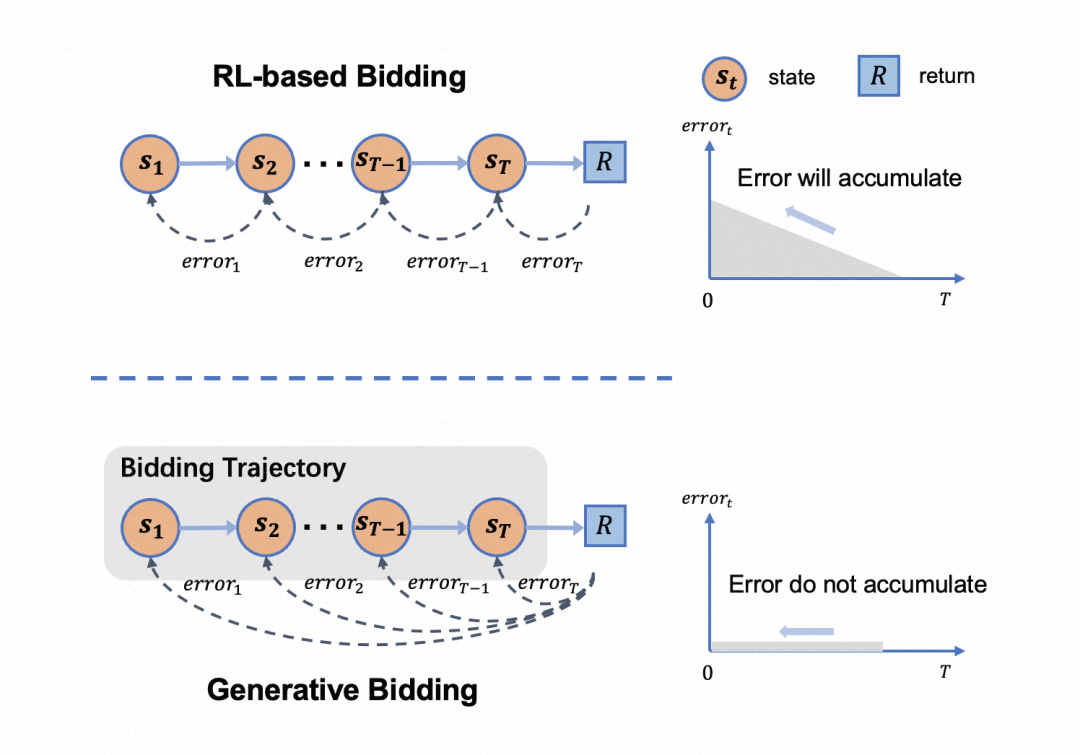

ChatGPT为代表的生成式大模型以汹涌澎湃之势到来。一方面,新的用户交互模式会孕育新的商业机会,给自动出价的产品带来巨大改变;另一方面,新的技术理念和技术范式也会给自动出价策略带来革命性的升级。我们在思考生成式模型能够给自动出价策略带来什么?从技术原理上来看,RL类方法基于时序差分学习决策动作好坏,在自动出价这种长序列决策场景下会有训练误差累积过多的问题。因此,我们提出了一种基于生成式模型构造的出价策略优化方案(AIGB – AI Generative Bidding)[14]。与强化学习的视角不同,如图9所示,AIGB 直接关联决策轨迹和回报信息,能够避免训练累积,更适合长序列决策场景。

图10:Generative Bidding相比RL-based Bidding模式能够避免训练误差累积,更适合长序列决策场景

图10:Generative Bidding相比RL-based Bidding模式能够避免训练误差累积,更适合长序列决策场景

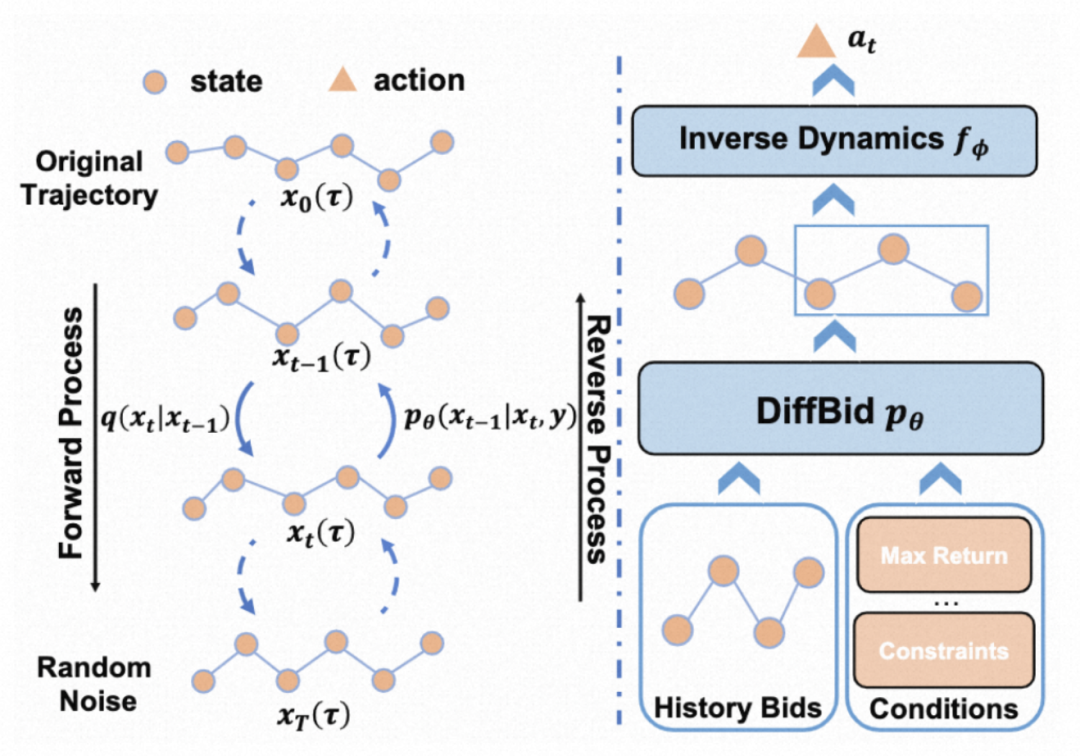

从生成式模型的角度来看,我们可以将出价、优化目标和约束等具备相关性的指标视为一个联合概率分布,从而将出价问题转化为条件分布生成问题。图10直观地展示了生成式出价模型的流程:在训练阶段,模型将历史投放轨迹数据作为训练样本,以最大似然估计的方式拟合轨迹数据中的分布特征。这使得模型能够自动学习出价策略、状态间转移概率、优化目标和约束项之间的相关性。在线上推断阶段,生成式模型可以基于约束和优化目标,以符合分布规律的方式输出出价策略。

图11:AIGB的训练和预测算法

图11:AIGB的训练和预测算法

AIGB基于当前的投放状态信息以及策略生成条件输出未来的投放策略,相比于以往的RL策略输出单步action,AIGB可以被理解为在规划的基础上进行决策,最大程度地避免分布偏移和策略退化问题,从而更适合长序列决策场景。这一优点有利于在实践中进一步减小出价间隔,提升策略的快速反馈能力。与此同时,基于规划的出价策略也具备更好的可解释性,能够帮助我们更好地进行离线策略评估,方便专家经验与模型深度融合。另外,我们也还在进一步探索,是否可以把竞价领域知识融入到大模型中并帮助出价决策。从「动作判别式」决策 到「轨迹生成式」决策 ,朝着生成式Bidding的新时代大踏步迈进!

2.2 副线:百花齐放,更全面的出价决策技术

图12:发展副线:更全面的业务实际场景的特性优化

图12:发展副线:更全面的业务实际场景的特性优化

除了更强的决策能力外,在实际场景中还会针对业务特点做更多的优化,这里介绍4个典型的研究技术点:

👉🏻 复杂的竞价环境下的最优出价策略

出价形式化建模依赖对竞价环境的假设,不同的假设下推导出来的出价公式是不同的。以MaxReturn计划为例,出价形式为,其中为一个粗粒度与请求无关的参数,在简单竞价环境下(GSP单坑下)这种出价形式是理论最优的。而在实际工业界竞价环境是非常复杂的:多坑、带保留价的机制或其他复杂机制,当前的出价策略并非最优。学术界和工业界针对这一问题提出了不少方法,大概分为2类:1)对竞价环境做进一步的假设(比如多坑)推导出闭式解,并进行求解[18];2)基于数据驱动的方法,在基础价格上结合当前流量的信息(如Winning Price)等进行微调,比如Bid Shading类方法[17][19] 。

👉🏻 多智能体联合出价

在线广告本质上是一个多智能体竞价系统。通常情况下每一个自动出价智能体求解一个独立的优化问题,而将其他智能体出价的影响隐式地建模为环境的一部分。这种建模方式忽略了在线广告的动态博弈,即最终的拍卖结果取决于所有智能体的出价,且任一智能体的策略的改变会影响到其他所有智能体的策略。因此若不做协调,则所有智能体会处于一个无约束状态,进而降低系统的效率。典型的工作包括[7][11][12]都是针对线上环境的多智能体问题进行求解,面对线上智能体个数众多(百万级),通过广告主进行聚类等方式,把问题规模降低到可求解的程度。

👉🏻 Fairness

不同行业的广告主在广告投放时面临的竞价环境也是不同的,当前广泛采用的统一出价策略可能使得不同广告主的投放效果存在较大的差异,尤其是对小广告主来说,训练效果会受到大广告主的影响,即“Fairness”问题。典型的工作包括[16]将传统的统一出价策略拓展为多个能够感知上下文的策略族,其中每个策略对应一类特定的广告主聚类。这个方法中首先设计了广告计划画像网络用于建模动态的广告投放环境。之后,通过聚类技术将差异化的广告主分为多个类并为每一类广告主设计一个特定的具有上下文感知能力的自动出价策略,从而实现为每个广告主匹配特定的个性化策略。

👉🏻 多阶段协同出价

为平衡行业在线广告的优化性能和响应时间,在线工业场景经常会采用两阶段级联架构。在这种架构下,自动出价策略不仅需要在精竞阶段(第二阶段)进行传统的竞拍,还必须在粗竞阶段(第一阶段)参与竞争才能进入精竞阶段。现有的工作主要集中在精竞阶段的拍卖设计和自动出价策略上,而对粗竞阶段的拍卖机制和自动出价策略研究还不够充分,这部分最主要的挑战在于粗竞阶段的广告量级会比精竞阶段多了近百倍,且自动出价依赖的流量价值预估(如PCVR)比精竞阶段准度差,因此如何设计更大规模且能够应对不确定性预估值下的出价策略是这个方向主要研究的问题,而且还需要研究两阶段下的拍卖机制设计以引导自动出价正确报价。在这个方向上,我们依赖强大的工程基建能力上线了全链路自动出价策略,显著提升了广告主的投放效果;并设计了适用于两阶段的拍卖机制[33]。

3. 结语

雄关漫道真如铁,而今迈步从头越。历经阿里妈妈技术同学们坚持不懈的努力,在自动出价决策技术上,从推动经典强化学习类算法在工业界大规模落地,到持续革新提出Offline RL-based Bidding、Online RL-based Bidding等适应工业界特点的新算法,再到提出AIGB迈入生成式Bidding的新时代。一路走来,我们持续推动业界广告决策智能技术的发展,并秉承开放共赢,把我们的工作以学术化沉淀的方式实现对学术界研究的反哺。希望大家多多交流,共赴星辰大海。

4. 小彩蛋:强化学习邀请赛

🏷 阿里妈妈强化学习邀请赛

2023年1月22日-2月29日 正式开赛,欢迎关注!作为典型的序列决策场景,强化学习在阿里妈妈广告上得到大规模的落地实践并得到了快速的技术发展。工业界参竞流量巨大,奖赏稀疏性且延迟反馈,和真实环境交互代价等挑战都使得强化学习还有很大的优化空间。本次比赛结合了真实广告业务场景,诚邀广大强化学习爱好者前来挑战,一起体验算法的乐趣~

▐ 关于我们

核心关键词:超核心业务、大规模RL工业界落地、决策智能大模型、技术引领业界、团队氛围好!

「智能广告平台」 基于海量数据,优化阿里广告技术体系,驱动业务增⻓,并推动技术持续走在行业前沿:精准建模以提升商业化效率,创新广告售卖机制和商业化模式以打开商业化天花板,研发最先进的出价算法帮助商家获得极致的广 告投放效果和体验,设计和升级算法架构以支撑国内顶级规模的广告业务稳健&高效迭代等。

超大业务体量和丰富商业化场景,赋能我们在深度学习、强化学习、机制设计、投放策略、顶层业务/技术上的视野和判断极速成⻓并沉淀丰厚;超一线站位也让我们在“挖掘有价值&有挑战新问题,驱动产品技术能力创新等”方面有得天独厚优势。欢迎聪明靠谱小伙伴加入(社招、校招、实习生、高校合作、访问学者等)。

✉️ 简历投递邮箱:alimama_tech@service.alibaba.com

▐ 参考文献

[1]. Chen Y, Berkhin P, Anderson B, et al. Real-time bidding algorithms for performance-based display ad allocation[C]//Proceedings of the 17th ACM SIGKDD international conference on Knowledge discovery and data mining. 2011: 1307-1315.

[2]. Zhang W, Rong Y, Wang J, et al. Feedback control of real-time display advertising[C]//Proceedings of the Ninth ACM International Conference on Web Search and Data Mining. 2016: 407-416.

[3]. Yu H, Neely M J. A Low Complexity Algorithm with Regret and Constraint Violations for Online Convex Optimization with Long Term Constraints[J]. arXiv preprint arXiv:1604.02218, 2016.

[4]. Yu H, Neely M, Wei X. Online convex optimization with stochastic constraints[J]. Advances in Neural Information Processing Systems, 2017, 30.

[5]. Zhao J, Qiu G, Guan Z, et al. Deep reinforcement learning for sponsored search real-time bidding[C]//Proceedings of the 24th ACM SIGKDD international conference on knowledge discovery & data mining. 2018: 1021-1030.

[6]. Cai H, Ren K, Zhang W, et al. Real-time bidding by reinforcement learning in display advertising[C]//Proceedings of the tenth ACM international conference on web search and data mining. 2017: 661-670.

[7]. Jin J, Song C, Li H, et al. Real-time bidding with multi-agent reinforcement learning in display advertising[C]//Proceedings of the 27th ACM international conference on information and knowledge management. 2018: 2193-2201.

[8]. Wu D, Chen X, Yang X, et al. Budget constrained bidding by model-free reinforcement learning in display advertising[C]//Proceedings of the 27th ACM International Conference on Information and Knowledge Management. 2018: 1443-1451.

[9]. He Y, Chen X, Wu D, et al. A unified solution to constrained bidding in online display advertising[C]//Proceedings of the 27th ACM SIGKDD Conference on Knowledge Discovery & Data Mining. 2021: 2993-3001.

[10]. Yang X, Li Y, Wang H, et al. Bid optimization by multivariable control in display advertising[C]//Proceedings of the 25th ACM SIGKDD international conference on knowledge discovery & data mining. 2019: 1966-1974.

[11]. Guan Z, Wu H, Cao Q, et al. Multi-agent cooperative bidding games for multi-objective optimization in e-commercial sponsored search[C]//Proceedings of the 27th ACM SIGKDD Conference on Knowledge Discovery & Data Mining. 2021: 2899-2909.

[12]. Wen C, Xu M, Zhang Z, et al. A cooperative-competitive multi-agent framework for auto-bidding in online advertising[C]//Proceedings of the Fifteenth ACM International Conference on Web Search and Data Mining. 2022: 1129-1139.

[13]. Mou Z, Huo Y, Bai R, et al. Sustainable Online Reinforcement Learning for Auto-bidding[J]. Advances in Neural Information Processing Systems, 2022, 35: 2651-2663.

[14]. 阿里妈妈生成式出价模型(AIGB)详解https://zhuanlan.zhihu.com/p/619301816, 2023

[15]. Lin Q, Tang B, Wu Z, et al. Safe Offline Reinforcement Learning with Real-Time Budget Constraints[J]. arXiv preprint arXiv:2306.00603, 2023.

[16]. Zhang H, Niu L, Zheng Z, et al. A Personalized Automated Bidding Framework for Fairness-aware Online Advertising[C]//Proceedings of the 29th ACM SIGKDD Conference on Knowledge Discovery and Data Mining. 2023: 5544-5553.

[17]. Gong Z, Niu L, Zhao Y, et al. MEBS: Multi-task End-to-end Bid Shading for Multi-slot Display Advertising[C]//Proceedings of the 32nd ACM International Conference on Information and Knowledge Management. 2023: 4588-4594.

[18]. Ou, W., Chen, B., Liu, W., Dai, X., Zhang, W., Xia, W., Li, X., Tang, R., & Yu, Y. (2023). Optimal Real-Time Bidding Strategy for Position Auctions in Online Advertising. Proceedings of the 32nd ACM International Conference on Information and Knowledge Management.

[19]. Gligorijevic, D., Zhou, T., Shetty, B., Kitts, B., Pan, S., Pan, J., & Flores, A. (2020). Bid Shading in The Brave New World of First-Price Auctions. Proceedings of the 29th ACM International Conference on Information & Knowledge Management.

[20]. Zhang, W., Kitts, B., Han, Y., Zhou, Z., Mao, T., He, H., Pan, S., Flores, A., Gultekin, S., & Weissman, T. (2021). MEOW: A Space-Efficient Nonparametric Bid Shading Algorithm. Proceedings of the 27th ACM SIGKDD Conference on Knowledge Discovery & Data Mining.

[21]. Kumar, A., Zhou, A., Tucker, G., & Levine, S. (2020). Conservative Q-Learning for Offline Reinforcement Learning. ArXiv, abs/2006.04779.

[22]. Kostrikov, I., Nair, A., & Levine, S. (2021). Offline Reinforcement Learning with Implicit Q-Learning. ArXiv, abs/2110.06169.

END

也许你还想看丨Bidding模型训练新范式:阿里妈妈生成式出价模型(AIGB)详解丨Auction Design in the Auto-bidding World系列一:面向异质目标函数广告主的拍卖机制设计丨自动出价下机制设计系列 (二) :面向私有约束的激励兼容机制设计丨万字长文,漫谈广告技术中的拍卖机制设计(经典篇)丨阿里妈妈展示广告智能拍卖机制的演进之路丨面向在线广告全链路拍卖机制设计新突破 — Two-stage Auction

丨Deep GSP :面向多目标优化的工业界广告智能拍卖机制

关注「阿里妈妈技术」,了解更多~

喜欢要“分享”,好看要“点赞”哦ღ~

↓欢迎留言参与讨论↓

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง