导语

近日发表于 Cell 子刊 Patterns 上的一项最新研究针对传统联邦学习算法训练得到的机器学习模型在多个水平上呈现出的公平性差的难题,设计并实现了联邦学习设定下的统一的算法公平性框架以及相应的高效优化算法,为联邦学习在数字医疗领域的应用提供了一种可信的解决方案。浙江大学计算机科学与技术学院副教授、人工智能系副主任况琨是论文通讯作者,也是集智俱乐部「因果科学与Causal AI」系列读书会主讲人。

研究领域:联邦学习,算法公平性,数字医疗

况琨 | 作者

论文题目:Unified fair federated learning for digital healthcare

论文来源:Cell Press Patterns

论文地址:https://www.cell.com/patterns/fulltext/S2666-3899(23)00314-8

近年来,随着人工智能(AI)技术的飞速发展,人们对其充满热情和憧憬。AI技术在通用领域和多个专业垂直领域均展示出了前所未有的强大性能,引领着科技创新的潮流。但是,随着AI能力的突飞猛进,社会对AI模型潜在的伦理风险和社会责任问题也日益关注。AI技术的快速进步带来了潜在的风险,包括数据隐私泄露、不公平偏见以及其他伦理挑战。

因此,确保AI技术的安全发展,与人类价值观和目标保持一致,对于促进人类社会的持续进步至关重要。在这样的背景下,AI安全与对齐的概念应运而生,它强调AI技术的发展必须以人类福祉为核心,避免AI模型失控或被不当使用,导致灾难性的后果。AI安全与对齐的研究包括确保AI系统的决策公平公正、可解释,并且能够遵循道德和法律标准。

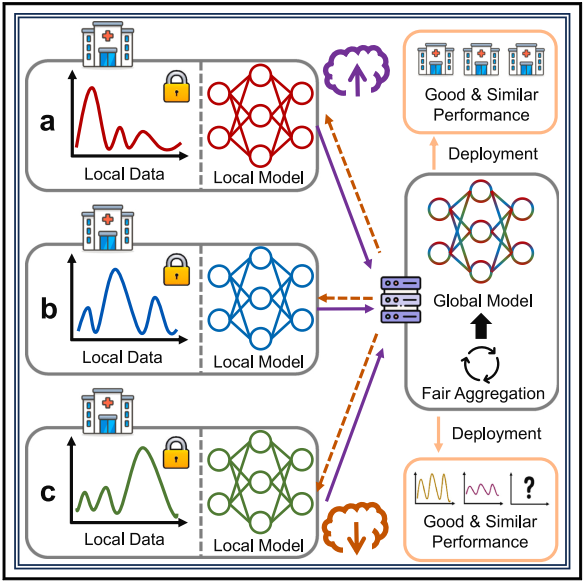

特别地,在医疗领域,AI的应用前景广阔,能够协助医生做出更准确的诊断、提供个性化治疗方案,甚至在药物研发中发挥关键作用。然而,医疗数据的敏感性要求更高层次的隐私保护。这引入了联邦学习的概念,一种旨在保护数据隐私的机器学习技术,它允许算法在多个数据源(医疗机构)上进行训练,而无需将这些数据集中或共享。

此外,医疗领域联邦学习中的公平性问题也非常关键。在处理来自不同人群和地区的医疗数据时,必须确保AI系统不会加剧现有的健康不平等。这需要在算法设计中考虑到多样性和包容性,确保所有群体的健康需求得到平等的关注和服务。

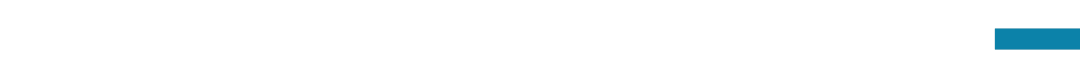

然而,已有证据表明传统联邦学习算法得到的模型存在着不公平性 (unfairness):虽然模型有着较高的整体准确率 (overall accuracy),但是其在不同数据子种群上可能存在着很大的性能差异 (performance disparity)。可将联邦学习中的公平性按照不同水平分为以下四类:(A) 医院水平公平性:在不同医院上的性能差异大,可能会打击部分医院参与联邦学习的积极性,进而破坏联邦学习生态;(B) 属性水平公平性:在不同属性(类别/性别/种族)上的性能差异大,可能会对部分人群产生歧视性,进而引发伦理问题;(C) 多水平公平性:同时在多个水平(医院&属性)上的性能差异大,可能会引发多种后果;

(D) 未知水平公平性:模型部署环境的数据分布未知时,可能在某个水平(例如未参与联邦学习的医院)上存在较大性能差异。

图1:医疗领域联邦学习场景中不同水平的算法公平性示意图

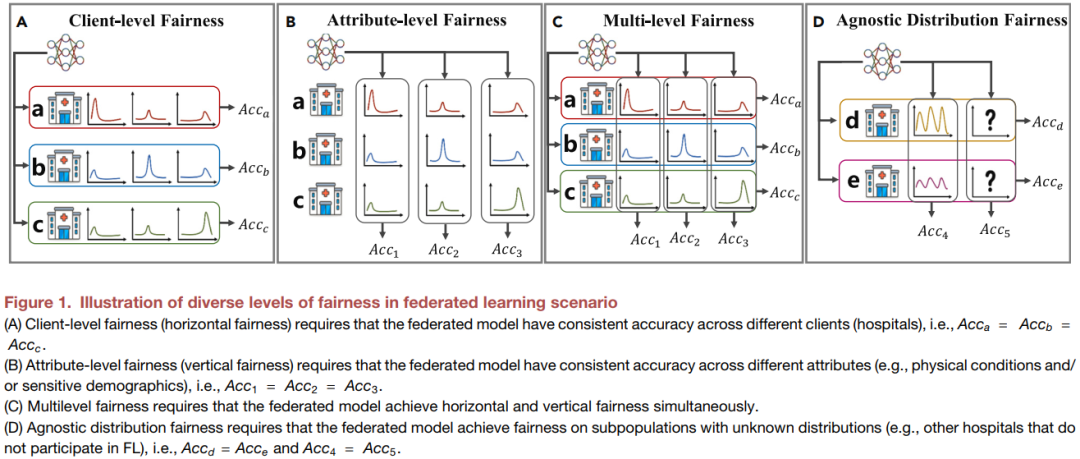

在本文中,作者基于分布鲁棒优化技术设计了一套联邦学习算法公平性框架,并开发了相应的高效优化算法(FedUFO),为上述问题提供了一个统一的解决方案。

图2:面向医疗领域的公平联邦学习统一优化框架流程图

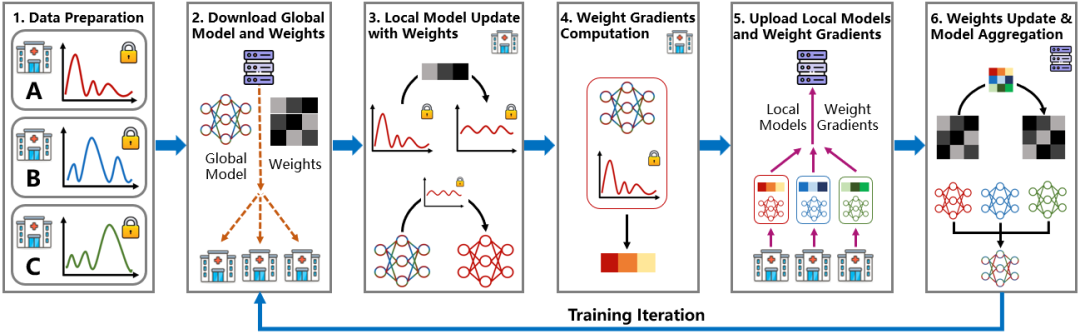

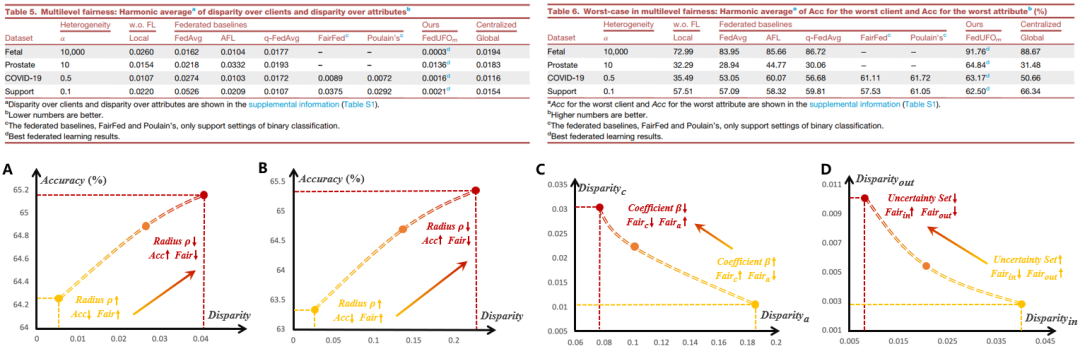

为了验证该技术在各种联邦学习设定下不同水平公平性上的有效性,作者在四个真实数字医疗数据集上进行了应用实验,实验结果表明该方法可以有效提升任意指定水平上的公平性。此外,不同指标(包括准确率与不同水平上的算法公平性等)之间往往存在着权衡取舍,FedUFO算法可以使用户根据实际需求灵活地平衡不同指标。

图3:本文所提出的算法FedUFO性能评估

总结:该研究工作针对传统联邦学习算法训练得到的机器学习模型在多个水平上呈现出的公平性差的难题,设计并实现了联邦学习设定下的统一的算法公平性框架以及相应的高效优化算法,为联邦学习在数字医疗领域的应用提供了一种可信的解决方案。

该项研究工作由况琨副教授、吴飞教授、庄越挺教授、肖俊教授共同指导,博士生张凤达为论文第一作者,帅子滔为共同第一作者。相关研究得到了科技创新2030-“新一代人工智能”重大项目、NSFC企业创新发展联合基金项目和NSFC青年科学基金项目等资助。

AI安全与对齐读书会

大模型的狂飙突进唤醒了人们对AI技术的热情和憧憬,也引发了对AI技术本身存在的社会伦理风险及其对人类生存构成的潜在威胁的普遍担忧。在此背景下,AI安全与对齐得到广泛关注,这是一个致力于让AI造福人类,避免AI模型失控或被滥用而导致灾难性后果的研究方向。集智俱乐部和安远AI联合举办「AI安全与对齐」读书会,由多位海内外一线研究者联合发起,旨在深入探讨AI安全与对齐所涉及的核心技术、理论架构、解决路径以及安全治理等交叉课题。

详情请见:2024开年读书会:AI安全与对齐——应对前沿AI失控与滥用的技术路线

推荐阅读

1. 大模型安全与对齐:复杂系统视角下的AI安全2. CausalAI核心算法:因果森林及其相关研究3. Nat. Mach. Intell. 速递:临床机器学习的算法公平性和减少偏差4. 张江:第三代人工智能技术基础——从可微分编程到因果推理 | 集智学园全新课程5. 加入集智学园VIP,一次性获取集智平台所有内容资源6. 加入集智,一起复杂!

点击“阅读原文”,报名读书会

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง