梦晨 西风 发自 凹非寺

量子位 | 公众号 QbitAI

谷歌下一代大模型,无预警降临。

Gemini 1.5,除了性能显著增强,还在长上下文理解方面取得突破,甚至能仅靠提示词学会一门训练数据中没有的新语言。

此时距离去年12月Gemini 1.0发布,还不到3个月。

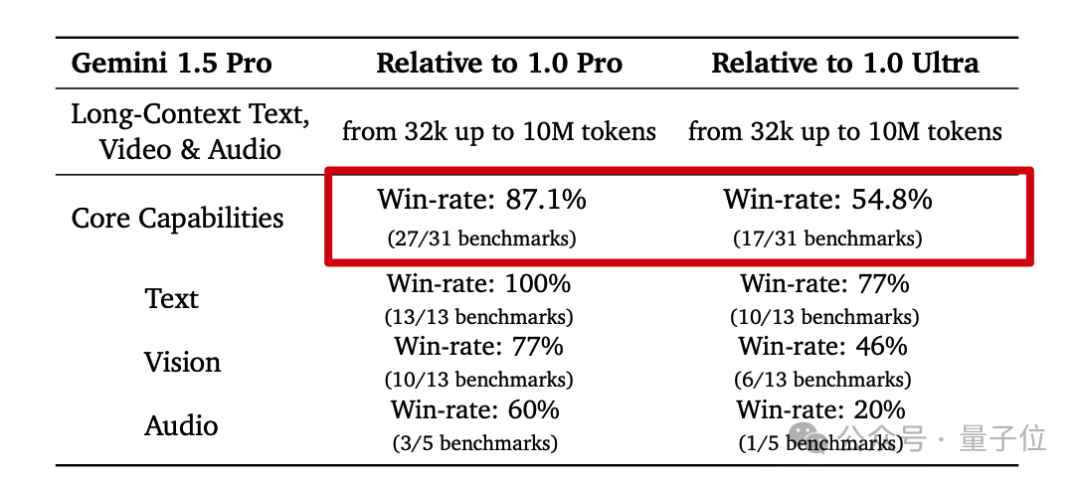

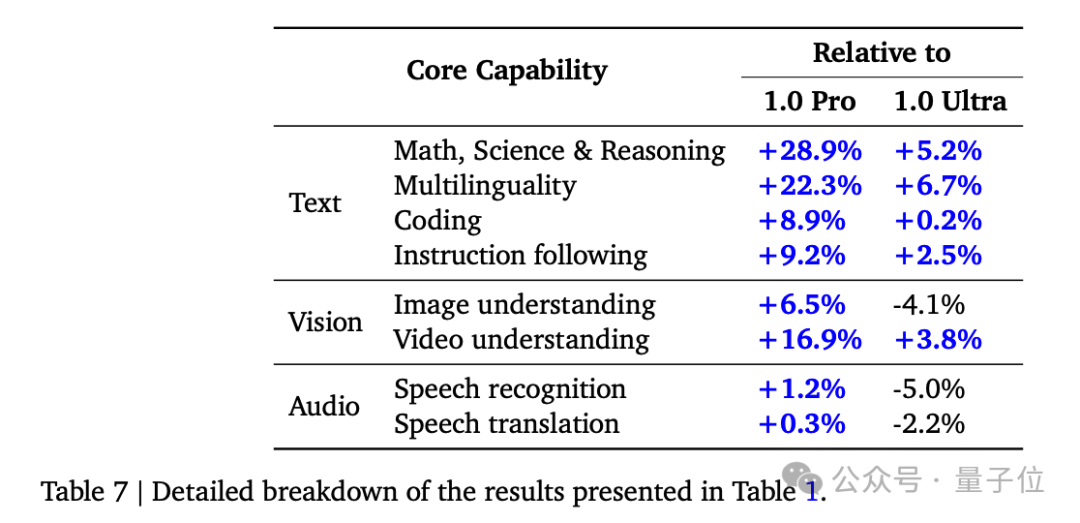

现在仅仅中杯1.5 Pro版就能越级打平上一代大杯1.0 Ultra版,更是在27项测试中超越平级的1.0 Pro。

支持100万token上下文窗口,迄今为止大模型中最长,直接甩开对手一个量级。

这还只是对外发布的版本,谷歌更是透露了内部研究版本已经能直冲1000万。

现在Gemini能处理的内容,可换算成超过70万单词,或1小时视频、11小时音频、超过3万行代码。

没错,这些数据模态Gemini 1.5都已经内建支持。

从今天起,开发者和客户就可以在Vertex API或AI Studio申请试用。

刚刚收到消息还在震惊中的网友们 be like:

还有人直接@了OpenAI的奥特曼,这你们不跟进一波?

上下文理解能力拉满

目前谷歌已放出三个不同任务的演示视频,只能说Gemini 1.5是个抽象派(doge)。

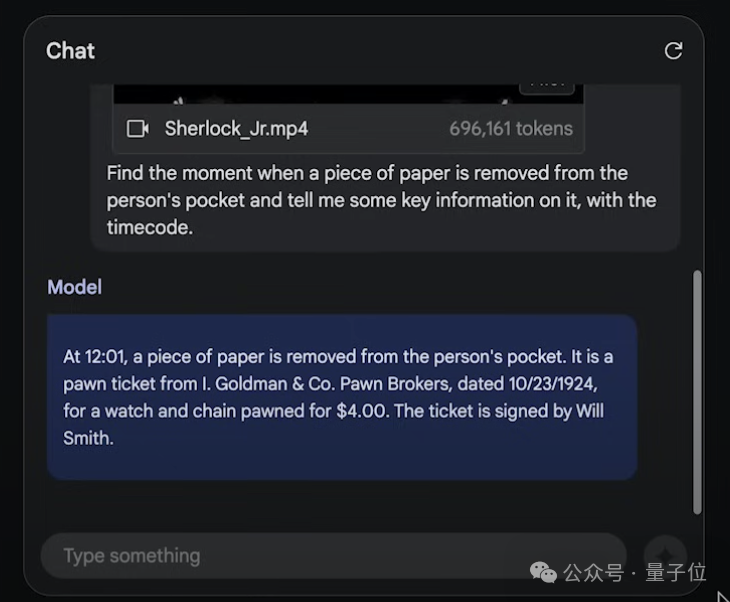

在第一段演示视频中,展示的是Gemini 1.5处理长视频的能力。

使用的视频是巴斯特·基顿(Buster Keaton)的44分钟电影,共696161 token。

演示中直接上传了电影,并给了模型这样的提示词:

找到从人的口袋中取出一张纸的那一刻,并告诉我一些关于它的关键信息以及时间码。

随后,模型立刻处理,输入框旁边带有一个“计时器”实时记录所耗时间:

不到一分钟,模型做出了回应,指出12:01的时候有个人从兜里掏出了一张纸,内容是高盛典当经纪公司的一张当票,并且还给出了当票上的时间、成本等详细信息。

随后经查证,确认模型给出的12:01这个时间点准确无误:

除了纯文字prompt,还有更多玩法。直接给模型一张抽象“场景图”,询问“发生这种情况时的时间码是多少?”。

同样不到一分钟,模型准确给出了的电影对应的时间点15:34。

在第二段演示视频中,谷歌展示了Gemini 1.5分析和理解复杂代码库的能力。用到的是Three.js,这是一个3D Javascript库,包含约100000行代码、示例、文档等。

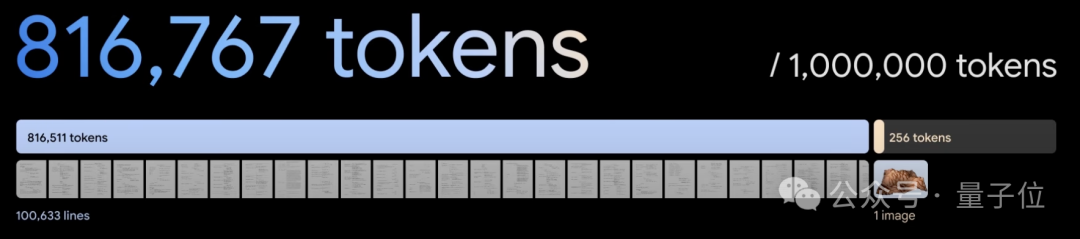

演示中他们将所有内容放到了一个txt文件中,共816767 token,输入给模型并要求它“找到三个示例来学习角色动画”。

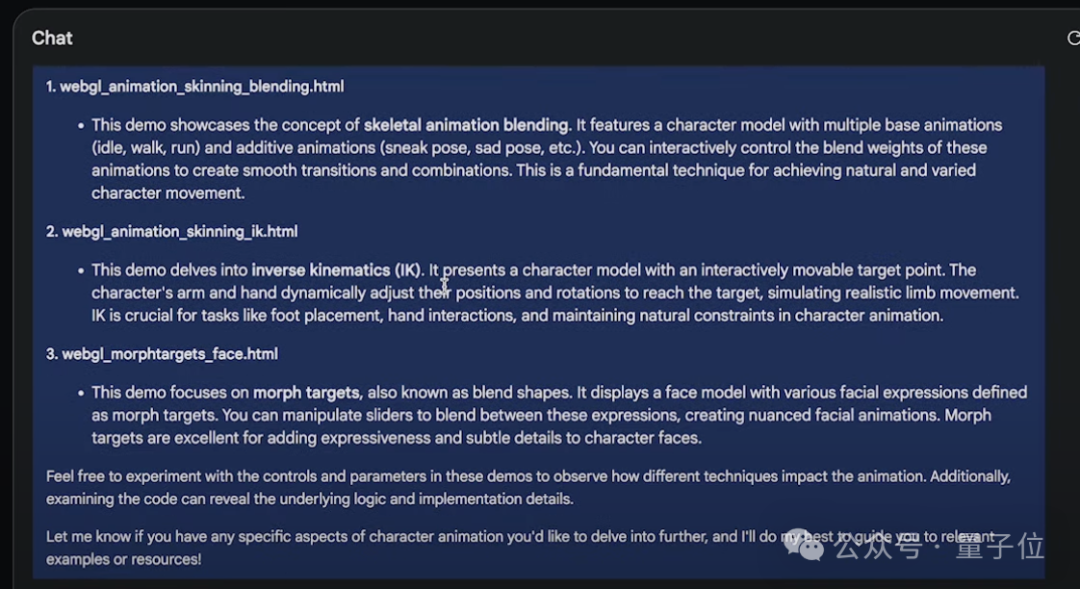

结果模型查看了数百个示例后筛选出了三个关于混合骨骼动画、姿势、面部动画的示例。

这只是开胃小菜。接下来只用文字询问模型“动画Little Tokyo的demo是由什么控制?”

模型不仅找到了这个demo,并且解释了动画嵌入在gLTF模型中。

并且还能实现“定制代码”。让模型“给一些代码,添加一个滑块来控制动画的速度。使用其它演示所具有的那种GUI”。

Gemini 1.5分分钟给出了可以成功运行的代码,动画右上角出现了一个可控速的滑块:

当然也可以做“代码定位”。仅靠一张demo的图片,Gemini 1.5就能在代码库中从数百个demo中,找到该图对应动画的代码:

还能修改代码,让地形变得平坦,并解释其中的工作原理:

修改代码这一块,对文本几何体的修改也不在话下:

第三个演示视频展示的是Gemini 1.5的文档处理能力。

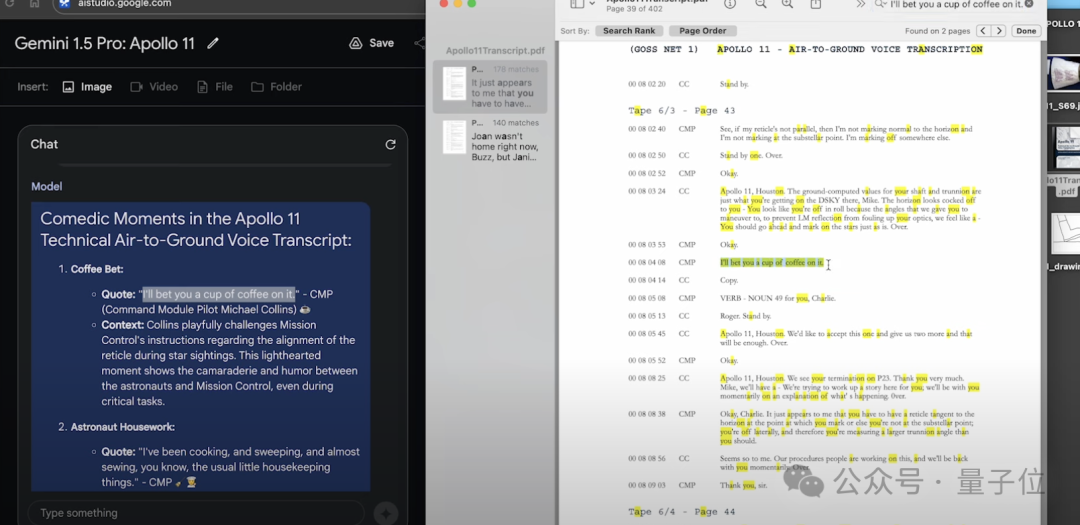

选用的是阿波罗11号登月任务的402页PDF记录,共326658 token。

要求Gemini 1.5“找到三个搞笑时刻,并列出文字记录以及表情符号引述”:

30秒,模型给出了回应,其一是迈克尔·柯林斯的这句话“我敢打赌你一定要喝一杯咖啡”,经查询文档中的确有记录:

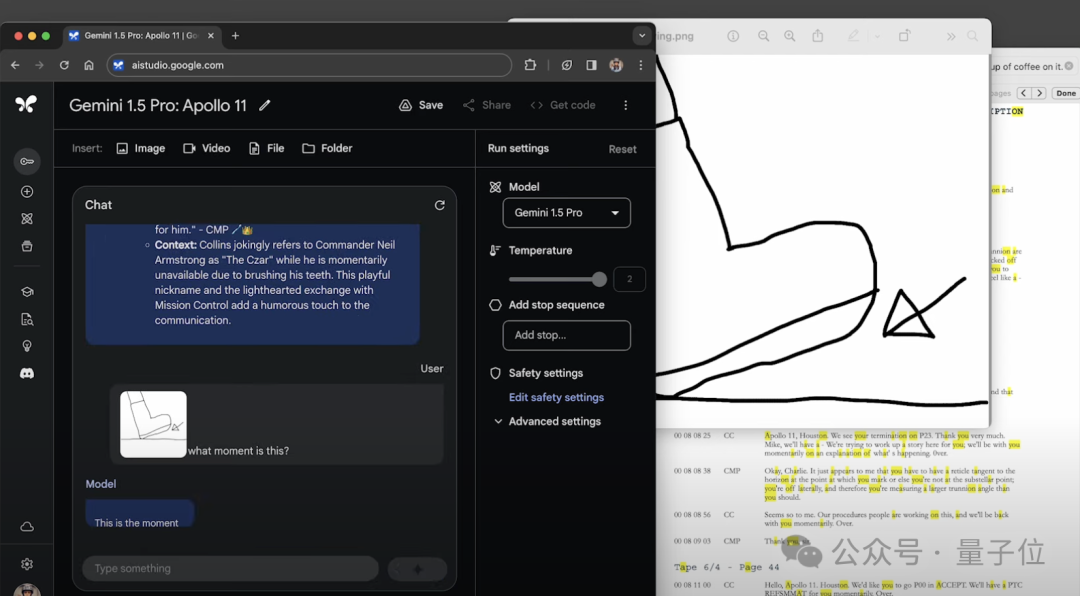

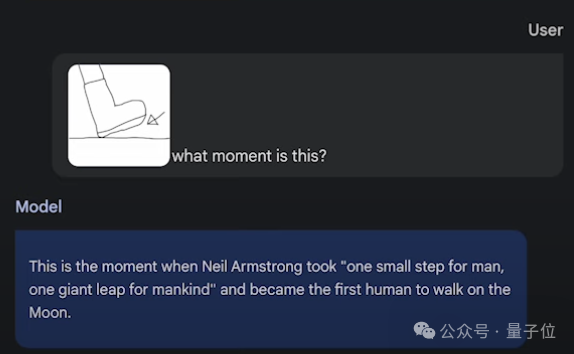

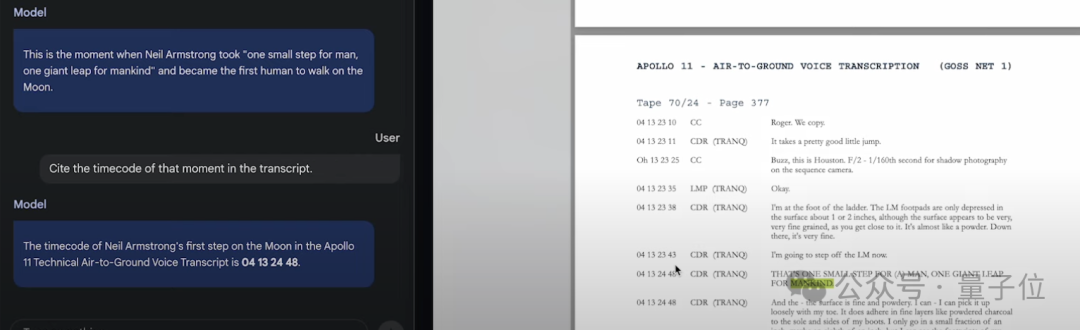

更抽象一点,绘制一个靴子的图片,询问模型“这是什么时刻”。

模型正确地将其识别为这是Neil在月球上的第一步:

最后同样可以询问模型快速定位这一时刻在文档中对应的时间位置:

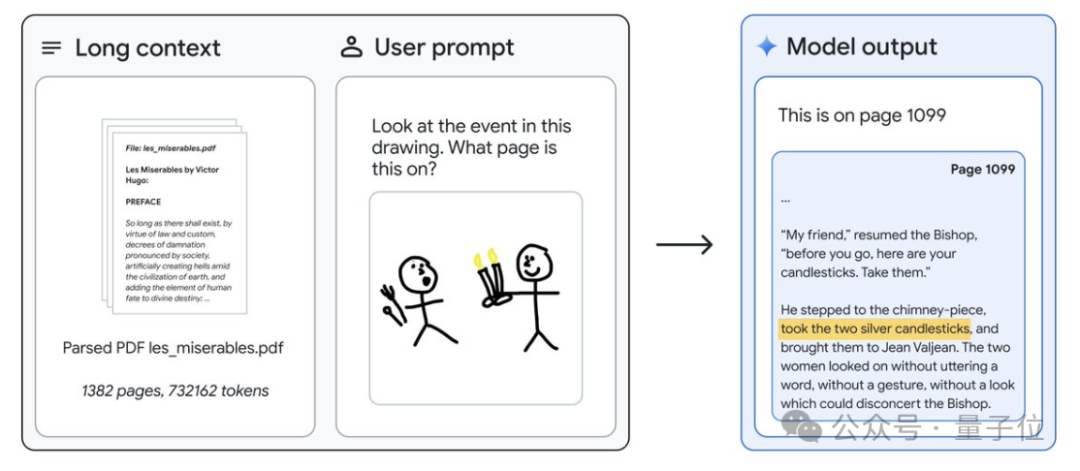

差不多的抽象风同样适用于1382页、732000 token的《悲惨世界》,一张图定位小说位置。

仅从提示词中学会一门新语言

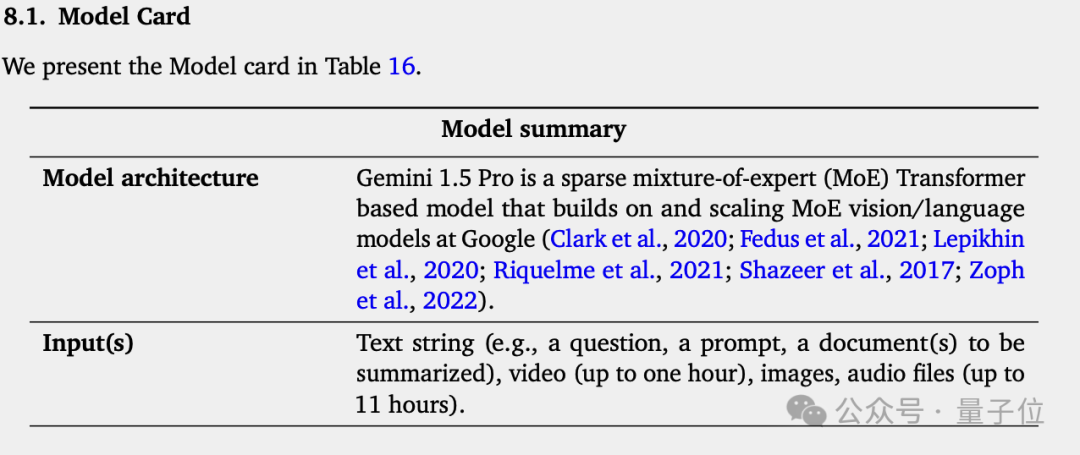

对于Gemini 1.5的技术细节,谷歌遵循了OpenAI开的好头,只发布技术报告而非论文。

其中透露Gemini 1.5使用了MoE架构,但没有更多细节。

与上代1.0 Pro相比,1.5 Pro在数学、科学、推理、多语言、视频理解上进步最大,并达到1.0 Ultra层次。

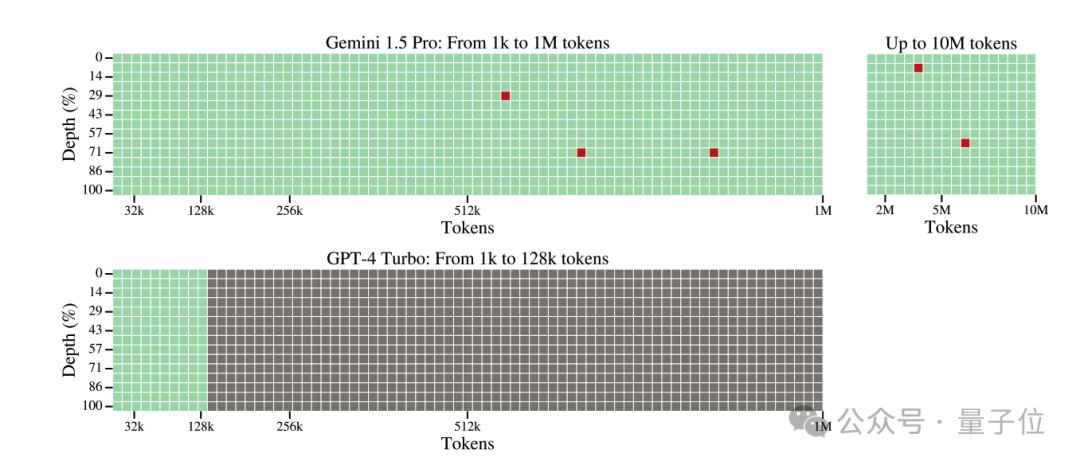

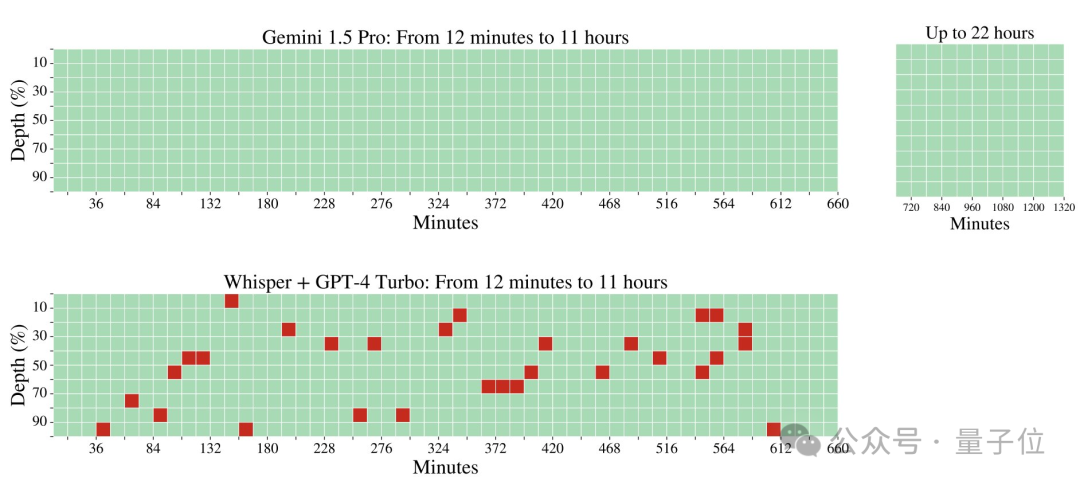

为验证长上下文窗口的性能,使用了开源社区通行的大海捞针测试,也就是在长文本中准确找到可以藏起来的一处关键事实。

结果50万token之前的表现非常完美,一直到千万token,Gemini 1.5也只失误了5次。

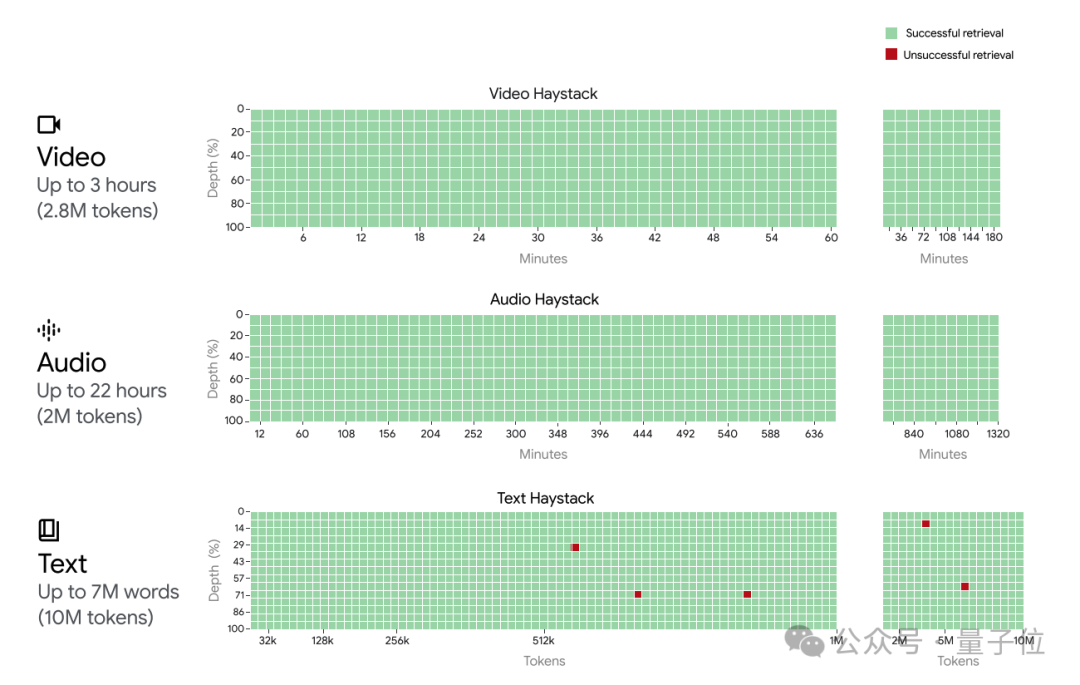

此外还将测试扩展到多模态版本,如在视频画面的某一帧中藏一句话,给的例子是在阿尔法狗的纪录片中藏了“The secret word is ‘needle’”字样。

结果在视频、音频测试中都实现了100%的召回率。

特别是音频中,对比GPT-4+Whisper的结果,差距非常明显。

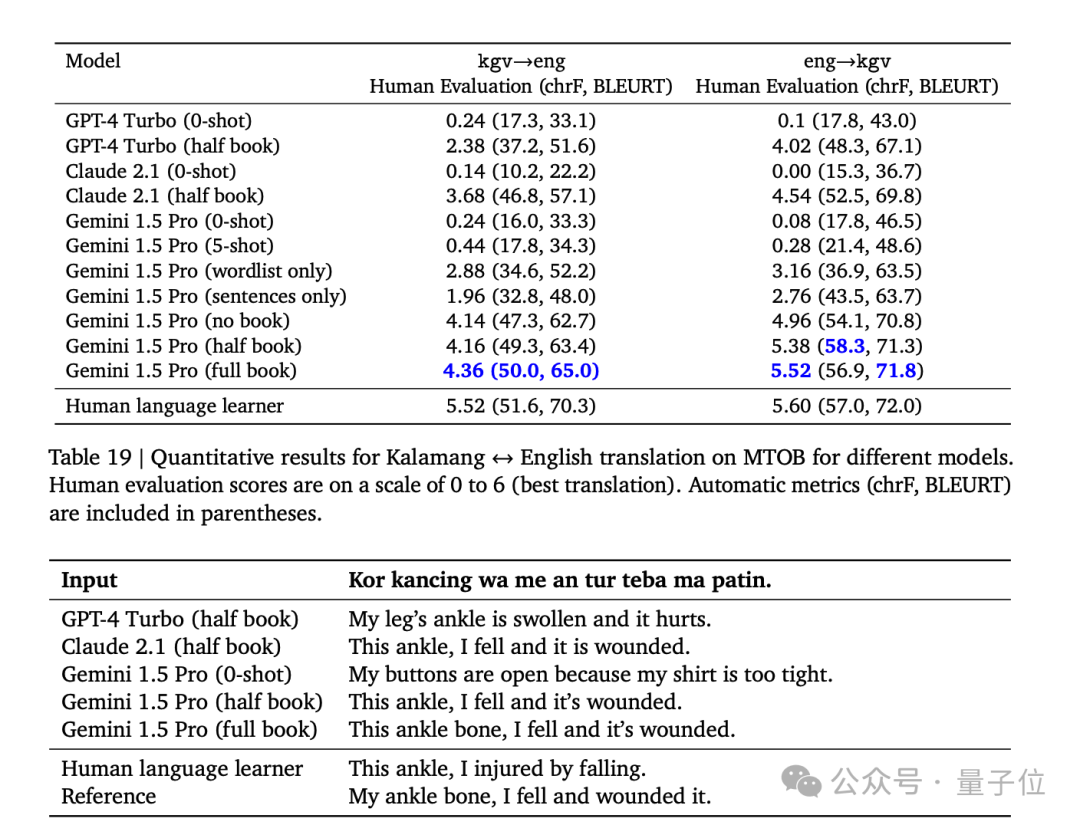

此外谷歌DeepMind团队还测试了一项高难任务,仅通过长提示词让模型学会全新的技能。

输入一整本语法书,Gemini 1.5 Pro就能在翻译全球不到200人使用的Kalamang上达到人类水平。

相比之下,GPT-4 Turbo和Claude 2.1一次只能看完半本书,想获得这个技能就必须要微调或者使用外部工具了。

也难怪有网友看过后惊呼,“哥们这是要把RAG玩死啊”。

One More Thing

谷歌还公布了一波已在业务中采用Gemini大模型的客户。

其中有三星手机这样的大厂,也有像Jasper这种靠GPT起家的创业公司,甚至OpenAI董事Adam D‘Angelo旗下的Quora。

与OpenAI形成了直接竞争关系。

对此,一位网友道出了大家的心声:

真希望这能促使OpenAI发布他们的下一代大模型。

参考链接:

[1] https://twitter.com/JeffDean/status/1758146022726041615

[2] https://storage.googleapis.com/deepmind-media/gemini/gemini_v1_5_report.pdf

[3] https://blog.google/technology/ai/google-gemini-next-generation-model-february-2024/#gemini-15

— 完 —

点这里👇关注我,记得标星哦~

一键三连「分享」、「点赞」和「在看」

科技前沿进展日日相见 ~

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง