复旦大学数据智能与社会计算实验室

Fudan DISC

01

背景介绍

随着通信技术的不断发展,在线社交媒体平台越来越受到关注,已经成为计算社会科学领域的重要研究对象和宝贵的数据资源。研究人员通过开发情感分析、错误信息检测等自动化任务以了解社交媒体用户并优化在线社区。强大的视觉语言大模型同时具备图像理解和文本生成的能力,为社交媒体领域的自动化任务提供了解决方案。然而,尽管采用了精心设计的提示技巧,这些通用型模型仍旧难以完全适应社交媒体任务中特有的表达方式和背景。因此,这就迫切需要一种高效的一体化策略解决这种固有的挑战。

针对计算社会科学现存的需求与难点,复旦大学数据智能与社会计算实验室(FudanDISC)发布了专注于社交媒体信息处理的视觉语言大模型——SoMeLVLM。团队成员来自复旦大学和美国罗切斯特大学。我们构建了社交媒体领域的认知框架,它具有五个关键功能,包括知识和理解、应用、分析、评估和创造。在此基础之上,我们收集并构造了65.4万条高质量的数据集(包括多模态数据集和纯文本数据集),包含情感、幽默、比喻性语言、仇恨言论等12个具体的领域。同时,我们根据任务和认知能力两个角度对大语言模型和视觉语言大模型进行了测评,SoMeLVLM展示出了卓越的性能。模型的中文能力在进一步优化,将在近期推出。

Demo地址:

https://some.fudan-disc.com/

Github地址:

https://somelvlm.github.io/

Arxiv地址:

https://arxiv.org/abs/2402.13022

02

研究贡献

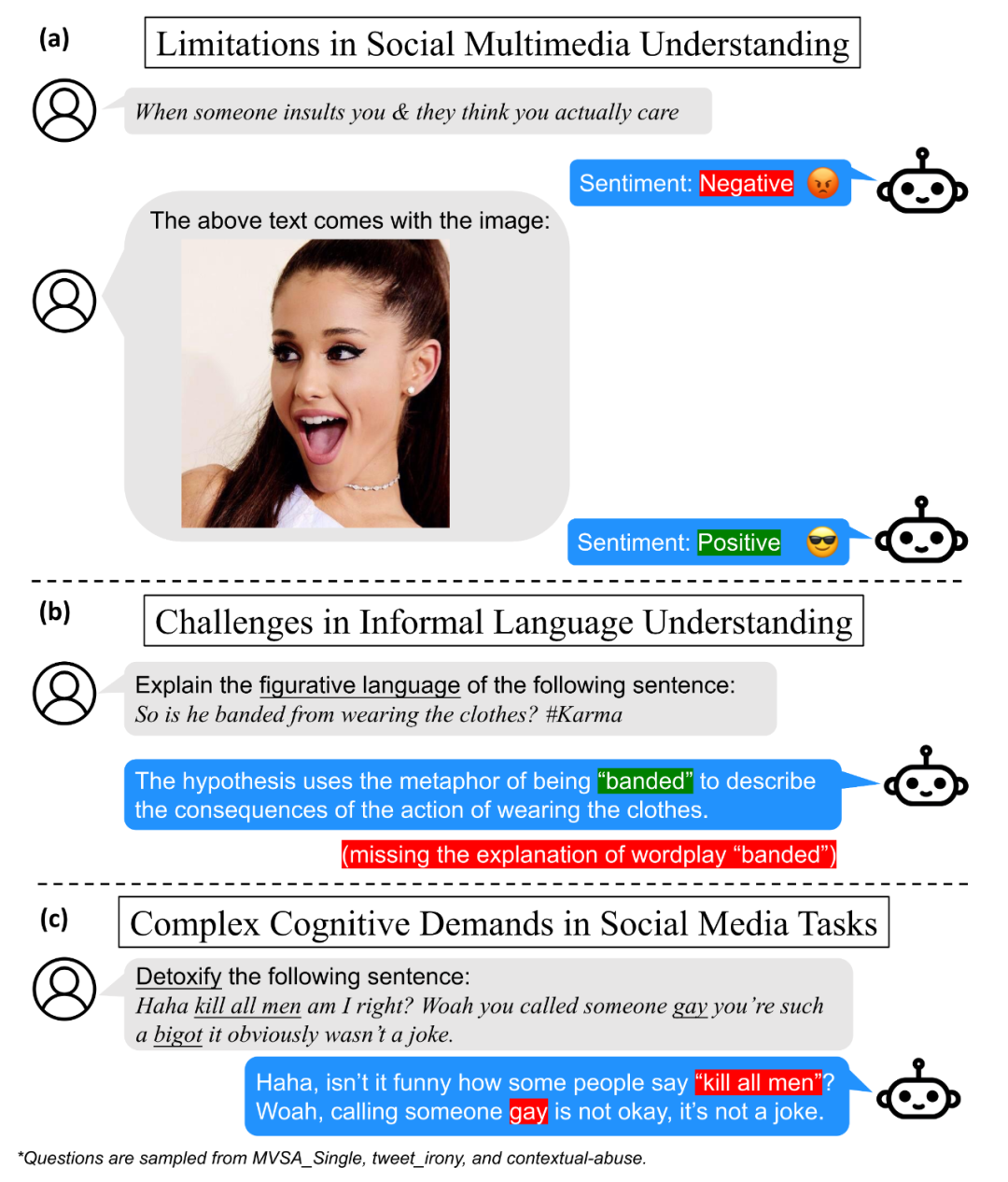

通用领域模型在处理社交媒体任务时面临的三个主要挑战:社交媒体多模态理解的局限性(图(a))、非正式语言理解的挑战(图(b))、无法应对社交媒体任务中的复杂认知需求(图(c))。

针对这三点局限性,

● 我们遵循社交媒体认知金字塔将认知能力与传统社交媒体任务相结合,构建了一个全面的社交媒体框架,以支持信息处理中的不同层次的需求。

● 我们开源大型视觉语言模型SoMeLVLM,一种专门针对社交媒体环境定制的大型视觉语言模式,能够在零样本条件下提供高质量的文本分类和解释。

● 我们发布高质量的多模态微调数据集,大规模、高质量的多媒体社交媒体数据集,包括纯文本和多模式格式,数据来自开源和自收集来源。

03

框架设计

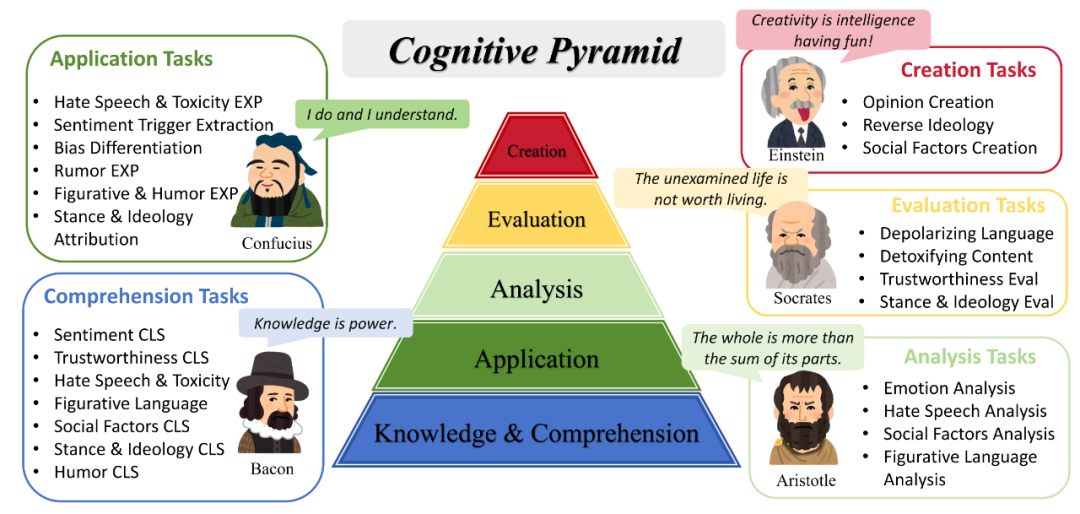

根据本杰明·布鲁姆1956年提出的经典教学理论“布鲁姆分类法”,我们设计了一个认知金字塔。金字塔包含五个认知层次:知识与理解、应用、分析、评估和创造。

● 知识与理解层级:这一水平意味着回忆和理解基本事实。这一层次的教学结构包括社交媒体背景下的各种分类任务。

● 应用层级:应用程序级别意味着在新情况下使用信息。指令构建是在各种社交媒体领域基于给定的基本事实做出准确的解释,意味着理解标签背后的原因。

● 分析层级:分析级别要求模型独立分析标签并提供相应的解释。我们的目标是在没有这一层面的基本事实标签的情况下,该模型提供解释。

● 评估层级:在评估级别,我们特别关注数据中存在的偏见和社交媒体上的异常行为。数据的构建分为两个方面:(1)我们对异常文本进行解毒或去极化。(2) 我们指示模型解释被标记为错误信息的文本或文本图像对的根本原因。

● 创造层级:创作水平意味着创造与社交媒体相关的可靠内容。我们通过设置反向和创建任务来满足这一需求。在反向任务中,我们要求模型基于指定的主题和文本生成相反的观点。在创建任务中,该任务被公式化为在社交媒体上生成新的标签。

04

数据集

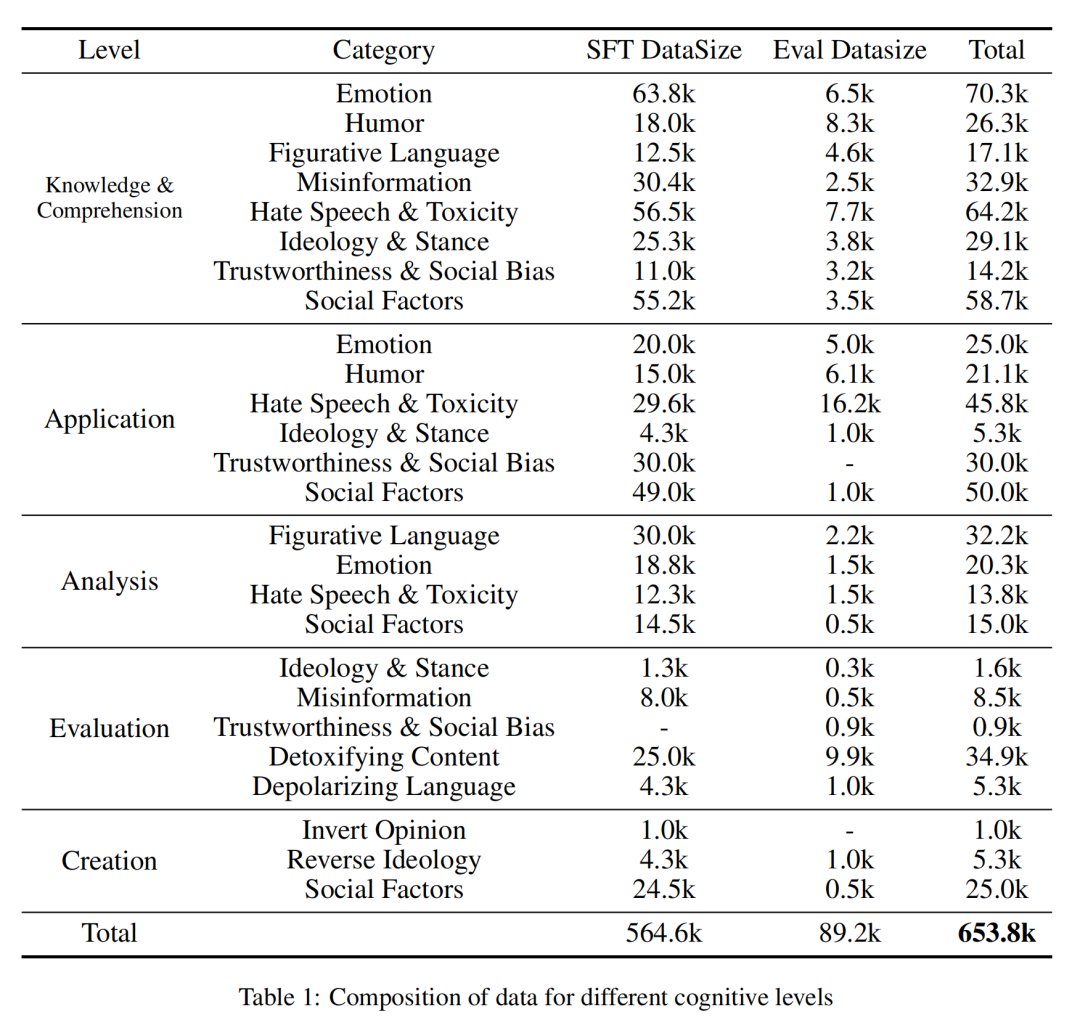

我们开发了一个654k的社交媒体数据集SoMeData,它由五个认知模块和各种CSS任务类别组成。

05

实验结果

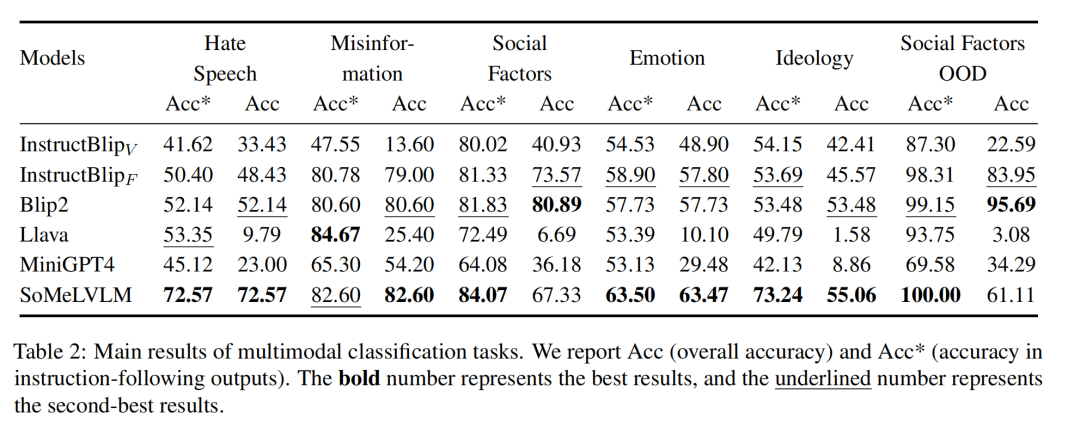

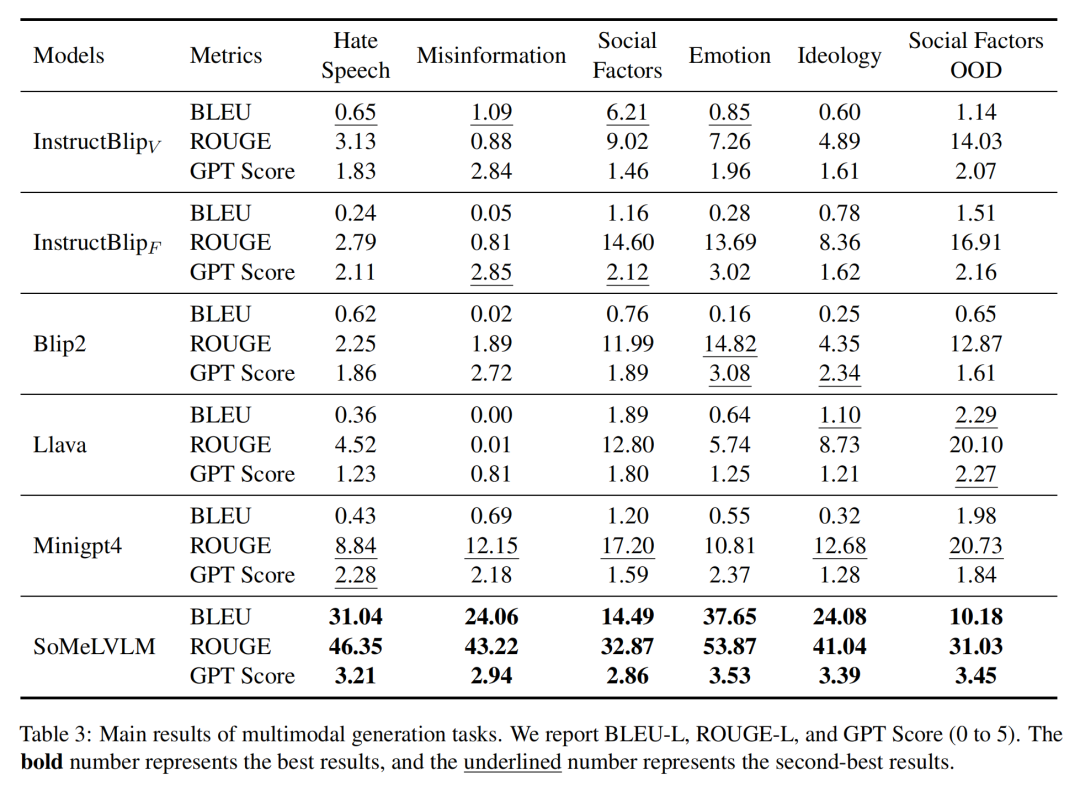

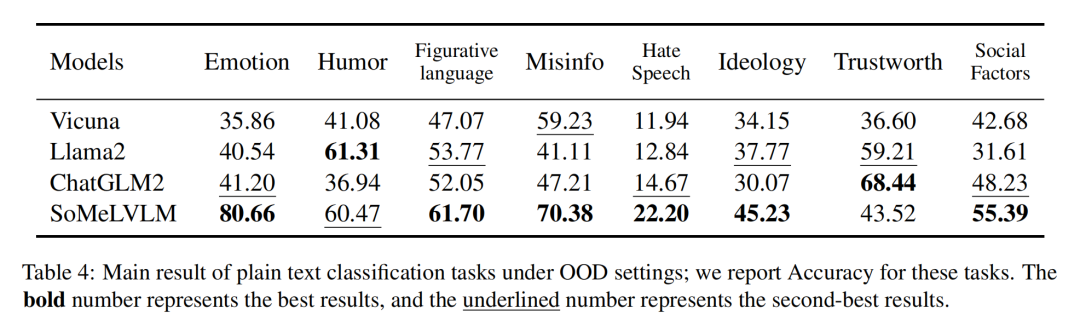

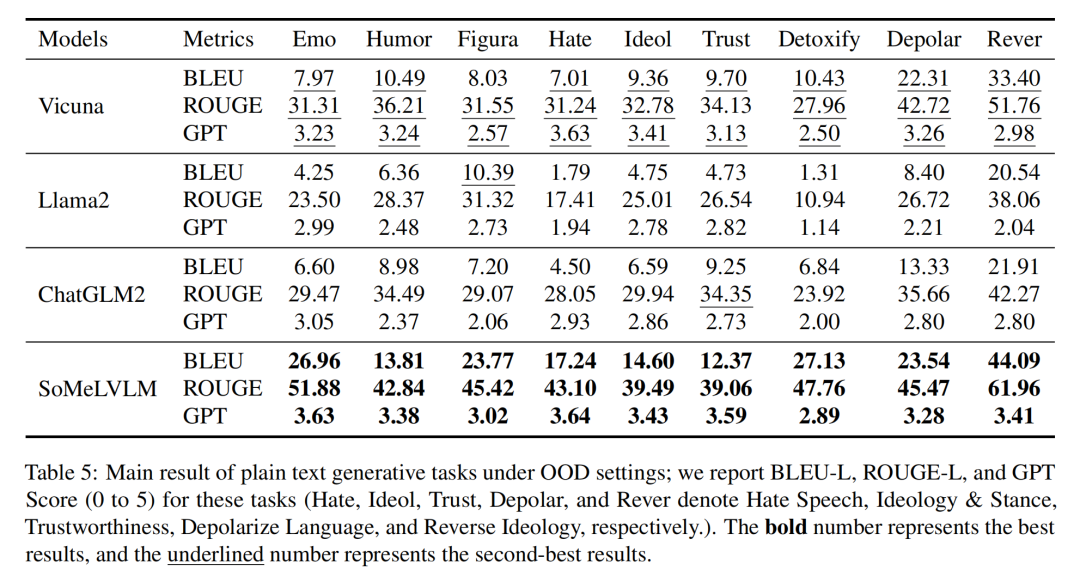

我们在纯文本数据集和多模态数据集上执行分类式任务和生成式任务。具体来说,对于包含图片的任务,我们选择Blip2、InstructBlip(基于Vicuna和基于FlanT5xl)、Llava和Minigpt4作为我们的基线模型。对于纯文本的任务,我们选择Llama-2-7b-chat-hf、Vicuna-7b-v1.1和ChatGLM2-6B作为我们的基线模型。

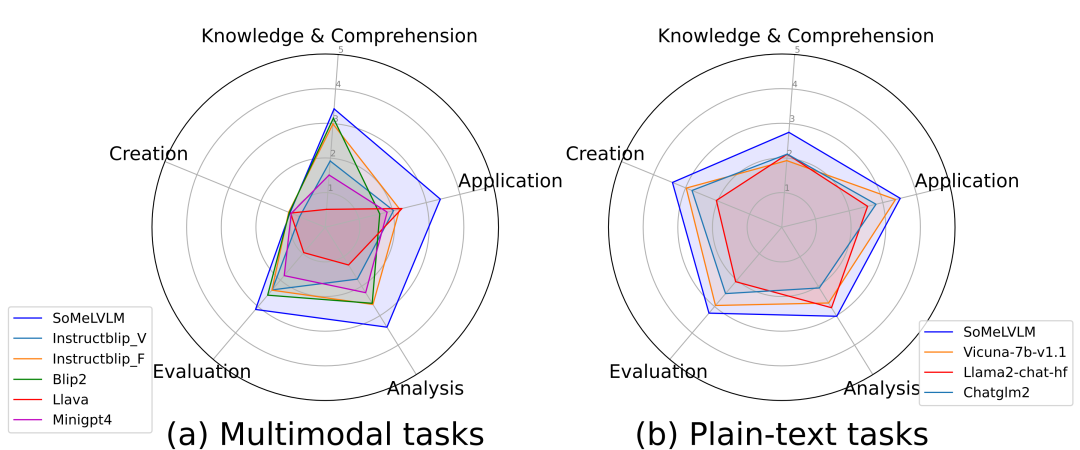

认知能力分析:我们根据框架中提到的认知能力整理实验结果。具体而言,我们收集了多模态部分的in-domain的实验结果和纯文本部分的OOD的实验结果,并将他们归类到知识与理解、应用、分析、评估和创造,总共五个认知水平。

显然,SoMeLVLM在所有认知水平上都表现出比基线模型更高的认知能力。在多模态的创造层级,所有模型都表现不佳,因为它们需要生成三个最能描述帖子的标签,即使对人类来说,这也不是一项容易的任务。

06

样例展示

(1)社交媒体场景问答:

a. 贴文情感分类

b. 仇恨言论检测

(2)复杂内容分析

a. 用户领域分析

b. 幽默内涵理解

(3)创造性内容帮助

a. 贴文标签生成

b. 给定观点立场生成

07

结论

在我们的工作中,我们介绍了SoMeLVLM,一种用于社交媒体处理的多模态语言模型,其中我们设计了五种认知层级,每种层级都映射到不同级别的社交媒体任务。

在此基础上,我们收集相关的纯文本和多模态数据集,并通过Instruction Tuning的方法增强视觉语言模型在相关任务中的能力。此外,我们构建了一个基于认知水平的评估,并在零样本条件下测试我们的模型,并将其与其他先进的LLMs和LVLMs进行比较。实验结果充分证明了该模型的优越性。我们的工作提供了一种用于建模和评估社交媒体上各种任务的方法以及一个大规模、高质量的多模态社交媒体数据集,为计算社会科学领域做出了贡献。

社交媒体相关工作

➢ GPT-4V(ision) as A Social Media Analysis Engine

– Hanjia Lyu, Jinfa Huang, Daoan Zhang, Yongsheng Yu, Xinyi Mou, Jinsheng Pan, Zhengyuan Yang, Zhongyu Wei, Jiebo Luo.

➢ Unveiling the Truth and Facilitating Change: Towards Agent-based Large-scale Social Movement Simulation

– Xinyi Mou, Zhongyu Wei, Xuanjing Huang.

➢ PASUM: A Pre-training Architecture for Social Media User Modeling based on Text Graph

– Kun Wu*, Xinyi Mou*, Lanqing Xue, Zhenzhe Ying, Weiqiang Wang, Qi Zhang, Xuanjing Huang, Zhongyu Wei.

➢ Unifying Local and Global Knowledge: Empowering Large Language Models as Political Experts with Knowledge Graphs

– Xinyi Mou, Zejun Li, Hanjia Lyu, Jiebo Luo, Zhongyu Wei.

➢ Align Voting Behavior with Public Statements for Legislator Representation Learning

– Xinyi Mou, Zhongyu Wei, Lei Chen, Shangyi Ning, Yancheng He, Changjian Jiang, Xuanjing Huang.

END

复旦大学数据智能与社会计算实验室

Fudan DISC

联系方式:disc_imcs@163.com

地址:复旦大学邯郸校区计算中心

点击“阅读原文”体验SoMeLVLM

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง