龚克

世界工程组织联合会前主席,中国新一代人工智能发展战略研究院执行院长、清华大学人工智能国际治理研究院学术委员会委员

“人工智能是先进生产力,它正在以前所未有的深度、广度和速度,进入我们的生产和生活。它还不成熟,存在着固有的缺陷,存在着被滥用的可能,需要对它进行治理,但这不能成为阻碍它发展的理由——对于人工智能,不发展就是最大的不安全。”中国新一代人工智能发展战略研究院执行院长、清华大学人工智能国际治理研究院学术委员会委员龚克在国家科技传播中心讲坛上发表如上观点。《国家科技传播中心讲坛》是中国科协打造的新型演讲类新知栏目,以科学精神,科技探索和科技产业为主要讲述内容,汇集相关领域顶尖科技工作者讲述科技创新故事,传播前沿创新成果,弘扬科学家精神。本文摘选部分内容以飨读者。

对人工智能可以有很多不同看法,我这里强调三点。第一,人工智能是一个不可抗拒的、加速发展的新质生产力。第二,它正在经历着重大的技术突破——不是“经历了”,是“经历着”,它整个还处在重大的技术突破过程中。第三,它还不成熟,但是已经在用了,而且是越用越广,它的风险需要被控制。

人工智能是一项技术,是一项要完成人类规定的,或者人类所需要的任务的技术。它通过什么办法来完成?通过模仿人类的智能行为。人类智能行为需要分成四个步骤来完成:首先是感知,在感知基础上有认知,认知之后叫谋行,即谋划行动,最后是执行。

ChatGPT开创了

人工智能发展的新阶段

人工智能发展已经有70多年历史了。过程中有几个重要的节点,其中最重要的是1956年,在美国达特茅斯举行了一次会议,一群年轻人在当年夏季的研讨会中提出了人工智能的概念。这群人中岁数最大的一位是Claude Shannon,他是信息论的创始人,当时他已经是MIT正教授,也不过才39岁。

进入新世纪,华裔科学家李飞飞建立了一个有1500多万张标注好的图片的巨大数据库,全世界搞图像识别的人可以用这个数据库对AI进行训练,然后进行识别。最初这个比赛表现最好的五个团队,平均错误率达到28%,然后逐年下降。作为对比,人类识别的误差率在5%-10%之间。到了2012年 、2013年的时候,AI就逼近了人类的水平。

这个进步,科学家依赖的是一种叫做深度神经网络的算法。从那以后,所有最好的团队都用深度神经网络,很快就突破了人类界限,错误率直逼3%以下。这一巨大的成功使得图像识别变成了第一项成熟的人工智能应用,人工智能从论文和实验室走到了我们的生产和生活之中。

2022年11月30日发生了一件事情,OpenAI宣布他们的一个产品诞生,这个产品叫ChatGPT,我们现在把它称为生成式的人工智能。它可以模仿人类生成文本、剧本、图像、视频,以及程序的代码。这是一个重要的进步,我们认为它开创了人工智能发展的新阶段。

从技术上看,这个新阶段是由于有巨大参数的大模型同一系列其他技术相结合,实现了对语意的基本掌握。我们知道,所有的人类语言中用了很多词汇,但是同一个词汇在不同的上下文之间,可以表达不同的语意。这个大训练模型利用了很长的文本,使得每一个词的语意得到相对比较准确的表达。

从应用上看,chat也是非常重要的。在这之前比较有名的AI有Deep Blue(深蓝),是下国际象棋的。后来出现下围棋的AlphaGo。在中国,下国际象棋的人不多,下围棋的可能多一点,但依然不是所有人都下围棋。现在到了chat,everyone chats,所有人都会聊天,通过聊天把人工智能推向了所有的人。我想这是在应用上一个重大的进步。

但这也引起了社会上的一些焦虑,担心AI会不会最后超过我们人类、它和人类是什么关系、人类能不能有效地管控它、它会不会终结我们人类。在这种情况下,去年3月份,包括Elon Musk在内的一批名人,就发出一个呼吁,说是要把人工智能的发展先停下来,至少停6个月。

但事实上它并没有停下来。2023年6月份,麦肯锡做了一个调查,发现在亚太和北美地区,有40%的人在工作或生活中常规性地在使用AI;在技术领域和传媒领域,甚至有50%的人在使用生成式AI——那时离ChatGPT出现只有半年的时间。这说明人工智能已经实实在在地走进了我们的生产和生活,这是一个挡不住的、重要的、历史性的趋势。

根据预测,从2023年到2030年,人工智能将以36.8%的速度在市场发展。我不知道还有什么其他的行业可以被预测有这么高的发展速度。

自古以来,人类从茹毛饮血到男耕女织,一直到今天的超级计算,人类总是不断创造出工具来增强我们的能力,增强我们的体力,增强我们的脑力。这是人与其他动物的重要区别之一。自有文明史以来5000多年,人类在生理上并没有什么重大的变化,但是今天人类的能力,比5000年前要强得多。强在什么地方?不是我们的脑比那时候更发达了,或者是我们的骨骼比那时候更发达了,而是我们使用的工具比那时候更先进了。这个过程就是生产力的进步。

大模型如何形成智能?

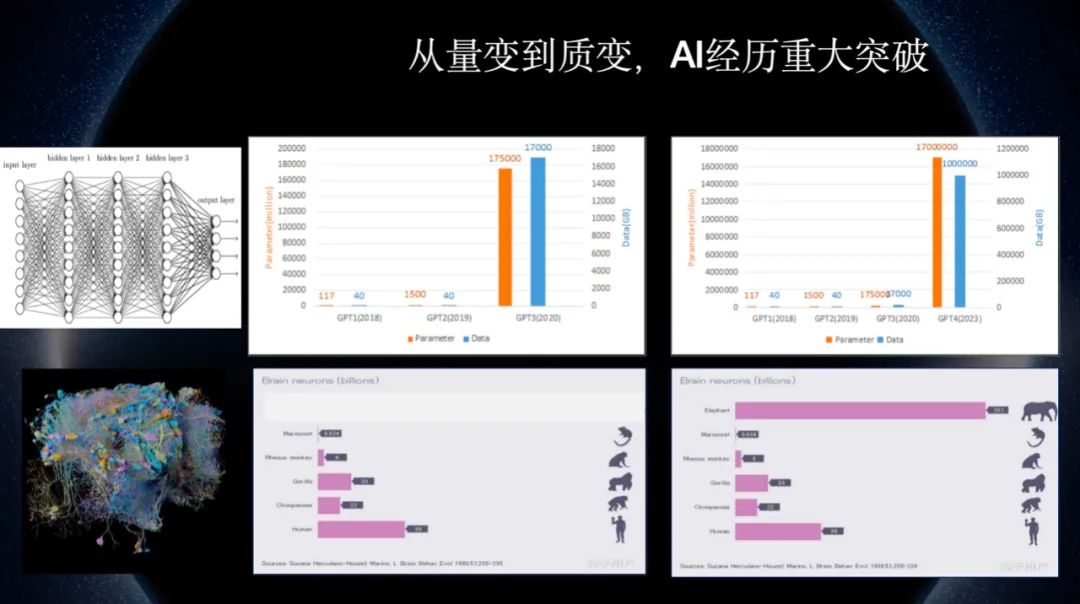

人工智能就像机械动力技术、电气技术那样,是革命性的通用技术,在所有的行业都能用,它会带来整个社会的智能化。如何实现这样的技术突破?这需要一个从量变到质变的过程。2018年刚推出来的第一代GPT,只有10亿的参数,到2019年达到了15亿的参数,有所增长;到了2020年6月份,达到了1750亿的参数,这个增长已经不是一般的量变,可以称之为突变了。现在参数又有了数百倍的增长,更是达到了几十万亿。这种量的变化给AI带来了巨大的能量。

这个参数是什么意思?指的是我们模仿人脑创造一个神经网络的模型,模型中连接点的数量。人脑有860亿个神经元,这些神经元通过触突连接起来,我们模仿它,所谓模型参数就是这种连接的数量。但模型参数是不是越大越好、把参数做到无限大的时候AI就能变得无限聪明?也不尽然。非洲大象的神经元数量比人还大至少三倍,但是它并不比人聪明。这告诉我们,简单地去增加参数数量并不能达到更好的智能效果。所以我们一方面要增加参数,另外一方面还需要技术的黄金组合。

ChatGPT一系列的技术里面,有几项特别值得一提的技术,其中一项叫 Word Embedding ,翻译成中文叫词嵌入。这是比较难懂的一个词,是把一个词嵌入到一个矢量的空间里面。这里面矢量的维数可以非常多,每一维以0或者1代表一个矢量的性质。比方说第一个维度以0和1代表它是个生物还是非生物;如果是生物,下一维度,这是动物还是植物;如果是动物,下一维度判断这是哺乳动物还是非哺乳动物;如果是哺乳动物,是地上跑的还是天上飞的……在一个高维矢量空间里,把一个词意给它确定下来,这就叫做 Word Embedding。

还有一项重要的技术,GPT的T是Transformer的首字母。Transformer我们翻译成变换器。这个变换器是干什么的?是做编码和解码用的。编码和解码会产生另一个概念,我们叫做 attention,翻译成注意力,它可以在很长的上下文中找到关键词。人看文章的时候,不是在每一个词上都平均用力的,而是迅速抓住关键词,这对AI来说也是一个重要的功能。

接下来还有一个重要的功能,叫做基于人类反馈的强化学习。就是AI说错了以后,我们告诉它:“你说得不对吧?你写得太长,要压缩。”在这个人类反馈过程中,可以把人的价值观、社会的风俗、法律的规定、技术的标准、人的审美和情绪,用语言输入给模型,让它产生你所需要的结果。

这一系列重要技术组合,才产生了今天的技术突破,而且按照我的说法,它正在经历着突破,还在往前走着。

大模型带来一个非常重要的工作模式和很多新的岗位。这个新的工作模式叫做MaaS,Model as a Service。原来我们说软件是个服务,网络是个服务,平台是个服务,现在说,模型是个服务。这个预训练的大模型会变成一个社会的基础设施,让我们的各行各业在这个预训练大模型基础上,用我们的数据和专门的知识,结合我们特定的任务,把它变成一个专用的模型。

这时候就降低了我们使用模型的门槛。即便要改进模型,也不用从头做起,我们可以拿过一个大模型来,结合我们需要用的专门的数据做精调。现在有招聘一种岗位,叫做提示工程师。提示工程师的主要工作就是跟AI对话,通过有效对话来对它进行训练。GPT工程师可以在模型基础上去改错、加工,而不是从头一行一行写C语言代码,这使得原来最低级的程序员变成了软件系列里比较高级的系统分析师。如果我们把AI看成是一辆车,我们不仅需要设计车的人和造车的人,更需要会开车的人。这就是一旦普遍使用这个工具,就会产生各行各业新的工作岗位的原因。

但人工智能的应用也是有风险的。它存在风险的一个最根本的原因在于,它在推测答案的时候,用的是概率,叫做联合分布概率。给它输入一个问题,它判断哪些词与输入的词组合形成的概率最高,那就是它选择的输出。既然它是通过概率来判断的,就不可能100%正确,总有出错的时候。人也会出错,只不过我们可以通过长期的实践、根据民主决策的程序、通过专家咨询等,来尽量减少人的错误。而对大模型,现在还存在不可解释性,还不能清晰地说明在什么样的条件下可以影响它的概率分布。

我们认为这种出错基本上会来自两个方面:一是技术内在的不完善,联合分布概率因此不可完全控制;另外一方面来自于它的滥用——再安全的车,也可以开着去撞人,不是车不好,也不是车的技术参数不好,危险来自对它的滥用。

发展人工智能

我们可以这样干

以上内容可以归结为三点:第一,人工智能是先进生产力,发展不可阻挡;第二,它正在形成大的突破,而且是以前所未有的深度、广度和速度,在进入我们的生产和生活;第三,它还不成熟,存在着固有的缺陷,存在着被滥用的可能,需要对它进行治理。在这三点基础上,我们可以讨论如何发展AI。

这里我想谈五个关键词:创新、应用、平台、治理、人才。

创新和应用是一个相互迭代的过程,是相互促进的,没有创新就没有有效的应用。在此我借用一下“深度学习”中的“深度”概念,提出深度的创新和深度的应用。深度创新,指的是要在根上创新,要突破模型可解释性问题,我们不能总是把别人做的模型拿过来做fine tuning。我们有没有可能在类脑神经模型上做新的突破?就是把前文说的MaaS这个模型作为一个服务给广泛推出,在应用大模型基础上,把人工智能从chat推向product,变成了product以后,才能真正发挥效益。

这里我给大家举一个例子。现在一些头部的企业已经在推出面向行业的应用,但这些应用需要跟行业更紧密地结合,把它真正落到生产的深部。我们研究院做了一个试验,到全国开展自动驾驶网联车的那些城市去发调查问卷,分成坐过网联车的和没坐过网联车的。我们看到无论是试验组还是对照组对自动驾驶汽车上路进行测试,都持积极的态度,其中坐过的(试验组)态度更为积极。拿武汉举例,自动驾驶出租车推出商业服务不到500天的时间,有一个人就用了900多次,差不多一天用两次自动驾驶车接送他的孩子。这说明这项技术在中国有比较好的接受度,我们可以在大规模应用过程中完善技术。

创新和应用之外,我们发现了一个更重要的现象:创新和应用在中国的发展是由平台支撑的。我们调查了全国的2205家人工智能企业,看这些人工智能企业的资金从哪里来,投资向哪里去;看他们的人才从哪里来、人才跳槽向哪里去;看他们的技术从哪里来,如果输出技术向哪里去。人、才、技术形成了这些企业之间的相互联系。

在这两千多家企业的背后,我们发现了一大批投资者、一大批科研院所、一大批政府的科研园区等。其中有15家企业是科技部命名的,叫人工智能开放创新平台。这15个开放创新品牌,在这两千多家企业中起到了重要的推动作用。这是一个平台推动的发展生态。

我们需要建立一批跨界的创新组织,用这些创新组织来探索这种由平台驱动的新质生产力,形成更好的上层建筑(生产关系),来加快创新应用的循环,推动产业的新生态,实现人工智能和实体经济的深度融合。这是写进我们党的十九大报告的一句话:推进人工智能和实体经济深度融合。

还有一个关键词是治理。在这里,治理的对象是一种生产力,而且是一种先进的生产力,我们要以是否能解放和发展这种生产力作为治理的标准。最忌讳的,就是用现存的生产关系来约束正在迅速发展的先进的新质生产力。切记不能把这一生产力的发展和它的安全给对立起来——不发展就是最大的不安全,我们要治理它,首先就要把它发展好,要发展好就要鼓励从根上创新,没有根上的创新就没有根上的安全,就实现不了发展。

目前我们国家建立了基于风险的、对人工智能的治理机制,划出了一些高风险应用。比如把脑机接口植入到人的大脑里,风险就比较高,这样的应用就属于高风险应用。

智能化社会来了,我们需要全民的人工智能素质,但是不需要社会焦虑。现在有些完全不必要的社会焦虑,它们的存在只会对人工智能的发展、对生产生活的高质量发展带来毫无必要的干扰。

最后一个关键词是人才。有人评估说,光是中国人工智能领域,相关岗位就缺500万,现在我们就要把这500万人给培养出来。但还不止于这500万,我们整个已经进入人工智能时代,这个时代所有合格公民都应该具备人工智能相应的素质,能够学会驾驭人工智能。这就需要对我们的教育系统提出新的要求。

应用人工智能,特别要注意的是我们可以驾驭而不可以依赖这个工具——必须清楚,AI生成的只是半成品,它要经过人类的审视、人类的加工,才能变成一个真正的成品。我们要对它做factual check、logic check、ethical check,也就是做事实的、逻辑的、伦理的审查。这里有个词叫做critical thinking,翻译成批判性思维,其实我觉得翻译成审辩思维更好。

概括起来,我们现在需要为AI立心。联合国有一个口号,The AI we want is the AI with human values for sustainable development,“我们需要具有人类价值观的、可持续发展服务的AI”。

关于我们

清华大学人工智能国际治理研究院(Institute for AI International Governance, Tsinghua University,THU I-AIIG)是2020年4月由清华大学成立的校级科研机构。依托清华大学在人工智能与国际治理方面的已有积累和跨学科优势,研究院面向人工智能国际治理重大理论问题及政策需求开展研究,致力于提升清华在该领域的全球学术影响力和政策引领作用,为中国积极参与人工智能国际治理提供智力支撑。

新浪微博:@清华大学人工智能国际治理研究院

微信视频号:THU-AIIG

Bilibili:清华大学AIIG

来源 | 本文转载自科协之声,点击“阅读原文”获取更多内容

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง