王家豪 投稿自 凹非寺

量子位 | 公众号 QbitAI

GPT-4o再次掀起多模态大模型的浪潮。

如果他们能以近似人类的熟练程度,在不同领域执行广泛的任务,这对许多领域带来革命性进展。

因而,构建一个全面的评估基准测试就显得格外重要。然而评估大型视觉语言模型能力的进程显著落后于它们自身的发展。

来自上海AI Lab、香港大学、上海交大、浙江大学等多家机构提出了 MMT-Bench。

这是一个全方位的多模态基准测试,旨在全面评估大型视觉语言模型(LVLMs)在多模态多任务理解方面的表现。

研究团队还对当前几个代表的视觉大模型进行了能力评估,结果发现感知错误、推理错误是所有模型最常见的两大错误。

多模态多任务AGI基准测试MMT-Bench

MMT-Bench的广度体现在三个方面。

首先,MMT-Bench数据经过精心设计,包含32K个多选视觉语言问题,涵盖了32个核心元任务和162个子任务,这比此前的评测数据集MMBench大8.1倍。

其次,MMT-Bench包含了13种图像类型,如自然场景、合成图像、深度图、富文本图像、绘画、屏幕截图、点云、医学图像等。这样的图片多样性要求模型能够解释理解各种视觉输入。

第三,MMT-Bench涵盖了多种多模态情景,如车辆驾驶、GUI导航和具身AI,测试了14种多模态能力,包括视觉识别、定位、推理、OCR、计数、3D感知、时间理解等。

构建评测任务 。

MMT-Bench的评测任务在构建时旨在包含尽可能多的多模态任务。为此,研究人员首先提出多模态理解的元任务。然后,通过去重和筛选重要任务总结出32个元任务。

接着,将每个元任务分解为几个子任务。子任务是否被保留在MMT-Bench中,需要满足三个标准:

- 1、子任务是否检验了基本的多模态能力;

- 2、子任务对当前的大型视觉语言模型(LVLMs)是否具备挑战性;

- 3、子任务的测试样本是否可以公开获取。

经过选择,MMT-Bench共包含了162个子任务,这比之前任务最多的评测集TinyLVLM-eHub大3.8倍。

MMT-Bench与此前评测数据的详细比较如下表所示。

数据收集。

MMT-Bench的研究人员设计了一个高效的数据收集流程,以构建每个子任务的多选视觉语言问题评估数据。

首先,他们通过Google、Paper With Code、Kaggle和ChatGPT等多种数据来源,根据子任务的名称全面搜索相关数据集。下载数据集后,再细致地评估它们是否适合评估子任务,确保数据集的可用性和相关性。

接着,研究人员定义了一种统一的元数据格式,用于整理下载的数据集。每个元数据样本包括图像和元信息,其中元信息包括生成评测问题和答案所需的必要信息,以及所需推理能力的标注信息和视觉图片的类型。

为了提高评估效率,在每个任务中,研究人员通过随机抽样将样本数量最大限制为200,并且每个数据集包含相同数量的样本。

最后,对于每个子任务,研究人员从它们的元数据中生成多选视觉语言问题及其选项和答案。具体来说,根据特定任务,研究人员或手动设计规则,或使用ChatGPT来进行高质量的QA生成。

例如,在基于草图进行图像检索的任务中,使用对应的图像作为正确答案,并从元数据中随机抽取其他图像来生成错误选项。而在生成视频描述的任务中,则使用ChatGPT编写容易混淆的错误选项。

综上,MMT-Bench共包含31,325个精心设计的多选问题,涵盖13种输入图像类型,如自然场景、合成图像、富文本图像、医学图像等,覆盖32个核心元任务和162个子任务,用于多任务多模态理解。

与之前的LVLMs基准测试相比,MMT-Bench中的问题涵盖了多种多模态场景,如GUI导航和文档理解,测试了包括视觉识别、定位、推理、OCR、计数、3D感知、时间理解等14种能力。这些特点确保MMT-Bench满足评估多任务AGI的任务广度要求。

评测结果

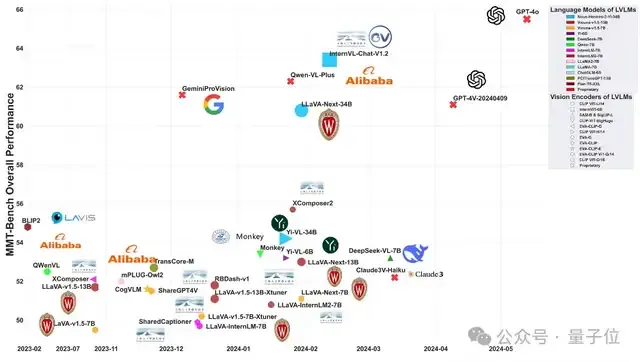

研究人员基于MMT-Bench对30种公开可用的大型视觉语言模型(LVLMs)进行了综合评估。

结果显示MMT-Bench的基准测试给现有的LVLMs带来了重大挑战,即使是InternVL-Chat、GPT-4o和GeminiProVision等先进模型,其准确率也仅分别为63.4%、65.5%和61.6%。

综合而言,闭源的专有模型GPT-4o目前在MMT-Bench中取得了领先地位,超过了InternVL-chat、QWen-VL-Plus、GPT-4V和GeminiProVision等其他模型。

值得注意的是,开源模型InternVL-chat和QwenVL-Max正紧随GPT-4o之后,这为未来开源社区模型能与闭源专有模型竞争甚至超越它们的前景增添了信心。

在所有元任务的评测结果中,研究人员还发现:

1)大多数大型视觉语言模型在视觉识别(Visual Recognition)和视觉描述(Visual Captioning)任务中表现出色,凸显了LVLMs在识别“物体是什么”和描述图像中展示内容的能力。然而,对于精细感知任务(如定位、像素级感知等)或复杂推理任务(如图像评测判断),大多数LVLMs仍表现较差。

2)对于LLaVA-v1.5和LLaVA-v1.5-Xtuner,随着模型大小的增加(从7B增加到13B),其性能显著提高,而从InternLM升级到InternLM2也提高了LLaVA的性能。这表明即便保持训练数据和视觉编码器保持不变,采用更大或改进的LLMs也能够提升多任务性能。

3)BLIP2即使没有经过指令调整,也在性能上超过了大多数经过数百万指令数据调整的LVLMs,这表明在某些任务中使用指令调整的数据甚至可能损害其他任务的泛化能力。

任务地图。

得益于MMT-Bench中任务的广泛覆盖,研究人员可以在任务地图上评估LVLMs的多模态性能。

通过分析任务地图中任务之间的关系,可以系统地解释不同任务在多模态能力中的作用。基于任务地图,研究人员发现LVLMs在彼此相近的任务上获得更一致的性能排名。此外,任务地图还可以用来发现领域外(OoD)任务和领域内任务。

错误分析。

为了分析LVLMs在MMT-Bench上的错误分布,研究人员检查了三个LVLMs:GPT-4V、GeminiProVision和InternVL-Chat-V1.2(简称InternVL)。

结果发现,感知错误(Perception Error)是所有模型中最常见的错误类型。

其中GPT-4V的感知错误率显著低于GeminiProVision(76.9%)和InternVL(67.2%),表明其在感知任务中的表现优越。

推理错误是第二常见的错误类型,其中InternVL的推理错误率最高(14.8%),其次是GeminiProVision(10.4%)和GPT-4V(9.94%),这凸显了所有模型在复杂推理任务中所面临的挑战。

最后简单一下,MMT-Bench是一个旨在评估LVLMs在多模态多任务理解方面的一个综合性基准测试。MMT-Bench的广度体现在其精心构建的包含31325个多选问题的数据上,这些问题涵盖了162个多模态任务。

评估结果揭示了当前LVLMs仍面临由MMT-Bench所带来的重大挑战。MMT-Bench的目标是衡量LVLMs在多任务AGI路径上的进展,并在未来将继续扩展其所涵盖的任务集。研究人员相信,MMT-Bench将进一步激发LVLMs的研究和开发,使得人们能够更接近实现真正智能的多模态系统。

论文地址:

https://arxiv.org/abs/2404.16006

项目主页地址:

https://mmt-bench.github.io/

代码地址:

https://github.com/OpenGVLab/MMT-Bench

数据集地址:

https://huggingface.co/datasets/Kaining/MMT-Bench

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง