蚂蚁专用模型超越o3!仅用2K训练样本刷新医疗AI榜单纪录

参数规模不是唯一解药,Agent Data才是破局关键

MedResearcher-R1团队 投稿

量子位 | 公众号 QbitAI

不卷参数的专业模型,会不会被通用大模型取代?

在医疗领域,这个疑问正在被打破。

蚂蚁集团联合研究团队发布的《MedResearcher-R1: Expert-Level Medical Deep Researcher》技术报告,证明了一条关键路径:专业开源模型只要做好领域化设计,有机会在垂直赛道上“以小博大”,反超通用大模型。

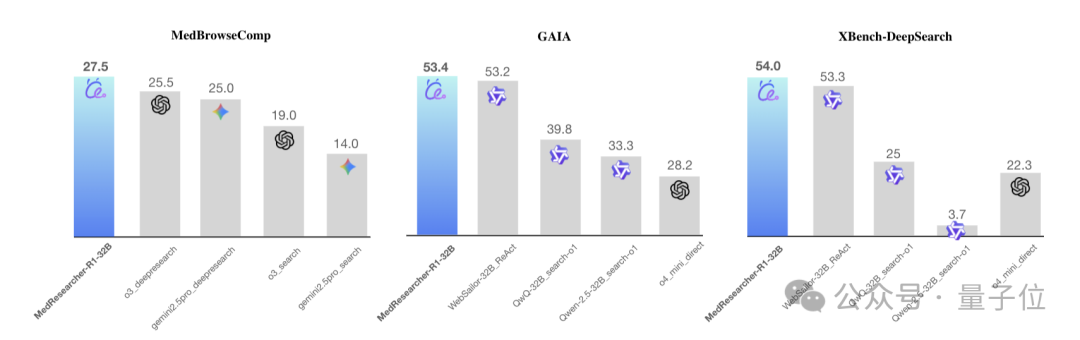

团队发布的医学AI智能体MedResearcher-R1,靠2100条(约2K规模)训练样本,在权威医疗基准测试MedBrowseComp上,将复杂医疗研究任务的准确回答数量提升至27.5。

刷新该榜单纪录的同时,超过o3、Gemini 2.5 Pro等领先通用大模型,突破了此前25.5的业界准确回答“卡点”。

让AI学会像医学专家那样思考

研究背景

现在,基于大语言模型 (LLM) 的Agent已展现出跨越多个领域的卓越能力。

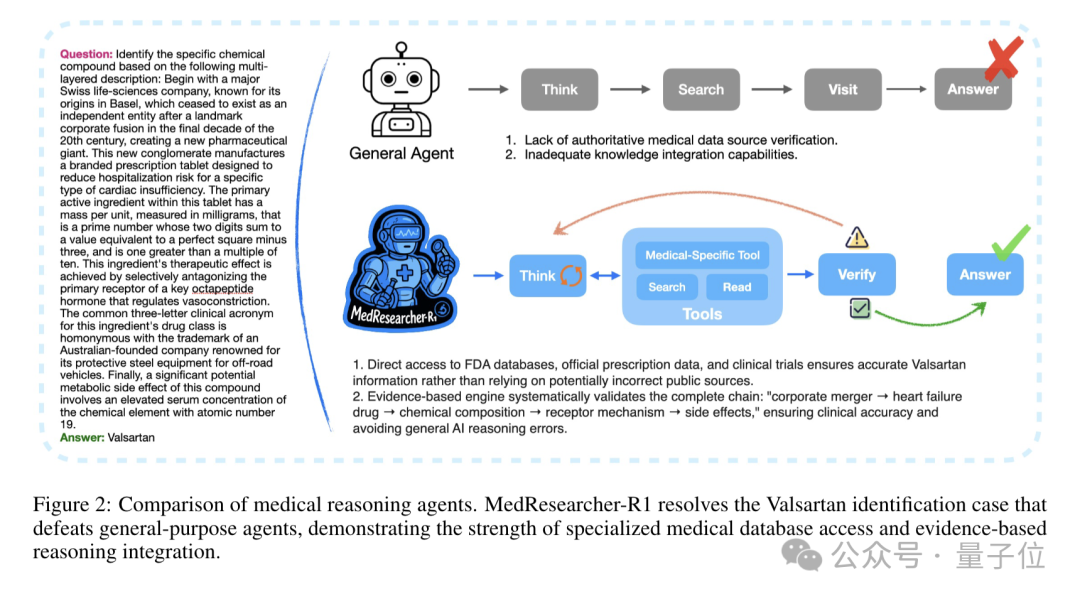

例如深度研究系统在复杂信息搜索和合成任务中就展现了高性能。但它们在医疗等专业领域容易出现不同程度的“水土不服”,面对复杂医疗查询时也常“掉链子”,核心问题就两个:

- 缺“专业储备”:通用模型没有密集的医疗知识,面对罕见病、多病症关联等场景,支撑不了临床推理;

- 缺“精准工具”:依赖公开网页搜索的通用工具,要么找不到权威医疗数据,要么被错误信息干扰,无法保障推理严谨性。

而MedResearcher-R1的突破源于数据、工具、训练方法三大核心创新。

据此,蚂蚁团队提出了知识指引下的轨迹合成框架(KISA),在12个医学专业领域生成了2100多条不同的轨迹,每条轨迹平均与4.2个工具交互,为构建“专家级AI医疗研究员”提供了全新范式。

三大核心技术:不堆参数,只做 “精准突破”

MedResearcher-R1没有走“堆参数、喂海量数据”的老路,而是从“让AI学会像医学专家那样思考”出发,做了三个关键设计:

1. 主动 “造难题”:从3000万文献里炼出“4.2步推理题”

传统AI训练靠“啃现成数据”,而MedResearcher-R1学会了“自己造题”,尤其是医疗领域的“高难度研究型问题”。

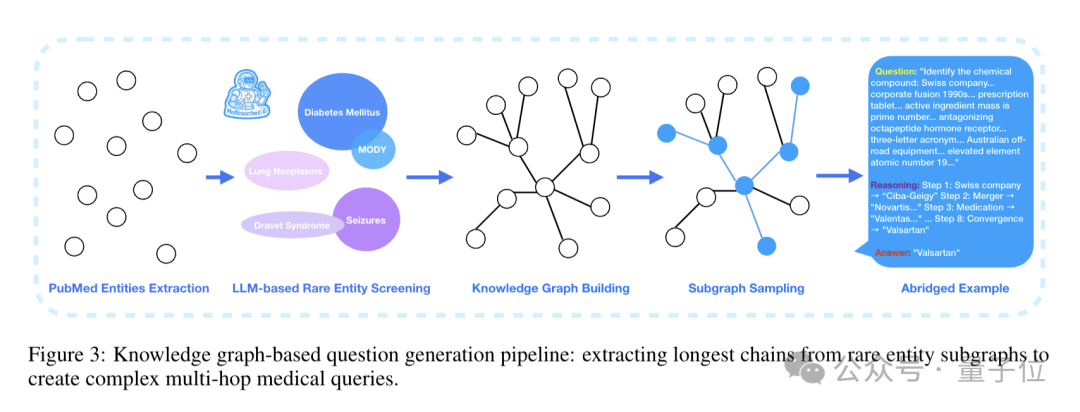

研究团队先从超过3000万篇医学文献中,筛选出罕见病、特殊药理机制等“冷门但关键”的医学实体,再围绕这些实体搭建知识图谱。

最核心的一步是:从知识图谱里提取“最长推理路径”——比如“罕见遗传病→关联基因→靶向药物→代谢副作用”的多环节链条,最终生成需要平均调用4.2次工具才能解决的复杂问题。

这意味着AI训练时学的不是“翻书查答案”,而是“拆解问题、逐步验证”的专家级思维,比如面对“某罕见心脏病的用药副作用”,它会主动追溯药物机制、临床数据,而非直接套模板回答。

2. 专属“工具箱”:不囿于公开搜索,直连权威医疗数据源

通用领域Deep Research Agent的“软肋”之一,是只能依赖公开网页搜索。

在医疗场景里,未经筛选的网络公开检索信息不仅可能过时,还可能混杂非临床级数据。

MedResearcher-R1直接配备了私有化部署的医疗专用工具集:通过直接访问国际医疗指南、核心医学期刊等一手权威信源,尽可能从根源上避免“信息噪音”。

比如在回答“某药物成分”时,它会直接调取官方药品注册数据,而非依赖可能出错的公开科普;验证“药物副作用”时,会对接临床验证结果,确保每一步推理都有权威依据。

3. 不教“背诵”教“思考”:「蒙版轨迹引导(Masked Trajectory Guidance)」技术“逼”出AI的自主能力

怕AI“死记硬背”?MedResearcher-R1的训练方法直接改道而行。

研究团队用了一种“蒙版轨迹引导(Masked Trajectory Guidance)”技术:训练时只给 AI一个“推理框架”(比如“疾病→药物→副作用”的逻辑链),但隐藏关键实体信息(比如具体疾病名称、药物成分)。

这就逼着AI必须主动调用工具:查疾病指南确认病症、搜药品数据库匹配成分、验临床数据验证副作用,最终自己“拼出”完整推理链。

这种训练不是“喂答案”,而是“教方法”——最终提升了小模型的泛化能力,在面对没见过的新医疗问题,也能像人类研究员一样自主拆解、验证。

举个具体例子:当被问及“某药物的活性成分(需满足质数剂量、受体拮抗机制等多条件)”时,通用AI通常会根据各种公开信息进行全面整理给出不同答案;

而MedResearcher-R1会先查企业史锁定药企,再调取药物信息,接着验证成分的化学结构与受体机制,最后确认副作用 ——整套流程复刻人类医学研究员的工作逻辑,最终给出具体药物名称。

既要追求专业,还要“不偏科”

更值得注意的是,蚂蚁还在攻克其专业模型的 “通用研究能力”提升,试图打破“专业模型只能干一行”的刻板印象。

从GAIA、xBench等通用AI助手基准测试结果来看,MedResearcher-R1的表现也保持业界前列,初步验证小规模模型可以同时兼具“领域深度”和“通用广度”,避免因为“专精医疗”而变成“偏科生”。

MedResearcher-R1等专业模型发展的意义,不在于一次次测试结果,而是验证另一种可能性:在医疗、法律、工业等专业领域,“参数规模”不是唯一解药,“Agentic Data”才是破局关键——通过精准的数据源搭建、专用工具开发、创新训练方法,小规模模型有机会能啃下硬骨头。

在容错率极低的医疗领域,专业模型仍然需要不断提升可解释性、合规性等,这也是行业未来面临的共同挑战。

目前,研究团队已宣布将MedResearcher-R1的代码和数据集开源,希望在推动全球研究者在该领域的协同创新,加速开发能够辅助人类专家、提升医疗研究效率与质量的下一代AI工具。

感兴趣的朋友可通过官网链接直接体验。

官网链接:https://chat.antaq.com/

报告地址:https://arxiv.org/abs/2508.14880

— 完 —

量子位 QbitAI · 头条号签约

关注我们,第一时间获知前沿科技动态

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง