马斯克入局AI编程!新模型限时免费用:256K上下文,主打一个速度快

价格是Sonnet 4的十分之一

闻乐 鹭羽 发自 凹非寺

量子位 | 公众号 QbitAI

刚刚,马斯克xAI加入C++oding战局:推出智能编程模型Grok Code Fast 1。

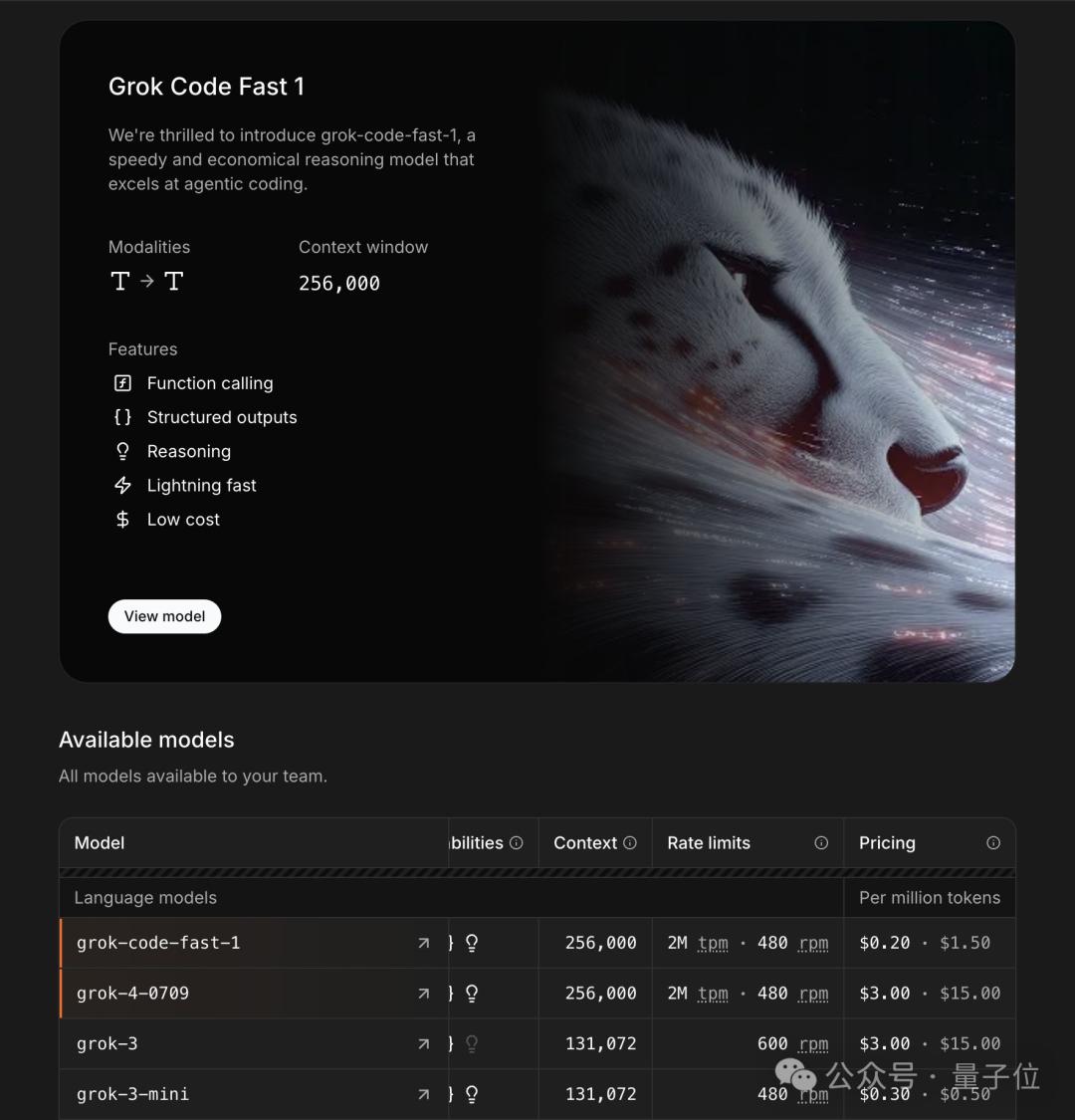

Fast写进名字里,新模型主打的就是快速、经济,且支持256K上下文,可在GitHub Copilot、Cursor、Cline、Kilo Code、Roo Code、opencode和Windsurf上使用,还限时7天免费!

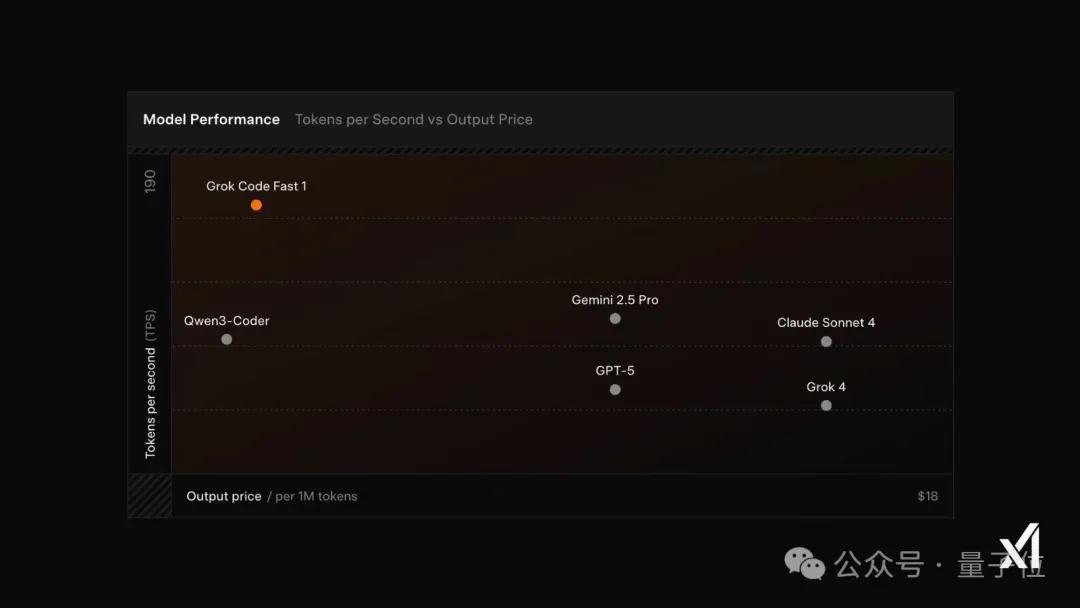

不仅性能比肩Claude Sonnet 4和GPT-5,价格更是只有它们的十分之一。

已经有网友在Cursor上用Grok Code Fast 1制作了一个模拟战斗的小游戏,可实现持续交互。

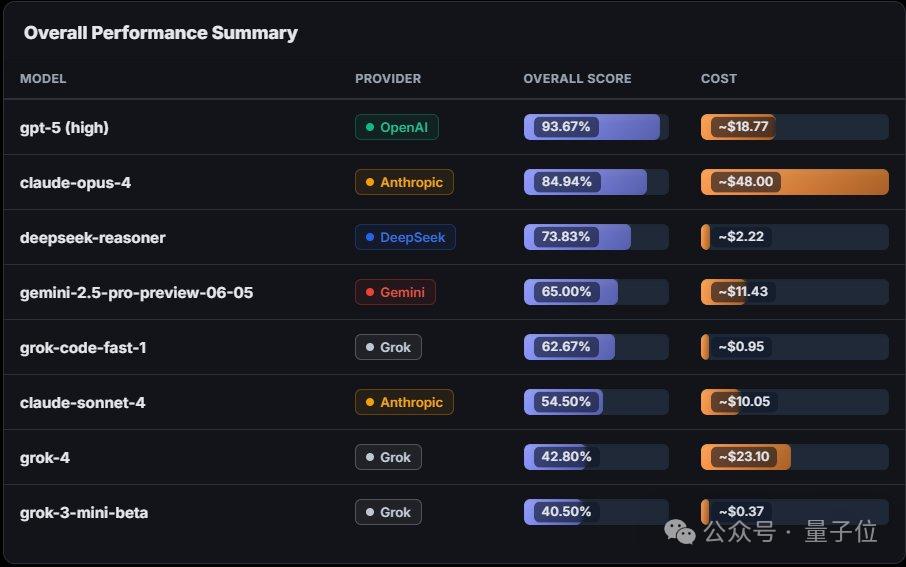

目前,Grok Code Fast 1在ToyBench上的整体排名为第5名,仅次于GPT-5、Claude Opus 4、Gemini 2.5 Pro和DeepSeek Reasoner。

近期,各家发布的新产品可不少,让人感叹:AI发展太快了……

能力如何?

先来看一波网友实测。

首先,第一感受就是确实快,思考时长基本在几秒之内。在VS Code开源免费的扩展Cline中即可使用。

还有人将Grok Code Fast 1添加到聊天机器人中,只需要简单的prompt:

展示真正优秀的pygame。

就得到了如下随机的多媒体效果,看上去也非常丝滑~

不只游戏模拟器,Grok Code Fast 1对UI设计也手拿把掐。

在多指令下构建的时间晶体的细节展示也很到位。

确实,不少体验者都表示,这个新模型在指令遵循方面表现很优秀。

看完实测案例,再来看看模型情况。

兼具速度与性价比

根据官方透露出的消息,Grok Code Fast 1从零开始搭建了全新的模型架构,使用专门的代码语料库进行预训练,并利用真实世界拉取请求与编码任务数据进行微调。

另外,还与GitHub Copilot、Cursor、Roo Code等平台深度合作,让模型能够在IDE中快速理解开发者指令,完成如grep、终端和文件编辑等常用工具的使用。

借助推理加速和提示缓存优化,模型能在你还没读完思维流程第一段文字时,就已经执行了数十种工具调用。

指令缓存命中率更是超过90%,用户体验将会极度顺畅,让响应毫无卡顿的感觉。

除了快,Grok Code Fast 1还具有很强的通用性,无论是TypeScript、Python、Java,还是Rust、C++、Go,它都可以轻松完成,从创建项目到点对点的bug修复,而无需人工监督。

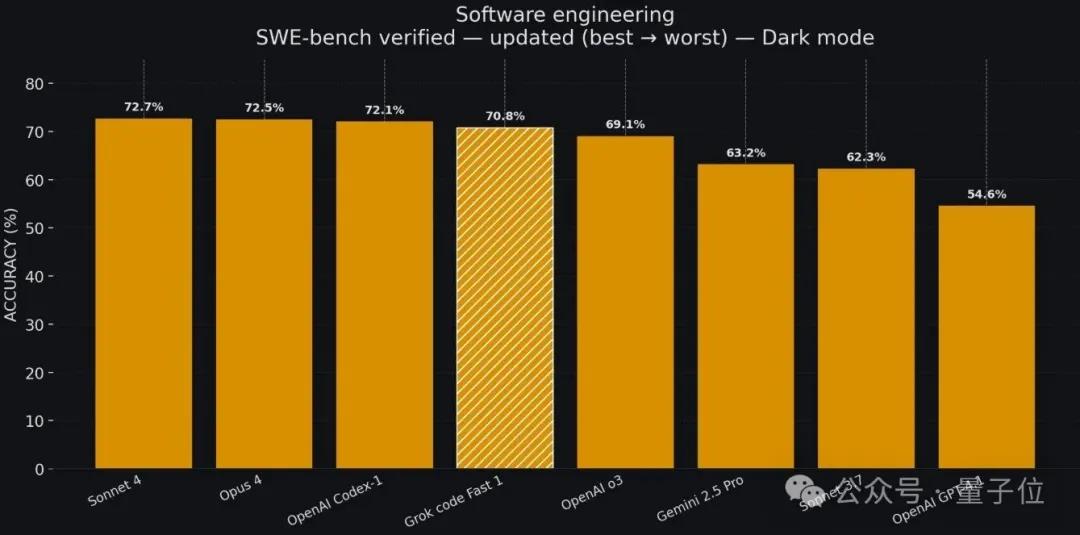

在内部基准测试SWE-Bench-Verified的完整子集上,grok-code-fast-1成绩可达70.8%,在其余一众编程模型中,性能也处于较为领先的程度。

除了传统基准,测试过程中还额外添加了开发者主观评估与自动化行为监控,确保模型快速可靠,满足日常编码任务。

支持256K的上下文窗口,每分钟最多请求数是480,每分钟可处理约200万token。

对于日常高频编码用户,这个价格可以说是相当友好了,在性能上也不输其他编程模型。

另外,官方也和Grok 4做了对比,Grok 4更适合单次问答类场景,如复杂概念解析或深度调试,需要事先提供充足上下文。

而Grok Code Fast 1作为轻量级智能编码模型,更适用于多步骤、工具调用密集的复杂自动化任务,是兼具速度和效率的AI代码助手。

此次更新中,最亮眼的莫过于Grok Code Fast 1超高的性价比。

每1M输入tokens只需要0.2美元(折合人民币约1.4元),输出tokens需要1.5美元(约10.7元),缓存调用tokens更是仅需0.02美元(约0.14元)。

与Claude Sonnet 4和GPT-5相比,相当于是只有别人的10%。

现在更是7天内可以免费使用……

所以已经用过的朋友,快来说说马斯克家的AI coding体验够不够地道?

参考链接:

[1]https://x.com/xai/status/1961129789944627207

[2]https://www.reuters.com/business/musks-xai-forays-into-agentic-coding-with-new-model-2025-08-28/

[3]https://docs.x.ai/docs/models/grok-code-fast-1

[4]https://docs.x.ai/docs/guides/grok-code-prompt-engineering

— 完 —

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง