腾讯版“Claude Code”来了!AI编程L4时代is coming

面向所有用户开放使用,无需邀请码

允中 发自 凹非寺

量子位 | 公众号 QbitAI

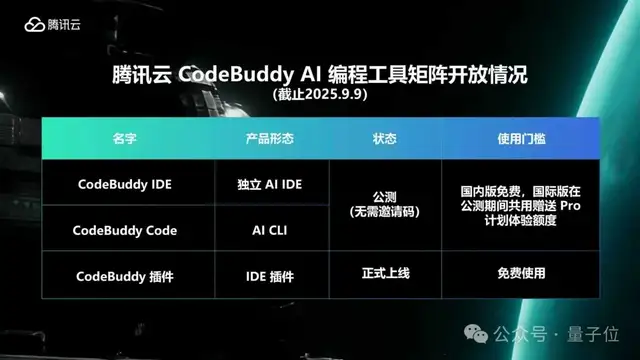

9月9日,腾讯发布AI CLI工具CodeBuddy Code,并宣布CodeBuddy IDE开启公测,面向所有用户开放使用,无需邀请码。

IDE和CLI都区分了国内外版本,分别支持海内外模型。国内版无限制使用;国际版测试期间赠送部分Pro模型体验额度,IDE和CLI共享。

CodeBuddy Code定位于专业工程师用专业的 CLI Agent,基于npm安装(指令npm install -g @tencent-ai/codebuddy-code),支持用自然语言驱动整个开发运维生命周期,实现极致自动化效率提升。

显然,这就是腾讯版的“Claude Code”。

之前Claude Code几乎垄断AI CLI,但伴随着最近Claude作妖事件,也让中国开发者纷纷表示要弃用。这个节骨眼上,腾讯自研的AI CLI出来得刚刚好,而且国内版直接集成DeepSeek免费使用,在很多运维场景中也完全够用了。

比如,它已经可以自己给自己做需求了……

腾讯的工程师在直播中演示了他们用CodeBuddy Code开发CodeBuddy Code一个真实场景:

当时,研发在企业微信群中接收到一个需求,通过截图和自然语言描述给到CodeBuddy Code,进行需求理解、特性分支创建、AI 编程、创建 MR和 Commit Message,全程不用写一行代码。

这个AI有两下子,还能自己开发自己…

伴随CodeBuddy Code的诞生,腾讯云CodeBuddy成为业内首个同时支持插件、IDE和CLI三种形态的AI编程工具矩阵。

AI Coding迈入L4时代,CLI成为基础设施

随着AI编程能力的快速发展,软件工程正在经历一场范式级变革。

从最早的“单文件代码补全”,到如今可参与项目级开发与多智能体写作的AI工具,AI的角色正逐步从“辅助”升级为“驱动”。

我们可以把AI编程工具的发展划分为五个层次:

- L1,文档级补全:能够在单文件内进行代码生成和优化;

- L2,任务级自动化:能够处理子流程任务,需要精心设计上下文与提示词;

- L3,项目级自动化:从需求到PR的端到端流程,适合小型项目;

- L4,AI软件工程师:独立承接复杂项目,辅助架构与策略决策;

- L5,AI开发团队:多智能体写作,处理企业级复杂项目。

在这个过程中,AI CLI形态的出现改变了市场的格局。产品形态也从最早只有IDE插件,到今天插件、AI IDE和AI CLI三种形态并存。

Claude Code开创了AI CLI形态,提供了完整的自动化流水线:集成了传统CLI的所有优势,适合自动化、批处理、远程操作,可嵌入企业开发者流水线,且拥有了AI的智能。

命令行形式门槛太高不适合非技术用户,却很适合专业开发者,尤其是企业级的开发者。

于是它一经推出,深受专业开发者喜爱。

AI CLI形态的出现也标志着AI大模型智能能力的进一步提升。因此,腾讯认为,在2025-2026年,AI编程将向L4级AI软件工程师演进;到2027年,开始向L5级迈进。

同时,随着AI智能体能力的逐级攀升,大模型业内逐渐形成一种新的共识:

而随着AI智能体能力的逐级攀升,大模型业内逐渐形成一种新的共识:

CLI(命令行界面)正在成为下一代AI编程的底层基础设施。

其关键在于,未来,AI不再只是IDE插件,而是能够深度嵌入企业开发流程的智能协作伙伴。

为什么CLI是企业级AI编程的未来

不同开发场景对AI工具的需求完全不同。

比如IDE/插件模式,适用于单人开发者或小团队,特点是AI提供建议,人工手动确认。

可视化编程平台则更适用于非技术人员与技术人员的快速开发场景,AI能够生成完整代码文件,图形可视化。

而CLI模式,适用对象正是需要大规模写作的企业级团队。这种模式下,AI支持多模块、多任务自动化,深度集成CI/CD,能够保证安全与权限控制。

在企业级场景中,CLI模式具有天然优势:

- 易于集成

- 可与Git、CI/CD、监控系统、日志分析工具无缝结合。高效协作

- 支持多文档、多任务、多智能体并行处理,提升团队效率。全链路自动化

从任务分解到部署上线,几乎覆盖整个软件生命周期。CLI更像是企业级开发的操作系统,让AI从“代码生成器”升级为全流程开发伙伴。

目前,腾讯内部超90%工程师都在用CodeBuddy,整体编码时间平均缩短40%以上,AI生成代码占比超50%,结合内部大规模投产经验,研发提效超16%。

CodeBuddy团队透露,对比2024年腾讯内部实践看来,今年AI代码生成覆盖的流程广泛,更加侧重以智能体为代表的项目级代码生成而不仅是代码补全,同时更加关注AI代码评审环节,AI生成代码占比从35% 增加到50%;AI在代码评审中贡献占比从12%增加到35%。

腾讯认为,随着AI CLI工具的普及,AI开发的代码占比将会更高,超过90%。

CLI驱动的智能编程平台

腾讯的CodeBuddy Code正是一个CLI驱动的智能编程平台。

它定位于专业工程师用专业的 CLI Agent,基于npm安装,支持用自然语言驱动整个开发运维生命周期,实现极致自动化效率提升。

1. 安装命令:

npm install -g @tencent-ai/codebuddy-code

2. 进入项目目录:

cd your-project-dir

3、 启动Codebuddy Code

codebuddy

其核心功能亮点包括:

- 自然语言交互:无需学习复杂命令,直接输入需求

- 文档驱动管理:任务与模块可溯源、可共享

- 多智能体协作:前端、后端、DevOps、安全Agent分工合作

- 长期记忆 + 上下文压缩:跨会话、跨项目的连续理解

- 与Git/CI/CD深度集成:覆盖从开发到上线的全链路自动化

CodeBuddy.md

CodeBuddy Code会将项目上下文管理在CodeBuddy.md文件中,形成一个 可追踪、可共享的智能工作空间。

# 初始化工作空间

codebuddy /init

# 使用自然语言描述任务

codebuddy “设计电商订单系统:购物车 + 订单处理 + 支付 + 库存”

# 进入交互式终端,支持选择 @file

codebuddy

> 在输入框中选择文件并输入:

@file1 设计电商订单系统:购物车 + 订单处理 + 支付 + 库存

这种文档驱动开发模式让 AI 能够理解历史决策、架构约束和团队约定,从而实现长期上下文管理。

上下文压缩与长期记忆

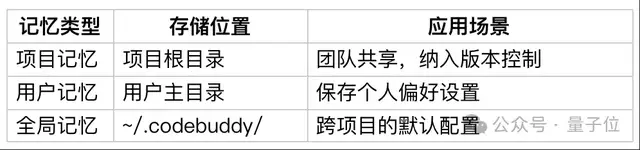

在长期项目中,AI需要持续理解数百次交互内容。CodeBuddy Code通过语义化上下文压缩 + 项目级长期记忆实现智能管理。

核心机制是:

- 自动压缩:上下文达到阈值时,系统自动触发压缩。

- 手动压缩:开发者可通过 /compact 命令手动压缩,降低token消耗。

- 语义保持:智能提取关键信息,避免丢失项目上下文。

- 增量更新:只更新变化的部分,降低计算成本。

其记忆体系如下:

MCP(Memory & Context Plugin)扩展

MCP是CodeBuddy Code的上下文扩展协议,可以实时接入外部知识源。

例如,安装Context7 MCP后,可以让CodeBuddy获取最新的软件文档和示例。

安装步骤如下:

# 1. 退出 CodeBuddy Code

# 2. 安装 MCP

npx -y @upstash/context7-mcp@latest

# 3. 配置远程 MCP

codebuddy mcp add –transport http context7 https://mcp.context7.com/mcp

# 或使用 SSE 传输

codebuddy mcp add –transport sse context7 https://mcp.context7.com/sse

# 4. 验证是否安装成功

codebuddy mcp list

# 如果看到 “Connected” 状态,表示安装完成

CodeBuddy Code实战工作流

在真实企业项目中,一个典型的CodeBuddy Code工作流如下:

1. 项目初始化

codebuddy /init

2. 智能架构设计

codebuddy "设计支持千万商品的电商搜索系统,包含 ES 集群、缓存策略和降级方案"

3. 安装与配置 MCP

4. 按照上节步骤安装 Context7,持续优化与重构

codebuddy "基于性能测试结果优化查询性能"

5. 安全执行与自动化部署

未来,CodeBuddy Code将可以通过生态扩展集成沙盒运行、权限控制、审计机制,确保企业级安全。

实际上,像CodeBuddy Code这样的产品,代表了企业级AI编程的新方向:

- CLI驱动:让AI融入开发流程,而不是外挂插件

- 多智能体协作:前后端、DevOps、测试、安全全链路打通

- 文档化上下文管理:保持长期记忆,支撑大型项目开发

对开发者而言,掌握这一范式,意味着从“代码执行者”升级为AI协作架构师。

这不仅是工具的迭代,更是软件工程思维的升级。

— 完 —

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง