精准锁定「硬骨头」:难样本筛选破局SFT依赖,GRPO-only斩获感知推理双最优

难度采样+GRPO-only首次跑赢SFT范式

中兴通讯AIM团队 投稿

量子位 | 公众号 QbitAI

一组被AAAI 2026接收的新实验,一口啃向了多模态大模型后训练的硬骨头

在视觉推理与视觉感知两大类基准测试上,只用中等+困难样本训练、且完全不做SFT的GRPO-only范式,反而拿下几乎所有最优成绩。

MathVista最高68.3、OCRBench达77.8、MMMU提升0.107、MMStar提升0.083,相比全量数据训练大幅跃升,甚至全面超越传统的“SFT+RL”双阶段范式。

结论直截了当:

多模态后训练环节里,样本难度比训练范式更关键,而SFT并非RL的必要前置步骤。

这项由中南大学&中兴通讯团队完成的新研究,为多模态大模型找到了可量化、可操作的“难度采样”标准,并第一次系统性验证了一个过去被视为“不可能有效”的训练路线,即仅靠RL强化策略(GRPO),就能独立完成多模态能力的优化。

而研究切入点,正是多模态后训练长期卡住的两个老问题。

第一,缺乏可量化的样本难度指标。

多模态数据包含视觉与文本双重特征,文本模态难度常无法直接表征多模态样本整体难度(如OCR、目标检测等任务),因此无法沿用纯文本数据的难度划分方式,导致难以筛选对模型优化具有高价值的训练样本。

第二,训练范式无法协同优化感知与推理能力。

现有方法多采用“监督微调+强化微调”的固定流程,且大多数研究侧重于提升模型的推理性能,但多模态场景常常既包含视觉推理类(数学、科学、图表分析等),又包含视觉感知类(目标检测、目标定位、计数、OCR等),单一范式可能无法适配两类数据的训练需求,导致模型在感知或推理任务中出现性能偏科。

针对这些痛点,团队从模态内敏感性与跨模态交互复杂度双重视角,提出PISM(渐进式图像语义掩码)与CMAB(跨模态注意力平衡)两种难度量化策略,并设计分层训练框架,验证了强化学习独立优化多模态能力的可行性,为多模态后训练提供全新技术路径。

核心方法:难度感知采样策略与训练框架

研究人员提出了2种互补的难度量化策略,分别从视觉敏感性与跨模态注意力平衡维度来实现样本难度分层。

渐进式图像语义掩码(PISM)

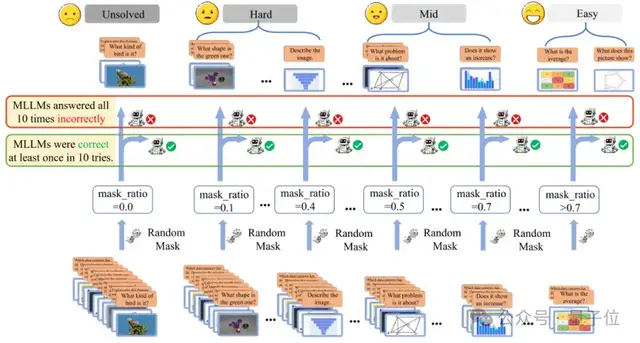

下面是渐进式图像语义掩码(PISM,Progressive Image Semantic Masking)方法示意图。

从无掩码(mask_ratio = 0.0)到重度掩码(mask_ratio > 0.7),研究团队渐进式地对图像的不同部分进行掩码操作。

每张掩码图像通过随机隐藏一定比例的像素区域,该过程模拟了不同程度的视觉信息损失。

随后在这些掩码图像上评估模型性能,以了解模型为了准确推理对视觉细节的依赖程度。

如图所示,PISM基于“难样本对视觉信息损失更敏感”的核心假设,通过系统的图像退化实验量化样本难度,具体流程如下:

1、掩码设计。

对图像-文本样本对s=(I,Q),设置掩码比例序列Λ={λi|λi=0.0,0.1,…,0.9},模拟从无退化(λ=0.0)到重度退化(λ=0.9)的视觉信息损失场景。

2、性能评估。

对每个掩码比例λi

,生成扰动图像

(M(·)

为随机像素掩码操作),输入模型得到预测结果

,通过二元指标

(1表示预测正确,0表示错误)评估性能。

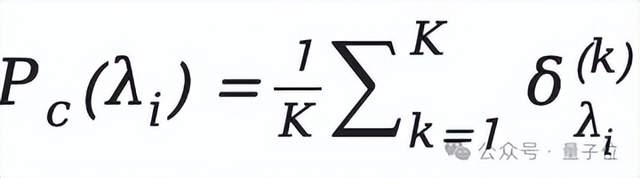

3、鲁棒性计算。

为降低随机性影响,每个掩码比例重复实验K=10次,计算鲁棒准确率

。

4、难度划分。

定义失败阈值

,据此将样本分为4类:

跨模态注意力平衡(CMAB)

下面是跨模态注意力平衡(CMAB,Cross-Modality Attention Balance)方法示意图。

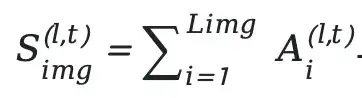

对于每个生成token,我们计算其在所有Transformer层上对输入文本token和图像token的平均注意力分数,然后对所有生成的token的这些分数取平均值。

(N) 代表Transformer的总层数。

如上图所示,CMAB通过分析模型生成响应时对文本和对图像的注意力之比,评估跨模态交互复杂度,具体逻辑如下:

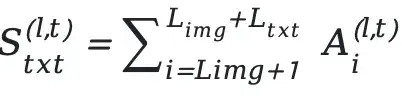

1、注意力分解。

对输入的图像

与文本

计算模型生成每个响应token y

t

时,在第l层Transformer的跨模态注意力权重

,并分解为图像注意力总和

与文本注意力总和

。

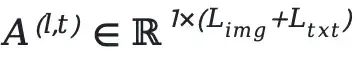

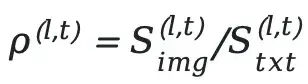

2、注意力平衡比计算。

定义跨层的token级注意力平衡比

,为降低层间噪声,排除首末层(主要负责输入编码与输出解码),计算几何均值

(ε≈10

-8避免数值不稳定)。

3、样本级平衡比。

对所有响应token取算术平均,得到样本级注意力平衡比

。

4、难度划分。

基于

区分样本难度:

分层训练框架与实验设计

基于PISM与CMAB的难度分层结果,设计两种后训练范式进行对比。

第一种,GRPO-only范式。

直接对难度分层后的样本(为中等+困难样本)应用组相对策略优化(GRPO,Group Relative Policy Optimization,),无SFT预处理。

第二种,SFT+GRPO范式。

先对筛选后的样本(如困难样本、中等样本)进行SFT,再对目标样本应用GRPO,并测试SFT阶段样本难度顺序(如SFT(困难)+GRPO(中等)、SFT(中等)+GRPO(困难))对模型性能的影响。

实验配置如下:

- 基础模型:Qwen2.5VL-7B(多模态大模型,支持视觉-文本联合推理);

- 硬件环境:5个节点(每节点8×80GB NVIDIA A800 SXM4 GPU)+2个节点(每节点8×96GB NVIDIA H20 GPU);

- 框架工具:SFT基于LLaMA-Factory实现,GRPO基于Swift框架实现,评估基于OpenCompass框架,采用GPT-4o-mini作为统一评分器;

- 基准数据集:涵盖6类通用场景的多模态任务。

实验结果与分析

PISM策略下的性能对比(以视觉推理数据集为例)

下表展示了PISM分层后,不同训练范式在视觉推理数据集上的性能。

(注:表1,通过PISM在视觉推理数据集上使用SFT+GRPO和仅使用GRPO的训练结果比较,*表示次优结果,加粗表示最优结果)

从表中可观察到——

第一,GRPO-only(中等+困难)范式优势显著。

在MathVista(68.300)、OCRBench(77.800)、MMMU(0.547)、MMStar(0.639)4项指标上均取得最优,较全量数据GRPO-only提升幅度最大(MathVista提升14.9分,MMMU提升0.107);

第二,SFT阶段未带来增益。

所有SFT+GRPO范式的性能均低于GRPO-only(中等+困难),且SFT阶段样本难度顺序对结果影响较小(如SFT(中等)+GRPO(困难)与SFT(困难)+GRPO(中等)性能接近),说明SFT可能引入“伪思维链”(Pseudo-CoT),限制模型真实推理能力;

第三,随机样本性能有限。

GRPO-only(随机样本)虽在部分指标(如MMVet)表现较好,但整体低于中等+困难样本训练结果,验证了难度分层对样本质量筛选的有效性。

CMAB策略下的性能对比(以视觉感知数据集为例)

下表展示了CMAB分层后,不同训练范式在视觉感知数据集上的性能。

(注:表2,通过CMAB在视觉感知数据集上对采用SFT+GRPO和GRPO-only两种训练方式的结果对比,*表示次优结果,加粗表示最优结果)

从表中可观察到CMAB在推理任务中优势凸显——

GRPO-only(中+困难)在MathVista(68.300)、MMVet(50.367)、MMMU(0.550)、MMStar(0.629)上表现最优,尤其在需要跨模态深度融合的任务中(如MathVista),较SFT+GRPO范式提升1.5-2.5分,验证了CMAB对跨模态交互复杂度评估的有效性。

推翻“SFT是RL后训练必要前提”的传统认知关键结论

通过以上实验,研究团队得出了一系列结论。

首先,难度感知采样是核心。

无论PISM还是CMAB,基于中等+困难样本的GRPO-only训练均显著优于全量数据、随机样本及SFT+GRPO范式,证明“数据质量(难度分层)比数量更重要”。

其次,GRPO-only范式可行。

实验推翻了“SFT是RL后训练必要前提”的传统认知,GRPO-only在排除SFT后,极大地简化了训练流程,提高了模型后训练效率,为多模态模型通用训练提供新思路。

该研究提出多模态样本难度量化标准,首次从视觉敏感性与跨模态注意力平衡两个维度,建立可量化的多模态样本难度评估体系,解决了多模态数据“难筛选”问题。

通过聚焦多模态后训练的“样本筛选”核心问题,为多模态大模型性能提升提供了全新技术路径,也为后续研究打开了“数据驱动优化”的新视角。

最后,研究团队还提出了三个未来研究方向:

- 动态难度调整:当前难度评估为静态,未来可结合模型训练过程动态更新样本难度,实现自适应课程学习;

- 多策略融合:探索PISM与CMAB的联合采样策略,进一步提升样本筛选精度;

- 更大模型验证:在百亿参数级多模态模型上验证方法有效性,探索难度感知采样在更大尺度模型中的泛化性。

目前,研究代码已开源,扩展版本包含详细实验配置,为后续研究提供可复现的技术基础。

期待更多研究者基于此方法,推动多模态AI在医疗、教育、自动驾驶等领域的实际应用。

arXiv:

https://arxiv.org/abs/2511.06722

GitHub:

https://github.com/qijianyu277/DifficultySampling

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง